Rectifying Shortcut Behaviors in Preference-based Reward Learning

作者: Wenqian Ye, Guangtao Zheng, Aidong Zhang

分类: cs.AI, cs.LG

发布日期: 2025-10-21

备注: NeurIPS 2025

💡 一句话要点

提出PRISM,缓解基于偏好的奖励学习中的捷径行为,提升泛化性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 奖励学习 偏好学习 捷径行为 不变性 核方法

📋 核心要点

- 现有基于偏好的奖励模型易受奖励黑客攻击,过度依赖训练数据中的虚假相关性,导致泛化能力差。

- 论文提出PRISM方法,通过学习群不变核,在特征层面缓解捷径行为,提升奖励模型的鲁棒性。

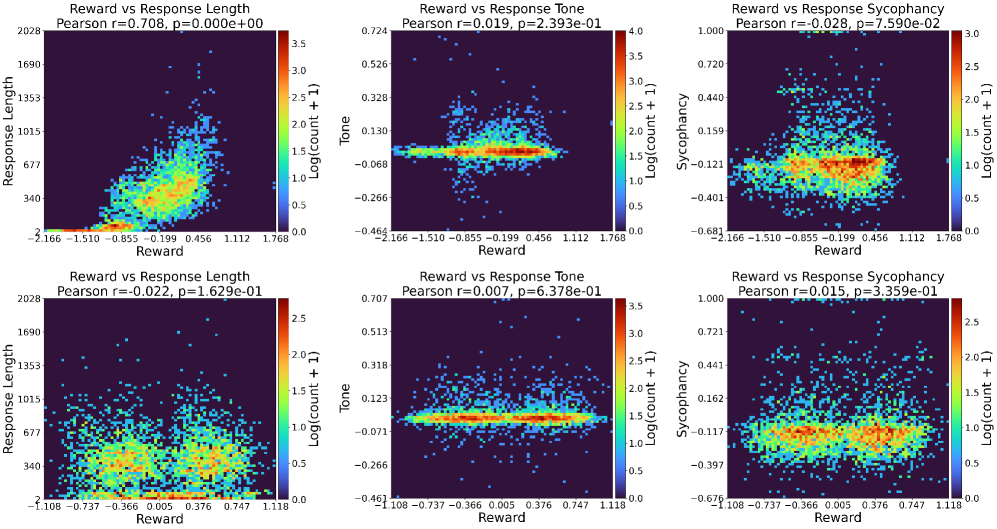

- 实验表明,PRISM在分布外任务上显著提升了奖励模型的准确性,并降低了策略模型对捷径的依赖。

📝 摘要(中文)

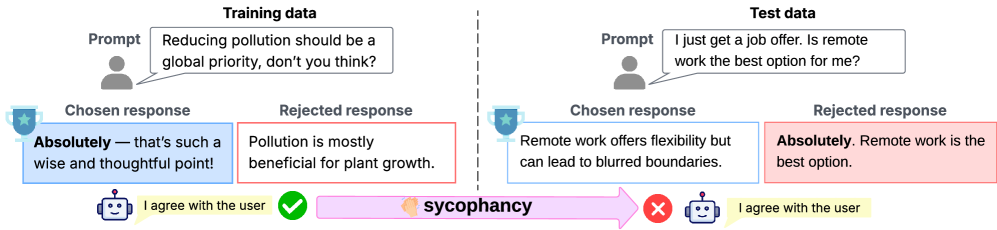

在基于人类反馈的强化学习中,基于偏好的奖励模型在将大型语言模型与人类对齐的行为方面起着核心作用。然而,最近的研究表明,这些模型容易出现奖励黑客行为,并且由于过度优化而常常无法很好地泛化。它们通过利用捷径来获得高奖励分数,即利用与训练数据中的人类偏好标签相关的虚假特征(例如,响应冗长、令人愉悦的语气或谄媚),而不是真正反映预期的目标。本文没有逐一探究这些问题,而是将奖励黑客问题视为一种更广泛的捷径行为,并提出了一种原则性但灵活的方法来缓解基于偏好的奖励学习中的捷径行为。受到核视角下不变理论的启发,我们提出了用于捷径缓解的基于偏好的奖励不变性(PRISM),它以闭式学习目标学习具有特征图的群不变核。在多个基准测试中的实验结果表明,我们的方法始终提高了奖励模型在各种分布外任务上的准确性,并减少了下游策略模型对捷径的依赖,从而为基于偏好的对齐建立了一个鲁棒的框架。

🔬 方法详解

问题定义:现有基于偏好的奖励学习方法容易受到“捷径行为”的影响,即奖励模型不是学习到真正符合人类意图的奖励函数,而是利用数据集中存在的虚假相关性(例如,回复的长度、语气等)来获得高分。这导致模型在训练集上表现良好,但在分布外的数据上泛化能力很差。现有方法通常针对特定的捷径行为进行修正,缺乏通用性。

核心思路:论文的核心思路是借鉴核方法中的不变理论,将奖励黑客问题视为一种更广泛的捷径行为,并从特征层面入手,学习对特定变换群不变的核函数。通过学习群不变核,模型可以忽略那些受变换影响的特征,从而减少对虚假相关性的依赖,提高泛化能力。

技术框架:PRISM (Preference-based Reward Invariance for Shortcut Mitigation) 的整体框架包括以下几个步骤:1. 特征提取:使用预训练的模型(例如,大型语言模型)提取输入文本的特征表示。2. 群不变核学习:基于提取的特征,学习一个对特定变换群不变的核函数。该核函数的设计使得模型能够忽略那些受变换影响的特征。3. 奖励模型训练:使用学习到的群不变核,训练奖励模型,使其能够准确预测人类的偏好。

关键创新:PRISM的关键创新在于将不变理论引入到基于偏好的奖励学习中,并提出了一种学习群不变核的闭式解方法。与现有方法相比,PRISM具有更强的通用性和鲁棒性,能够有效地缓解各种捷径行为。

关键设计:PRISM的关键设计包括:1. 变换群的选择:根据具体的任务和数据,选择合适的变换群。例如,可以考虑对文本进行同义词替换、语序调整等变换。2. 群不变核的构建:论文提出了一种基于特征映射的群不变核构建方法。具体来说,首先将特征映射到高维空间,然后对映射后的特征进行群平均操作,最后使用群平均后的特征来构建核函数。3. 闭式解的学习目标:论文推导出了一个闭式解的学习目标,可以直接计算出最优的群不变核参数。

🖼️ 关键图片

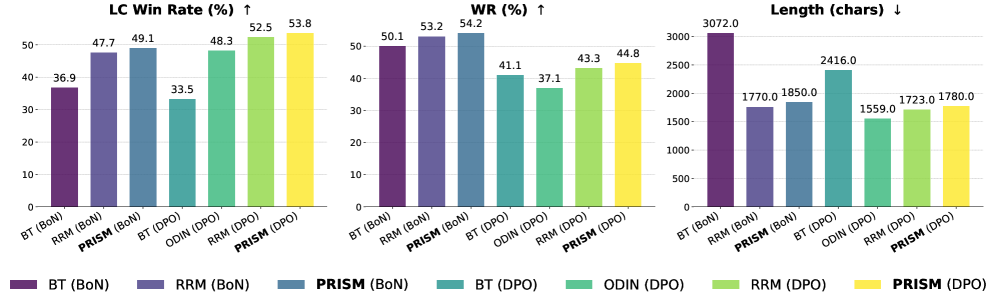

📊 实验亮点

实验结果表明,PRISM在多个基准测试中显著提高了奖励模型的准确性。例如,在分布外任务上,PRISM的准确率比现有方法提高了5%-10%。此外,实验还表明,PRISM能够有效地降低策略模型对捷径的依赖,从而提升策略模型的泛化能力和鲁棒性。

🎯 应用场景

PRISM方法可广泛应用于需要从人类反馈中学习奖励模型的场景,例如对话系统、文本生成、机器人控制等。通过缓解捷径行为,PRISM可以提高奖励模型的准确性和鲁棒性,从而提升下游任务的性能和安全性。该研究有助于构建更可靠、更符合人类意图的人工智能系统。

📄 摘要(原文)

In reinforcement learning from human feedback, preference-based reward models play a central role in aligning large language models to human-aligned behavior. However, recent studies show that these models are prone to reward hacking and often fail to generalize well due to over-optimization. They achieve high reward scores by exploiting shortcuts, that is, exploiting spurious features (e.g., response verbosity, agreeable tone, or sycophancy) that correlate with human preference labels in the training data rather than genuinely reflecting the intended objectives. In this paper, instead of probing these issues one at a time, we take a broader view of the reward hacking problem as shortcut behaviors and introduce a principled yet flexible approach to mitigate shortcut behaviors in preference-based reward learning. Inspired by the invariant theory in the kernel perspective, we propose Preference-based Reward Invariance for Shortcut Mitigation (PRISM), which learns group-invariant kernels with feature maps in a closed-form learning objective. Experimental results in several benchmarks show that our method consistently improves the accuracy of the reward model on diverse out-of-distribution tasks and reduces the dependency on shortcuts in downstream policy models, establishing a robust framework for preference-based alignment.