Probabilistic Modeling of Intentions in Socially Intelligent LLM Agents

作者: Feifan Xia, Yuyang Fang, Defang Li, Yantong Xie, Weikang Li, Yang Li, Deguo Xia, Jizhou Huang

分类: cs.AI, cs.CL

发布日期: 2025-10-21

💡 一句话要点

提出基于概率意图建模的LLM Agent框架,提升社交对话中的智能水平。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 概率意图建模 社交对话 多轮对话 信念更新

📋 核心要点

- 现有LLM Agent在社交对话中难以准确理解对方意图,导致对话策略不够灵活和有效。

- 该论文提出概率意图建模框架,通过维护和更新伙伴意图的信念分布,为Agent提供更丰富的上下文信息。

- 实验表明,该框架在SOTOPIA环境中显著提升了Agent的对话表现,甚至超越了能直接观察意图的Oracle Agent。

📝 摘要(中文)

本文提出了一种用于多轮社交对话中大型语言模型(LLM)Agent的概率意图建模框架。该框架维护一个关于伙伴潜在意图的信念分布,该分布从上下文先验初始化,并通过每次话语后的似然估计动态更新。不断演变的分布为策略提供了额外的上下文基础,从而能够在不确定性下实现自适应对话策略。在SOTOPIA环境中的初步实验表明,该框架取得了持续的改进:与Qwen2.5-7B基线相比,在SOTOPIA-All上的总体得分提高了9.0%,在SOTOPIA-Hard上的总体得分提高了4.1%,并且略微超过了直接观察伙伴意图的Oracle Agent。这些初步结果表明,概率意图建模有助于开发具有社交智能的LLM Agent。

🔬 方法详解

问题定义:在多轮社交对话中,LLM Agent需要理解对话伙伴的潜在意图,以便制定合适的对话策略。然而,由于语言的模糊性和复杂性,Agent难以准确推断对方的意图,导致对话策略缺乏针对性和适应性。现有的方法往往依赖于简单的规则或启发式方法,无法有效处理意图的不确定性。

核心思路:本文的核心思路是使用概率模型来表示Agent对伙伴意图的信念。Agent维护一个关于伙伴意图的概率分布,该分布表示Agent对伙伴可能意图的置信度。通过在对话过程中不断更新这个概率分布,Agent可以更好地跟踪伙伴意图的变化,从而制定更有效的对话策略。这种方法能够有效处理意图的不确定性,并允许Agent根据不同的意图概率采取不同的行动。

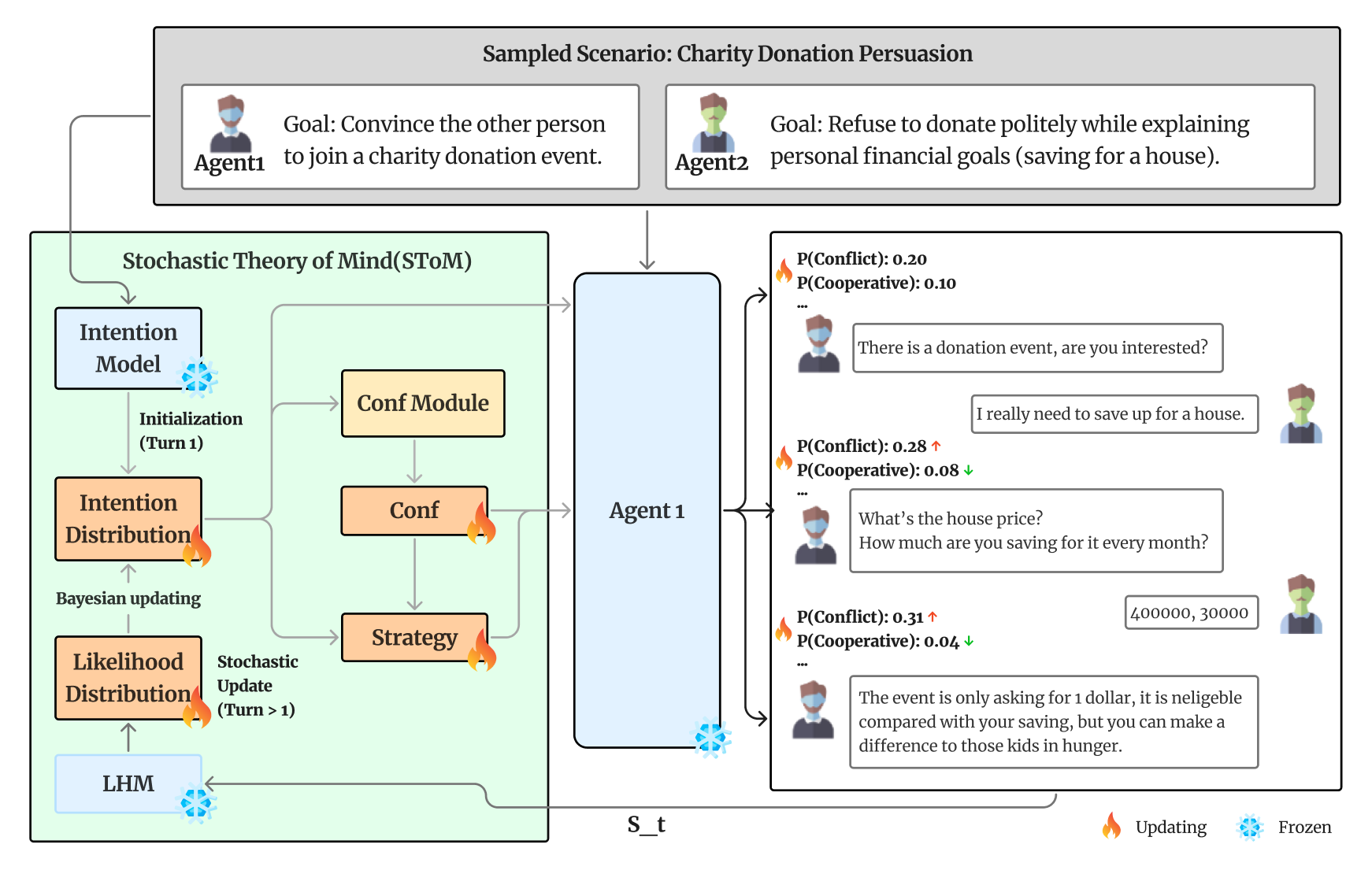

技术框架:该框架包含以下主要模块:1) 意图先验建模:根据对话的上下文信息,初始化伙伴意图的概率分布。2) 似然估计:在每次对话后,根据伙伴的话语,计算不同意图的似然概率。3) 信念更新:使用贝叶斯公式,将先验概率和似然概率结合起来,更新伙伴意图的概率分布。4) 策略选择:根据更新后的意图概率分布,选择合适的对话策略。整个流程是一个循环迭代的过程,Agent在每次对话后都会更新对伙伴意图的信念,并根据新的信念选择下一步的行动。

关键创新:该论文最重要的技术创新点在于将概率建模方法引入到LLM Agent的意图理解中。与传统的确定性方法相比,概率建模能够更好地处理意图的不确定性,并允许Agent根据不同的意图概率采取不同的行动。此外,该框架还能够动态更新意图的概率分布,从而更好地跟踪伙伴意图的变化。

关键设计:意图先验建模可以使用预训练语言模型提取上下文特征,然后将特征映射到意图空间。似然估计可以使用分类器或回归模型,根据伙伴的话语预测不同意图的概率。信念更新可以使用贝叶斯公式或其他概率更新方法。策略选择可以使用强化学习或其他决策方法,根据意图概率选择合适的行动。具体的参数设置、损失函数、网络结构等需要根据具体的应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在SOTOPIA环境中显著提升了Agent的对话表现。与Qwen2.5-7B基线相比,在SOTOPIA-All上的总体得分提高了9.0%,在SOTOPIA-Hard上的总体得分提高了4.1%。更令人印象深刻的是,该框架甚至略微超过了能够直接观察伙伴意图的Oracle Agent,这表明概率意图建模在提升Agent的社交智能方面具有巨大的潜力。

🎯 应用场景

该研究成果可应用于各种需要人机交互的场景,例如智能客服、虚拟助手、社交机器人等。通过更准确地理解用户的意图,Agent可以提供更个性化、更有效的服务,从而提升用户体验。此外,该研究还可以促进人机协作,使Agent能够更好地与人类合作完成任务。

📄 摘要(原文)

We present a probabilistic intent modeling framework for large language model (LLM) agents in multi-turn social dialogue. The framework maintains a belief distribution over a partner's latent intentions, initialized from contextual priors and dynamically updated through likelihood estimation after each utterance. The evolving distribution provides additional contextual grounding for the policy, enabling adaptive dialogue strategies under uncertainty. Preliminary experiments in the SOTOPIA environment show consistent improvements: the proposed framework increases the Overall score by 9.0% on SOTOPIA-All and 4.1% on SOTOPIA-Hard compared with the Qwen2.5-7B baseline, and slightly surpasses an oracle agent that directly observes partner intentions. These early results suggest that probabilistic intent modeling can contribute to the development of socially intelligent LLM agents.