On AI Verification in Open RAN

作者: Rahul Soundrarajan, Claudio Fiandrino, Michele Polese, Salvatore D'Oro, Leonardo Bonati, Tommaso Melodia

分类: cs.NI, cs.AI

发布日期: 2025-10-21

💡 一句话要点

提出基于决策树的轻量级AI验证方法,保障Open RAN中DRL智能体的可靠性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Open RAN AI验证 深度强化学习 决策树 可解释人工智能 RAN切片 运行时验证

📋 核心要点

- Open RAN引入AI/ML驱动的自动化,但AI模型的不透明性及可靠性问题成为挑战。

- 提出基于决策树的轻量级验证方法,用于运行时验证DRL智能体的行为一致性。

- 通过DT切片验证器展示了可行性,并分析了XAI和AI验证的现状,为未来研究奠定基础。

📝 摘要(中文)

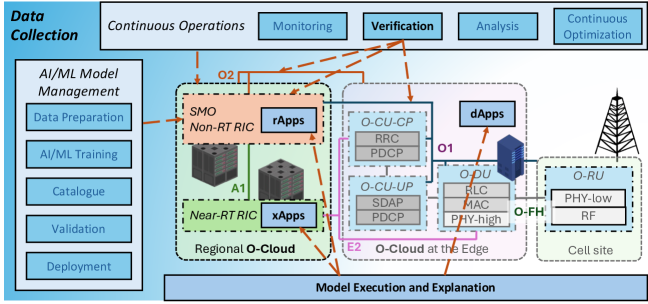

Open RAN为无线接入网(RAN)引入了灵活的、基于云的架构,从而能够在异构、多厂商部署中实现由人工智能(AI)/机器学习(ML)驱动的自动化。虽然可解释人工智能(XAI)有助于缓解AI模型的不透明性,但仅凭可解释性并不能保证可靠的网络运行。在本文中,我们提出了一种基于可解释模型的轻量级验证方法,以验证Open RAN中用于RAN切片和调度的深度强化学习(DRL)智能体的行为。具体来说,我们使用基于决策树(DT)的验证器来执行近乎实时的运行时一致性检查,这对于计算成本高的最先进的验证器来说是不可行的。我们分析了XAI和AI验证的现状,提出了一个可扩展的架构集成,并通过基于DT的切片验证器展示了可行性。我们还概述了未来的挑战,以确保在Open RAN中采用可信赖的AI。

🔬 方法详解

问题定义:Open RAN中,深度强化学习(DRL)智能体被用于RAN切片和调度,但其决策过程复杂,难以保证在各种网络状态下的行为可靠性。现有AI验证方法计算复杂度高,难以在Open RAN的实时环境中应用。因此,需要一种轻量级的验证方法,能够在运行时快速验证DRL智能体的行为是否符合预期。

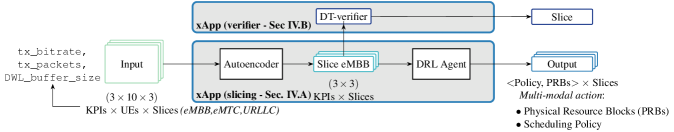

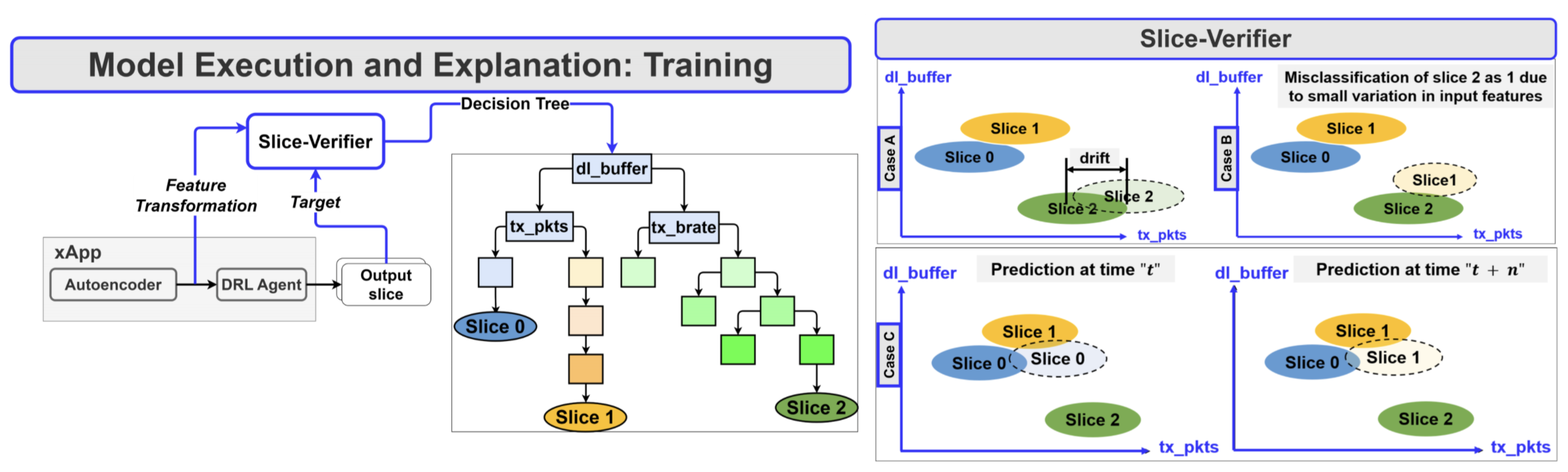

核心思路:论文的核心思路是利用可解释性强的决策树(DT)模型作为验证器,对DRL智能体的行为进行一致性检查。DT模型结构简单,计算速度快,可以在近实时的情况下完成验证。通过将DT模型训练成能够预测DRL智能体行为的模型,然后比较DT模型的预测结果和DRL智能体的实际行为,从而判断DRL智能体的行为是否合理。

技术框架:整体框架包含三个主要部分:DRL智能体、决策树验证器和监控模块。DRL智能体负责RAN切片和调度决策,决策树验证器负责验证DRL智能体的行为,监控模块负责收集DRL智能体的行为数据,并将其输入到决策树验证器中。如果决策树验证器的预测结果与DRL智能体的实际行为不一致,则触发警报,提示可能存在异常行为。

关键创新:关键创新在于使用决策树作为轻量级的验证器,能够在运行时快速验证DRL智能体的行为。与传统的AI验证方法相比,该方法计算复杂度低,更适合在Open RAN的实时环境中应用。此外,该方法还具有可解释性,可以帮助理解DRL智能体的决策过程,从而更好地诊断和解决问题。

关键设计:决策树验证器的训练数据来自DRL智能体的历史行为数据。训练目标是使决策树能够准确预测DRL智能体的行为。决策树的深度和叶子节点数量需要根据实际情况进行调整,以平衡验证精度和计算复杂度。监控模块需要实时收集DRL智能体的状态信息和行为数据,并将其输入到决策树验证器中。验证的频率也需要根据实际情况进行调整,以保证验证的及时性。

🖼️ 关键图片

📊 实验亮点

论文提出了基于决策树的轻量级验证方法,能够在近实时的情况下验证DRL智能体的行为。实验结果表明,该方法能够在保证验证精度的前提下,显著降低计算复杂度,使其能够在Open RAN的实时环境中应用。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

该研究成果可应用于Open RAN等无线通信系统中,用于保障AI驱动的网络自动化功能的可靠性和安全性。通过实时验证AI智能体的行为,可以及时发现和纠正潜在的错误或异常,提高网络性能和用户体验。此外,该方法还可以用于评估和改进AI智能体的设计,促进可信赖AI在无线通信领域的应用。

📄 摘要(原文)

Open RAN introduces a flexible, cloud-based architecture for the Radio Access Network (RAN), enabling Artificial Intelligence (AI)/Machine Learning (ML)-driven automation across heterogeneous, multi-vendor deployments. While EXplainable Artificial Intelligence (XAI) helps mitigate the opacity of AI models, explainability alone does not guarantee reliable network operations. In this article, we propose a lightweight verification approach based on interpretable models to validate the behavior of Deep Reinforcement Learning (DRL) agents for RAN slicing and scheduling in Open RAN. Specifically, we use Decision Tree (DT)-based verifiers to perform near-real-time consistency checks at runtime, which would be otherwise unfeasible with computationally expensive state-of-the-art verifiers. We analyze the landscape of XAI and AI verification, propose a scalable architectural integration, and demonstrate feasibility with a DT-based slice-verifier. We also outline future challenges to ensure trustworthy AI adoption in Open RAN.