AI for Distributed Systems Design: Scalable Cloud Optimization Through Repeated LLMs Sampling And Simulators

作者: Jacopo Tagliabue

分类: cs.DC, cs.AI, cs.DB, cs.SE

发布日期: 2025-10-20

备注: Pre-print IAAA workshop submission

💡 一句话要点

利用LLM采样与模拟器,实现分布式系统设计的可扩展云优化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 分布式系统 策略设计 大型语言模型 模拟器 云优化

📋 核心要点

- 现有分布式系统策略设计方法难以在庞大设计空间中进行有效搜索和优化,缺乏可解释性。

- 论文提出一种基于LLM和模拟器的迭代生成-验证框架,LLM生成策略,模拟器评估并提供反馈,指导LLM优化。

- 实验结果表明,该方法在函数即服务运行时环境中,能够有效提升系统吞吐量,验证了方法的可行性。

📝 摘要(中文)

本文探索了AI驱动的分布式系统策略设计,通过结合大型语言模型(LLM)的随机代码生成与领域特定模拟器中的确定性验证。以函数即服务运行时(Bauplan)及其开源模拟器(Eudoxia)为例,我们将调度器设计构建为一个迭代的生成-验证循环:LLM提出一个Python策略,模拟器在标准化跟踪上评估它,结构化反馈指导后续生成。这种设置保留了解释性,同时实现了对大型设计空间的有针对性搜索。我们详细介绍了系统架构,并报告了跨多个模型的吞吐量改进的初步结果。除了早期收益外,我们还讨论了当前设置的局限性,并概述了后续步骤;特别是,我们推测AI对于通过帮助引导新的模拟器来扩展这种方法至关重要。

🔬 方法详解

问题定义:论文旨在解决分布式系统中调度器策略设计的自动化优化问题。现有的手动设计或基于规则的方法难以应对复杂多变的云环境,且缺乏可扩展性。此外,直接在真实系统上进行实验的成本很高,风险也很大。因此,需要一种能够高效探索设计空间,并能保证策略正确性的方法。

核心思路:论文的核心思路是将调度器策略设计视为一个迭代的优化过程,利用LLM生成候选策略,并使用模拟器进行评估和验证。通过模拟器的反馈,LLM可以不断改进策略,最终找到最优解。这种方法结合了LLM的创造性和模拟器的精确性,能够在保证策略正确性的前提下,高效地探索设计空间。

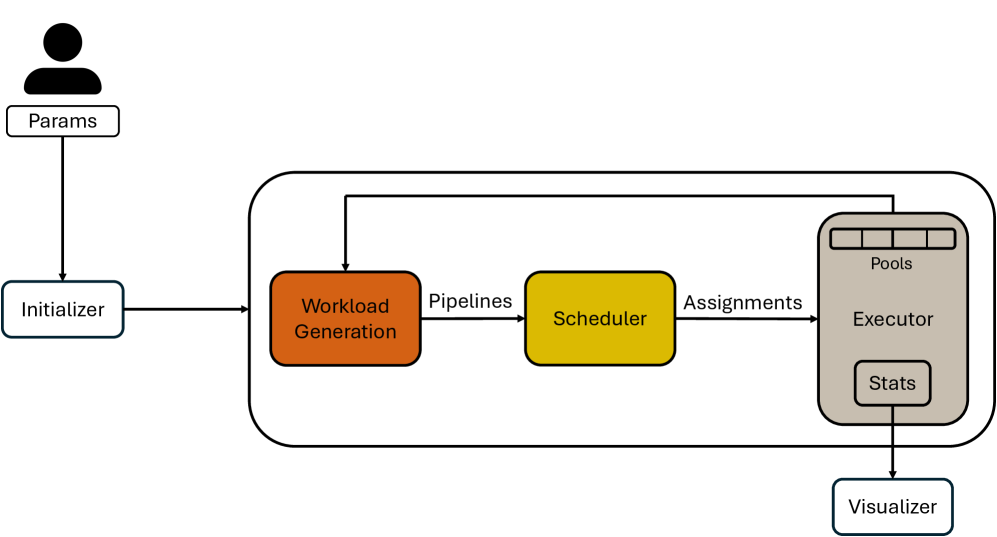

技术框架:整体框架包含以下几个主要模块:1) LLM:负责生成Python代码形式的调度器策略。2) 模拟器(Eudoxia):负责在标准化的跟踪数据上评估LLM生成的策略,并提供结构化的反馈信息,例如吞吐量、延迟等。3) 迭代循环:LLM根据模拟器的反馈,不断调整和优化策略,直到满足性能要求或达到迭代次数上限。4) Bauplan:一个函数即服务运行时环境,作为案例研究对象。

关键创新:该方法最重要的创新点在于将LLM的代码生成能力与领域特定的模拟器相结合,形成一个闭环的优化系统。这种方法既利用了LLM的强大生成能力,又保证了策略的正确性和可解释性。此外,使用结构化反馈来指导LLM的策略生成,能够更有效地探索设计空间。

关键设计:LLM使用Python代码生成调度策略,模拟器使用Eudoxia,这是一个专门为Bauplan设计的开源模拟器。LLM接收的反馈信息包括吞吐量、延迟等性能指标,以及策略执行过程中出现的错误信息。LLM根据这些反馈信息,调整策略的参数或逻辑。具体的LLM模型选择和训练细节在论文中可能没有详细描述,需要参考相关文献。

🖼️ 关键图片

📊 实验亮点

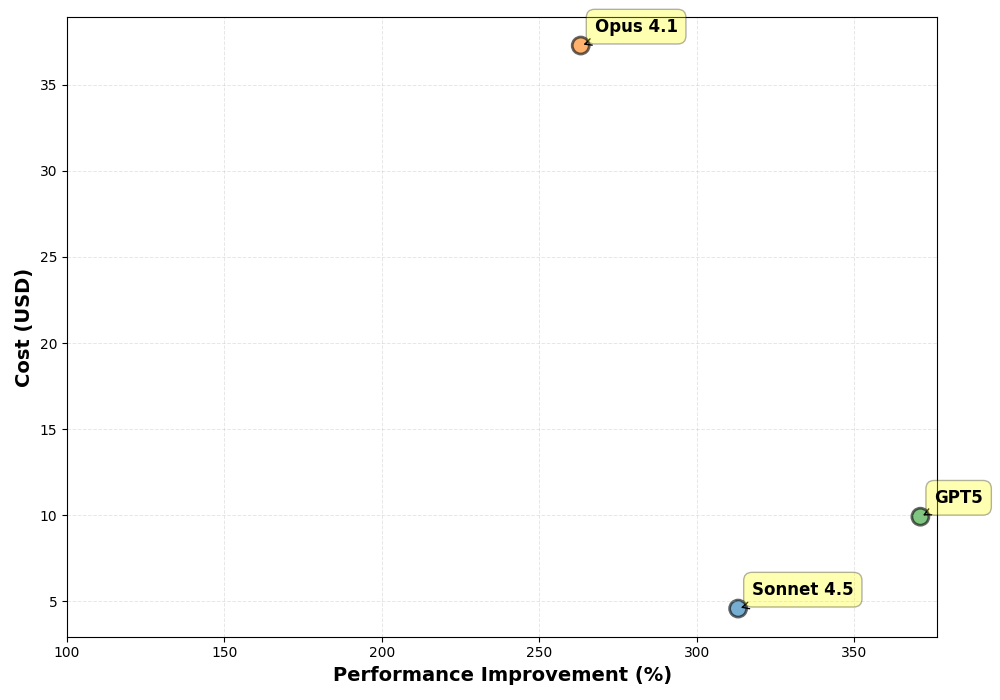

初步实验结果表明,该方法能够有效提升函数即服务运行时环境的吞吐量。具体提升幅度在论文中有所提及,但需要查阅原文获取准确数据。通过与基线策略的对比,验证了该方法的有效性。此外,论文还讨论了当前设置的局限性,并提出了未来研究方向。

🎯 应用场景

该研究成果可应用于各种分布式系统策略设计与优化,例如云计算资源调度、网络流量控制、边缘计算任务分配等。通过自动化策略生成和验证,可以显著降低人工成本,提高系统性能,并加速新技术的部署。未来,该方法有望推广到其他领域,例如智能制造、金融风控等。

📄 摘要(原文)

We explore AI-driven distributed-systems policy design by combining stochastic code generation from large language models (LLMs) with deterministic verification in a domain-specific simulator. Using a Function-as-a-Service runtime (Bauplan) and its open-source simulator (Eudoxia) as a case study, we frame scheduler design as an iterative generate-and-verify loop: an LLM proposes a Python policy, the simulator evaluates it on standardized traces, and structured feedback steers subsequent generations. This setup preserves interpretability while enabling targeted search over a large design space. We detail the system architecture and report preliminary results on throughput improvements across multiple models. Beyond early gains, we discuss the limits of the current setup and outline next steps; in particular, we conjecture that AI will be crucial for scaling this methodology by helping to bootstrap new simulators.