Trust in foundation models and GenAI: A geographic perspective

作者: Grant McKenzie, Krzysztof Janowicz, Carsten Kessler

分类: cs.CY, cs.AI

发布日期: 2025-10-20

💡 一句话要点

探讨地理空间视角下对基础模型和生成式AI的信任问题,并提出信任的三种类型。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 地理空间AI 信任 基础模型 生成式AI 数据偏见 透明度 伦理责任 空间关系

📋 核心要点

- 现有方法缺乏对地理空间AI信任的系统性分析,尤其是在基础模型和生成式AI快速发展的背景下。

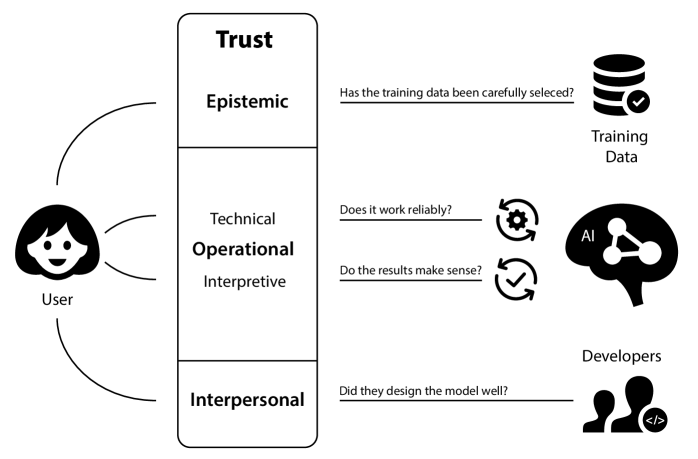

- 论文将信任分解为认知信任、运行信任和人际信任三种类型,并分析了它们在地理应用中的具体含义。

- 论文强调了文化背景、数据异质性和空间关系在地理AI信任构建中的重要性,并呼吁关注偏见、透明度和伦理责任。

📝 摘要(中文)

大规模预训练机器学习模型已经重塑了我们对人工智能的理解,包括地理领域。与任何新技术一样,信任在讨论中扮演着重要角色。本章探讨了基础模型中信任的多方面概念,尤其是在地理背景下。随着对这些模型的依赖性增加,并且它们被依赖于关键决策,信任变得至关重要,但也变得支离破碎。本文将信任分为三种类型:对训练数据的认知信任、对模型功能的运行信任以及对模型开发人员的人际信任。每种类型的信任都对地理应用产生独特的影响。文化背景、数据异质性和空间关系是空间科学的基础,并在建立信任方面发挥着重要作用。本章继续讨论了不同形式的偏见所带来的挑战、透明度和可解释性的重要性以及模型开发中的伦理责任。最后,强调了地理信息科学家的新颖视角,并呼吁进一步提高透明度、减少偏见和制定区域性政策。简而言之,本章旨在为研究人员、从业人员和政策制定者提供一个概念性的起点,以更好地理解(生成式)GeoAI 中的信任。

🔬 方法详解

问题定义:论文旨在解决在地理空间领域应用基础模型和生成式AI时,如何建立和评估信任的问题。现有方法缺乏对信任的细粒度划分和系统性分析,难以应对地理数据的复杂性和区域差异性。此外,模型偏见、透明度不足和伦理问题也对信任构成挑战。

核心思路:论文的核心思路是将信任分解为三个相互关联的维度:认知信任(对训练数据的信任)、运行信任(对模型功能的信任)和人际信任(对模型开发者的信任)。通过分析这三个维度,可以更全面地理解和评估地理空间AI的信任度。同时,论文强调了地理空间数据的特殊性,如文化背景、数据异质性和空间关系,并认为这些因素对信任的建立至关重要。

技术框架:论文并没有提出一个具体的技术框架,而是一个概念框架,用于分析和理解地理空间AI中的信任问题。该框架包括以下几个关键要素:1) 信任的三种类型(认知、运行和人际);2) 影响信任的因素(如数据质量、模型性能、开发者声誉);3) 评估信任的方法(如用户调查、模型审计、伦理审查)。

关键创新:论文的关键创新在于提出了地理空间AI信任的三维模型,并强调了地理空间数据的特殊性对信任的影响。与以往研究主要关注模型性能和准确性不同,该论文更加关注用户对模型的信任感和接受度,以及模型开发过程中的伦理责任。

关键设计:论文主要是一个概念性的探讨,并没有涉及具体的算法或模型设计。但论文强调了在模型开发过程中需要考虑以下关键设计:1) 数据选择和清洗,以减少数据偏见;2) 模型透明度和可解释性,以便用户理解模型的决策过程;3) 伦理审查,以确保模型的使用符合伦理规范。

🖼️ 关键图片

📊 实验亮点

该论文的主要贡献在于提出了一个地理空间AI信任的三维模型,并强调了地理空间数据的特殊性对信任的影响。虽然没有提供具体的实验数据,但该模型为研究人员、从业人员和政策制定者提供了一个有用的框架,以更好地理解和解决地理空间AI中的信任问题。

🎯 应用场景

该研究成果可应用于各种地理空间AI应用场景,例如城市规划、环境监测、灾害管理等。通过提高用户对地理空间AI的信任度,可以促进这些技术的广泛应用,并更好地服务于社会。此外,该研究还可以为政策制定者提供参考,制定更加合理的地理空间AI发展政策。

📄 摘要(原文)

Large-scale pre-trained machine learning models have reshaped our understanding of artificial intelligence across numerous domains, including our own field of geography. As with any new technology, trust has taken on an important role in this discussion. In this chapter, we examine the multifaceted concept of trust in foundation models, particularly within a geographic context. As reliance on these models increases and they become relied upon for critical decision-making, trust, while essential, has become a fractured concept. Here we categorize trust into three types: epistemic trust in the training data, operational trust in the model's functionality, and interpersonal trust in the model developers. Each type of trust brings with it unique implications for geographic applications. Topics such as cultural context, data heterogeneity, and spatial relationships are fundamental to the spatial sciences and play an important role in developing trust. The chapter continues with a discussion of the challenges posed by different forms of biases, the importance of transparency and explainability, and ethical responsibilities in model development. Finally, the novel perspective of geographic information scientists is emphasized with a call for further transparency, bias mitigation, and regionally-informed policies. Simply put, this chapter aims to provide a conceptual starting point for researchers, practitioners, and policy-makers to better understand trust in (generative) GeoAI.