Repairing Reward Functions with Feedback to Mitigate Reward Hacking

作者: Stephane Hatgis-Kessell, Logan Mondal Bhamidipaty, Emma Brunskill

分类: cs.AI, cs.LG

发布日期: 2025-10-14 (更新: 2026-01-29)

💡 一句话要点

提出基于偏好的奖励修复方法,缓解强化学习中的奖励函数漏洞

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 奖励函数漏洞 偏好学习 奖励函数修复 人机交互

📋 核心要点

- 人工设计的奖励函数常与人类真实目标不符,导致奖励函数漏洞,产生不符合人类意图的策略。

- PBRR通过学习附加的修正项来修复代理奖励函数,利用有针对性的探索策略和新的偏好学习目标。

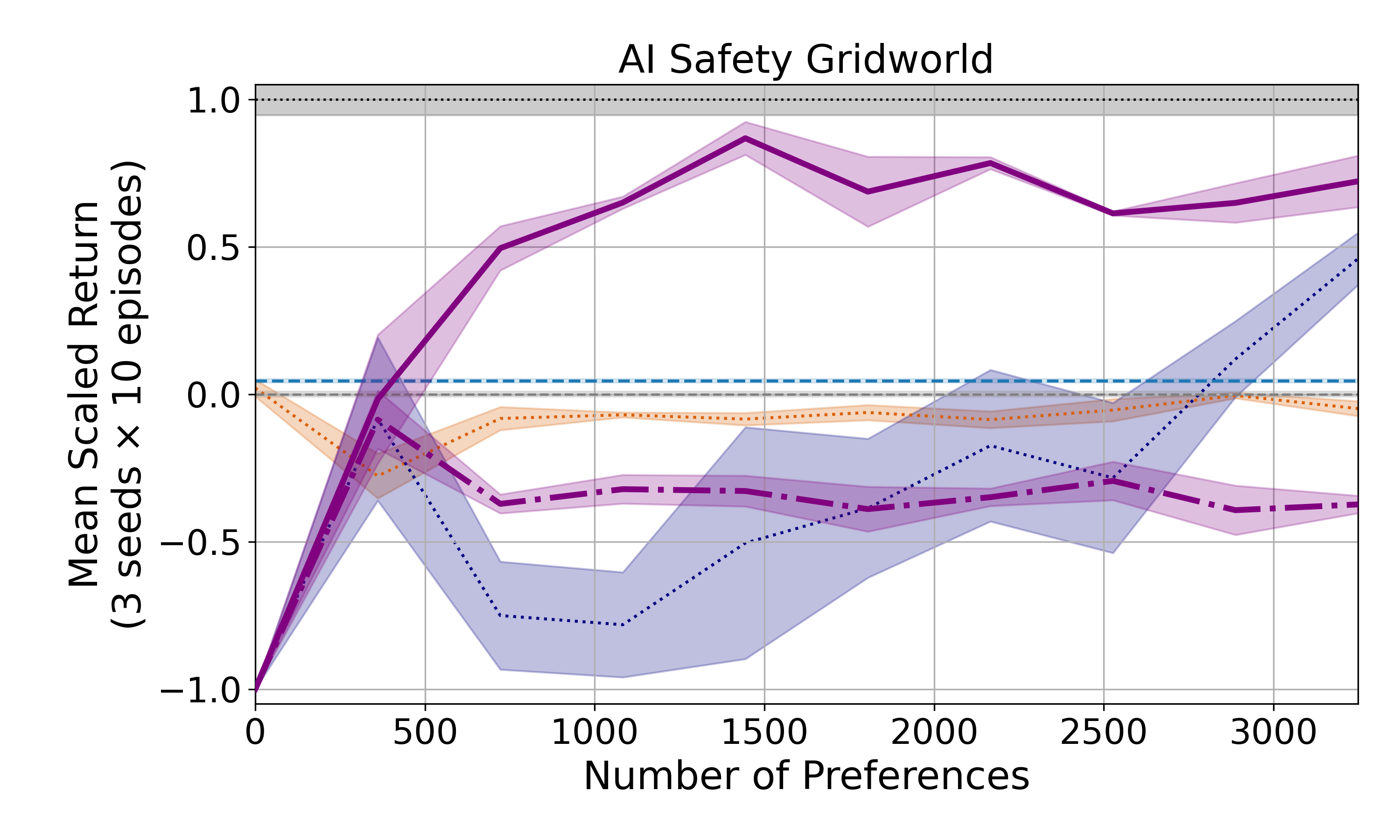

- 实验表明,PBRR在奖励函数漏洞基准测试中优于其他方法,且只需更少的偏好即可学习高性能策略。

📝 摘要(中文)

为解决强化学习中人工设计的奖励函数与人类真实目标不一致的问题,论文提出了一种基于偏好的奖励修复(PBRR)的迭代框架。该框架通过学习一个附加的、与状态转移相关的修正项,来修复人工指定的代理奖励函数。PBRR利用有针对性的探索策略和新的偏好学习目标,识别并纠正那些对策略影响较大的状态转移。理论分析表明,在表格型领域,PBRR的累积遗憾与现有的基于偏好的强化学习方法相当。在奖励函数漏洞基准测试中,PBRR始终优于从偏好中从头开始学习奖励函数或使用其他方法修改代理奖励函数的基线方法,并且只需更少的偏好即可学习高性能策略。

🔬 方法详解

问题定义:强化学习中,人工设计的奖励函数往往是人类真实目标的代理,优化这些有偏差的代理奖励函数会导致奖励函数漏洞,产生与人类意图不符的策略。现有方法要么从头开始学习奖励函数,需要大量人类反馈,成本高昂;要么直接修改代理奖励函数,效果不佳。

核心思路:论文的核心思路是通过学习一个附加的、与状态转移相关的修正项,来修复人工指定的代理奖励函数。这种方法旨在利用人类先验知识(即初始的代理奖励函数),并仅通过少量人类反馈来修正奖励函数中的偏差,从而更高效地学习符合人类意图的策略。

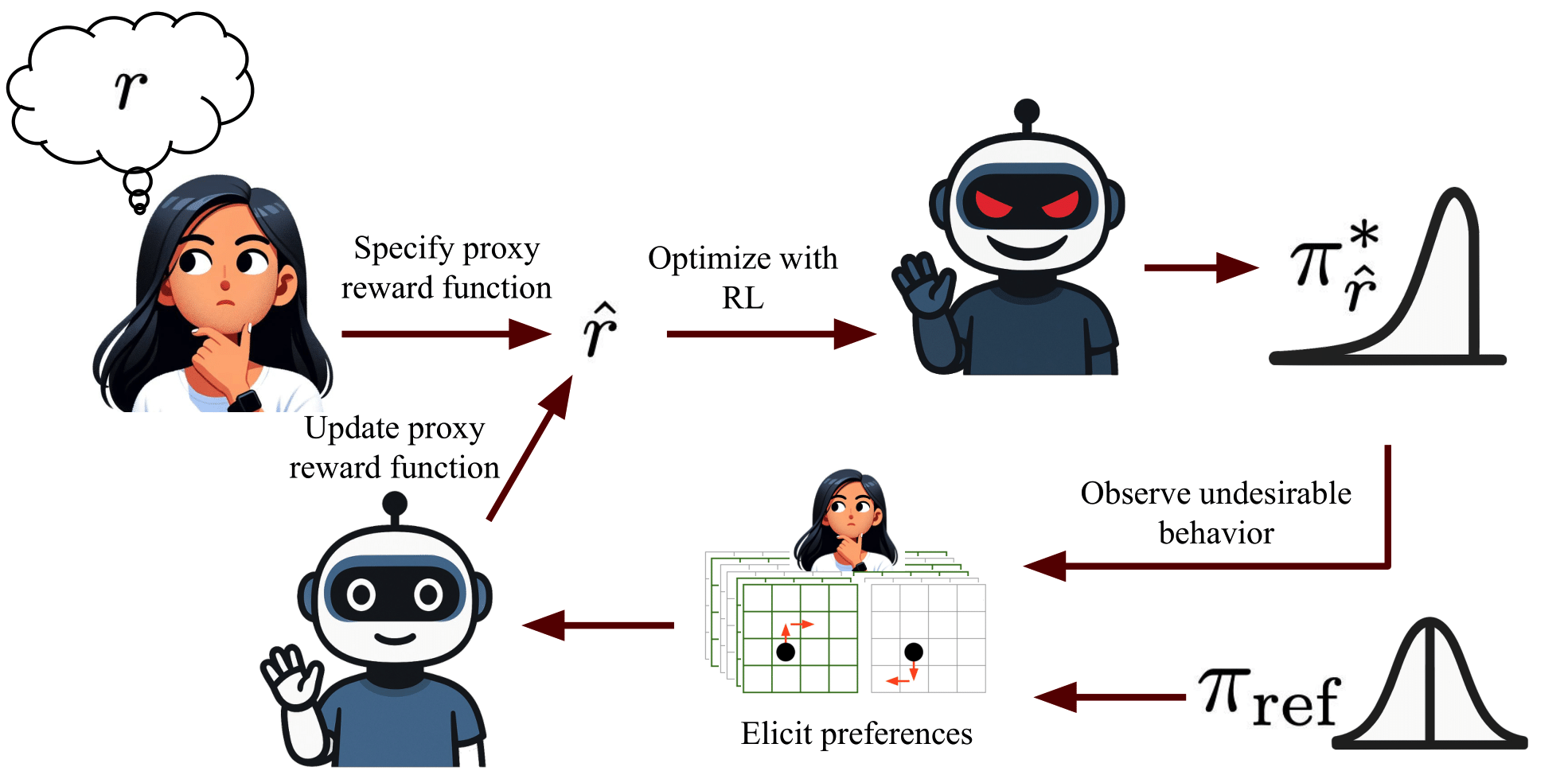

技术框架:PBRR是一个迭代框架,包含以下主要阶段:1) 策略生成:基于当前奖励函数(初始代理奖励函数加上修正项)训练一个策略。2) 轨迹采样:使用有针对性的探索策略,生成可能存在奖励函数漏洞的轨迹。3) 偏好查询:向人类展示成对的轨迹,并收集人类对这些轨迹的偏好。4) 奖励函数修正:基于收集到的偏好数据,学习一个附加的、与状态转移相关的修正项,更新奖励函数。这个过程迭代进行,直到策略性能达到预期。

关键创新:PBRR的关键创新在于:1) 奖励函数修复:不是从头开始学习奖励函数,而是修复已有的代理奖励函数,更有效地利用先验知识。2) 有针对性的探索策略:设计了一种探索策略,专门用于识别可能存在奖励函数漏洞的状态转移,从而更有效地收集人类反馈。3) 新的偏好学习目标:设计了一个新的偏好学习目标,更准确地学习奖励函数的修正项。

关键设计:PBRR使用一个神经网络来表示与状态转移相关的修正项。偏好学习目标通常基于Bradley-Terry模型,将人类偏好建模为轨迹奖励之差的sigmoid函数。有针对性的探索策略可能涉及使用不确定性采样或奖励塑造等技术,以鼓励agent访问可能存在奖励函数漏洞的状态转移。具体的参数设置和网络结构取决于具体的任务和环境。

🖼️ 关键图片

📊 实验亮点

在奖励函数漏洞基准测试中,PBRR显著优于从头开始学习奖励函数的基线方法,以及使用其他方法修改代理奖励函数的基线方法。例如,在某些任务中,PBRR仅需少量偏好数据即可达到接近最优的性能,而其他方法则需要更多的数据或无法达到相同的性能水平。实验结果表明,PBRR能够有效地修复奖励函数漏洞,并学习到符合人类意图的高性能策略。

🎯 应用场景

PBRR可应用于各种需要人工设计奖励函数的强化学习任务中,尤其适用于奖励函数容易出现漏洞的复杂环境,例如机器人控制、游戏AI、推荐系统等。该方法能够降低对大量人工标注数据的需求,提高强化学习算法的实用性和安全性,减少因奖励函数设计不当而导致的意外行为。

📄 摘要(原文)

Human-designed reward functions for reinforcement learning (RL) agents are frequently misaligned with the humans' true, unobservable objectives, and thus act only as proxies. Optimizing for a misspecified proxy reward function often induces reward hacking, resulting in a policy misaligned with the human's true objectives. An alternative is to perform RL from human feedback, which involves learning a reward function from scratch by collecting human preferences over pairs of trajectories. However, building such datasets is costly. To address the limitations of both approaches, we propose Preference-Based Reward Repair (PBRR): an automated iterative framework that repairs a human-specified proxy reward function by learning an additive, transition-dependent correction term from preferences. A manually specified reward function can yield policies that are highly suboptimal under the ground-truth objective, yet corrections on only a few transitions may suffice to recover optimal performance. To identify and correct for those transitions, PBRR uses a targeted exploration strategy and a new preference-learning objective. We prove in tabular domains PBRR has a cumulative regret that matches, up to constants, that of prior preference-based RL methods. In addition, on a suite of reward-hacking benchmarks, PBRR consistently outperforms baselines that learn a reward function from scratch from preferences or modify the proxy reward function using other approaches, requiring substantially fewer preferences to learn high performing policies.