Toward Reasoning-Centric Time-Series Analysis

作者: Xinlei Wang, Mingtian Tan, Jing Qiu, Junhua Zhao, Jinjin Gu

分类: cs.AI

发布日期: 2025-10-14

💡 一句话要点

提出以推理为中心的时间序列分析方法,利用LLM提升复杂场景下的可解释性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列分析 大型语言模型 因果推理 可解释性 多模态融合

📋 核心要点

- 现有时间序列分析方法侧重于模式识别,难以应对现实世界中复杂多变的场景,缺乏对潜在因果关系的理解。

- 论文提出以推理为中心的时间序列分析方法,利用LLM的推理能力,挖掘时间序列数据中的因果结构,提升分析的可解释性。

- 该方法旨在将时间序列分析与人类的理解对齐,从而在复杂环境中提供透明且上下文感知的洞察。

📝 摘要(中文)

传统的时间序列分析长期依赖于模式识别,并在静态且完善的基准上进行训练。然而,在现实世界中,由于政策变化、人类行为调整和意外事件的发生,有效的分析必须超越表面趋势,揭示驱动它们的实际力量。大型语言模型(LLM)的兴起为通过整合多模态输入来重新思考时间序列分析提供了新的机会。然而,随着LLM使用的普及,我们必须保持谨慎,思考为什么使用LLM以及如何有效地利用它们。目前大多数基于LLM的方法仍然采用其数值回归能力,而忽略了其更深层次的推理潜力。本文认为,应该将LLM应用于时间序列分析视为一个推理任务,优先考虑因果结构和可解释性。这种转变使时间序列分析更接近于人类对齐的理解,从而在复杂的现实环境中实现透明且上下文感知的洞察。

🔬 方法详解

问题定义:传统时间序列分析方法主要依赖于模式识别和数值回归,难以捕捉现实世界中复杂多变的因果关系。现有方法缺乏对时间序列数据背后驱动因素的深入理解,导致分析结果缺乏可解释性,难以适应动态变化的环境。

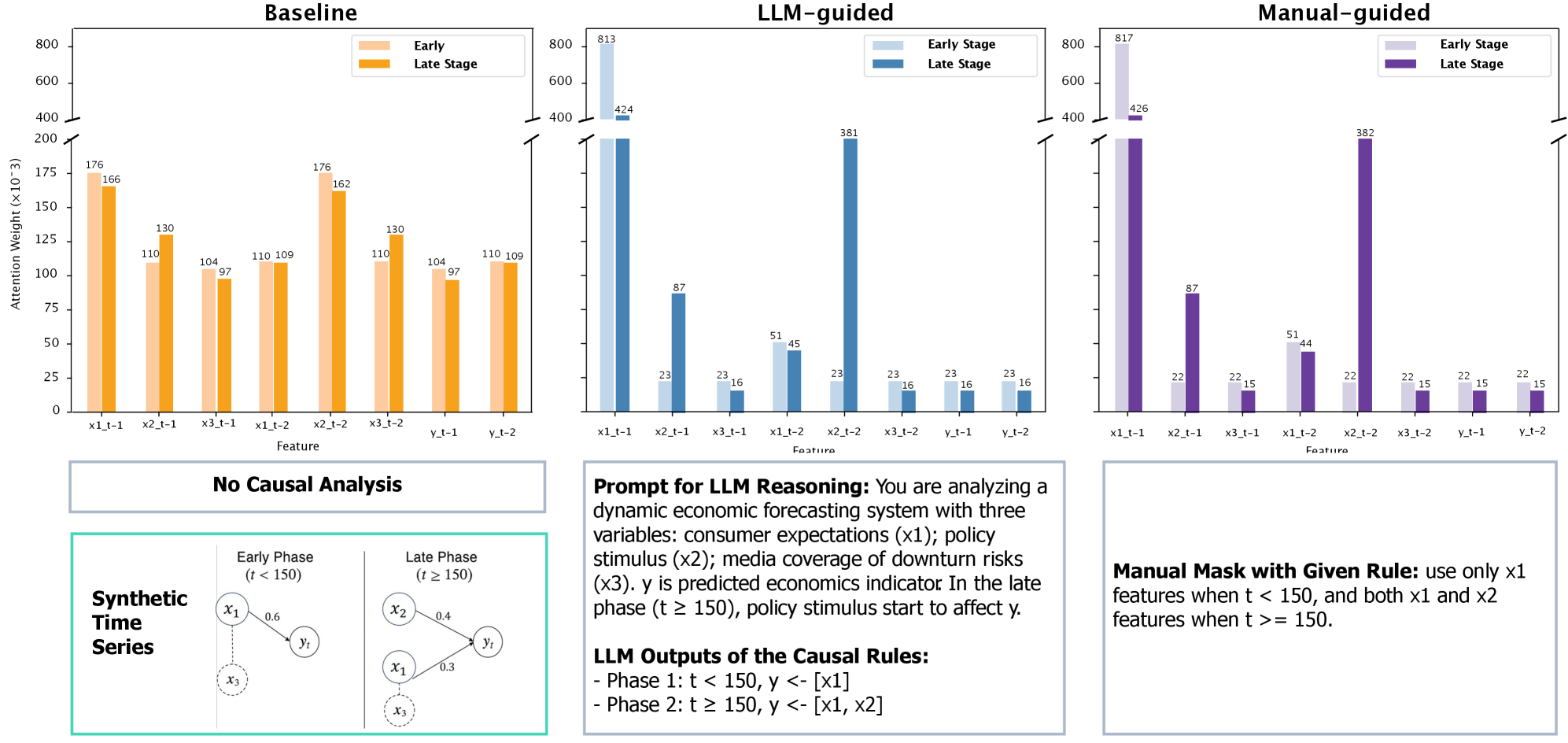

核心思路:论文的核心思路是将时间序列分析视为一个推理任务,而非单纯的数值预测。通过利用大型语言模型(LLM)的推理能力,挖掘时间序列数据中的因果结构,从而提升分析的可解释性和鲁棒性。这种方法旨在将时间序列分析与人类的认知方式对齐,使其能够更好地理解和解释复杂的时间序列数据。

技术框架:论文提出的技术框架主要包括以下几个阶段:1) 数据预处理:对时间序列数据进行清洗、标准化等处理,并整合相关的多模态信息(例如,文本描述、图像等)。2) 因果关系推理:利用LLM对预处理后的数据进行因果关系推理,识别时间序列数据中潜在的因果依赖关系。3) 解释生成:基于推理得到的因果结构,生成对时间序列数据变化的解释,提供可理解的洞察。4) 预测与验证:利用推理得到的因果模型进行预测,并通过实验验证模型的有效性和可解释性。

关键创新:论文最重要的技术创新点在于将LLM应用于时间序列分析的推理任务,而非仅仅将其作为数值回归工具。这种方法能够更好地利用LLM的语义理解和推理能力,挖掘时间序列数据中隐藏的因果关系,从而提升分析的可解释性和鲁棒性。与现有方法相比,该方法更注重对时间序列数据背后驱动因素的理解,而非仅仅关注表面上的模式。

关键设计:论文的关键设计可能包括:1) 如何将时间序列数据转化为LLM可以理解的输入格式(例如,文本描述)。2) 如何设计合适的提示(prompt)来引导LLM进行因果关系推理。3) 如何评估LLM推理得到的因果结构的准确性和可靠性。4) 如何将推理得到的因果模型应用于预测任务,并评估其性能。

🖼️ 关键图片

📊 实验亮点

由于摘要中没有明确提及实验结果,因此无法提供具体的性能数据、对比基线和提升幅度。但是,该研究的亮点在于提出了以推理为中心的时间序列分析方法,并利用LLM提升了分析的可解释性,这为未来的研究提供了新的思路。

🎯 应用场景

该研究成果可应用于金融风险预测、供应链管理、智能交通系统、医疗健康监测等领域。通过提升时间序列分析的可解释性,可以帮助决策者更好地理解数据背后的驱动因素,从而做出更明智的决策。未来,该方法有望应用于更复杂的现实世界场景,例如,预测突发事件的影响、评估政策实施的效果等。

📄 摘要(原文)

Traditional time series analysis has long relied on pattern recognition, trained on static and well-established benchmarks. However, in real-world settings -- where policies shift, human behavior adapts, and unexpected events unfold -- effective analysis must go beyond surface-level trends to uncover the actual forces driving them. The recent rise of Large Language Models (LLMs) presents new opportunities for rethinking time series analysis by integrating multimodal inputs. However, as the use of LLMs becomes popular, we must remain cautious, asking why we use LLMs and how to exploit them effectively. Most existing LLM-based methods still employ their numerical regression ability and ignore their deeper reasoning potential. This paper argues for rethinking time series with LLMs as a reasoning task that prioritizes causal structure and explainability. This shift brings time series analysis closer to human-aligned understanding, enabling transparent and context-aware insights in complex real-world environments.