AI Agents as Universal Task Solvers

作者: Alessandro Achille, Stefano Soatto

分类: cs.AI, cs.LG

发布日期: 2025-10-14

💡 一句话要点

将AI Agent视为通用任务求解器,关注时间在学习推理中的关键作用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI Agent 通用任务求解 转导学习 时间优化 算法信息 推理时间 模型缩放

📋 核心要点

- 现有AI Agent在解决任务时依赖工具和模拟,但缺乏对计算本质的深入理解,需要探索其通用性和学习推理机制。

- 论文提出将AI Agent视为随机动态系统,强调转导学习的重要性,旨在通过捕获算法结构来减少解决新任务的时间。

- 研究揭示了算法信息与最优加速之间的关系,并从理论上推导了推理时间与训练时间之间的幂律缩放关系。

📝 摘要(中文)

本文将AI推理Agent重新定义为具备计算能力的随机动态系统,强调了时间在学习推理中的基础性作用。论文提出从经典的归纳学习转向转导学习,目标不是近似过去数据的分布,而是捕获其算法结构,以减少寻找新任务解决方案所需的时间。与香农的信息论相反,论文认为信息在学习中的关键作用是减少时间而非重建误差。研究表明,通用求解器利用过去数据所能实现的最佳加速与它们的算法信息紧密相关。基于此,论文推导出了推理时间与训练时间之间观察到的幂律缩放关系。此外,论文指出,扩展模型规模可能导致在基准测试中提高准确率,但无法通过合理的智能测试,甚至超级智能测试。因此,在扩展推理模型时,关键的优化目标是时间,而时间在学习中的关键作用迄今为止只被间接考虑。

🔬 方法详解

问题定义:现有AI Agent虽然能够通过链式思考解决各种任务,但缺乏对计算本质的理解。现有方法主要关注模型规模和数据集大小,忽略了时间在学习推理中的关键作用。因此,如何让AI Agent更高效地学习推理,并具备解决通用任务的能力,是一个重要的挑战。

核心思路:论文的核心思路是将AI Agent视为具备计算能力的随机动态系统,并强调转导学习的重要性。转导学习的目标不是近似过去数据的分布,而是捕获其算法结构,从而减少解决新任务所需的时间。这种思路强调了时间在学习中的关键作用,并认为信息的主要作用是减少时间而非重建误差。

技术框架:论文并没有提出一个具体的AI Agent架构,而是从理论层面分析了AI Agent的学习推理过程。其核心框架可以概括为:1) 将AI Agent视为随机动态系统;2) 引入转导学习的概念,强调捕获算法结构;3) 分析算法信息与最优加速之间的关系;4) 推导推理时间与训练时间之间的幂律缩放关系。

关键创新:论文最重要的技术创新在于强调了时间在学习推理中的关键作用,并提出了转导学习的概念。与传统的归纳学习不同,转导学习的目标不是近似过去数据的分布,而是捕获其算法结构,从而减少解决新任务所需的时间。此外,论文还从理论上推导了推理时间与训练时间之间的幂律缩放关系,为理解AI Agent的学习行为提供了新的视角。

关键设计:论文主要关注理论分析,并没有涉及具体的参数设置、损失函数或网络结构等技术细节。然而,论文提出的转导学习概念可以指导未来的AI Agent设计,例如,可以设计新的损失函数来鼓励AI Agent学习算法结构,或者设计新的网络结构来更好地捕获时间信息。

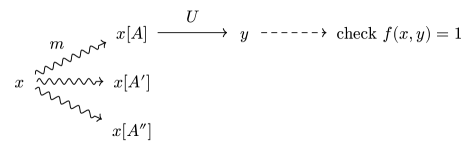

🖼️ 关键图片

📊 实验亮点

论文从理论上推导了推理时间与训练时间之间的幂律缩放关系,并指出扩展模型规模可能导致在基准测试中提高准确率,但无法通过合理的智能测试。这些结果表明,优化时间是提高AI Agent智能水平的关键。

🎯 应用场景

该研究成果可应用于通用人工智能、机器人、自动化推理等领域。通过优化AI Agent的学习推理过程,可以提高其解决复杂任务的效率和泛化能力。未来的AI系统有望在更短的时间内解决更广泛的问题,从而推动人工智能技术的进步。

📄 摘要(原文)

AI reasoning agents are already able to solve a variety of tasks by deploying tools, simulating outcomes of multiple hypotheses and reflecting on them. In doing so, they perform computation, although not in the classical sense -- there is no program being executed. Still, if they perform computation, can AI agents be universal? Can chain-of-thought reasoning solve any computable task? How does an AI Agent learn to reason? Is it a matter of model size? Or training dataset size? In this work, we reinterpret the role of learning in the context of AI Agents, viewing them as compute-capable stochastic dynamical systems, and highlight the role of time in a foundational principle for learning to reason. In doing so, we propose a shift from classical inductive learning to transductive learning -- where the objective is not to approximate the distribution of past data, but to capture their algorithmic structure to reduce the time needed to find solutions to new tasks. Transductive learning suggests that, counter to Shannon's theory, a key role of information in learning is about reduction of time rather than reconstruction error. In particular, we show that the optimal speed-up that a universal solver can achieve using past data is tightly related to their algorithmic information. Using this, we show a theoretical derivation for the observed power-law scaling of inference time versus training time. We then show that scaling model size can lead to behaviors that, while improving accuracy on benchmarks, fail any reasonable test of intelligence, let alone super-intelligence: In the limit of infinite space and time, large models can behave as savants, able to brute-force through any task without any insight. Instead, we argue that the key quantity to optimize when scaling reasoning models is time, whose critical role in learning has so far only been indirectly considered.