SR-Scientist: Scientific Equation Discovery With Agentic AI

作者: Shijie Xia, Yuhan Sun, Pengfei Liu

分类: cs.AI

发布日期: 2025-10-13

💡 一句话要点

SR-Scientist:利用Agentic AI进行科学方程发现,提升方程探索效率与精度

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 科学方程发现 大型语言模型 Agentic AI 代码解释器 强化学习

📋 核心要点

- 现有科学方程发现方法通常将LLM限制在方程提议者的角色,缺乏自主性和优化能力。

- SR-Scientist框架将LLM提升为自主AI科学家,使其能够自主分析数据、评估方程并根据反馈进行优化。

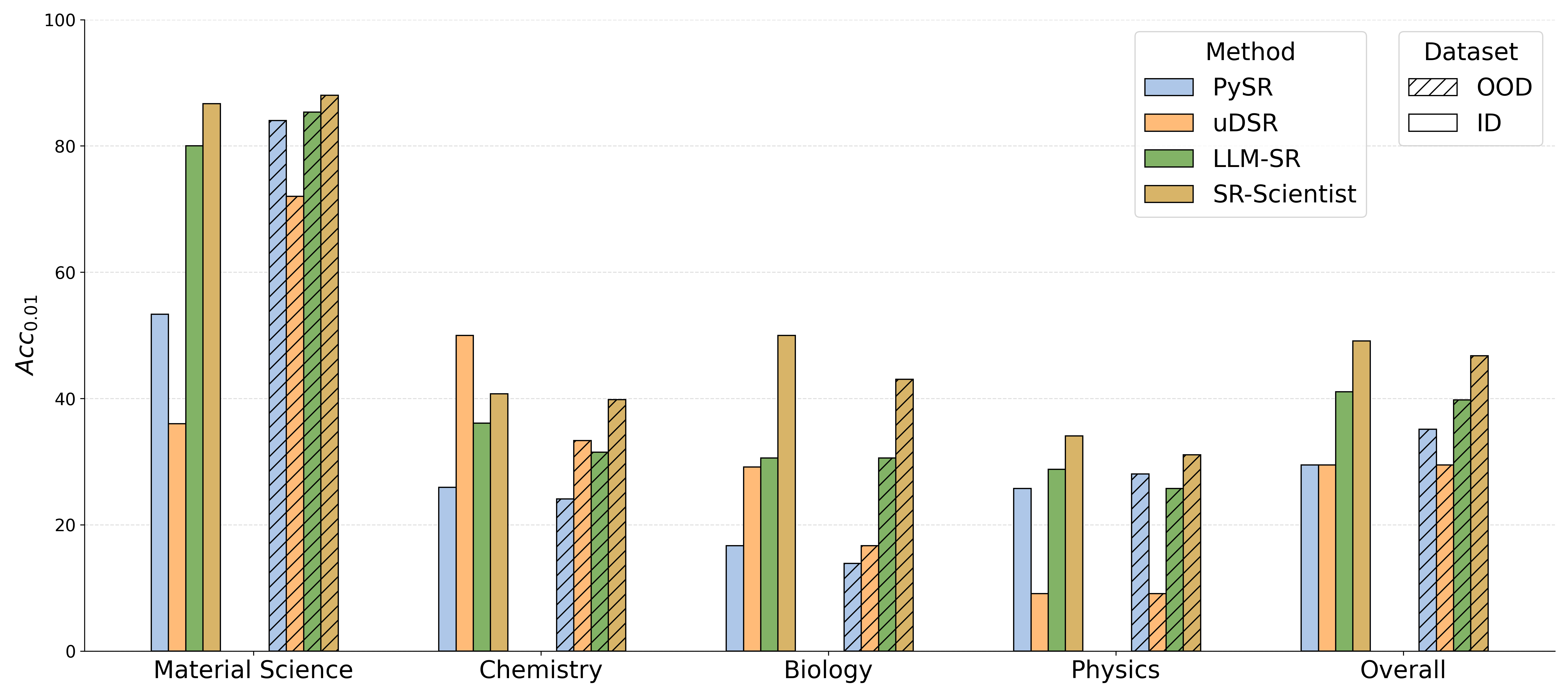

- 实验表明,SR-Scientist在多个科学数据集上显著优于现有方法,并展现出良好的泛化性和鲁棒性。

📝 摘要(中文)

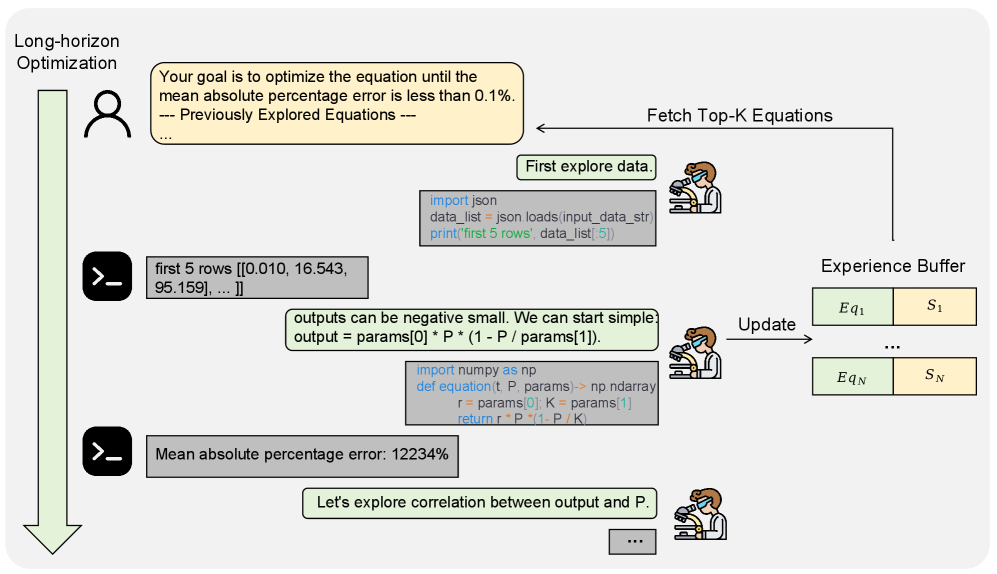

本文提出了一种名为SR-Scientist的框架,该框架将大型语言模型(LLM)从简单的方程提议者提升为自主AI科学家。该AI科学家能够编写代码分析数据,将方程实现为代码,提交方程进行评估,并根据实验反馈优化方程。具体来说,该框架将代码解释器封装成一套用于数据分析和方程评估的工具。通过最小化人工定义的流程,该Agent被指示在较长时间范围内利用这些工具来优化方程。实验结果表明,SR-Scientist在涵盖四个科学学科的数据集上,性能优于基线方法6%到35%。此外,该方法对噪声具有鲁棒性,发现的方程能够泛化到领域外数据,并具有符号准确性。同时,本文还开发了一个端到端强化学习框架来增强Agent的能力。

🔬 方法详解

问题定义:科学方程发现旨在从观测数据中自动推导出描述物理现象的数学方程。现有方法,特别是基于LLM的方法,通常将LLM作为方程的提议者,需要人工干预或预定义的搜索算法(如遗传编程)来指导方程的探索和优化过程。这些方法限制了LLM的自主性和探索能力,难以充分利用LLM的科学知识和推理能力。

核心思路:SR-Scientist的核心思路是将LLM赋予自主性,使其能够像科学家一样,通过实验、分析和迭代优化来发现方程。通过将代码解释器封装为工具,LLM可以自主地进行数据分析、方程评估和优化,从而摆脱了人工干预和预定义流程的束缚。这种Agentic AI的方法能够更有效地利用LLM的科学知识和推理能力,探索更广阔的方程空间。

技术框架:SR-Scientist框架包含以下主要模块:1) LLM Agent:作为核心决策者,负责制定实验计划、编写代码、评估方程和优化方程。2) 代码解释器:提供执行Python代码的能力,用于数据分析、方程实现和评估。3) 工具集:封装了常用的数据分析和方程评估函数,例如数据可视化、统计分析、方程拟合等。4) 环境:提供实验数据和反馈信息,例如方程的拟合误差、泛化能力等。整个流程是,Agent首先根据当前知识和目标,选择合适的工具进行数据分析,然后提出候选方程,将方程实现为代码并提交给环境进行评估,最后根据环境的反馈信息,调整方程并进行下一轮迭代。

关键创新:SR-Scientist的关键创新在于将LLM从被动的方程提议者提升为主动的AI科学家。这种Agentic AI的方法赋予了LLM自主性,使其能够像科学家一样进行实验、分析和优化,从而更有效地发现科学方程。与现有方法相比,SR-Scientist不需要人工干预或预定义的搜索算法,能够更充分地利用LLM的科学知识和推理能力。

关键设计:SR-Scientist的关键设计包括:1) 工具集的选择:选择合适的工具对于Agent的性能至关重要。本文选择了常用的数据分析和方程评估函数,例如数据可视化、统计分析、方程拟合等。2) 奖励函数的设计:奖励函数用于指导Agent的学习方向。本文设计了一个综合考虑方程拟合误差、泛化能力和符号复杂度的奖励函数。3) 强化学习框架:为了进一步提升Agent的能力,本文开发了一个端到端强化学习框架,使用策略梯度算法训练Agent,使其能够更好地利用工具和优化方程。

🖼️ 关键图片

📊 实验亮点

SR-Scientist在四个科学学科的数据集上,相比基线方法取得了显著的性能提升,绝对提升幅度达到6%到35%。实验还表明,该方法对噪声具有鲁棒性,发现的方程能够泛化到领域外数据,并具有较高的符号准确性。此外,通过端到端强化学习框架的训练,Agent的能力得到了进一步提升。

🎯 应用场景

SR-Scientist具有广泛的应用前景,可以应用于物理学、化学、生物学、工程学等多个科学领域,帮助科学家自动发现新的科学方程和规律。该方法可以加速科学研究的进程,提高科学发现的效率,并可能发现人类难以凭借直觉发现的复杂方程。此外,该方法还可以用于教育领域,帮助学生更好地理解科学原理和数学建模。

📄 摘要(原文)

Recently, Large Language Models (LLMs) have been applied to scientific equation discovery, leveraging their embedded scientific knowledge for hypothesis generation. However, current methods typically confine LLMs to the role of an equation proposer within search algorithms like genetic programming. In this paper, we present SR-Scientist, a framework that elevates the LLM from a simple equation proposer to an autonomous AI scientist that writes code to analyze data, implements the equation as code, submits it for evaluation, and optimizes the equation based on experimental feedback. Specifically, we wrap the code interpreter into a set of tools for data analysis and equation evaluation. The agent is instructed to optimize the equation by utilizing these tools over a long horizon with minimal human-defined pipelines. Empirical results show that SR-Scientist outperforms baseline methods by an absolute margin of 6% to 35% on datasets covering four science disciplines. Additionally, we demonstrate our method's robustness to noise, the generalization of the discovered equations to out-of-domain data, and their symbolic accuracy. Furthermore, we develop an end-to-end reinforcement learning framework to enhance the agent's capabilities.