A Layered Intuition -- Method Model with Scope Extension for LLM Reasoning

作者: Hong Su

分类: cs.AI, cs.CL

发布日期: 2025-10-12

💡 一句话要点

提出基于分层直觉-方法模型与范围扩展的LLM推理框架,提升解决未见问题的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理 范围扩展 知识图谱 熵 分层模型 问题解决

📋 核心要点

- 现有LLM在解决间接问题时面临挑战,直接矩阵映射方法存在局限性。

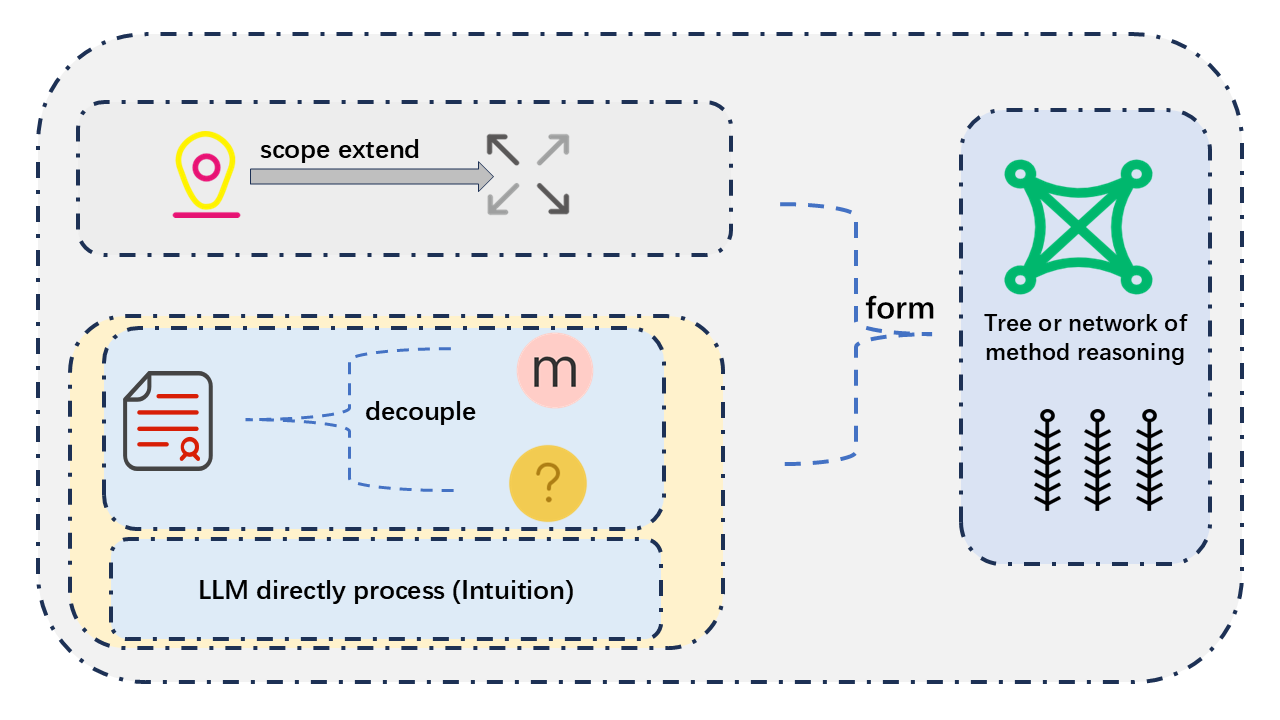

- 论文提出分层直觉-方法模型,结合范围扩展,将问题解耦为可迁移的推理单元。

- 引入方法扩展熵来评估系统解决未见问题的能力,提升LLM的适应性。

📝 摘要(中文)

本文提出了一种分层直觉-方法模型与范围扩展的统一框架,旨在提升大型语言模型(LLM)在解决间接(未见)问题上的性能。该框架基于已有的方法推理和范围扩展研究,将直觉思维作为快速的第一反应,方法思维将问题和解决方案解耦为可迁移的推理单元。范围扩展应用于拓宽适用性,包括垂直(因果分析)、水平(并行和泛化问题)以及首次提出的时间和空间扩展,从而扩展跨时间和上下文维度的推理。这些扩展被组织成系统的知识树,互连成知识网络,从而提高适应性。为了定量评估该过程,提出了方法扩展的熵,用于衡量扩展的独立性和多样性,作为系统解决未见问题能力的指标。通过将现有方法与新的扩展逻辑连接,并引入基于熵的评估框架,这项工作朝着为LLM在实际问题解决中提供更强大和可扩展的推理范式迈进了一步。

🔬 方法详解

问题定义:现有大型语言模型在处理复杂推理任务,特别是面对未曾见过的间接问题时,表现出一定的局限性。传统的直接矩阵映射方法难以有效应对这些挑战,缺乏足够的泛化能力和适应性。因此,如何提升LLM在解决未见问题时的推理能力,是本文要解决的核心问题。

核心思路:论文的核心思路是将推理过程分解为两个层次:直觉层和方法层。直觉层提供快速的初步判断,而方法层则将问题和解决方案解耦为独立的、可迁移的推理单元。通过范围扩展,进一步拓宽推理的适用范围,从而提高模型在不同场景下的适应性。这种分层结构和范围扩展的设计旨在模拟人类的思维方式,提升LLM的推理能力。

技术框架:该框架包含三个主要组成部分:直觉层、方法层和范围扩展。直觉层负责快速生成初步答案;方法层则将问题分解为一系列可迁移的推理步骤;范围扩展则包括垂直扩展(因果分析)、水平扩展(并行和泛化问题)以及时间和空间扩展。这些扩展被组织成知识树,并最终形成知识网络,从而实现更全面的推理能力。

关键创新:该论文的关键创新在于首次提出了时间和空间范围扩展,并将其与现有的垂直和水平扩展相结合,形成了一个更完整的范围扩展体系。此外,论文还引入了方法扩展熵的概念,用于定量评估模型解决未见问题的能力。这种熵的引入为评估LLM的推理能力提供了一种新的视角。

关键设计:论文中,范围扩展的具体实现方式(例如,如何构建知识树和知识网络)以及方法扩展熵的计算公式等技术细节并未详细描述,属于未知内容。未来的研究可以进一步探索这些方面的具体实现方法,以提升模型的性能。

🖼️ 关键图片

📊 实验亮点

论文提出了方法扩展熵,用于量化评估模型解决未见问题的能力,为LLM推理能力的评估提供了一种新的指标。虽然论文中没有提供具体的实验数据,但该框架的提出为后续研究提供了有益的参考。

🎯 应用场景

该研究成果可应用于智能客服、自动驾驶、医疗诊断等领域,提升LLM在复杂场景下的问题解决能力。通过扩展LLM的推理范围和适应性,可以更好地应对现实世界中的各种挑战,具有重要的实际应用价值和未来发展潜力。

📄 摘要(原文)

Existing studies have introduced method-based reasoning and scope extension as approaches to enhance Large Language Model (LLM) performance beyond direct matrix mappings. Building on these foundations, this paper summarizes and integrates these ideas into a unified Intuition-Method Layered Model with Scope Extension, designed to address indirected (unseen) issues more systematically. In this framework, intuition-based thinking provides rapid first-reaction answers, while method-based thinking decouples questions and solutions into transferable reasoning units. Scope extension is then applied to broaden applicability, including vertical (cause analysis), horizontal (parallel and generalized issues), and for the first time, temporal and spatial extensions, which expand reasoning across time and contextual dimensions. These extensions are organized into systematic knowledge trees that interconnect into a knowledge network, thereby increasing adaptability. To quantitatively evaluate this process, we propose the entropy of method extension, which measures the independence and diversity of extensions as an indicator of the system's capacity to solve unseen questions. By logically connecting existing approaches with new extensions and introducing an entropy-based evaluation framework, this work advances toward a more robust and extensible reasoning paradigm for LLMs in real-world problem-solving.