ConstraintLLM: A Neuro-Symbolic Framework for Industrial-Level Constraint Programming

作者: Weichun Shi, Minghao Liu, Wanting Zhang, Langchen Shi, Fuqi Jia, Feifei Ma, Jian Zhang

分类: cs.AI

发布日期: 2025-10-07

备注: Accepted to the 2025 Conference on Empirical Methods in Natural Language Processing (EMNLP 2025), Main Conference

期刊: Proceedings of the 2025 Conference on Empirical Methods in Natural Language Processing, pages 15999-16019

DOI: 10.18653/v1/2025.emnlp-main.809

🔗 代码/项目: GITHUB

💡 一句话要点

提出ConstraintLLM以解决工业级约束编程问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 约束编程 大型语言模型 神经符号AI 自动建模 优化问题 工业级基准 上下文学习 思维树框架

📋 核心要点

- 现有方法在约束编程领域的应用较少,缺乏针对CP建模的专门大型语言模型,导致求解效率和准确性不足。

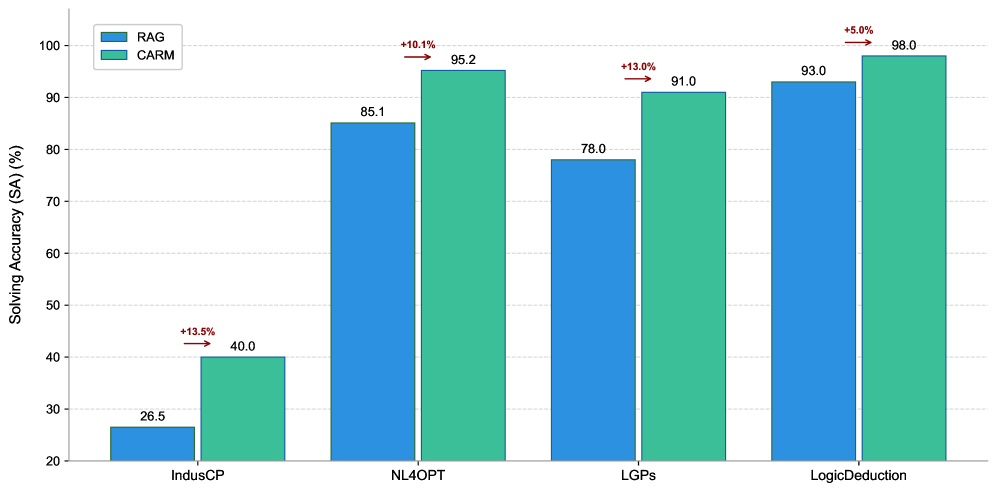

- 本文提出ConstraintLLM,专为CP建模设计,结合约束感知检索模块(CARM)和思维树框架,提升了模型的上下文学习能力。

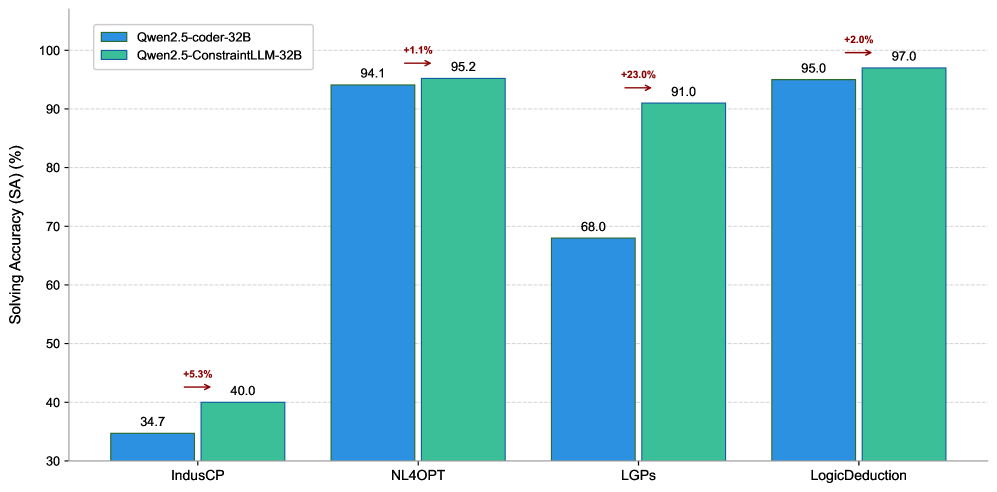

- 实验结果显示,ConstraintLLM在多个基准测试中表现优异,特别是在IndusCP基准上,其求解准确率比基线提升了2倍。

📝 摘要(中文)

约束编程(CP)是解决现实世界约束优化问题的重要技术,具备丰富的建模语义和高效的求解能力。利用大型语言模型(LLMs)自动生成CP的形式化建模成为一种有前景的方法,旨在借助符号求解器构建可信的神经符号AI。然而,相较于基于运筹学模型的研究,CP的关注度较低。本文介绍了ConstraintLLM,这是首个专为CP建模设计的LLM,经过多指令监督微调训练。我们提出了约束感知检索模块(CARM),以增强上下文学习能力,并将其集成在带有引导自我纠正机制的思维树(ToT)框架中。此外,我们构建并发布了IndusCP,这是首个工业级CP建模基准,包含来自多个领域的140个挑战性任务。实验表明,ConstraintLLM在多个基准上实现了最先进的求解准确率,并在新的IndusCP基准上超越基线2倍。

🔬 方法详解

问题定义:本文旨在解决约束编程(CP)建模中的效率和准确性问题。现有方法多集中于运筹学模型,CP的研究相对较少,导致在实际应用中面临挑战。

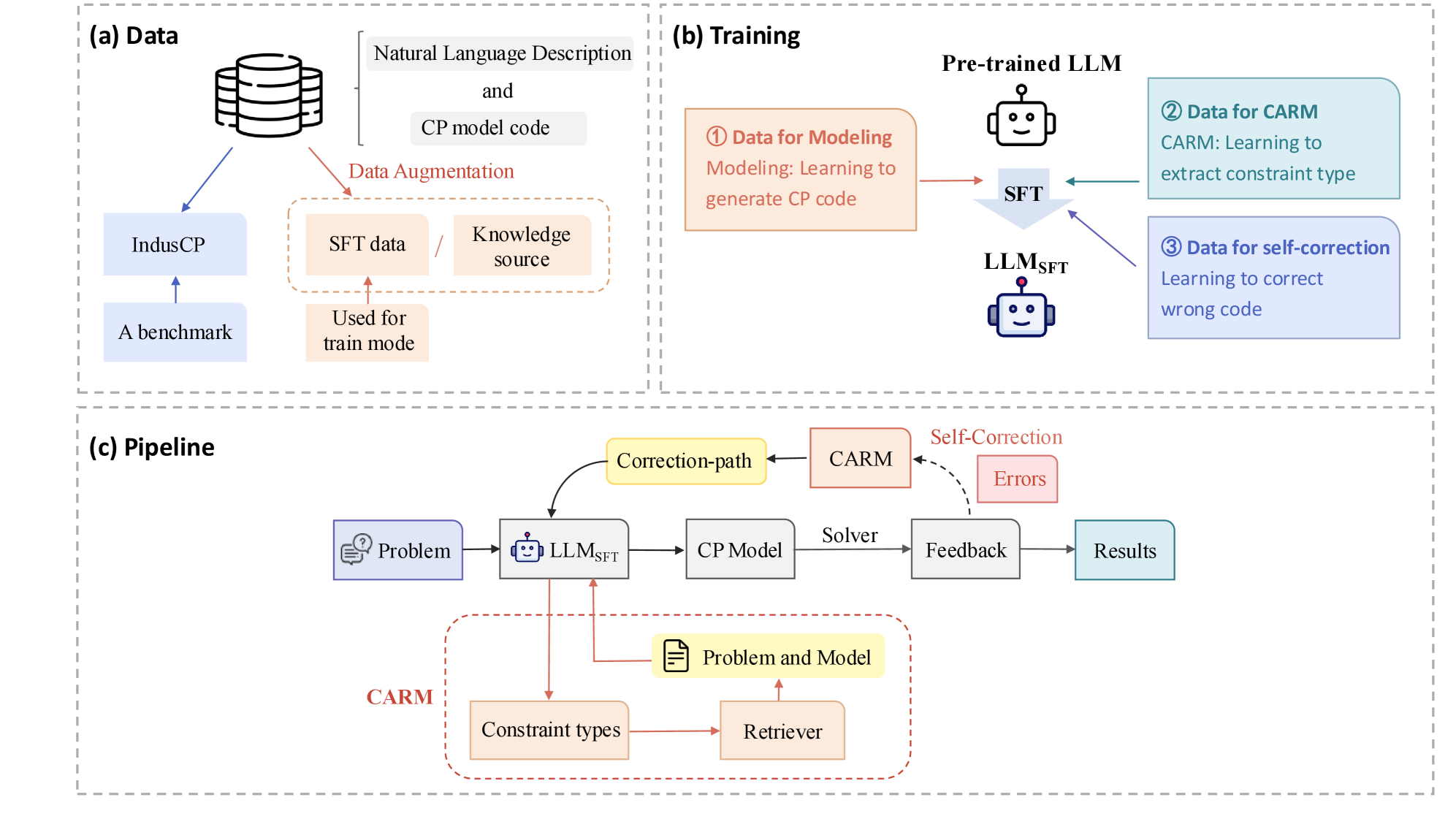

核心思路:ConstraintLLM通过结合大型语言模型和符号求解器,自动生成CP的形式化建模。引入约束感知检索模块(CARM)以增强模型的上下文学习能力,提升求解效果。

技术框架:整体架构包括大型语言模型的微调、CARM模块的集成以及思维树(ToT)框架。思维树框架引入引导自我纠正机制,以优化模型的推理过程。

关键创新:ConstraintLLM是首个专为CP建模设计的LLM,结合了神经网络和符号求解的优势,显著提高了求解准确率。与传统方法相比,模型能够更好地处理复杂约束。

关键设计:在模型设计中,采用多指令监督微调策略,CARM模块通过增强上下文信息的检索能力来提升学习效果。具体的损失函数和网络结构设计旨在优化模型在CP任务中的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ConstraintLLM在多个基准测试中实现了最先进的求解准确率,特别是在IndusCP基准上,其性能较基线提升了2倍,展示了该模型在工业级约束编程中的优越性。

🎯 应用场景

ConstraintLLM的研究成果可广泛应用于工业级约束优化问题,如生产调度、资源分配和物流管理等领域。通过提高约束编程的建模效率和求解准确性,该模型有潜力推动智能制造和自动化决策的进步,具有重要的实际价值和未来影响。

📄 摘要(原文)

Constraint programming (CP) is a crucial technology for solving real-world constraint optimization problems (COPs), with the advantages of rich modeling semantics and high solving efficiency. Using large language models (LLMs) to generate formal modeling automatically for COPs is becoming a promising approach, which aims to build trustworthy neuro-symbolic AI with the help of symbolic solvers. However, CP has received less attention compared to works based on operations research (OR) models. We introduce ConstraintLLM, the first LLM specifically designed for CP modeling, which is trained on an open-source LLM with multi-instruction supervised fine-tuning. We propose the Constraint-Aware Retrieval Module (CARM) to increase the in-context learning capabilities, which is integrated in a Tree-of-Thoughts (ToT) framework with guided self-correction mechanism. Moreover, we construct and release IndusCP, the first industrial-level benchmark for CP modeling, which contains 140 challenging tasks from various domains. Our experiments demonstrate that ConstraintLLM achieves state-of-the-art solving accuracy across multiple benchmarks and outperforms the baselines by 2x on the new IndusCP benchmark. Code and data are available at: https://github.com/william4s/ConstraintLLM.