Membership Inference Attacks on Tokenizers of Large Language Models

作者: Meng Tong, Yuntao Du, Kejiang Chen, Weiming Zhang

分类: cs.CR, cs.AI

发布日期: 2025-10-07 (更新: 2026-01-12)

备注: To appear at USENIX Security Symposium 2026

💡 一句话要点

提出基于Tokenizer的成员推断攻击,揭示大语言模型隐私风险

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 成员推断攻击 大型语言模型 Tokenizer 隐私泄露 自适应防御

📋 核心要点

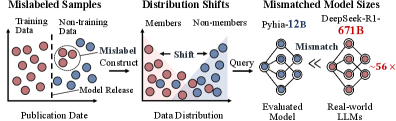

- 现有成员推断攻击在大型语言模型上效果不佳,因为存在数据分布偏移和模型规模差异等问题。

- 本文提出利用Tokenizer作为新的攻击向量,Tokenizer训练高效且数据代表性强,能有效规避现有挑战。

- 实验表明,Tokenizer存在严重的成员泄露风险,并提出自适应防御机制,验证了该风险的可行性。

📝 摘要(中文)

成员推断攻击(MIAs)被广泛用于评估与机器学习模型相关的隐私风险。然而,当这些攻击应用于预训练的大型语言模型(LLMs)时,它们面临着显著的挑战,包括错误标记的样本、分布偏移以及实验和实际设置之间模型大小的差异。为了解决这些限制,我们引入了tokenizer作为成员推断的新攻击向量。具体来说,tokenizer将原始文本转换为LLM的token。与完整模型不同,tokenizer可以从头开始高效地训练,从而避免了上述挑战。此外,tokenizer的训练数据通常代表用于预训练LLM的数据。尽管有这些优点,tokenizer作为攻击向量的潜力仍未被探索。为此,我们首次研究了通过tokenizer进行的成员泄漏,并探索了五种攻击方法来推断数据集成员。对数百万互联网样本进行的大量实验揭示了最先进的LLM的tokenizer中的漏洞。为了减轻这种新兴风险,我们进一步提出了一种自适应防御。我们的发现强调tokenizer是一个被忽视但至关重要的隐私威胁,强调迫切需要专门为它们设计的隐私保护机制。

🔬 方法详解

问题定义:本文旨在解决大型语言模型(LLMs)的成员推断攻击(MIA)问题。现有的MIA方法在应用于LLMs时面临诸多挑战,例如训练数据与实际应用数据之间的分布偏移,以及实验环境与真实环境的模型规模差异。这些因素导致现有MIA方法在LLMs上的有效性降低。此外,直接攻击LLM需要大量的计算资源和时间,使得研究成本较高。

核心思路:本文的核心思路是将tokenizer作为新的攻击向量。Tokenizer是将原始文本转换为LLM可以处理的token序列的组件。与完整的LLM相比,tokenizer的训练成本较低,并且其训练数据通常与LLM的预训练数据具有相似的分布。因此,通过攻击tokenizer,可以更高效地评估LLM的隐私风险,并避免现有MIA方法面临的挑战。

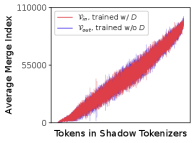

技术框架:本文提出的攻击框架主要包括以下几个步骤:1)收集tokenizer的训练数据和非训练数据;2)训练tokenizer;3)使用不同的MIA方法(例如,基于阈值的攻击、基于熵的攻击、基于shadow model的攻击等)对tokenizer进行攻击,以推断某个样本是否属于tokenizer的训练集;4)评估攻击的性能,例如准确率、召回率和F1值。同时,本文还提出了一种自适应防御机制,通过对tokenizer的训练数据进行扰动,降低MIA的攻击成功率。

关键创新:本文最重要的技术创新点在于将tokenizer作为MIA的攻击向量。以往的研究主要集中于攻击完整的LLM,而忽略了tokenizer的隐私风险。本文首次揭示了tokenizer可能存在的成员泄露问题,并证明了通过攻击tokenizer可以有效地推断LLM的训练数据成员。

关键设计:本文探索了五种不同的MIA方法,包括基于阈值的攻击、基于熵的攻击、基于shadow model的攻击等。这些方法利用tokenizer的输出分布来区分训练集样本和非训练集样本。此外,本文还提出了一种自适应防御机制,通过对tokenizer的训练数据进行扰动,降低MIA的攻击成功率。具体的扰动方法包括添加噪声、删除部分数据等。防御机制的关键在于平衡模型的性能和隐私保护。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的Tokenizer存在显著的成员泄露风险,攻击者可以利用Tokenizer的输出分布,以较高的准确率推断出某个样本是否属于训练集。例如,基于阈值的攻击在某些数据集上可以达到80%以上的准确率。此外,本文提出的自适应防御机制可以有效地降低MIA的攻击成功率,同时对模型的性能影响较小。

🎯 应用场景

该研究成果可应用于评估和提升大型语言模型的隐私安全性。通过分析Tokenizer的成员泄露风险,可以帮助开发者更好地理解LLM的潜在隐私漏洞,并设计更有效的隐私保护机制。此外,该研究还可以促进隐私保护技术在自然语言处理领域的应用,例如差分隐私训练、联邦学习等。

📄 摘要(原文)

Membership inference attacks (MIAs) are widely used to assess the privacy risks associated with machine learning models. However, when these attacks are applied to pre-trained large language models (LLMs), they encounter significant challenges, including mislabeled samples, distribution shifts, and discrepancies in model size between experimental and real-world settings. To address these limitations, we introduce tokenizers as a new attack vector for membership inference. Specifically, a tokenizer converts raw text into tokens for LLMs. Unlike full models, tokenizers can be efficiently trained from scratch, thereby avoiding the aforementioned challenges. In addition, the tokenizer's training data is typically representative of the data used to pre-train LLMs. Despite these advantages, the potential of tokenizers as an attack vector remains unexplored. To this end, we present the first study on membership leakage through tokenizers and explore five attack methods to infer dataset membership. Extensive experiments on millions of Internet samples reveal the vulnerabilities in the tokenizers of state-of-the-art LLMs. To mitigate this emerging risk, we further propose an adaptive defense. Our findings highlight tokenizers as an overlooked yet critical privacy threat, underscoring the urgent need for privacy-preserving mechanisms specifically designed for them.