Bridging Reasoning to Learning: Unmasking Illusions using Complexity Out of Distribution Generalization

作者: Mohammad Mahdi Samiei Paqaleh, Arash Marioriyad, Arman Tahmasebi-Zadeh, Mohamadreza Fereydooni, Mahdi Ghaznavai, Mahdieh Soleymani Baghshah

分类: cs.AI, cs.LG

发布日期: 2025-10-06

💡 一句话要点

提出复杂度分布外泛化框架,用于评估和提升AI的推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推理能力 分布外泛化 复杂度度量 柯尔莫哥洛夫复杂度 归纳偏置

📋 核心要点

- 现有AI模型在推理能力评估上缺乏明确的定义和统一的指标,导致难以有效衡量和提升。

- 论文提出复杂度分布外泛化(Complexity OoD)框架,通过解的复杂程度来定义和衡量模型的推理能力。

- 该框架强调模型在面对复杂度超出训练数据的测试用例时,仍能保持良好的性能,从而实现更鲁棒的推理。

📝 摘要(中文)

近年来,人工智能已从模式识别任务发展到需要逐步推理的问题,尤其是在大型语言模型中。然而,与学习领域中泛化和分布外(OoD)评估的概念不同,推理能力缺乏明确且一致的定义或指标。本文提出了复杂度分布外(Complexity OoD)泛化框架,用于定义和衡量推理能力。当模型在测试实例上保持性能时,且这些实例的最小所需解复杂度(无论是表征上的(更丰富的解结构)还是计算上的(更多的推理步骤/程序长度))超过了所有训练样本,则该模型表现出复杂度OoD泛化能力。我们通过解描述的柯尔莫哥洛夫复杂度和操作代理(例如,对象/关系计数;推理步骤计数)来形式化复杂度,阐明了复杂度OoD与长度和组合OoD的区别。这种视角统一了学习和推理:许多可以用类似System1的处理在低复杂度下解决的案例,在复杂度压力下变得像System2,而System2可以被视为对解结构的泛化。我们将这种视角转化为实践,提出了在整个堆栈中实施复杂度OoD的建议:将复杂度纳入基准和评估指标设计,重新思考针对解轨迹的监督,寻找和设计用于复杂度OoD泛化的归纳偏置,解决学习到推理的溢出问题,例如虚假捷径、语义鲁棒性、灾难性遗忘和逐步校准。由于复杂度OoD不能仅通过扩展数据来解决,因此在鲁棒推理方面取得进展将需要明确建模并根据复杂度分配计算的架构和训练方案。

🔬 方法详解

问题定义:现有AI模型,特别是大型语言模型,在推理能力上取得了显著进展,但缺乏一个清晰、一致的定义和度量标准来评估其推理能力。现有的泛化和分布外(OoD)评估方法主要关注输入数据的分布变化,而忽略了解决问题所需的内在复杂性。这导致模型容易学习到虚假的捷径,并且在面对复杂度更高的任务时表现不佳。

核心思路:论文的核心思路是将推理能力与解决问题所需的最小复杂度联系起来。通过定义复杂度分布外泛化(Complexity OoD),即模型在解决复杂度高于训练数据的测试用例时仍能保持高性能,来衡量模型的推理能力。这种方法强调模型需要真正理解问题的结构和推理步骤,而不是简单地记忆或模仿训练数据。

技术框架:该框架主要包含以下几个方面:1) 复杂度形式化:使用柯尔莫哥洛夫复杂度和操作代理(如对象/关系计数、推理步骤计数)来量化问题的复杂度。2) Complexity OoD定义:明确定义了Complexity OoD泛化的概念,即模型在复杂度超出训练集的测试集上的表现。3) 实践建议:提出了在基准测试、评估指标、监督方式、归纳偏置等方面实施Complexity OoD的具体建议。4) 问题解决:针对学习到推理的溢出问题,如虚假捷径、语义鲁棒性、灾难性遗忘和逐步校准,提出了相应的解决方案。

关键创新:该论文最重要的创新在于提出了Complexity OoD泛化的概念,并将其作为评估和提升AI推理能力的关键框架。与传统的OoD泛化不同,Complexity OoD关注的是解决问题所需的内在复杂度,而不是输入数据的分布变化。这使得该框架能够更准确地衡量模型的推理能力,并指导模型学习更鲁棒的推理策略。

关键设计:论文的关键设计包括:1) 使用柯尔莫哥洛夫复杂度和操作代理来量化问题的复杂度,为Complexity OoD的评估提供了基础。2) 提出了针对解轨迹的监督方式,鼓励模型学习正确的推理步骤,而不是简单地模仿训练数据。3) 强调需要设计具有Complexity OoD泛化能力的归纳偏置,例如,通过显式地建模和分配计算资源来应对复杂度。

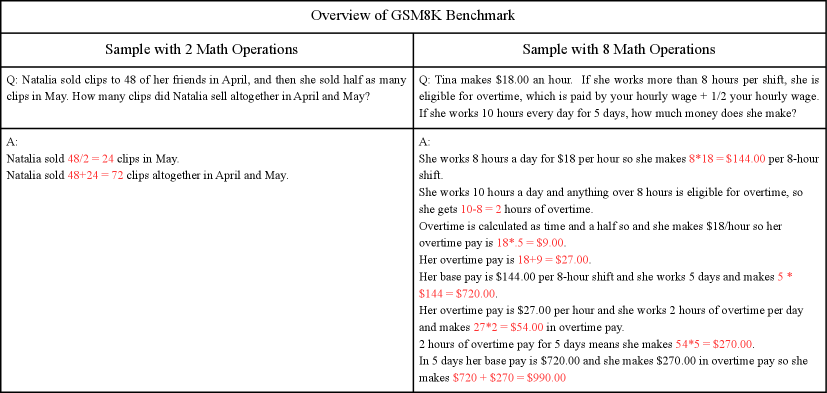

🖼️ 关键图片

📊 实验亮点

论文提出了Complexity OoD泛化框架,并给出了在多个方面实施该框架的具体建议。虽然论文没有提供具体的实验数据,但其提出的框架和建议为未来研究提供了明确的方向。该框架强调了模型在面对复杂度超出训练数据的测试用例时,仍能保持良好的性能,从而实现更鲁棒的推理。

🎯 应用场景

该研究成果可应用于各种需要复杂推理的AI系统,例如智能问答、机器人导航、程序生成等。通过提升模型在Complexity OoD上的泛化能力,可以使其在面对更复杂、更真实的应用场景时表现更佳,从而提高AI系统的可靠性和实用性。未来的影响在于推动AI系统从简单的模式识别向更高级的推理和问题解决能力发展。

📄 摘要(原文)

Recent progress has pushed AI frontiers from pattern recognition tasks toward problems that require step by step, System2 style reasoning, especially with large language models. Yet, unlike learning, where generalization and out of distribution (OoD) evaluation concepts are well formalized, there is no clear, consistent definition or metric for reasoning ability. We propose Complexity Out of Distribution (Complexity OoD) generalization as a framework and problem setting to define and measure reasoning. A model exhibits Complexity OoD generalization when it maintains performance on test instances whose minimal required solution complexity, either representational (richer solution structure) or computational (more reasoning steps/program length), exceeds that of all training examples. We formalize complexity via solution description Kolmogorov complexity and operational proxies (e.g., object/relation counts; reasoning step counts), clarifying how Complexity OoD differs from length and compositional OoD. This lens unifies learning and reasoning: many cases solvable with System1 like processing at low complexity become System2 like under complexity pressure, while System2 can be viewed as generalization over solution structures. We translate this perspective into practice with recommendations for operationalizing Complexity OoD across the stack: incorporating complexity into benchmark and evaluation metric design, rethinking supervision to target solution traces, seeking and designing inductive biases for Complexity OoD generalization, addressing learning to reason spillovers such as spurious shortcuts, semantic robustness, catastrophic forgetting, and step wise calibration. Because Complexity OoD cannot be solved by scaling data alone, progress toward robust reasoning will require architectures and training regimes that explicitly model and allocate computation with respect to complexity.