Think Then Embed: Generative Context Improves Multimodal Embedding

作者: Xuanming Cui, Jianpeng Cheng, Hong-you Chen, Satya Narayan Shukla, Abhijeet Awasthi, Xichen Pan, Chaitanya Ahuja, Shlok Kumar Mishra, Yonghuan Yang, Jun Xiao, Qi Guo, Ser-Nam Lim, Aashu Singh, Xiangjun Fan

分类: cs.AI, cs.LG

发布日期: 2025-10-06 (更新: 2026-01-19)

💡 一句话要点

提出Think-Then-Embed框架,利用生成式上下文提升通用多模态嵌入性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态嵌入 大型语言模型 思维链 生成式模型 视觉推理

📋 核心要点

- 现有通用多模态嵌入方法主要依赖编码器,忽略了MLLM的生成能力,在处理复杂指令时效果不佳。

- 论文提出Think-Then-Embed框架,利用MLLM的生成能力,先进行推理再进行嵌入,从而更好地理解复杂指令。

- 实验表明,该方法在MMEB-V2基准测试中取得了SOTA性能,并且通过微调小型MLLM推理器,实现了开源模型中的最佳性能。

📝 摘要(中文)

通用多模态嵌入(UME)旨在生成任务特定的表示,受到越来越多的关注。虽然最近的研究表明多模态大型语言模型(MLLM)在此类任务中表现良好,但它们仅将MLLM视为编码器,忽略了其生成能力。然而,随着指令变得更加复杂并需要组合推理,这种编码范式变得不太有效。受到思维链推理有效性的启发,我们为UME提出了一个通用的Think-Then-Embed(TTE)框架,它由一个推理器和一个嵌入器组成。推理器MLLM首先生成解释复杂查询的推理轨迹,然后嵌入器生成以原始查询和中间推理为条件的表示。这种显式的推理步骤能够更细致地理解复杂的多模态指令。我们的贡献有三方面:首先,通过利用强大的MLLM推理器,我们在MMEB-V2基准测试中取得了最先进的性能,超过了在大量内部数据集上训练的专有模型。其次,为了减少对大型MLLM推理器的依赖,我们使用高质量的以嵌入为中心的推理轨迹对较小的MLLM推理器进行微调,在开源模型中实现了最佳性能,比最近提出的模型提高了7%。第三,我们研究了将推理器和嵌入器集成到统一模型中的策略,以提高效率而不牺牲性能。

🔬 方法详解

问题定义:论文旨在解决通用多模态嵌入(UME)在处理复杂指令时,由于现有方法仅将多模态大型语言模型(MLLM)作为编码器,忽略其生成能力而导致的性能瓶颈。现有方法难以进行组合推理,无法充分理解复杂的多模态指令。

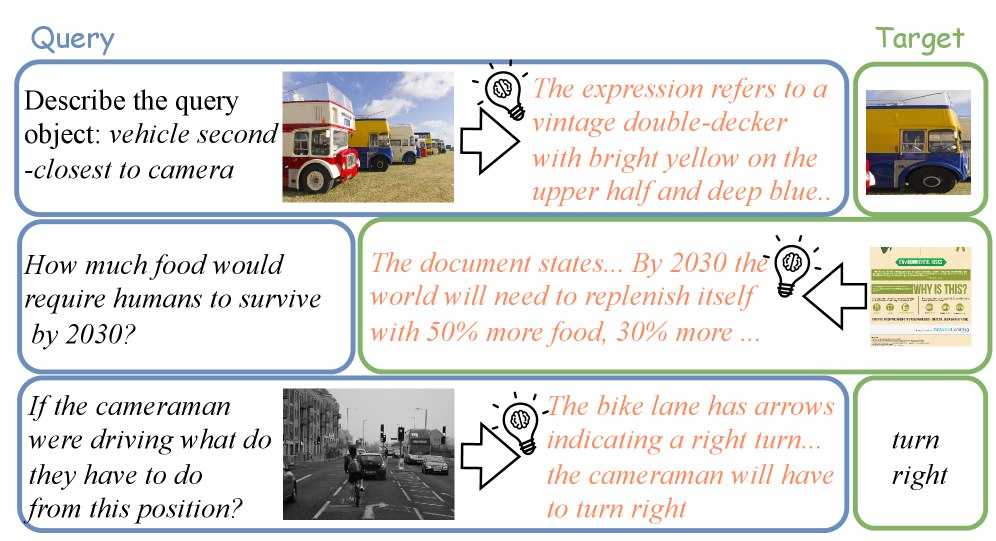

核心思路:论文的核心思路是借鉴思维链(Chain-of-Thought)推理的有效性,提出Think-Then-Embed (TTE)框架。该框架显式地利用MLLM的生成能力,首先让MLLM进行推理,生成中间推理步骤,然后再进行嵌入。这样可以使模型更好地理解复杂指令,从而提升嵌入表示的质量。

技术框架:TTE框架包含两个主要模块:推理器(Reasoner)和嵌入器(Embedder)。推理器是一个MLLM,负责接收原始查询并生成推理轨迹,解释复杂查询。嵌入器接收原始查询和推理轨迹,生成最终的嵌入表示。整体流程是:输入复杂多模态指令 -> 推理器生成推理轨迹 -> 嵌入器结合指令和推理轨迹生成嵌入表示。

关键创新:论文的关键创新在于提出了Think-Then-Embed框架,将MLLM的生成能力引入到通用多模态嵌入中。与现有方法直接将MLLM作为编码器不同,TTE框架显式地利用MLLM进行推理,生成中间推理步骤,从而提升了模型对复杂指令的理解能力。此外,论文还探索了如何将推理器和嵌入器集成到统一模型中,以提高效率。

关键设计:论文中,推理器可以使用大型MLLM,也可以使用通过高质量的以嵌入为中心的推理轨迹微调的小型MLLM。嵌入器可以使用各种现有的多模态嵌入模型。论文还研究了不同的集成策略,例如将推理器和嵌入器合并为一个统一的模型。具体的参数设置、损失函数和网络结构取决于所使用的具体MLLM和嵌入模型。

🖼️ 关键图片

📊 实验亮点

论文在MMEB-V2基准测试中取得了SOTA性能,超过了在大量内部数据集上训练的专有模型。此外,通过使用高质量的以嵌入为中心的推理轨迹对较小的MLLM推理器进行微调,在开源模型中实现了最佳性能,比最近提出的模型提高了7%。

🎯 应用场景

该研究成果可应用于各种需要理解复杂多模态指令的场景,例如智能问答、视觉推理、机器人导航等。通过提升多模态嵌入的质量,可以提高这些应用在复杂环境下的性能和鲁棒性,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

There is a growing interest in Universal Multimodal Embeddings (UME), where models are required to generate task-specific representations. While recent studies show that Multimodal Large Language Models (MLLMs) perform well on such tasks, they treat MLLMs solely as encoders, overlooking their generative capacity. However, such an encoding paradigm becomes less effective as instructions become more complex and require compositional reasoning. Inspired by the proven effectiveness of chain-of-thought reasoning, we propose a general Think-Then-Embed (TTE) framework for UME, composed of a reasoner and an embedder. The reasoner MLLM first generates reasoning traces that explain complex queries, followed by an embedder that produces representations conditioned on both the original query and the intermediate reasoning. This explicit reasoning step enables more nuanced understanding of complex multimodal instructions. Our contributions are threefold. First, by leveraging a powerful MLLM reasoner, we achieve state-of-the-art performance on the MMEB-V2 benchmark, surpassing proprietary models trained on massive in-house datasets. Second, to reduce the dependency on large MLLM reasoners, we finetune a smaller MLLM reasoner using high-quality embedding-centric reasoning traces, achieving the best performance among open-source models with a 7% absolute gain over recently proposed models. Third, we investigate strategies for integrating the reasoner and embedder into a unified model for improved efficiency without sacrificing performance.