Bridging the Gap Between Multimodal Foundation Models and World Models

作者: Xuehai He

分类: cs.AI, cs.CL, cs.CV, cs.LG

发布日期: 2025-10-04

备注: PhD thesis

💡 一句话要点

弥合多模态基础模型与世界模型差距,提升推理与生成能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态基础模型 世界模型 因果推理 反事实推理 可控生成 场景图 4D生成

📋 核心要点

- 现有MFMs缺乏反事实推理、动态模拟等关键能力,无法有效模拟真实世界。

- 通过判别任务和结构化推理技能,增强MFMs对视觉和文本数据深层关系的理解。

- 引入场景图等多模态信息,实现图像和视频的可控生成,并扩展到4D生成。

📝 摘要(中文)

本文旨在弥合多模态基础模型(MFMs)与世界模型之间的差距。当前MFMs在反事实推理、动态模拟、时空信息理解、可控视觉生成和多方面推理等关键能力上存在不足,难以作为有效的世界模型。本文首先通过判别任务提升MFMs的推理能力,并赋予其结构化推理技能,如因果推断、反事实思考和时空推理,使其超越表面相关性,理解视觉和文本数据之间更深层次的关系。其次,探索MFMs在图像和视频模态上的生成能力,引入新的结构化和可控生成框架。这些方法结合了场景图、多模态条件和多模态对齐策略来指导生成过程,确保与高层语义和细粒度用户意图的一致性。进一步将这些技术扩展到可控的4D生成,实现随时间和空间变化的交互式、可编辑和可变形的对象合成。

🔬 方法详解

问题定义:当前的多模态基础模型(MFMs)虽然在多模态理解和生成方面表现出色,但它们缺乏世界模型的关键能力,例如进行反事实推理、模拟动态过程、理解时空信息、控制生成结果以及执行多方面的推理。现有的MFMs主要关注于学习数据中的表面相关性,而忽略了更深层次的因果关系和物理规律,这限制了它们在复杂环境中的应用。

核心思路:本文的核心思路是通过增强MFMs的推理能力和生成控制能力,使其更接近于世界模型。具体来说,首先通过判别任务和结构化推理技能(如因果推断、反事实思考和时空推理)来提升MFMs的推理能力,使其能够理解视觉和文本数据之间更深层次的关系。然后,通过引入场景图、多模态条件和多模态对齐策略来增强MFMs的生成控制能力,使其能够生成符合高层语义和细粒度用户意图的图像和视频。

技术框架:整体框架包含两个主要部分:推理能力增强和生成能力增强。推理能力增强部分主要通过训练MFMs执行各种判别任务,并引入结构化推理模块来实现。生成能力增强部分则主要通过引入场景图、多模态条件和多模态对齐策略来指导生成过程。具体流程包括:1) 使用判别任务训练MFMs;2) 引入结构化推理模块,如因果推理模块;3) 使用场景图等多模态信息作为条件,指导图像和视频的生成;4) 使用多模态对齐策略,确保生成结果与用户意图一致。

关键创新:本文的关键创新在于将结构化推理技能引入到MFMs中,使其能够超越表面相关性,理解视觉和文本数据之间更深层次的关系。此外,本文还提出了新的结构化和可控生成框架,通过引入场景图、多模态条件和多模态对齐策略,实现了对生成结果的精细控制。将这些技术扩展到可控的4D生成,实现随时间和空间变化的交互式、可编辑和可变形的对象合成也是一个重要的创新点。

关键设计:在推理能力增强方面,关键设计包括选择合适的判别任务和设计有效的结构化推理模块。在生成能力增强方面,关键设计包括如何有效地利用场景图等多模态信息作为条件,以及如何设计多模态对齐策略来确保生成结果与用户意图一致。具体的参数设置、损失函数和网络结构等技术细节在论文中应该有更详细的描述(未知)。

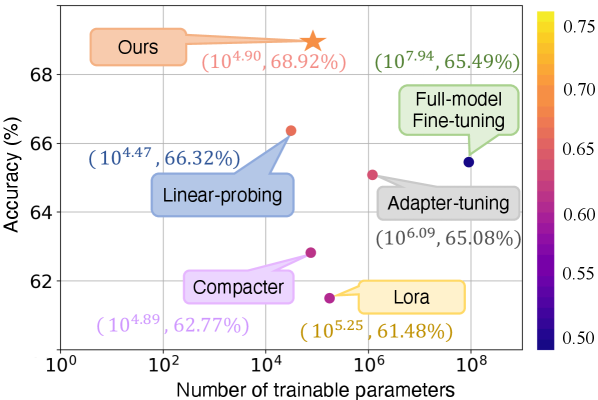

🖼️ 关键图片

📊 实验亮点

由于论文摘要中没有提供具体的实验结果和性能数据,因此无法总结实验亮点。具体实验结果,包括性能数据、对比基线和提升幅度等,需要在阅读完整论文后才能得知(未知)。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、游戏开发、虚拟现实等领域。例如,机器人可以利用增强后的世界模型进行更准确的环境理解和决策,自动驾驶系统可以更好地预测交通状况和避免事故,游戏开发者可以创建更逼真和交互性更强的虚拟世界。未来,该技术有望推动人工智能在复杂环境中的应用。

📄 摘要(原文)

Humans understand the world through the integration of multiple sensory modalities, enabling them to perceive, reason about, and imagine dynamic physical processes. Inspired by this capability, multimodal foundation models (MFMs) have emerged as powerful tools for multimodal understanding and generation. However, today's MFMs fall short of serving as effective world models. They lack the essential ability such as perform counterfactual reasoning, simulate dynamics, understand the spatiotemporal information, control generated visual outcomes, and perform multifaceted reasoning. We investigates what it takes to bridge the gap between multimodal foundation models and world models. We begin by improving the reasoning capabilities of MFMs through discriminative tasks and equipping MFMs with structured reasoning skills, such as causal inference, counterfactual thinking, and spatiotemporal reasoning, enabling them to go beyond surface correlations and understand deeper relationships within visual and textual data. Next, we explore generative capabilities of multimodal foundation models across both image and video modalities, introducing new frameworks for structured and controllable generation. Our approaches incorporate scene graphs, multimodal conditioning, and multimodal alignment strategies to guide the generation process, ensuring consistency with high-level semantics and fine-grained user intent. We further extend these techniques to controllable 4D generation, enabling interactive, editable, and morphable object synthesis over time and space.