Dissecting Larval Zebrafish Hunting using Deep Reinforcement Learning Trained RNN Agents

作者: Raaghav Malik, Satpreet H. Singh, Sonja Johnson-Yu, Nathan Wu, Roy Harpaz, Florian Engert, Kanaka Rajan

分类: q-bio.NC, cs.AI, cs.LG, cs.NE, eess.SY

发布日期: 2025-10-04

💡 一句话要点

利用深度强化学习训练的RNN智能体解剖斑马鱼幼虫的捕猎行为

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 循环神经网络 斑马鱼幼虫 捕猎行为 生物行为建模

📋 核心要点

- 现有方法难以在生态和能量约束下,有效模拟斑马鱼幼虫的捕猎行为,缺乏对行为背后权衡的深入理解。

- 论文提出基于深度强化学习的循环策略,在简化的斑马鱼模拟器中训练智能体,模拟其捕猎行为。

- 实验表明,该模型能够重现真实的斑马鱼捕猎行为,并揭示了生态约束、能量成本对捕猎策略的影响。

📝 摘要(中文)

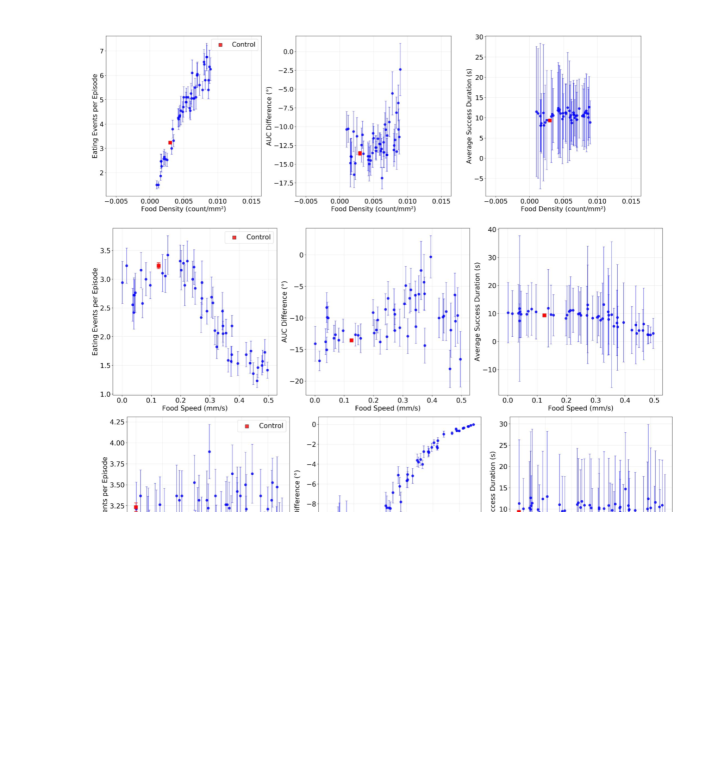

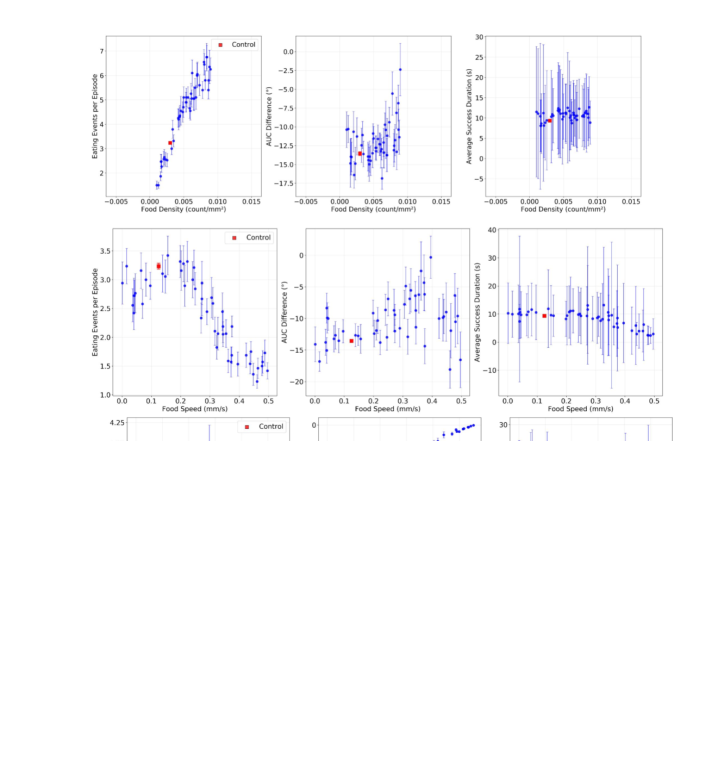

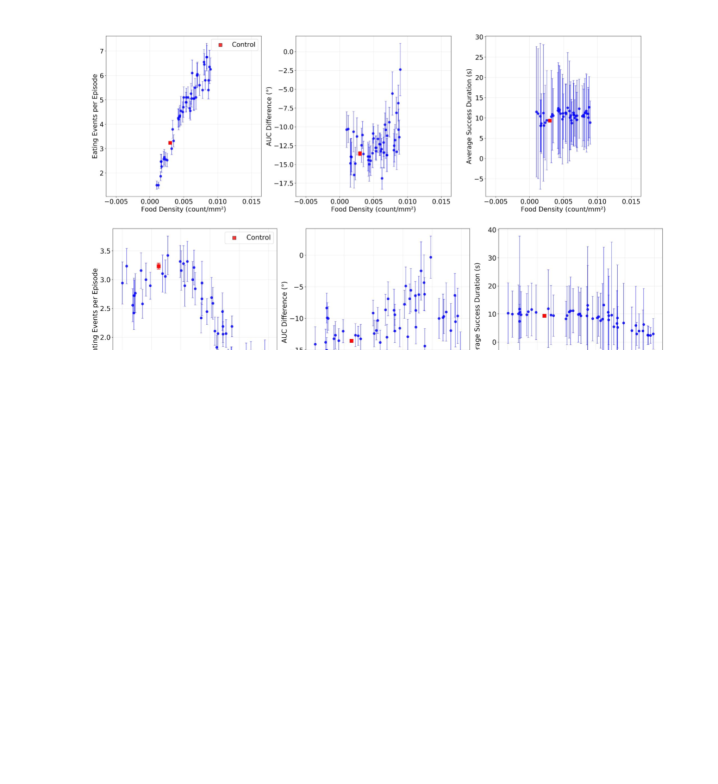

斑马鱼幼虫的捕猎行为提供了一个易于处理的环境,用于研究生态和能量约束如何在生物大脑和人工代理中塑造适应性行为。本文开发了一个最小的基于代理的模型,在基于爆发的斑马鱼模拟器中使用深度强化学习训练循环策略。尽管模型很简单,但它重现了标志性的捕猎行为,包括与眼睛会聚相关的追逐、速度调节和刻板的接近轨迹,这些行为与真实的斑马鱼幼虫非常匹配。定量轨迹分析表明,追逐爆发系统地将猎物角度在攻击前减少大约一半,这与测量结果一致。虚拟实验和参数扫描改变了生态和能量约束、爆发运动学(耦合与非耦合的转弯和前进运动)以及环境因素,如食物密度、食物速度和会聚限制。这些操作揭示了约束和环境如何塑造追逐动态、攻击成功率和中止率,从而为神经科学实验产生可证伪的预测。这些扫描确定了一组紧凑的约束——双目感知、爆发运动学中前进速度和转弯的耦合,以及运动和会聚的适度能量成本——这些约束足以使类似斑马鱼的捕猎行为出现。引人注目的是,这些行为出现在没有详细生物力学、流体动力学、电路真实性或从真实斑马鱼数据中进行模仿学习的最小代理中。总而言之,这项工作提供了一个关于斑马鱼捕猎的规范性解释,即能量成本和感觉益处之间的最佳平衡,突出了构建会聚和轨迹动态的权衡。我们建立了一个虚拟实验室,缩小了实验搜索空间,并生成关于行为和神经编码的可证伪预测。

🔬 方法详解

问题定义:现有方法在模拟斑马鱼幼虫捕猎行为时,往往需要复杂的生物力学、流体动力学模型,或者依赖大量的真实数据进行模仿学习。这些方法计算成本高昂,且难以揭示行为背后的基本原理,例如能量消耗和感觉收益之间的权衡。因此,需要一种更简洁、高效的方法来模拟斑马鱼幼虫的捕猎行为,并深入理解其背后的机制。

核心思路:论文的核心思路是利用深度强化学习训练一个基于循环神经网络(RNN)的智能体,使其在简化的斑马鱼模拟器中学习捕猎策略。通过奖励智能体成功捕获猎物,并惩罚其能量消耗,智能体能够学习到在生态和能量约束下的最优行为策略。这种方法避免了复杂的生物力学建模和大量真实数据的需求,能够更清晰地揭示捕猎行为背后的基本原理。

技术框架:整体框架包括一个斑马鱼模拟器和一个基于RNN的智能体。模拟器负责模拟斑马鱼幼虫和猎物的运动,并提供环境信息给智能体。智能体通过RNN处理环境信息,并输出控制斑马鱼运动的动作。强化学习算法(具体算法未知)用于训练智能体,使其最大化累积奖励。训练过程包括以下步骤:1) 初始化智能体和环境;2) 智能体根据当前状态选择动作;3) 模拟器执行动作,更新环境状态;4) 计算奖励;5) 使用强化学习算法更新智能体策略;6) 重复步骤2-5,直到训练收敛。

关键创新:该论文的关键创新在于使用深度强化学习和RNN来模拟斑马鱼幼虫的捕猎行为,并在简化的模型中重现了真实的生物行为。与传统的基于规则或模仿学习的方法相比,该方法能够自动学习最优策略,并揭示生态和能量约束对行为的影响。此外,该论文还通过虚拟实验和参数扫描,研究了不同因素对捕猎行为的影响,为神经科学实验提供了可证伪的预测。

关键设计:智能体使用RNN来处理时间序列信息,捕捉斑马鱼幼虫的运动状态和猎物的位置信息。奖励函数的设计至关重要,需要平衡捕获猎物的奖励和能量消耗的惩罚。具体的RNN结构、强化学习算法和超参数设置未知,但论文强调了双目感知、运动耦合和能量成本的重要性。参数扫描实验中,研究了食物密度、食物速度和会聚限制等因素对捕猎行为的影响。

🖼️ 关键图片

📊 实验亮点

该模型成功重现了斑马鱼幼虫的标志性捕猎行为,包括与眼睛会聚相关的追逐、速度调节和刻板的接近轨迹。定量轨迹分析表明,追逐爆发系统地将猎物角度在攻击前减少大约一半,这与测量结果一致。虚拟实验表明,双目感知、运动耦合和能量成本是斑马鱼幼虫捕猎行为的关键约束。

🎯 应用场景

该研究成果可应用于生物行为建模、人工智能和机器人控制等领域。通过模拟生物的捕猎行为,可以更好地理解生物的认知和运动机制。此外,该方法还可以用于开发更智能的机器人,使其能够在复杂环境中自主完成任务,例如搜索、救援和侦察。

📄 摘要(原文)

Larval zebrafish hunting provides a tractable setting to study how ecological and energetic constraints shape adaptive behavior in both biological brains and artificial agents. Here we develop a minimal agent-based model, training recurrent policies with deep reinforcement learning in a bout-based zebrafish simulator. Despite its simplicity, the model reproduces hallmark hunting behaviors -- including eye vergence-linked pursuit, speed modulation, and stereotyped approach trajectories -- that closely match real larval zebrafish. Quantitative trajectory analyses show that pursuit bouts systematically reduce prey angle by roughly half before strike, consistent with measurements. Virtual experiments and parameter sweeps vary ecological and energetic constraints, bout kinematics (coupled vs. uncoupled turns and forward motion), and environmental factors such as food density, food speed, and vergence limits. These manipulations reveal how constraints and environments shape pursuit dynamics, strike success, and abort rates, yielding falsifiable predictions for neuroscience experiments. These sweeps identify a compact set of constraints -- binocular sensing, the coupling of forward speed and turning in bout kinematics, and modest energetic costs on locomotion and vergence -- that are sufficient for zebrafish-like hunting to emerge. Strikingly, these behaviors arise in minimal agents without detailed biomechanics, fluid dynamics, circuit realism, or imitation learning from real zebrafish data. Taken together, this work provides a normative account of zebrafish hunting as the optimal balance between energetic cost and sensory benefit, highlighting the trade-offs that structure vergence and trajectory dynamics. We establish a virtual lab that narrows the experimental search space and generates falsifiable predictions about behavior and neural coding.