Improving Cooperation in Collaborative Embodied AI

作者: Hima Jacob Leven Suprabha, Laxmi Nag Laxminarayan Nagesh, Ajith Nair, Alvin Reuben Amal Selvaster, Ayan Khan, Raghuram Damarla, Sanju Hannah Samuel, Sreenithi Saravana Perumal, Titouan Puech, Venkataramireddy Marella, Vishal Sonar, Alessandro Suglia, Oliver Lemon

分类: cs.AI, cs.MA, cs.RO

发布日期: 2025-10-03

备注: In proceedings of UKCI 2025

💡 一句话要点

通过优化Prompt提升具身AI协作能力,实现更高效的多智能体交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 多智能体系统 大型语言模型 Prompt工程 协作式AI

📋 核心要点

- 现有具身AI协作框架在多智能体通信和任务协调方面存在效率瓶颈,需要更有效的协作策略。

- 论文提出通过优化Prompt工程,改进大型语言模型在多智能体系统中的应用,提升协作性能。

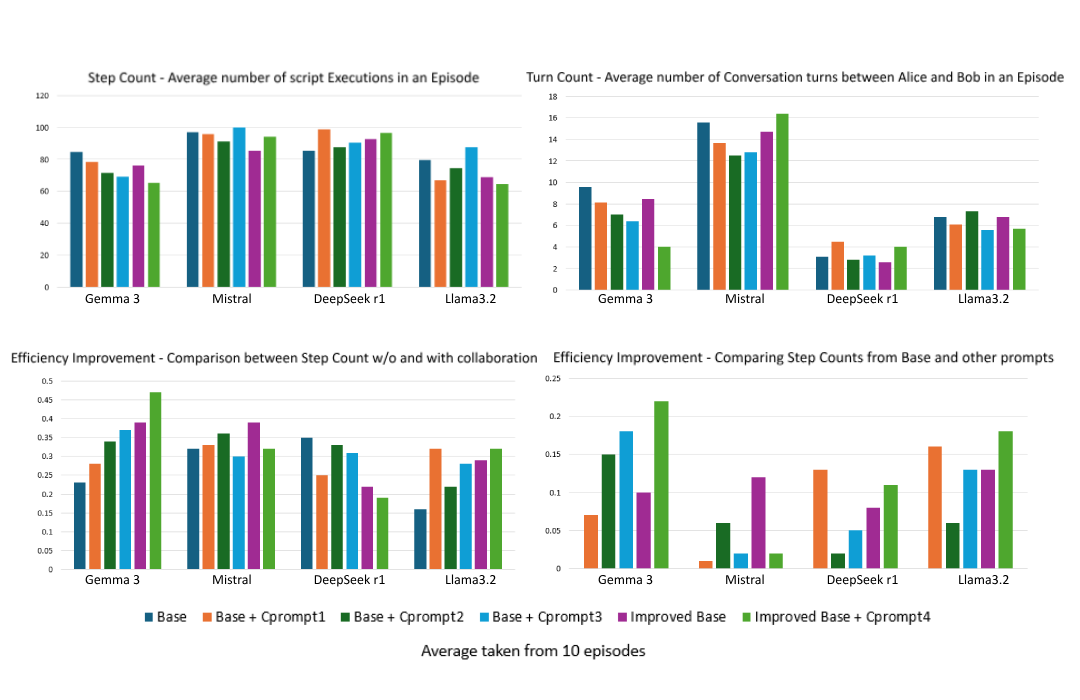

- 实验结果表明,优化的Prompt策略能够显著提升协作效率,例如Gemma3系统的效率提升了22%。

📝 摘要(中文)

本文研究了将大型语言模型(LLMs)集成到多智能体系统中,以探索AI智能体协作推理和合作的新可能性。论文改进了CoELA框架,该框架旨在构建协作式具身智能体,利用LLMs在共享虚拟空间中进行多智能体通信、推理和任务协调。通过系统的实验,研究人员检验了不同的LLMs和prompt工程策略,以确定最大化协作性能的优化组合。此外,研究通过集成语音功能扩展了研究范围,实现了无缝的基于语音的协作交互。研究结果表明,prompt优化能够有效提升协作智能体的性能;例如,最佳组合使Gemma3系统的效率比原始CoELA系统提高了22%。此外,语音集成为迭代系统开发和演示提供了一个更具吸引力的用户界面。

🔬 方法详解

问题定义:论文旨在解决多智能体协作环境中,如何有效利用大型语言模型(LLMs)提升智能体之间的通信、推理和任务协调效率的问题。现有方法在Prompt设计上存在不足,导致智能体协作效率低下,难以充分发挥LLMs的潜力。

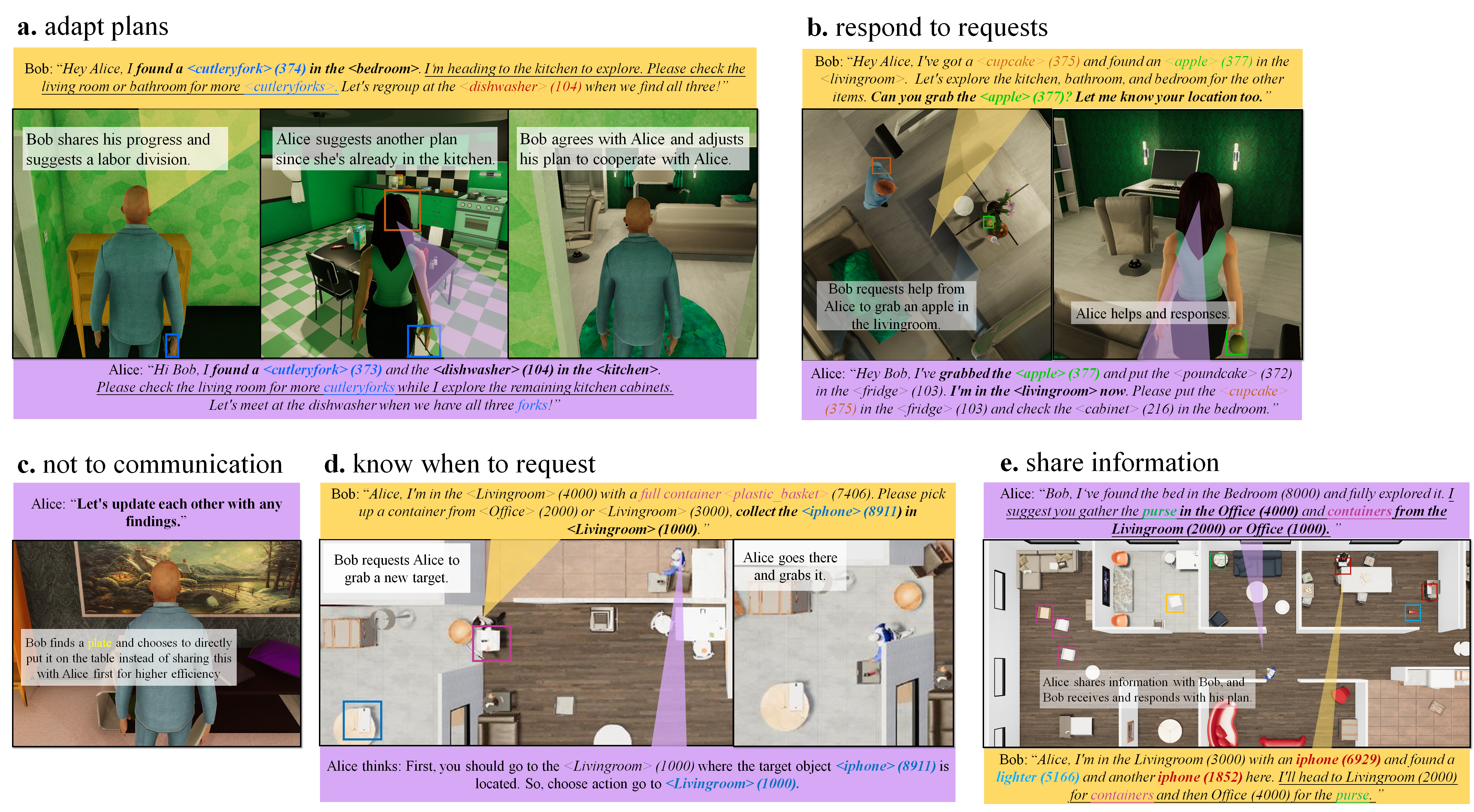

核心思路:论文的核心思路是通过优化Prompt工程,设计更有效的Prompt,引导LLMs更好地理解协作任务,并生成更准确、更有效的协作指令。通过精心设计的Prompt,可以提升智能体之间的沟通效率,减少歧义,从而提高整体协作性能。

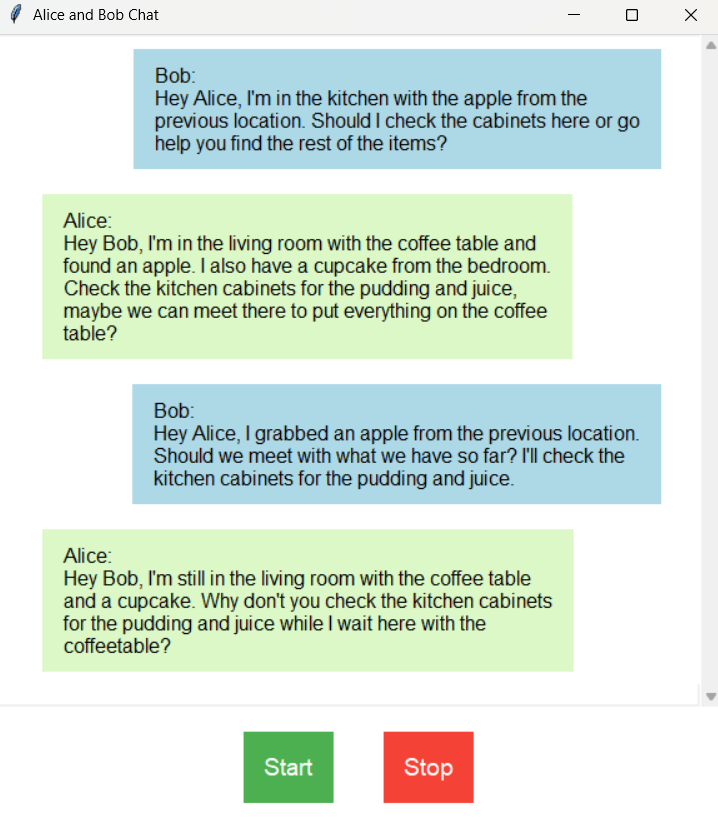

技术框架:论文基于CoELA框架进行改进,CoELA框架是一个用于构建协作式具身智能体的平台。主要流程包括:1) 定义协作任务;2) 设计不同的Prompt策略;3) 使用不同的LLMs进行实验;4) 评估协作性能;5) 集成语音功能,实现语音交互。框架的核心在于Prompt的设计和优化,以及LLMs的选择和配置。

关键创新:论文的关键创新在于系统性地研究了Prompt工程在多智能体协作中的作用,并提出了优化Prompt策略的方法。与现有方法相比,该方法更加注重Prompt的设计,通过实验验证了不同Prompt策略对协作性能的影响,并找到了最优的Prompt组合。此外,集成了语音功能,使得人机交互更加自然。

关键设计:论文的关键设计包括:1) 设计了多种Prompt模板,例如角色扮演、指令引导等;2) 针对不同的LLMs,调整Prompt的格式和内容;3) 使用BLEU、ROUGE等指标评估Prompt的质量;4) 通过A/B测试,比较不同Prompt策略的性能;5) 针对语音交互,设计了语音识别和语音合成模块。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过优化Prompt工程,Gemma3系统的协作效率比原始CoELA系统提高了22%。此外,集成的语音功能使得人机交互更加自然流畅,为迭代系统开发和演示提供了一个更具吸引力的用户界面。这些结果验证了Prompt优化在提升协作智能体性能方面的有效性。

🎯 应用场景

该研究成果可应用于协作机器人、智能家居、自动驾驶等领域。通过优化智能体之间的协作,可以提高任务完成效率,降低资源消耗,提升用户体验。未来,该技术有望应用于更复杂的协作场景,例如灾难救援、医疗辅助等。

📄 摘要(原文)

The integration of Large Language Models (LLMs) into multiagent systems has opened new possibilities for collaborative reasoning and cooperation with AI agents. This paper explores different prompting methods and evaluates their effectiveness in enhancing agent collaborative behaviour and decision-making. We enhance CoELA, a framework designed for building Collaborative Embodied Agents that leverage LLMs for multi-agent communication, reasoning, and task coordination in shared virtual spaces. Through systematic experimentation, we examine different LLMs and prompt engineering strategies to identify optimised combinations that maximise collaboration performance. Furthermore, we extend our research by integrating speech capabilities, enabling seamless collaborative voice-based interactions. Our findings highlight the effectiveness of prompt optimisation in enhancing collaborative agent performance; for example, our best combination improved the efficiency of the system running with Gemma3 by 22% compared to the original CoELA system. In addition, the speech integration provides a more engaging user interface for iterative system development and demonstrations.