Judging by Appearances? Auditing and Intervening Vision-Language Models for Bail Prediction

作者: Sagnik Basu, Shubham Prakash, Ashish Maruti Barge, Siddharth D Jaiswal, Abhisek Dash, Saptarshi Ghosh, Animesh Mukherjee

分类: cs.AI, cs.CY

发布日期: 2025-09-30

💡 一句话要点

提出基于视觉-语言模型的保释预测审计与干预方法,提升公平性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 保释预测 法律判决 公平性 偏见缓解 检索增强生成 模型审计

📋 核心要点

- 现有法律判决预测系统可能因利用罪犯图像而产生偏见,导致不公平的保释决策。

- 该论文提出通过检索增强生成(RAG)引入法律先例,并微调视觉-语言模型,以减轻偏见。

- 实验表明,所提出的干预算法显著提高了保释预测的性能,提升了模型的公平性。

📝 摘要(中文)

大型语言模型(LLMs)已被广泛应用于基于案件报告和犯罪历史的法律判决预测任务。然而,随着大型视觉语言模型(VLMs)的兴起,法律判决预测系统现在可以利用罪犯的图像以及文本案件报告/犯罪历史。以这种方式构建的应用程序可能会导致意想不到的后果,并可能被恶意使用。在这项工作中,我们进行了一项审计,以调查独立的VLM在保释决策预测任务中的效率。我们观察到,在多个交叉群体和模型中,性能都很差,并且 extit{错误地拒绝了有资格获得保释的个人的保释,且置信度非常高}。我们通过首先通过RAG管道包含法律先例,然后使用创新方案微调VLM来设计不同的干预算法。我们证明这些干预措施大大提高了保释预测的性能。我们的工作为未来在VLM上设计更智能的干预措施铺平了道路,然后才能将它们部署到现实世界的法律判决预测中。

🔬 方法详解

问题定义:论文关注的是视觉-语言模型(VLMs)在保释预测任务中的潜在偏见问题。现有方法仅依赖案件报告和犯罪历史等文本信息,而忽略了罪犯图像可能带来的偏见。直接使用VLM进行保释预测可能导致对特定群体的不公平待遇,例如错误地拒绝有资格获得保释的个人的保释,且置信度非常高。

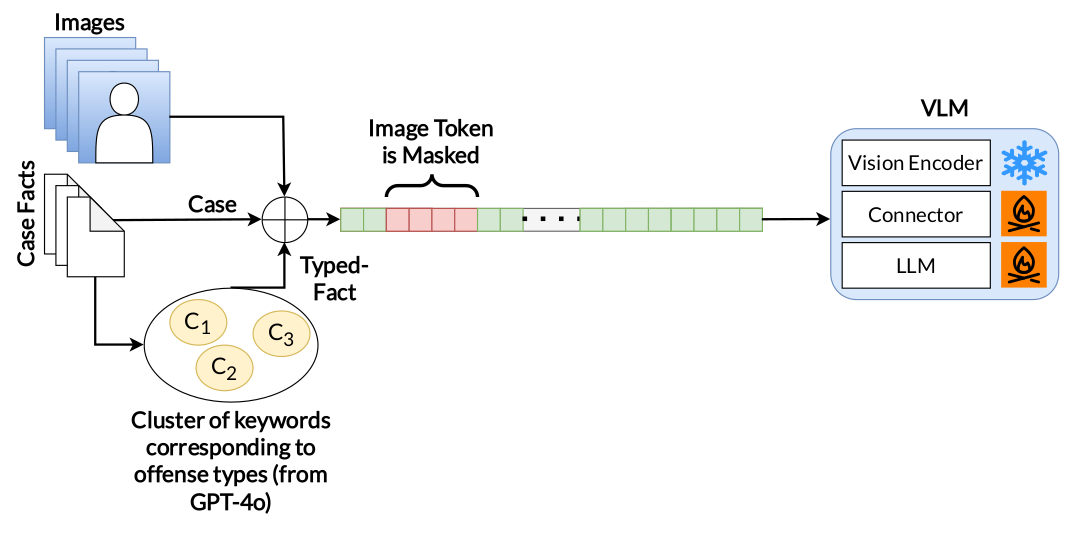

核心思路:论文的核心思路是通过引入法律先例来增强VLM的推理能力,并使用创新方案微调VLM,从而减轻模型中的偏见。具体来说,首先使用检索增强生成(RAG)管道将相关的法律先例注入到模型中,然后通过微调来优化模型的预测性能。

技术框架:整体框架包含以下几个主要阶段:1) 数据准备:收集包含罪犯图像、案件报告和犯罪历史的数据集。2) 法律先例检索:使用RAG管道,根据案件信息检索相关的法律先例。3) 模型干预:将检索到的法律先例作为上下文信息输入到VLM中。4) 模型微调:使用创新方案微调VLM,以优化保释预测性能。5) 性能评估:评估模型在不同交叉群体上的性能,以衡量公平性。

关键创新:论文的关键创新在于:1) 首次对VLM在保释预测任务中的偏见进行了审计。2) 提出了基于RAG和微调的干预算法,有效减轻了模型中的偏见。3) 设计了创新的微调方案,进一步提升了模型的预测性能和公平性。

关键设计:论文的关键设计包括:1) RAG管道的具体实现,包括检索策略和生成策略。2) 微调方案的设计,例如损失函数的选择和网络结构的调整。3) 性能评估指标的选择,例如准确率、召回率和公平性指标。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的干预算法显著提高了保释预测的性能。具体来说,通过引入法律先例和微调VLM,模型在多个交叉群体上的准确率和公平性指标均得到了显著提升。实验还表明,该方法能够有效减少模型对有资格获得保释的个人的错误拒绝率。

🎯 应用场景

该研究成果可应用于开发更公平、更可靠的法律判决预测系统。通过引入法律先例和减轻模型偏见,可以提高保释决策的准确性和公平性,减少对特定群体的歧视。此外,该研究提出的干预方法也可以推广到其他法律领域,例如量刑预测和案件分类。

📄 摘要(原文)

Large language models (LLMs) have been extensively used for legal judgment prediction tasks based on case reports and crime history. However, with a surge in the availability of large vision language models (VLMs), legal judgment prediction systems can now be made to leverage the images of the criminals in addition to the textual case reports/crime history. Applications built in this way could lead to inadvertent consequences and be used with malicious intent. In this work, we run an audit to investigate the efficiency of standalone VLMs in the bail decision prediction task. We observe that the performance is poor across multiple intersectional groups and models \textit{wrongly deny bail to deserving individuals with very high confidence}. We design different intervention algorithms by first including legal precedents through a RAG pipeline and then fine-tuning the VLMs using innovative schemes. We demonstrate that these interventions substantially improve the performance of bail prediction. Our work paves the way for the design of smarter interventions on VLMs in the future, before they can be deployed for real-world legal judgment prediction.