Uncovering Zero-Shot Generalization Gaps in Time-Series Foundation Models Using Real-World Videos

作者: Lujun Li, Lama Sleem, Yiqun Wang, Yangjie Xu, Niccolò Gentile, Radu State

分类: cs.AI

发布日期: 2025-09-30 (更新: 2025-11-28)

备注: This paper has been accepted by Artificial Intelligence for Time Series Analysis (AI4TS) Workshop @ AAAI 2026: Theory, Algorithms, and Applications

💡 一句话要点

提出REAL-V-TSFM数据集,揭示时序基础模型在真实视频数据上的泛化差距

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时序基础模型 零样本学习 泛化能力 真实世界视频 光流估计

📋 核心要点

- 现有时序基础模型数据集缺乏真实世界数据,过度依赖合成数据,导致模型泛化能力受限。

- 提出REAL-V-TSFM数据集,利用光流技术从真实视频中提取时序信号,模拟真实物理世界的动态变化。

- 实验表明,现有TSFMs在REAL-V-TSFM数据集上性能显著下降,揭示了模型在真实场景下的泛化差距。

📝 摘要(中文)

本文旨在解决时序基础模型(TSFMs)在真实世界数据上泛化能力不足的问题。现有数据集通常依赖合成数据,其泛化性备受争议。为此,我们提出了一种新的基准测试方法,构建了一个名为REAL-V-TSFM的数据集,该数据集通过光流技术从真实世界视频中提取时序信号,从而反映真实的物理时间动态。在零样本预测任务中,对最先进的TSFMs进行实验的结果表明,尽管这些模型在传统基准测试中表现出色,但在我们提出的数据集上性能下降,表明它们对新数据集的泛化能力有限。这些发现强调了获取时序数据的新方法的需求,并突出了现有TSFMs的通用性不足,同时也验证了我们基于视频的时序数据提取管道的有效性。

🔬 方法详解

问题定义:现有时序基础模型(TSFMs)在传统benchmark上表现良好,但这些benchmark往往包含大量合成数据,无法真实反映物理世界的复杂动态。因此,TSFMs在真实世界数据上的泛化能力受到质疑。论文旨在通过构建一个更贴近真实场景的数据集,来评估和揭示TSFMs的泛化差距。

核心思路:论文的核心思路是从真实世界的视频中提取时序信号,构建数据集。视频数据天然包含了丰富的物理动态信息,通过分析视频帧之间的变化,可以获得具有真实世界特征的时序数据。这种方法避免了合成数据的局限性,能够更准确地评估TSFMs的泛化能力。

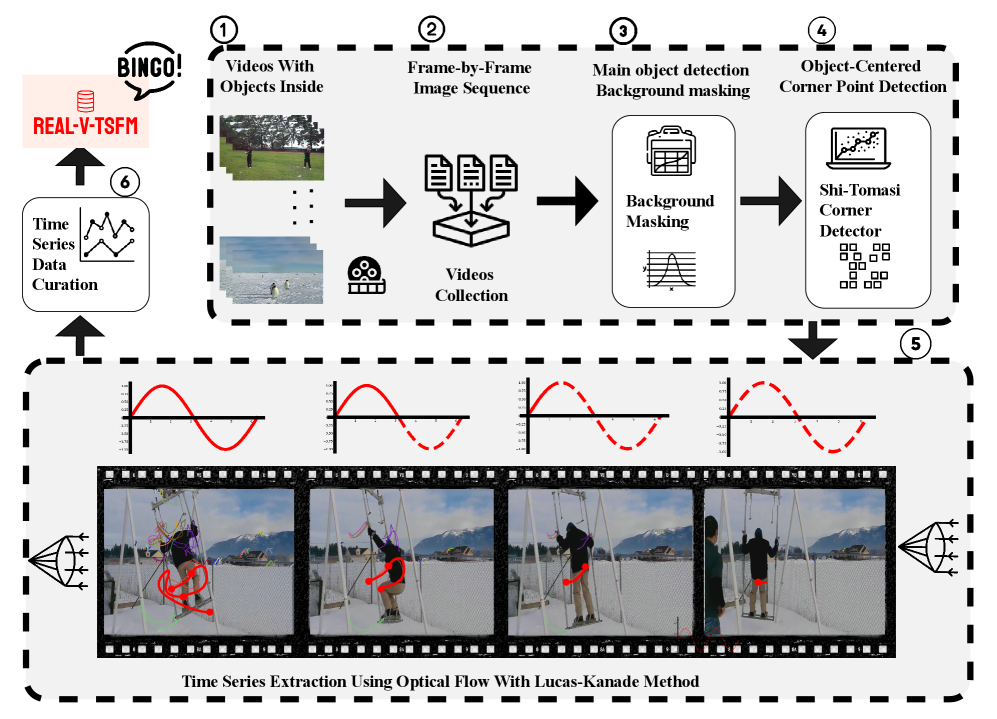

技术框架:整体流程包括:1) 收集真实世界视频数据;2) 使用光流算法提取视频帧之间的运动信息,得到光流场;3) 将光流场转换为时序信号,例如,可以统计光流的大小和方向的变化;4) 对提取的时序信号进行清洗和预处理,构建最终的REAL-V-TSFM数据集。该数据集可用于评估TSFMs在零样本预测等任务上的性能。

关键创新:论文的关键创新在于提出了一种新的时序数据获取方法,即从真实世界视频中提取时序信号。与传统的合成数据方法相比,这种方法能够更好地模拟真实世界的物理动态,从而更准确地评估TSFMs的泛化能力。此外,REAL-V-TSFM数据集的构建本身也是一项创新,为时序模型的研究提供了一个新的benchmark。

关键设计:在光流提取方面,可以选择不同的光流算法,例如Farnebäck算法或DeepFlow算法。在时序信号转换方面,可以根据具体的视频内容和任务需求,设计不同的转换方法。例如,可以统计光流大小的均值、方差、最大值、最小值等统计量,或者提取光流方向的直方图特征。此外,数据集的规模和多样性也是关键的设计因素,需要收集足够多的、涵盖不同场景的视频数据。

🖼️ 关键图片

📊 实验亮点

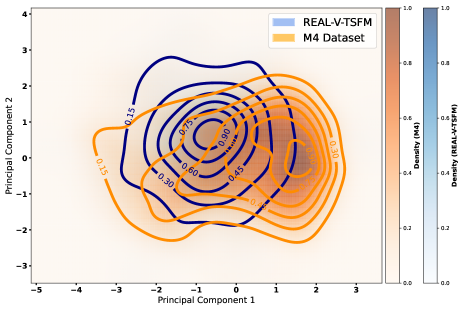

实验结果表明,尽管现有的TSFMs在传统benchmark上表现出色,但在REAL-V-TSFM数据集上的零样本预测性能显著下降。这一结果揭示了TSFMs在真实世界数据上的泛化差距,并验证了REAL-V-TSFM数据集作为评估TSFMs泛化能力的有效性。

🎯 应用场景

该研究成果可应用于评估和改进时序基础模型在各种实际场景中的性能,例如机器人导航、自动驾驶、视频监控、工业控制等领域。通过使用REAL-V-TSFM数据集,可以更准确地评估模型在真实环境中的泛化能力,从而推动时序模型在实际应用中的发展。

📄 摘要(原文)

Recent research on time-series foundation models (TSFMs) has underscored the scarcity of real-world data, often supplemented with synthetic sources in existing datasets, whose generalizability remains however debated. As such, in this work, we propose a novel benchmarking approach: in particular, we aim at building a curated dataset reflecting real world physical temporal dynamics, extracting temporal signals from real-world videos using optical flow. As such, we introduce REAL-V-TSFM, a novel dataset designed to capture rich and diverse time series derived from real-world videos. Experimental results on state-of-the-art TSFMs under zero-shot forecasting show that, despite strong performance on conventional benchmarks, these models exhibit performance degradation on the proposed dataset, suggesting limited generalizability to novel datasets. These findings underscore the need for novel approaches to acquiring time series data and highlight the lack of universality in recent TSFMs, while further validating the effectiveness of our video-based time series data extraction pipeline.