CoLLM-NAS: Collaborative Large Language Models for Efficient Knowledge-Guided Neural Architecture Search

作者: Zhe Li, Zhiwei Lin, Yongtao Wang

分类: cs.AI, cs.CV, cs.LG

发布日期: 2025-09-30

💡 一句话要点

提出CoLLM-NAS,利用协同大语言模型实现高效的知识引导神经架构搜索

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经架构搜索 大语言模型 自动化机器学习 知识引导 协同学习

📋 核心要点

- 现有基于大语言模型(LLM)的神经架构搜索(NAS)方法存在架构无效、计算低效和性能不足等问题。

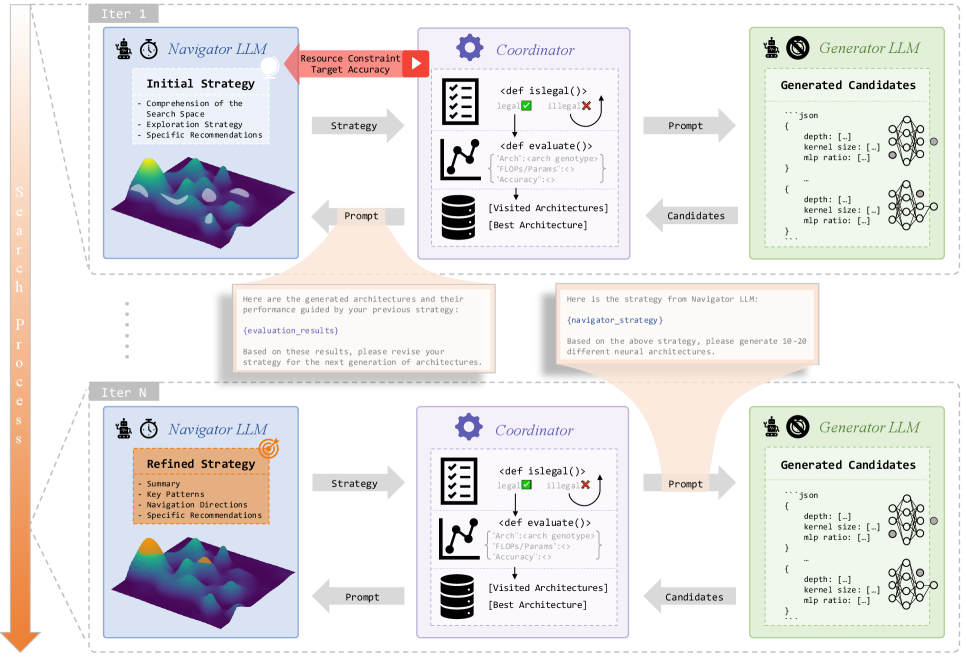

- CoLLM-NAS利用导航LLM指导搜索方向,生成器LLM合成高质量候选架构,并通过协调器模块管理它们之间的交互。

- 实验表明,CoLLM-NAS在ImageNet和NAS-Bench-201上超越了现有NAS方法,并在不同搜索空间中提升了多种两阶段NAS方法的性能。

📝 摘要(中文)

本文提出了一种基于协同大语言模型(LLM)的神经架构搜索(NAS)框架CoLLM-NAS,旨在解决现有方法中存在的架构无效、计算效率低下以及性能不如传统NAS等问题。CoLLM-NAS是一个两阶段的NAS框架,由两个互补的LLM驱动,进行知识引导搜索。具体来说,提出了一个导航LLM来指导搜索方向,以及一个生成器LLM来合成高质量的候选架构,并使用一个专门的协调器模块来管理它们的交互。CoLLM-NAS通过结合LLM固有的结构化神经架构知识以及来自迭代反馈和历史轨迹的渐进知识,有效地指导搜索过程。在ImageNet和NAS-Bench-201上的实验结果表明,CoLLM-NAS超越了现有的NAS方法和传统搜索算法,取得了新的state-of-the-art结果。此外,CoLLM-NAS持续提升了各种两阶段NAS方法(例如,OFA、SPOS和AutoFormer)在不同搜索空间(例如,MobileNet、ShuffleNet和AutoFormer)上的性能和效率,展示了其出色的泛化能力。

🔬 方法详解

问题定义:现有的基于LLM的NAS方法在生成有效的神经网络架构、计算效率以及最终性能方面存在局限性。许多方法生成的架构可能无效,搜索过程计算成本高昂,并且最终获得的架构性能往往不如传统的NAS方法。因此,如何利用LLM的知识来高效且有效地搜索高性能的神经网络架构是一个关键问题。

核心思路:CoLLM-NAS的核心思路是利用两个互补的LLM,一个负责导航搜索方向(Navigator LLM),另一个负责生成高质量的候选架构(Generator LLM),并通过一个协调器模块(Coordinator)来管理它们的交互。这种协同工作的方式旨在结合LLM的结构化知识和迭代反馈,从而更有效地指导搜索过程。

技术框架:CoLLM-NAS是一个两阶段的NAS框架。第一阶段,Navigator LLM根据历史搜索轨迹和反馈,预测有希望的搜索方向。第二阶段,Generator LLM根据Navigator LLM的指导,生成具体的候选架构。Coordinator模块负责管理两个LLM之间的交互,并根据验证结果更新搜索轨迹。整个框架通过迭代这两个阶段,逐步优化搜索过程。

关键创新:CoLLM-NAS的关键创新在于协同使用两个LLM,并引入Coordinator模块来管理它们的交互。Navigator LLM利用历史信息来指导搜索方向,Generator LLM负责生成具体的架构,这种分工合作的方式能够更有效地利用LLM的知识。此外,Coordinator模块通过反馈机制,不断优化搜索过程,提高了搜索效率和性能。

关键设计:Navigator LLM和Generator LLM的具体实现可以采用不同的LLM模型,例如GPT系列。Coordinator模块的设计需要考虑如何有效地将Navigator LLM的输出转化为Generator LLM的输入,以及如何根据验证结果更新搜索轨迹。损失函数的设计需要考虑如何平衡搜索效率和性能,例如可以使用基于验证集性能的奖励函数来指导搜索过程。具体的参数设置需要根据不同的搜索空间和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

CoLLM-NAS在ImageNet和NAS-Bench-201上取得了显著的性能提升。在ImageNet上,CoLLM-NAS超越了现有的NAS方法,取得了新的state-of-the-art结果。在NAS-Bench-201上,CoLLM-NAS也优于传统的搜索算法。此外,CoLLM-NAS还能够持续提升各种两阶段NAS方法在不同搜索空间上的性能和效率,展示了其出色的泛化能力。

🎯 应用场景

CoLLM-NAS具有广泛的应用前景,可以应用于图像识别、目标检测、自然语言处理等多个领域。它可以自动化地设计高性能的神经网络架构,降低了人工设计的成本和难度。此外,CoLLM-NAS还可以应用于边缘计算设备,通过搜索轻量级的神经网络架构,提高设备的计算效率和能效。未来,CoLLM-NAS有望成为一种通用的神经网络架构搜索工具,推动人工智能技术的发展。

📄 摘要(原文)

The integration of Large Language Models (LLMs) with Neural Architecture Search (NAS) has introduced new possibilities for automating the design of neural architectures. However, most existing methods face critical limitations, including architectural invalidity, computational inefficiency, and inferior performance compared to traditional NAS. In this work, we present Collaborative LLM-based NAS (CoLLM-NAS), a two-stage NAS framework with knowledge-guided search driven by two complementary LLMs. Specifically, we propose a Navigator LLM to guide search direction and a Generator LLM to synthesize high-quality candidates, with a dedicated Coordinator module to manage their interaction. CoLLM-NAS efficiently guides the search process by combining LLMs' inherent knowledge of structured neural architectures with progressive knowledge from iterative feedback and historical trajectory. Experimental results on ImageNet and NAS-Bench-201 show that CoLLM-NAS surpasses existing NAS methods and conventional search algorithms, achieving new state-of-the-art results. Furthermore, CoLLM-NAS consistently enhances the performance and efficiency of various two-stage NAS methods (e.g., OFA, SPOS, and AutoFormer) across diverse search spaces (e.g., MobileNet, ShuffleNet, and AutoFormer), demonstrating its excellent generalization.