Galton's Law of Mediocrity: Why Large Language Models Regress to the Mean and Fail at Creativity in Advertising

作者: Matt Keon, Aabid Karim, Bhoomika Lohana, Abdul Karim, Thai Nguyen, Tara Hamilton, Ali Abbas

分类: cs.AI

发布日期: 2025-09-30

💡 一句话要点

揭示大语言模型在广告创意中趋于平庸的“高尔顿定律”现象

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 创造力 广告创意 高尔顿回归平均 文本生成

📋 核心要点

- 现有大语言模型在创意任务中表现平庸,缺乏深度和独特性,难以胜任广告等领域。

- 论文将此现象形式化为“高尔顿回归平均”,模型倾向于高概率、安全通用的表达,忽略创造性特征。

- 实验表明,简化输入会导致创造性元素快速消失,而模型难以从简化输入中恢复原始文本的创造深度。

📝 摘要(中文)

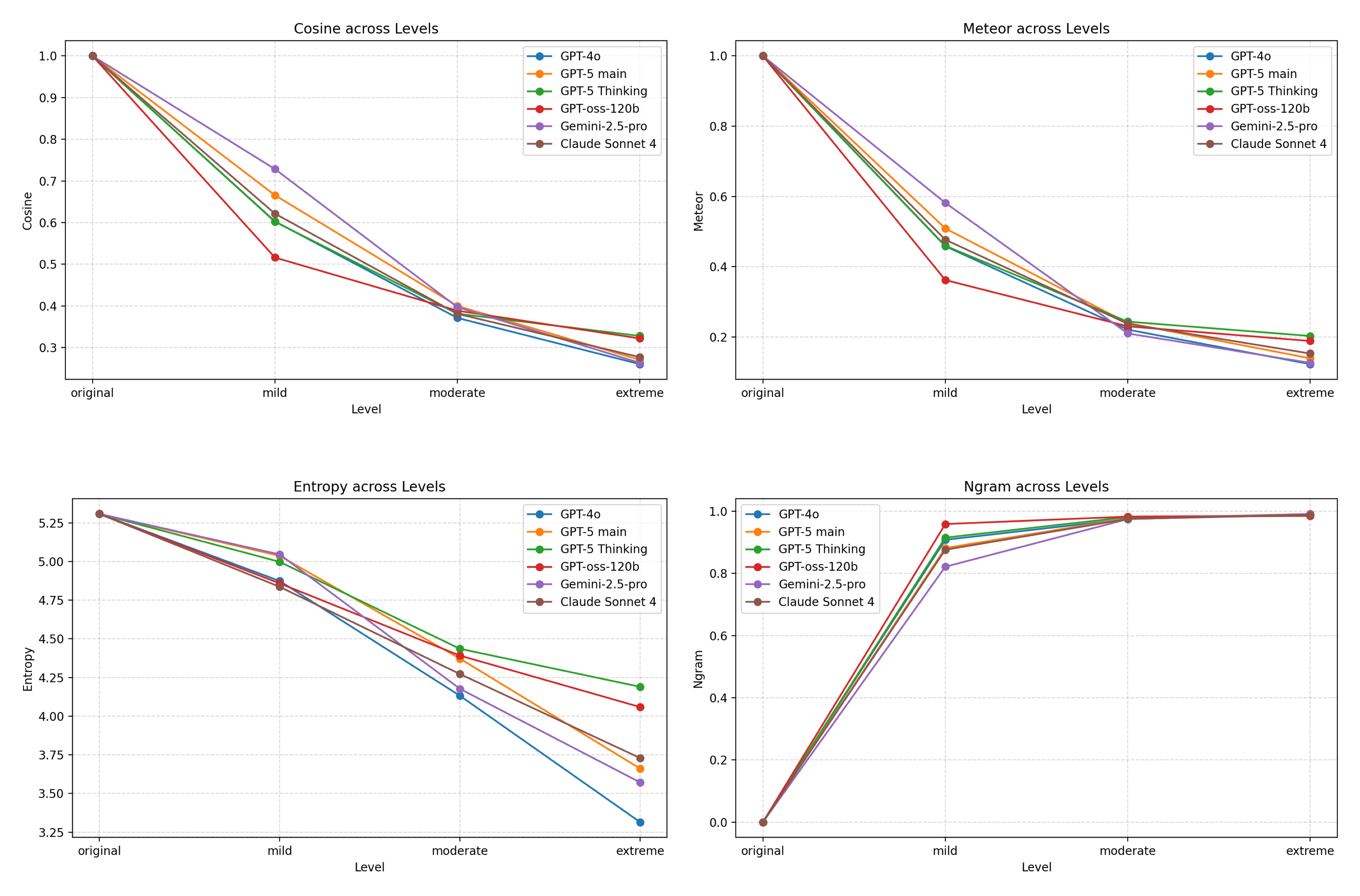

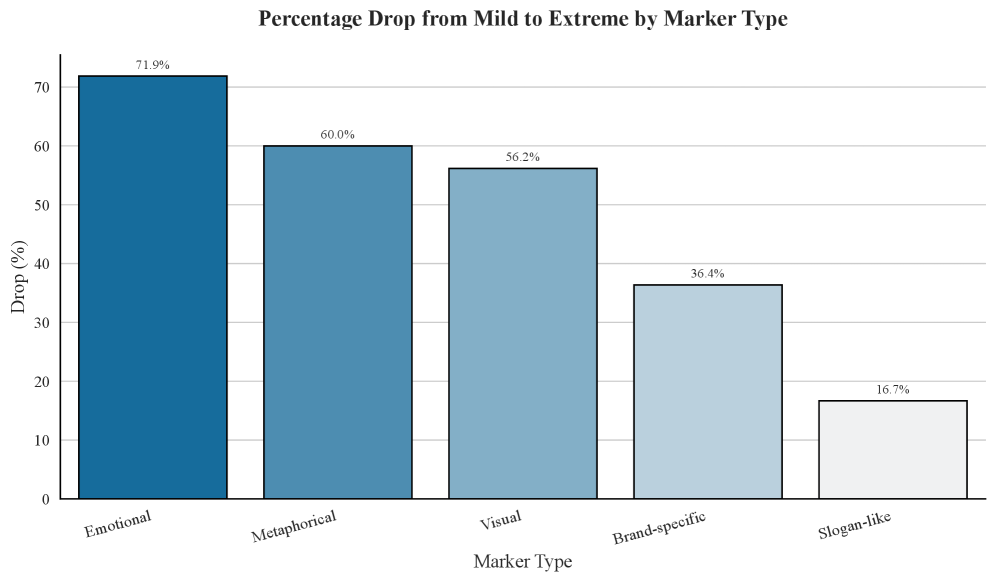

大型语言模型(LLMs)能够生成流畅的文本,但常常倾向于安全、通用的表达方式,这引发了对其创造力能力的质疑。本文将这种趋势形式化为语言中的一种高尔顿式的回归平均现象,并通过广告概念中的创造力压力测试对其进行评估。当广告创意逐步简化时,隐喻、情感和视觉线索等创造性特征过早消失,而事实性内容得以保留,表明模型偏爱高概率信息。当要求从简化的输入中重新生成时,模型产生了更长的、词汇多样的输出,但未能恢复原始文本的深度和独特性。通过定量比较和定性分析相结合,发现重新生成的文本通常看起来新颖,但缺乏真正的原创性。提供广告特定的线索,如隐喻、情感钩子和视觉标记,可以改善对齐和风格平衡,但输出仍然依赖于熟悉的套路。总而言之,研究结果表明,如果没有有针对性的指导,LLMs在创造性任务中会趋于平庸;结构化信号可以部分抵消这种趋势,并为开发对创造力敏感的模型指明了方向。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在广告创意生成等创造性任务中表现出的“趋于平庸”的问题。现有方法生成的文本虽然流畅,但缺乏原创性、深度和独特性,难以满足实际应用需求。这种现象可以理解为模型倾向于生成高概率、安全通用的表达,而忽略了低概率但具有创造性的元素。

核心思路:论文的核心思路是将LLMs的这种“趋于平庸”的现象形式化为一种高尔顿式的回归平均现象。高尔顿回归平均指的是子代的特征会向群体平均值回归。在语言模型中,这意味着模型生成的文本会向其训练数据中的平均表达方式回归,从而导致创造性元素的丢失。

技术框架:论文采用了一种创造力压力测试框架,通过逐步简化广告创意,观察LLMs在生成过程中的表现。该框架包含以下几个主要阶段:1) 原始广告创意生成;2) 逐步简化广告创意,去除隐喻、情感和视觉线索等创造性特征;3) 从简化后的输入中重新生成广告创意;4) 对原始创意、简化创意和重新生成的创意进行定量和定性分析,评估LLMs的创造力表现。

关键创新:论文最重要的技术创新点在于将“高尔顿回归平均”的概念引入到对LLMs创造力的评估中。通过这种形式化的分析,论文揭示了LLMs在创造性任务中表现平庸的根本原因,并为改进LLMs的创造力提供了新的视角。

关键设计:论文的关键设计包括:1) 创造力压力测试框架的设计,通过逐步简化广告创意来评估LLMs的创造力;2) 定量分析指标的选择,包括词汇多样性、情感强度等;3) 定性分析方法的应用,通过人工评估来判断LLMs生成的文本是否具有真正的原创性;4) 实验中使用的广告数据集的选择,确保数据集具有足够的创造性和多样性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,当广告创意被简化时,隐喻、情感和视觉线索等创造性特征会过早消失,而事实性内容得以保留。从简化输入重新生成的文本虽然词汇多样性增加,但未能恢复原始文本的深度和独特性。提供广告特定线索(如隐喻)可以改善对齐和风格平衡,但输出仍依赖于熟悉的套路。这些结果量化了LLMs在创意任务中“高尔顿回归平均”的现象。

🎯 应用场景

该研究成果可应用于提升大语言模型在广告文案生成、剧本创作、艺术设计等创意领域的表现。通过理解模型趋于平庸的原因,可以设计更有效的干预策略,例如引入结构化信号或调整训练目标,从而激发模型的创造力,生成更具原创性和吸引力的内容。此外,该研究也为评估和改进其他类型AI系统的创造力提供了借鉴。

📄 摘要(原文)

Large language models (LLMs) generate fluent text yet often default to safe, generic phrasing, raising doubts about their ability to handle creativity. We formalize this tendency as a Galton-style regression to the mean in language and evaluate it using a creativity stress test in advertising concepts. When ad ideas were simplified step by step, creative features such as metaphors, emotions, and visual cues disappeared early, while factual content remained, showing that models favor high-probability information. When asked to regenerate from simplified inputs, models produced longer outputs with lexical variety but failed to recover the depth and distinctiveness of the originals. We combined quantitative comparisons with qualitative analysis, which revealed that the regenerated texts often appeared novel but lacked true originality. Providing ad-specific cues such as metaphors, emotional hooks and visual markers improved alignment and stylistic balance, though outputs still relied on familiar tropes. Taken together, the findings show that without targeted guidance, LLMs drift towards mediocrity in creative tasks; structured signals can partially counter this tendency and point towards pathways for developing creativity-sensitive models.