Modeling Others' Minds as Code

作者: Kunal Jha, Aydan Yuenan Huang, Eric Ye, Natasha Jaques, Max Kleiman-Weiner

分类: cs.AI, cs.LG

发布日期: 2025-09-29

💡 一句话要点

ROTE:利用程序合成高效预测人类行为,提升人机协作

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 行为建模 程序合成 人机协作 大型语言模型 概率推理

📋 核心要点

- 现有行为建模方法依赖大量数据,且对人类理性假设不切实际,或计算复杂度过高,难以快速适应。

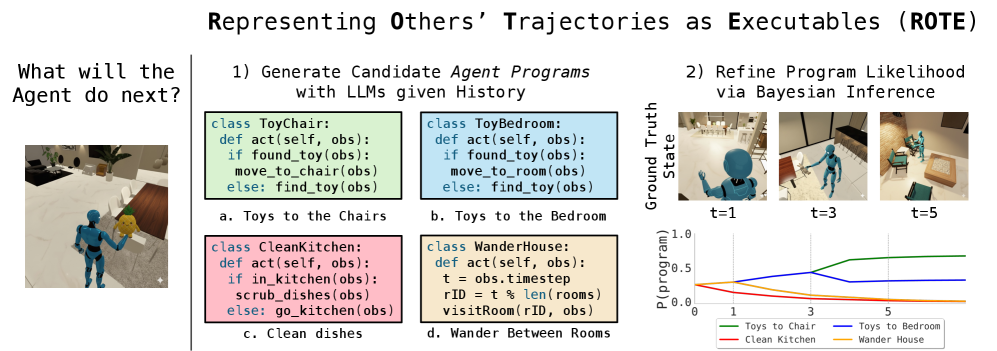

- ROTE将人类行为建模为计算机代码程序,利用大型语言模型生成假设空间,并进行概率推理。

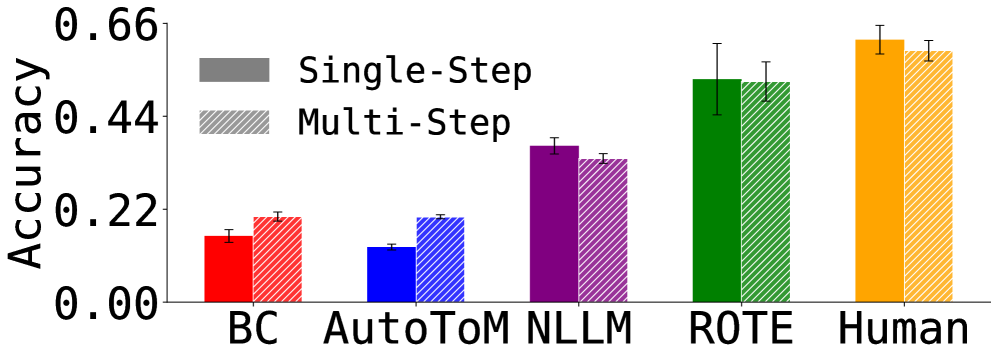

- 实验表明,ROTE在预测人类和AI行为方面,显著优于行为克隆和基于LLM的方法,提升高达50%。

📝 摘要(中文)

为了实现稳健且安全的人机协作,准确预测人类行为至关重要。然而,现有的人类行为建模方法通常需要大量数据且脆弱,因为它们要么对理性做出不切实际的假设,要么计算量过大而无法快速适应。本文的核心思想是,许多日常社交互动可能遵循可预测的模式,即高效的“脚本”,从而最大限度地减少参与者和观察者的认知负荷,例如“等待绿灯,然后前进”。我们提出将这些例程建模为计算机代码中实例化的行为程序,而不是以信念和愿望为条件的策略。我们介绍了一种名为ROTE的新算法,该算法利用大型语言模型(LLM)来合成行为程序的假设空间,并利用概率推理来推理该空间的不确定性。我们在一组网格世界任务和一个大型具身家庭模拟器中测试了ROTE。ROTE从稀疏的观察中预测人类和AI行为,在样本内准确性和样本外泛化方面,优于包括行为克隆和基于LLM的方法在内的竞争基线高达50%。通过将动作理解视为程序合成问题,ROTE为AI系统高效且有效地预测现实世界中的人类行为开辟了一条道路。

🔬 方法详解

问题定义:现有的人类行为建模方法,如基于强化学习或逆强化学习的方法,通常需要大量的训练数据才能学习到有效的策略。此外,这些方法往往假设人类是完全理性的,这在现实世界中并不成立。基于LLM的方法虽然可以生成合理的行为,但缺乏精确性和可解释性。因此,如何从少量观察数据中准确预测人类行为,并提高人机协作的效率和安全性,是一个重要的挑战。

核心思路:ROTE的核心思路是将人类行为理解为一个程序合成问题。它假设人类行为可以分解为一系列简单的、可预测的“脚本”,例如“如果看到红灯,则停车;如果看到绿灯,则前进”。这些脚本可以用计算机代码来表示,并且可以通过观察人类行为来学习。通过将行为建模为程序,ROTE可以利用程序合成技术来有效地搜索可能的行为模式,并从中选择最符合观察数据的程序。

技术框架:ROTE的整体框架包括以下几个主要模块:1) 行为程序生成器:使用大型语言模型(LLM)生成一系列可能的行为程序,这些程序描述了人类在特定环境中的行为方式。2) 概率推理引擎:使用概率推理来评估每个行为程序与观察数据的匹配程度。该引擎计算每个程序在给定观察数据下的后验概率。3) 行为预测器:根据后验概率选择最可能的行为程序,并使用该程序来预测未来的行为。

关键创新:ROTE最重要的技术创新点在于它将人类行为理解为一个程序合成问题,并利用大型语言模型和概率推理来解决这个问题。与传统的行为建模方法相比,ROTE不需要大量的训练数据,并且可以更好地处理人类行为的不确定性和非理性。此外,ROTE生成的行为程序具有可解释性,可以帮助我们理解人类行为的内在机制。

关键设计:ROTE的关键设计包括:1) 使用LLM(例如GPT-3)来生成行为程序,利用LLM的强大生成能力来探索更大的假设空间。2) 使用贝叶斯推理来更新行为程序的后验概率,根据观察数据不断优化行为预测。3) 定义合适的奖励函数来评估行为程序与观察数据的匹配程度,例如,可以使用行为克隆损失或交叉熵损失。

🖼️ 关键图片

📊 实验亮点

ROTE在网格世界任务和具身家庭模拟器中进行了评估。实验结果表明,ROTE在样本内准确性和样本外泛化方面,优于行为克隆和基于LLM的方法高达50%。这表明ROTE能够从稀疏的观察数据中有效地学习人类行为,并做出准确的预测。

🎯 应用场景

ROTE具有广泛的应用前景,例如:1) 机器人助手:ROTE可以帮助机器人理解人类的意图,并做出相应的反应,从而提高人机协作的效率和安全性。2) 自动驾驶:ROTE可以帮助自动驾驶汽车预测其他车辆和行人的行为,从而提高驾驶安全性。3) 游戏AI:ROTE可以用于创建更智能、更逼真的游戏AI,从而提高游戏体验。

📄 摘要(原文)

Accurate prediction of human behavior is essential for robust and safe human-AI collaboration. However, existing approaches for modeling people are often data-hungry and brittle because they either make unrealistic assumptions about rationality or are too computationally demanding to adapt rapidly. Our key insight is that many everyday social interactions may follow predictable patterns; efficient "scripts" that minimize cognitive load for actors and observers, e.g., "wait for the green light, then go." We propose modeling these routines as behavioral programs instantiated in computer code rather than policies conditioned on beliefs and desires. We introduce ROTE, a novel algorithm that leverages both large language models (LLMs) for synthesizing a hypothesis space of behavioral programs, and probabilistic inference for reasoning about uncertainty over that space. We test ROTE in a suite of gridworld tasks and a large-scale embodied household simulator. ROTE predicts human and AI behaviors from sparse observations, outperforming competitive baselines -- including behavior cloning and LLM-based methods -- by as much as 50% in terms of in-sample accuracy and out-of-sample generalization. By treating action understanding as a program synthesis problem, ROTE opens a path for AI systems to efficiently and effectively predict human behavior in the real-world.