Causal Autoencoder-like Generation of Feedback Fuzzy Cognitive Maps with an LLM Agent

作者: Akash Kumar Panda, Olaoluwa Adigun, Bart Kosko

分类: cs.AI, cs.CL, cs.HC, cs.IR

发布日期: 2025-09-29

备注: 8 pages, 4 figures

💡 一句话要点

提出基于LLM的因果模糊认知图自编码器,实现可解释的认知图重建。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 因果模糊认知图 自编码器 可解释AI 知识表示

📋 核心要点

- 传统自编码器(AE)是黑盒模型,缺乏可解释性,难以理解其内部决策过程。

- 利用大型语言模型(LLM)作为中介,将FCM转换为文本,再从文本重建FCM,实现可解释的自编码器。

- 该方法在保留强因果关系的前提下,实现了FCM的有损重建,并提供了人类可读的解释。

📝 摘要(中文)

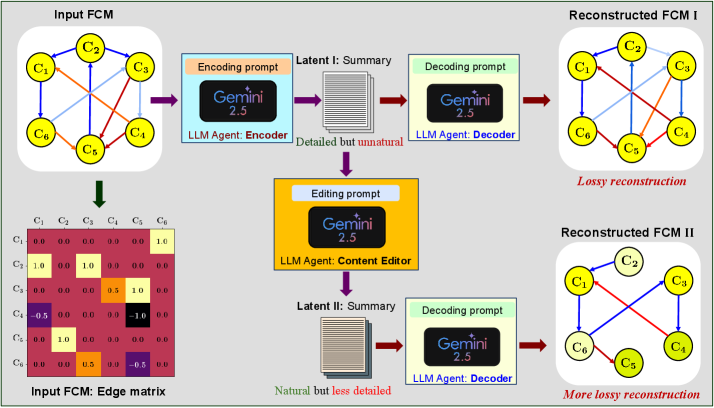

本文提出了一种利用大型语言模型(LLM)将反馈因果模糊认知图(FCM)映射到文本,然后从文本重建FCM的可解释AI系统。该系统近似于从FCM到自身的恒等映射,类似于自编码器(AE)的操作。与黑盒AE不同,编码器和解码器都解释了它们的决策。与AE中的隐藏变量和突触网络相比,人类可以阅读和解释编码的文本。LLM代理通过一系列不将输出与输入进行比较的系统指令来逼近恒等映射。重建是有损的,因为它移除了弱因果边或规则,同时保留了强因果边。即使编码器为了使文本听起来更自然而牺牲了关于FCM的一些细节,它仍然保留了强因果边。

🔬 方法详解

问题定义:现有的自编码器在处理因果模糊认知图(FCM)时,存在缺乏可解释性的问题。用户难以理解自编码器内部的决策过程,以及隐藏层变量的含义。此外,如何有效地从FCM中提取关键信息并进行重建也是一个挑战。

核心思路:本文的核心思路是利用大型语言模型(LLM)作为桥梁,将FCM转换为自然语言文本,然后利用LLM从文本重建FCM。这种方法将复杂的数值计算过程转化为人类可理解的文本描述,从而提高了模型的可解释性。同时,通过LLM的文本生成能力,可以实现对FCM的有损重建,保留关键的因果关系。

技术框架:该方法主要包含两个阶段:编码阶段和解码阶段。在编码阶段,LLM接收FCM作为输入,并将其转换为自然语言文本描述。这个过程可以看作是将FCM的结构和关系编码到文本中。在解码阶段,LLM接收编码后的文本描述,并尝试重建FCM。整个过程类似于自编码器的操作,但中间表示是人类可读的文本。

关键创新:该方法最重要的创新点在于利用LLM作为自编码器的中间层,实现了可解释的FCM重建。与传统的自编码器相比,该方法不仅能够重建FCM,还能够提供对重建过程的自然语言解释。此外,该方法还能够通过LLM的文本生成能力,实现对FCM的有损重建,保留关键的因果关系。

关键设计:该方法的关键设计在于如何设计LLM的输入和输出格式,以及如何训练LLM以实现有效的FCM编码和解码。具体来说,需要设计合适的prompt,指导LLM将FCM转换为自然语言文本,并从文本中提取FCM的结构和关系。此外,还需要选择合适的LLM模型,并对其进行微调,以提高其在FCM编码和解码任务上的性能。论文中并没有明确提及损失函数和网络结构等细节,这些可能是依赖于所使用的LLM模型。

🖼️ 关键图片

📊 实验亮点

该研究的主要亮点在于提出了基于LLM的可解释FCM自编码器框架。通过实验验证了该方法能够有效地重建FCM,并提供人类可读的解释。虽然摘要中没有提供具体的性能数据和对比基线,但强调了该方法在可解释性方面的优势。

🎯 应用场景

该研究成果可应用于知识图谱构建、决策支持系统、风险评估等领域。通过将复杂的因果关系网络转化为人类可理解的文本描述,可以提高决策的透明度和可信度。此外,该方法还可以用于教育领域,帮助学生理解复杂的系统和概念。

📄 摘要(原文)

A large language model (LLM) can map a feedback causal fuzzy cognitive map (FCM) into text and then reconstruct the FCM from the text. This explainable AI system approximates an identity map from the FCM to itself and resembles the operation of an autoencoder (AE). Both the encoder and the decoder explain their decisions in contrast to black-box AEs. Humans can read and interpret the encoded text in contrast to the hidden variables and synaptic webs in AEs. The LLM agent approximates the identity map through a sequence of system instructions that does not compare the output to the input. The reconstruction is lossy because it removes weak causal edges or rules while it preserves strong causal edges. The encoder preserves the strong causal edges even when it trades off some details about the FCM to make the text sound more natural.