Evaluating Foundation Models with Pathological Concept Learning for Kidney Cancer

作者: Shangqi Gao, Sihan Wang, Yibo Gao, Boming Wang, Xiahai Zhuang, Anne Warren, Grant Stewart, James Jones, Mireia Crispin-Ortuzar

分类: cs.AI

发布日期: 2025-09-29

备注: Best Paper Award at MICCAI AMAI 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于病理概念学习的肾癌评估方法,利用基础模型提升生存分析效果。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 肾癌 病理图像分析 基础模型 图神经网络 生存分析 病理概念学习 空间关系建模 深度学习

📋 核心要点

- 现有方法难以有效利用病理图像中的空间信息和病理概念进行肾癌风险评估。

- 利用基础模型提取病理图像特征,构建病理图捕捉空间关系,并学习病理概念。

- 实验表明,该方法在肾癌生存分析中表现出色,并具有良好的可解释性和公平性。

📝 摘要(中文)

本文提出了一种基于病理概念学习的方法,用于评估基础模型在肾癌领域的转化能力。该方法利用TNM分期指南和病理报告,构建了全面的肾癌病理概念。然后,利用基础模型从全切片图像中提取深度特征,构建病理图以捕捉空间相关性,并训练图神经网络来识别这些概念。最后,通过肾癌生存分析验证了该方法的有效性,突出了其在识别低风险和高风险患者方面的可解释性和公平性。源代码已在https://github.com/shangqigao/RadioPath发布。

🔬 方法详解

问题定义:论文旨在解决肾癌生存分析中,如何有效利用病理图像信息,特别是空间关系和病理概念的问题。现有方法通常难以充分利用这些信息,导致风险评估的准确性和可解释性不足。

核心思路:论文的核心思路是利用基础模型提取病理图像的深度特征,然后构建病理图来显式地建模肿瘤细胞之间的空间关系,并通过图神经网络学习和识别与肾癌预后相关的病理概念。这种方法旨在更全面地理解病理图像,并提高生存分析的准确性和可解释性。

技术框架:整体框架包括以下几个主要阶段:1) 特征提取:使用预训练的基础模型(如CLIP、DINO)从全切片图像(WSI)中提取深度特征。2) 病理图构建:基于提取的特征,构建病理图,其中节点代表图像块,边代表图像块之间的空间关系。3) 图神经网络训练:使用图神经网络(GNN)在病理图上进行训练,以识别与肾癌预后相关的病理概念。4) 生存分析:利用GNN学习到的病理概念,进行肾癌生存分析,预测患者的风险等级。

关键创新:论文的关键创新在于将基础模型与图神经网络相结合,用于病理图像的分析。通过病理图显式地建模空间关系,并利用GNN学习病理概念,从而提高了生存分析的准确性和可解释性。此外,利用TNM分期指南和病理报告构建病理概念,使得模型能够学习到与临床相关的知识。

关键设计:在病理图构建方面,论文可能采用了基于空间距离的邻接矩阵构建方法,例如k近邻算法。GNN的具体结构可能采用了图卷积网络(GCN)或图注意力网络(GAT)。损失函数可能包括交叉熵损失或生存分析相关的损失函数(如Cox比例风险模型)。具体的超参数设置(如学习率、batch size、GNN层数等)未知,可能需要根据实验进行调整。

🖼️ 关键图片

📊 实验亮点

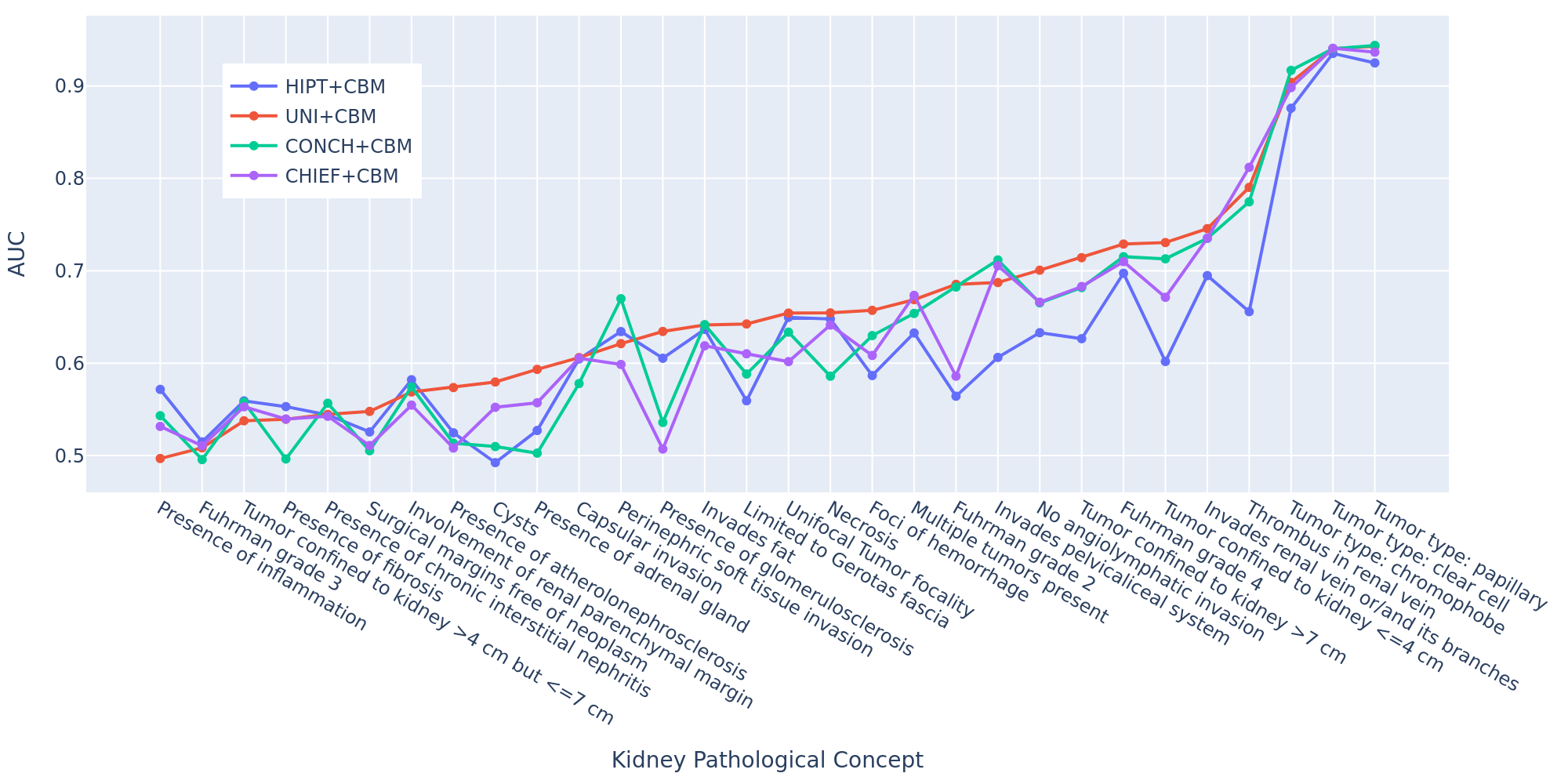

该研究通过实验验证了所提出的病理概念学习方法在肾癌生存分析中的有效性。具体性能数据未知,但摘要强调了该方法在识别低风险和高风险患者方面的可解释性和公平性。与传统方法相比,该方法能够更好地利用病理图像中的空间信息和病理概念,从而提高生存分析的准确性。

🎯 应用场景

该研究成果可应用于肾癌的辅助诊断和预后评估,帮助医生更准确地判断患者的风险等级,制定个性化的治疗方案。此外,该方法还可以推广到其他癌症类型的病理图像分析,具有广阔的应用前景。未来,可以进一步探索如何将多模态数据(如基因组数据、影像组学数据)融入到模型中,以提高预测的准确性。

📄 摘要(原文)

To evaluate the translational capabilities of foundation models, we develop a pathological concept learning approach focused on kidney cancer. By leveraging TNM staging guidelines and pathology reports, we build comprehensive pathological concepts for kidney cancer. Then, we extract deep features from whole slide images using foundation models, construct pathological graphs to capture spatial correlations, and trained graph neural networks to identify these concepts. Finally, we demonstrate the effectiveness of this approach in kidney cancer survival analysis, highlighting its explainability and fairness in identifying low- and high-risk patients. The source code has been released by https://github.com/shangqigao/RadioPath.