Toxicity in Online Platforms and AI Systems: A Survey of Needs, Challenges, Mitigations, and Future Directions

作者: Smita Khapre, Melkamu Abay Mersha, Hassan Shakil, Jonali Baruah, Jugal Kalita

分类: cs.CY, cs.AI, cs.CL, cs.HC, cs.SI

发布日期: 2025-09-29

DOI: 10.1016/j.eswa.2025.129832

💡 一句话要点

构建在线平台和AI系统毒性全面分类体系,旨在促进毒性检测与缓解方案设计。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 在线平台毒性 人工智能系统 毒性检测 毒性缓解 大型语言模型 毒性分类 综述研究

📋 核心要点

- 现有毒性检测与缓解研究主要集中于对已发生毒性行为的被动反应,缺乏对毒性的全面理解和主动预防。

- 论文旨在构建一个全面的毒性分类体系,从不同角度理解毒性,并考虑人工智能时代社会面临的背景和环境。

- 论文总结了毒性相关数据集和研究,并指出了毒性缓解方面在数据集、策略、模型、适应性等方面的研究差距。

📝 摘要(中文)

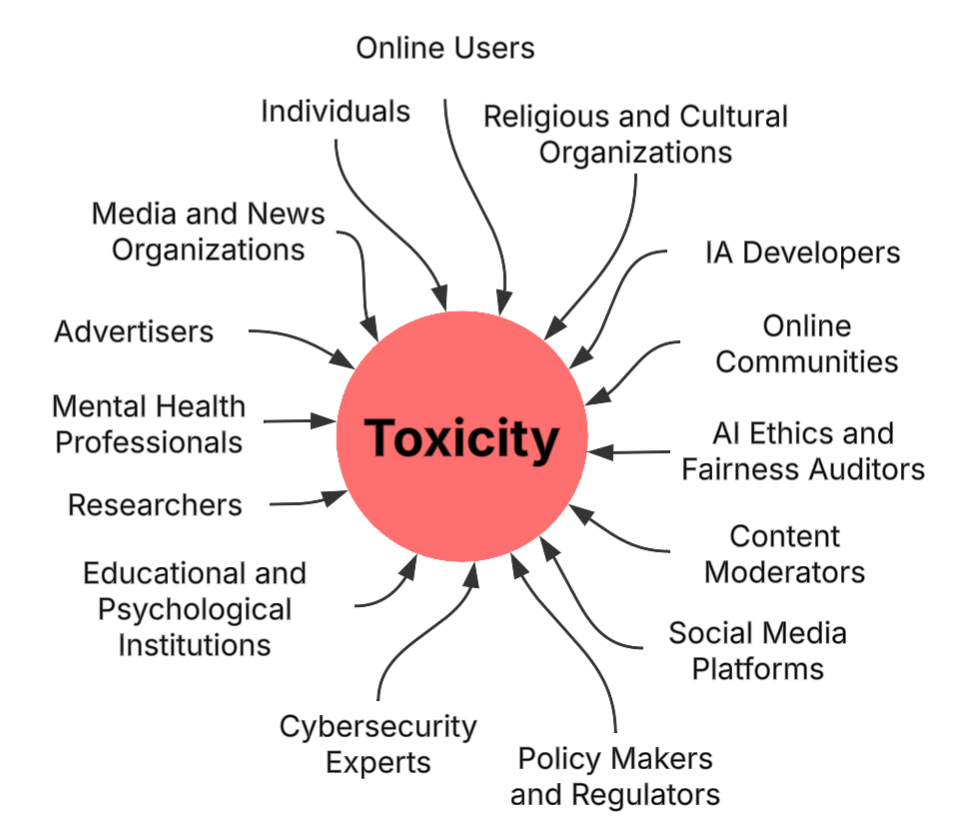

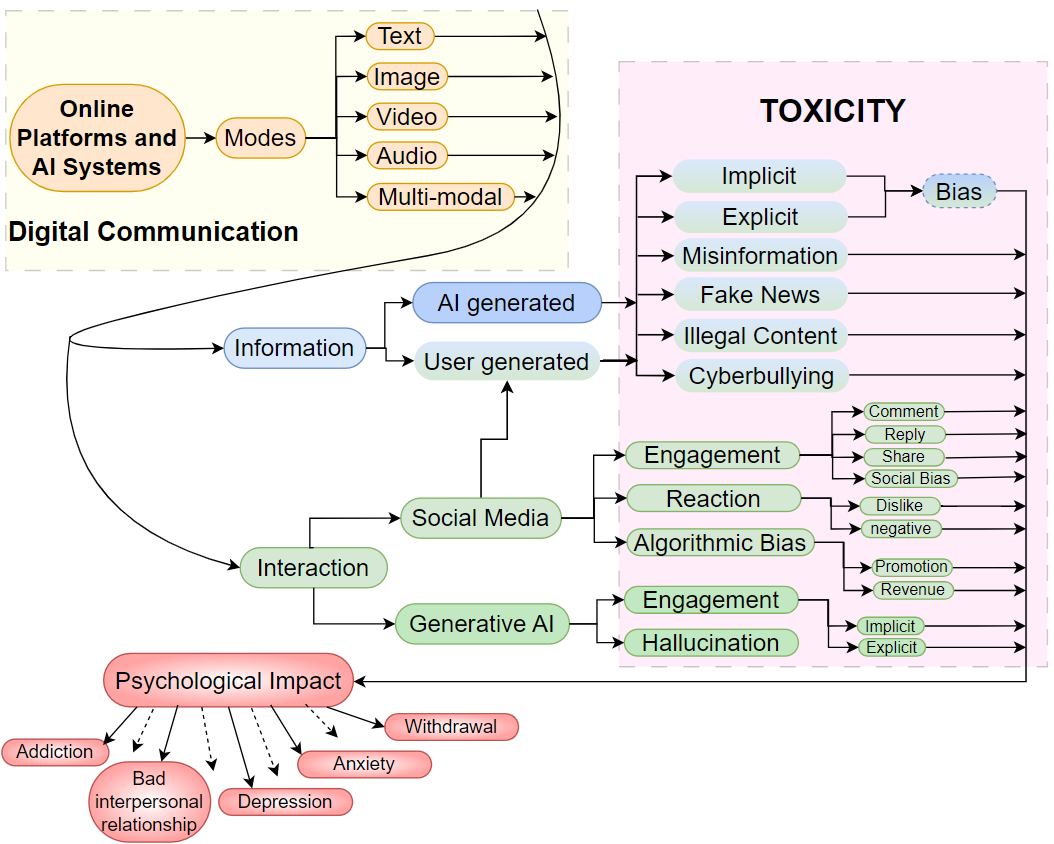

数字通信系统和在线平台的设计在无意中助长了有害行为的传播,引发了对这些行为的反应。在线内容和人工智能系统中的毒性已成为全球个人和集体福祉面临的严峻挑战,其危害程度远超我们的认知。毒性可以通过语言、图像和视频等形式表达,并且其含义会因使用环境而异。因此,建立一个全面的毒性分类体系对于主动检测和缓解在线内容、人工智能系统和/或大型语言模型中的毒性至关重要。对毒性的全面理解有助于设计实用的毒性检测和缓解方案。已发表的文献中的分类仅关注这一复杂问题的有限几个方面,并且主要采取被动的应对策略。本综述旨在从不同角度生成一个全面的毒性分类体系,并提出一种整体方法,通过理解人工智能时代社会面临的背景和环境来解释毒性。本综述总结了与毒性相关的数据集以及针对大型语言模型、社交媒体平台和其他在线平台的毒性检测和缓解研究,详细介绍了它们在文本模式下的属性,主要关注英语。最后,我们根据数据集、缓解策略、大型语言模型、适应性、可解释性和评估等方面,提出了毒性缓解方面的研究差距。

🔬 方法详解

问题定义:论文旨在解决在线平台和人工智能系统中日益严重的毒性问题。现有方法主要集中于对已发生毒性行为的被动反应,缺乏对毒性的全面理解和主动预防。此外,现有分类体系通常只关注毒性的有限几个方面,无法全面捕捉毒性的复杂性和多样性。

核心思路:论文的核心思路是构建一个全面的毒性分类体系,从不同角度理解毒性,并考虑人工智能时代社会面临的背景和环境。通过对毒性的全面理解,可以设计出更有效的毒性检测和缓解方案,从而主动预防毒性行为的发生。

技术框架:论文采用综述的形式,对现有文献进行系统性的梳理和分析。主要包括以下几个阶段:1) 定义毒性的概念和范围;2) 从不同角度对毒性进行分类,例如语言、图像、视频等;3) 总结与毒性相关的数据集和研究;4) 分析现有毒性检测和缓解方法的优缺点;5) 提出毒性缓解方面的研究差距。

关键创新:论文的主要创新在于提出了一个全面的毒性分类体系,该体系考虑了毒性的复杂性和多样性,并涵盖了不同类型的毒性表达形式。此外,论文还强调了主动预防毒性行为的重要性,并提出了未来研究方向。与现有方法相比,该论文更加注重对毒性的全面理解和主动预防。

关键设计:论文的关键设计在于其毒性分类体系,该体系需要根据不同类型的毒性表达形式进行细致的划分,并考虑不同环境下的毒性含义。此外,论文还需要对现有数据集和研究进行深入分析,才能准确地总结出毒性缓解方面的研究差距。具体的参数设置、损失函数、网络结构等技术细节取决于未来基于该综述进行的具体研究。

🖼️ 关键图片

📊 实验亮点

该综述论文的主要亮点在于:1) 提出了一个全面的毒性分类体系,为后续研究奠定了基础;2) 总结了与毒性相关的数据集和研究,方便研究人员快速了解该领域的研究进展;3) 指出了毒性缓解方面在数据集、策略、模型、适应性等方面的研究差距,为未来的研究方向提供了指导。

🎯 应用场景

该研究成果可应用于社交媒体平台、在线论坛、评论区等各种在线平台,以及聊天机器人、智能客服等人工智能系统。通过应用该研究提出的毒性分类体系和缓解策略,可以有效减少在线平台的毒性内容,提升用户体验,维护健康的网络环境,并促进人工智能系统的安全可靠发展。

📄 摘要(原文)

The evolution of digital communication systems and the designs of online platforms have inadvertently facilitated the subconscious propagation of toxic behavior. Giving rise to reactive responses to toxic behavior. Toxicity in online content and Artificial Intelligence Systems has become a serious challenge to individual and collective well-being around the world. It is more detrimental to society than we realize. Toxicity, expressed in language, image, and video, can be interpreted in various ways depending on the context of usage. Therefore, a comprehensive taxonomy is crucial to detect and mitigate toxicity in online content, Artificial Intelligence systems, and/or Large Language Models in a proactive manner. A comprehensive understanding of toxicity is likely to facilitate the design of practical solutions for toxicity detection and mitigation. The classification in published literature has focused on only a limited number of aspects of this very complex issue, with a pattern of reactive strategies in response to toxicity. This survey attempts to generate a comprehensive taxonomy of toxicity from various perspectives. It presents a holistic approach to explain the toxicity by understanding the context and environment that society is facing in the Artificial Intelligence era. This survey summarizes the toxicity-related datasets and research on toxicity detection and mitigation for Large Language Models, social media platforms, and other online platforms, detailing their attributes in textual mode, focused on the English language. Finally, we suggest the research gaps in toxicity mitigation based on datasets, mitigation strategies, Large Language Models, adaptability, explainability, and evaluation.