Flash-Searcher: Fast and Effective Web Agents via DAG-Based Parallel Execution

作者: Tianrui Qin, Qianben Chen, Sinuo Wang, He Xing, King Zhu, He Zhu, Dingfeng Shi, Xinxin Liu, Ge Zhang, Jiaheng Liu, Yuchen Eleanor Jiang, Xitong Gao, Wangchunshu Zhou

分类: cs.AI, cs.CL

发布日期: 2025-09-29

💡 一句话要点

Flash-Searcher:基于DAG并行执行的快速高效Web Agent

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agent推理 并行计算 有向无环图 动态工作流优化 大型语言模型 工具交互 Web Agent

📋 核心要点

- 现有Agent框架主要依赖顺序处理,导致在需要大量工具交互的复杂推理任务中效率低下。

- Flash-Searcher将任务分解为带有依赖关系的子任务,构建DAG图,实现并行推理,并通过动态优化工作流提升效率。

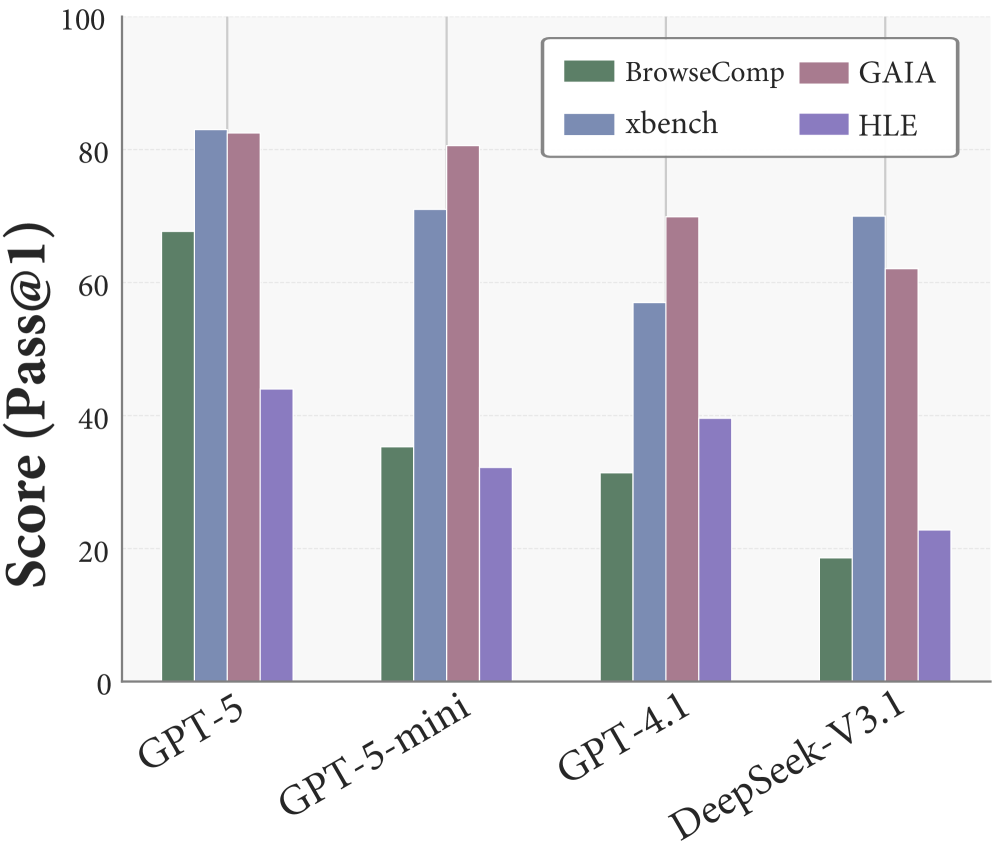

- 实验表明,Flash-Searcher在BrowseComp和xbench-DeepSearch上分别达到67.7%和83%的准确率,执行步骤减少高达35%。

📝 摘要(中文)

大型语言模型(LLMs)在配备外部工具时,在复杂的推理任务中表现出了卓越的能力。然而,当前的框架主要依赖于顺序处理,导致执行效率低下,尤其是在需要大量工具交互的任务中。本文介绍了一种新的并行Agent推理框架Flash-Searcher,它从根本上将执行范式从顺序链重新构想为有向无环图(DAG)。Flash-Searcher将复杂的任务分解为具有显式依赖关系的子任务,从而能够并发执行独立的推理路径,同时保持逻辑约束。通过动态工作流优化,我们的框架基于中间结果不断改进执行图,有效地集成了摘要模块。在多个基准测试中的全面评估表明,Flash-Searcher始终优于现有方法。具体而言,它在BrowseComp上实现了67.7%的准确率,在xbench-DeepSearch上实现了83%的准确率,同时与当前框架相比,Agent执行步骤减少了高达35%。此外,当将这种并行推理管道提炼到单个模型中时,我们观察到各种骨干架构的性能都有显著提高,突显了我们方法论的通用性。因此,我们的工作代表了Agent架构设计的一个重大进步,为复杂的推理任务提供了一种更具可扩展性和效率的范式。

🔬 方法详解

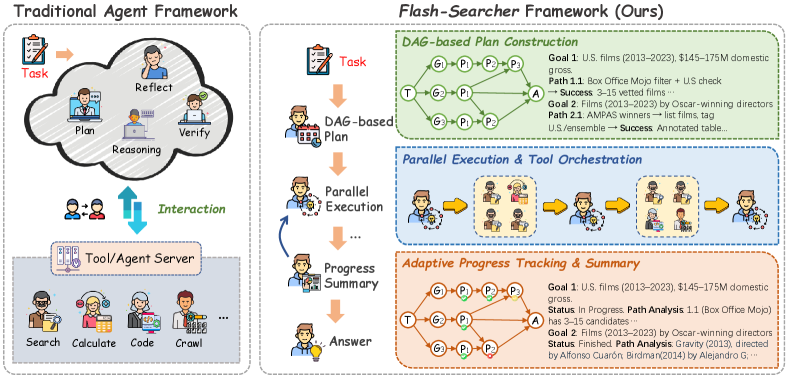

问题定义:现有基于LLM的Agent框架在处理复杂任务时,通常采用顺序执行的方式,即一个步骤执行完毕后才能执行下一个步骤。这种方式在需要大量工具交互的任务中效率低下,因为很多子任务之间可能并不存在依赖关系,可以并行执行。因此,如何提高Agent框架的执行效率,使其能够更好地处理复杂任务是一个关键问题。

核心思路:Flash-Searcher的核心思路是将复杂的任务分解为多个子任务,并显式地定义这些子任务之间的依赖关系,从而构建一个有向无环图(DAG)。通过DAG,Agent可以并行执行相互独立的子任务,从而提高整体的执行效率。此外,Flash-Searcher还引入了动态工作流优化机制,根据中间结果不断调整DAG的结构,进一步提升效率。

技术框架:Flash-Searcher的整体框架包括以下几个主要模块:任务分解模块,负责将复杂任务分解为多个子任务;依赖关系定义模块,负责定义子任务之间的依赖关系;DAG构建模块,负责根据子任务和依赖关系构建DAG;并行执行引擎,负责并行执行DAG中的子任务;动态工作流优化模块,负责根据中间结果优化DAG的结构;摘要模块,负责整合各个子任务的结果,生成最终的答案。

关键创新:Flash-Searcher最重要的技术创新点在于其将Agent的执行范式从顺序链转变为DAG。这种转变使得Agent可以并行执行独立的推理路径,从而显著提高了执行效率。此外,动态工作流优化机制也能够根据中间结果不断调整DAG的结构,进一步提升效率。

关键设计:Flash-Searcher的关键设计包括:如何有效地将复杂任务分解为子任务,如何准确地定义子任务之间的依赖关系,如何设计高效的并行执行引擎,以及如何设计有效的动态工作流优化策略。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

Flash-Searcher在多个基准测试中表现出色,在BrowseComp上实现了67.7%的准确率,在xbench-DeepSearch上实现了83%的准确率。与现有框架相比,Flash-Searcher能够将Agent的执行步骤减少高达35%。此外,将并行推理管道提炼到单个模型中,也能观察到性能的显著提升,证明了该方法具有良好的泛化能力。

🎯 应用场景

Flash-Searcher具有广泛的应用前景,可以应用于各种需要复杂推理和工具交互的场景,例如智能客服、自动化报告生成、科学研究辅助等。通过提高Agent的执行效率,Flash-Searcher可以显著提升这些应用的性能和用户体验,并有望推动相关领域的发展。

📄 摘要(原文)

Large language models (LLMs) have demonstrated remarkable capabilities in complex reasoning tasks when equipped with external tools. However, current frameworks predominantly rely on sequential processing, leading to inefficient execution particularly for tasks requiring extensive tool interaction. This paper introduces Flash-Searcher, a novel parallel agent reasoning framework that fundamentally reimagines the execution paradigm from sequential chains to directed acyclic graphs (DAGs). Flash-Searcher decomposes complex tasks into subtasks with explicit dependencies, enabling concurrent execution of independent reasoning paths while maintaining logical constraints. Through dynamic workflow optimization, our framework continuously refines the execution graph based on intermediate results, effectively integrating summary module. Comprehensive evaluations across multiple benchmarks demonstrate that Flash-Searcher consistently outperforms existing approaches. Specifically, it achieves 67.7% accuracy on BrowseComp and 83% on xbench-DeepSearch, while reducing agent execution steps by up to 35% compared to current frameworks. Furthermore, when distilling this parallel reasoning pipeline into single models, we observe substantial performance gains across diverse backbone architectures, underscoring the generalizability of our methodology. Our work thus represents a significant advance in agent architecture design, offering a more scalable and efficient paradigm for complex reasoning tasks.