MedLA: A Logic-Driven Multi-Agent Framework for Complex Medical Reasoning with Large Language Models

作者: Siqi Ma, Jiajie Huang, Fan Zhang, Jinlin Wu, Yue Shen, Guohui Fan, Zhu Zhang, Zelin Zang

分类: cs.AI

发布日期: 2025-09-28 (更新: 2025-11-19)

备注: accepted by AAAI-26 (ORAL)

💡 一句话要点

MedLA:一种逻辑驱动的多智能体框架,用于大型语言模型进行复杂医学推理

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 医学推理 多智能体系统 大型语言模型 逻辑推理 临床决策支持

📋 核心要点

- 现有医学问答方法难以检测和解决细粒度的逻辑不一致性,限制了复杂医学推理能力。

- MedLA框架将推理过程组织成显式逻辑树,并通过多智能体讨论迭代完善,实现共识。

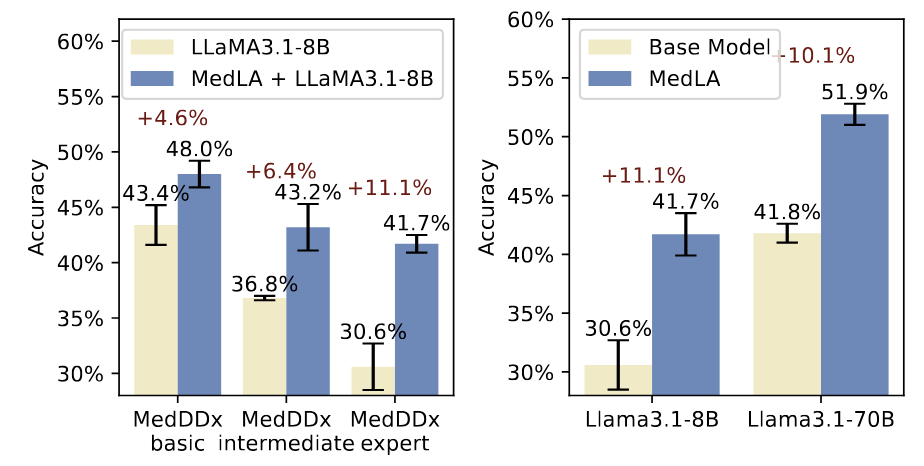

- 实验表明,MedLA在多个医学基准测试中优于现有方法,并可有效扩展到不同LLM骨干网络。

📝 摘要(中文)

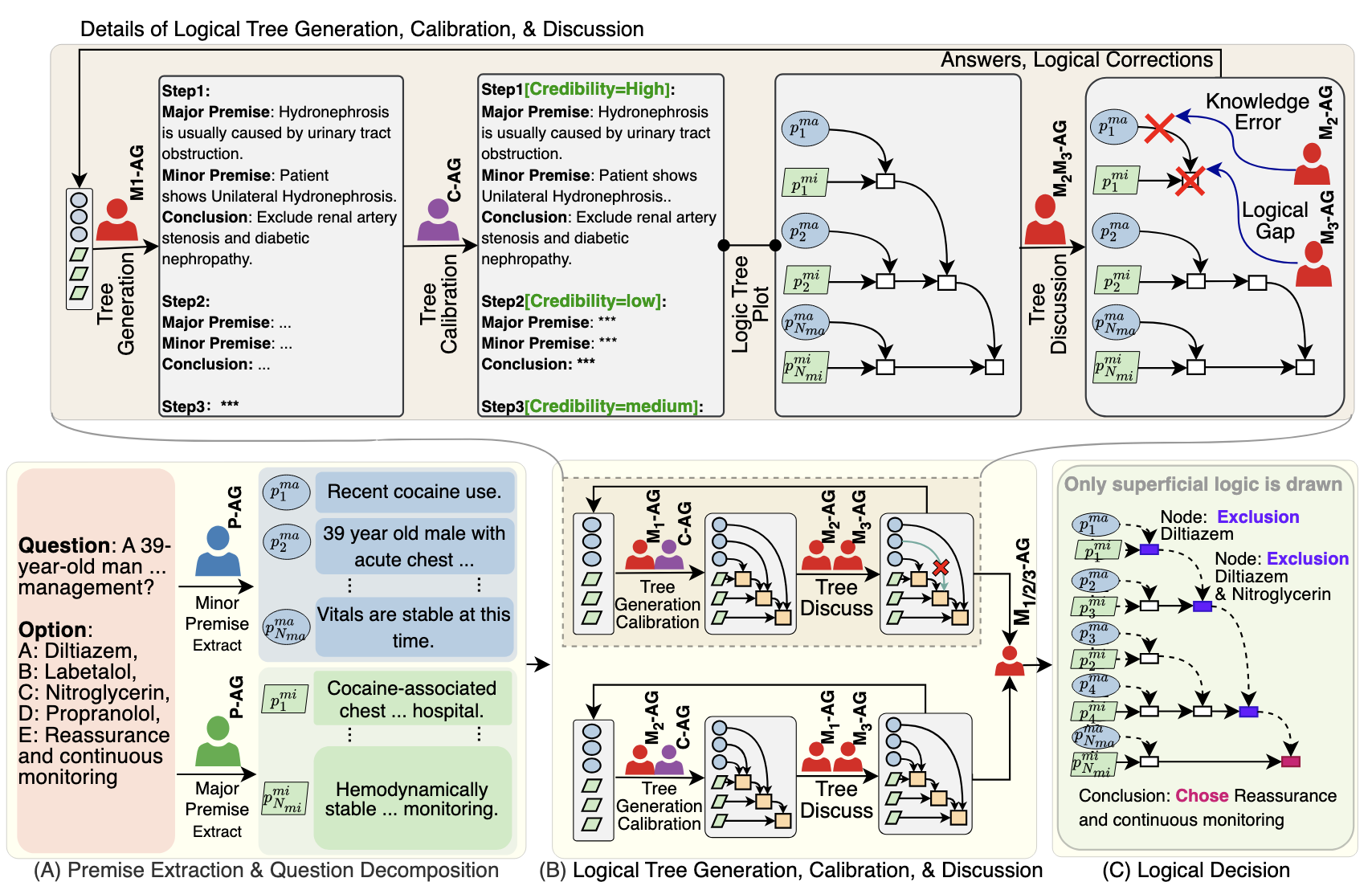

本文提出了一种基于大型语言模型的逻辑驱动的多智能体框架MedLA,用于解决复杂医学问题。该框架不仅需要领域专业知识和患者特定信息,还需要结构化和多角度的推理。现有方法通常依赖于固定的角色或浅层的交互提示,限制了它们检测和解决细粒度逻辑不一致性的能力。MedLA将每个智能体的推理过程组织成一个基于三段论(大前提、小前提和结论)的显式逻辑树,从而实现透明的推理和前提级别的对齐。智能体通过多轮、图引导的讨论来比较和迭代地完善它们的逻辑树,并通过错误纠正和矛盾解决达成共识。在MedDDx等具有挑战性的基准测试和标准医学问答任务中,MedLA始终优于静态的基于角色的系统和单智能体基线。此外,MedLA可以在开源和商业LLM骨干网上有效扩展,实现最先进的性能,并为可信的医学推理提供一种通用的范例。

🔬 方法详解

问题定义:现有医学问答系统在处理复杂问题时,难以进行结构化和多角度的推理,尤其是在检测和解决细粒度的逻辑不一致性方面存在不足。这些系统通常依赖于固定的角色分配或简单的提示工程,无法充分利用大型语言模型的推理能力。

核心思路:MedLA的核心思路是将每个智能体的推理过程显式地表示为逻辑树,并利用多智能体之间的讨论和协作来识别和纠正推理过程中的错误和矛盾。通过这种方式,可以提高推理的透明性和可靠性,并实现更准确的医学问答。

技术框架:MedLA框架包含以下主要模块:1) 逻辑树构建:每个智能体根据输入问题,利用大型语言模型构建一个基于三段论的逻辑树,其中包含大前提、小前提和结论。2) 图引导讨论:智能体之间进行多轮讨论,通过图结构来表示智能体之间的依赖关系和信息传递。3) 逻辑树对齐:智能体比较彼此的逻辑树,识别差异和矛盾,并进行迭代优化。4) 共识达成:通过错误纠正和矛盾解决,智能体最终达成共识,并输出最终答案。

关键创新:MedLA的关键创新在于将逻辑推理与多智能体协作相结合,通过显式的逻辑树表示和图引导的讨论,实现了对复杂医学问题的更深入和更可靠的推理。与现有方法相比,MedLA能够更好地检测和解决逻辑不一致性,并提供更透明和可解释的推理过程。

关键设计:MedLA的关键设计包括:1) 使用三段论作为逻辑树的基本单元,便于推理和对齐。2) 设计图引导的讨论策略,控制智能体之间的信息传递和协作。3) 采用错误纠正和矛盾解决机制,确保智能体最终达成共识。具体的参数设置和损失函数等技术细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

MedLA在MedDDx等具有挑战性的医学基准测试中,以及标准医学问答任务中,始终优于静态的基于角色的系统和单智能体基线。该框架不仅在性能上取得了显著提升,而且可以有效扩展到开源和商业LLM骨干网上,展示了其良好的泛化能力和实用价值。具体的性能提升幅度在论文中未明确给出。

🎯 应用场景

MedLA框架可应用于临床决策支持系统、医学教育和研究等领域。它可以帮助医生进行更准确的诊断和治疗方案制定,提高医疗质量和效率。此外,MedLA还可以用于医学知识库的构建和维护,以及医学研究的辅助分析。未来,该框架有望成为可信赖的医学人工智能解决方案的重要组成部分。

📄 摘要(原文)

Answering complex medical questions requires not only domain expertise and patient-specific information, but also structured and multi-perspective reasoning. Existing multi-agent approaches often rely on fixed roles or shallow interaction prompts, limiting their ability to detect and resolve fine-grained logical inconsistencies. To address this, we propose \textsc{MedLA}, a logic-driven multi-agent framework built on large language models. Each agent organizes its reasoning process into an explicit logical tree based on syllogistic triads (major premise, minor premise, and conclusion), enabling transparent inference and premise-level alignment. Agents engage in a multi-round, graph-guided discussion to compare and iteratively refine their logic trees, achieving consensus through error correction and contradiction resolution. We demonstrate that \textsc{MedLA} consistently outperforms both static role-based systems and single-agent baselines on challenging benchmarks such as MedDDx and standard medical QA tasks. Furthermore, \textsc{MedLA} scales effectively across both open-source and commercial LLM backbones, achieving state-of-the-art performance and offering a generalizable paradigm for trustworthy medical reasoning.