GUI-PRA: Process Reward Agent for GUI Tasks

作者: Tao Xiong, Xavier Hu, Yurun Chen, Yuhang Liu, Changqiao Wu, Pengzhi Gao, Wei Liu, Jian Luan, Shengyu Zhang

分类: cs.AI

发布日期: 2025-09-27 (更新: 2025-10-03)

💡 一句话要点

GUI-PRA:用于GUI任务的过程奖励Agent,解决长程任务中的“中间迷失”和UI状态感知问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI自动化 过程奖励模型 多模态大语言模型 动态记忆 UI状态感知 长程任务 人机交互

📋 核心要点

- 多模态大语言模型驱动的GUI Agent在长程任务中表现不佳,主要原因是难以有效利用历史信息和感知UI状态变化。

- GUI-PRA通过动态记忆机制和自适应UI感知机制,使Agent能够聚焦相关历史信息并根据UI状态变化进行评估,从而提升性能。

- 论文提出了GUI-PRA,通过检索相关历史信息和感知UI状态变化,为GUI任务提供更有效的过程奖励。

📝 摘要(中文)

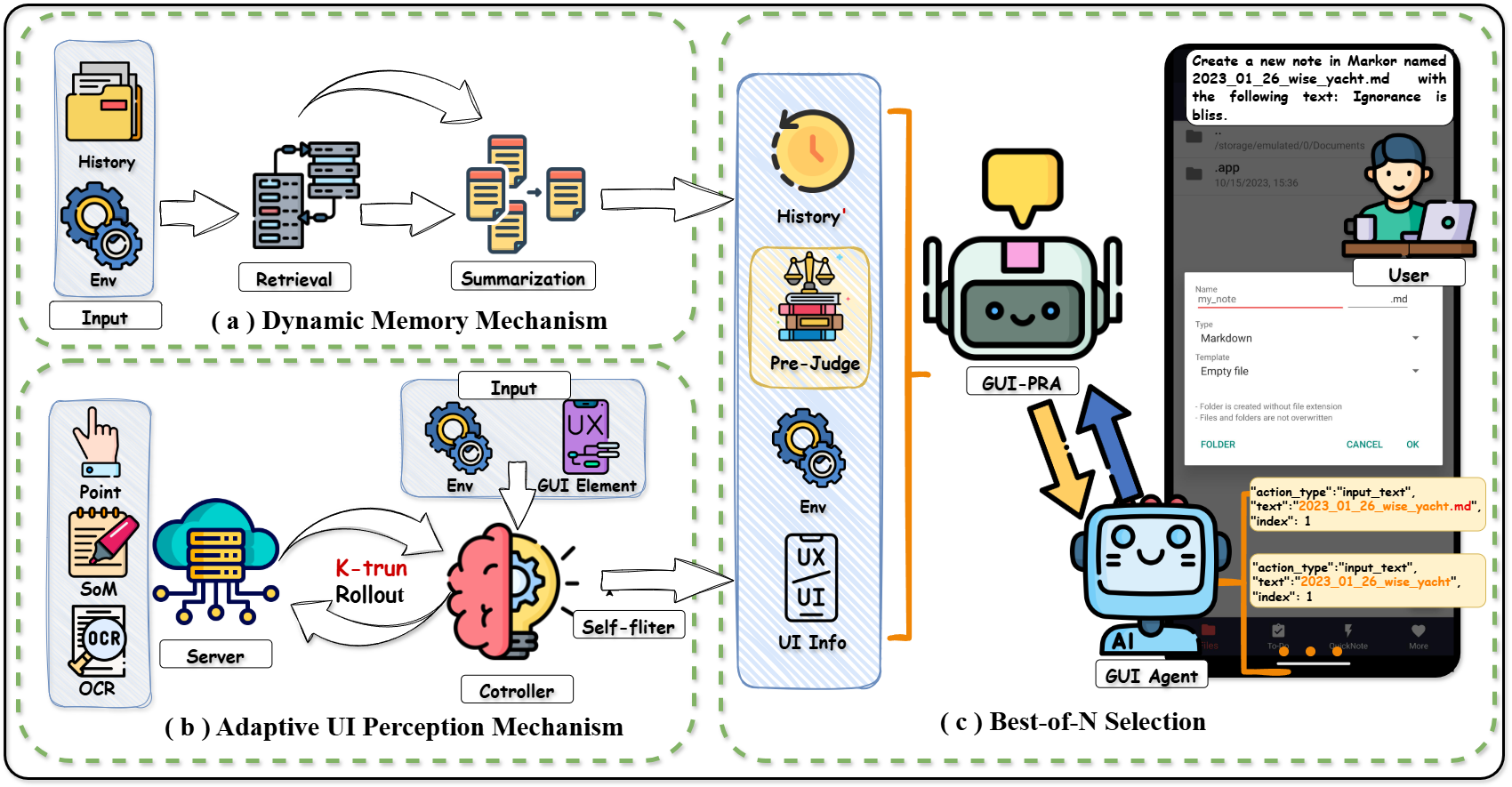

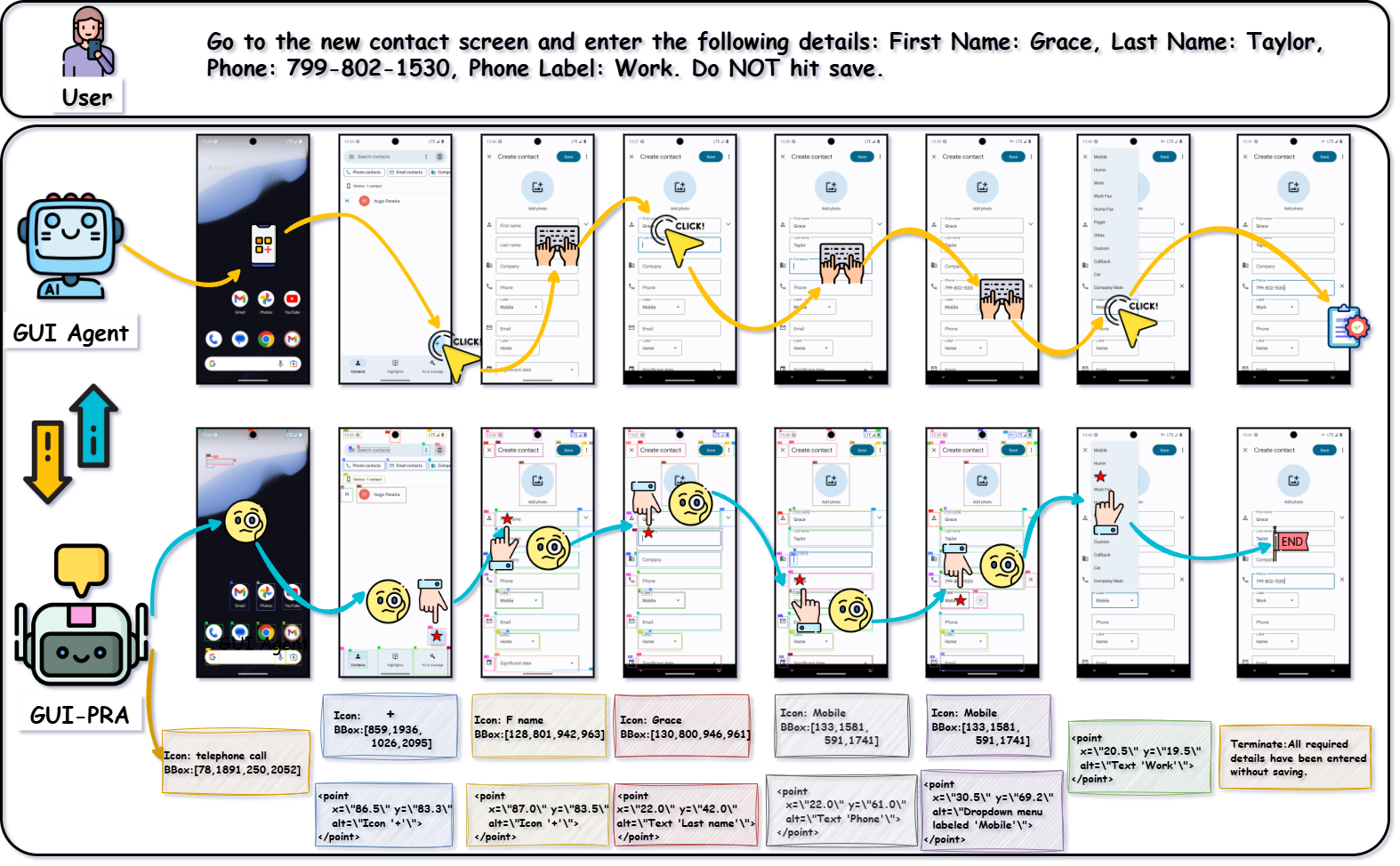

本文提出GUI-PRA,一个用于图形用户界面(GUI)任务的过程奖励Agent,旨在解决多模态大型语言模型(MLLM)在自动化GUI任务中面临的长程任务失败问题。现有的过程奖励模型(PRM)在处理GUI领域密集的人工输入和长历史数据时,会遭遇“中间迷失”现象,即历史上下文干扰当前步骤的评估。此外,标准PRM缺乏GUI变化感知能力,无法根据动作的动态结果进行评估。GUI-PRA通过智能处理历史上下文和主动感知UI状态变化来提供更好的过程奖励。它包含一个动态记忆机制,利用基于相关性的检索模块和渐进式总结模块来聚焦相关上下文,以及一个自适应UI感知机制,通过推理UI状态变化并动态选择工具来收集视觉证据,确保评估基于当前的UI上下文。

🔬 方法详解

问题定义:现有的基于多模态大语言模型(MLLM)的GUI Agent在处理长程任务时,容易失败。过程奖励模型(PRM)虽然有潜力指导Agent,但在GUI领域面临两个主要问题:一是“中间迷失”现象,即在处理大量历史数据时,模型难以关注当前步骤的相关信息;二是缺乏UI变化感知能力,无法根据动作带来的UI状态变化进行评估。现有方法无法有效处理长程任务中的历史信息和UI状态变化,导致Agent性能下降。

核心思路:GUI-PRA的核心思路是通过动态记忆机制来解决“中间迷失”问题,并通过自适应UI感知机制来解决UI状态变化感知问题。动态记忆机制使Agent能够从长历史中检索相关信息并进行总结,从而聚焦于重要上下文。自适应UI感知机制使Agent能够推理UI状态变化,并选择合适的工具来收集视觉证据,从而进行更准确的评估。

技术框架:GUI-PRA主要包含两个核心模块:动态记忆机制和自适应UI感知机制。动态记忆机制包括:1)基于相关性的检索模块,用于从长历史中检索相关信息;2)渐进式总结模块,用于动态压缩不断增长的交互数据。自适应UI感知机制使Agent能够推理UI状态变化,并动态选择最合适的工具来收集视觉证据。整体流程是Agent执行动作后,自适应UI感知机制观察UI变化,然后动态记忆机制处理历史信息,最后Agent根据处理后的信息进行下一步决策。

关键创新:GUI-PRA的关键创新在于:1)提出了动态记忆机制,有效解决了GUI任务中的“中间迷失”问题,使Agent能够更好地利用历史信息;2)提出了自适应UI感知机制,使Agent能够感知UI状态变化,从而进行更准确的评估。这两个机制的结合使得GUI-PRA能够更好地处理长程GUI任务。

关键设计:在动态记忆机制中,相关性检索模块使用相似度计算来确定历史信息的相关性,并选择最相关的部分。渐进式总结模块使用递归神经网络(RNN)或Transformer来压缩历史信息。在自适应UI感知机制中,Agent使用预训练的视觉模型来提取UI元素的特征,并使用分类器来预测UI状态变化。损失函数包括奖励预测损失和UI状态变化预测损失。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

论文重点在于提出了一种新的框架,具体实验数据未知。但可以推断,通过动态记忆机制和自适应UI感知机制,GUI-PRA在长程GUI任务上的性能应该优于传统的PRM方法。未来的实验结果可以进一步验证GUI-PRA的有效性和优越性。

🎯 应用场景

GUI-PRA具有广泛的应用前景,可用于自动化软件测试、RPA(机器人流程自动化)、智能助手等领域。它可以显著提高自动化任务的效率和成功率,降低人工成本。未来,GUI-PRA可以进一步扩展到更复杂的GUI任务,并与其他技术(如强化学习、迁移学习)相结合,实现更智能、更可靠的自动化。

📄 摘要(原文)

Graphical User Interface (GUI) Agents powered by Multimodal Large Language Models (MLLMs) show significant potential for automating tasks. However, they often struggle with long-horizon tasks, leading to frequent failures. Process Reward Models (PRMs) are a promising solution, as they can guide these agents with crucial process signals during inference. Nevertheless, their application to the GUI domain presents unique challenges. When processing dense artificial inputs with long history data, PRMs suffer from a "lost in the middle" phenomenon, where the overwhelming historical context compromises the evaluation of the current step. Furthermore, standard PRMs lacks GUI changing awareness, providing static evaluations that are disconnected from the dynamic consequences of actions, a critical mismatch with the inherently dynamic nature of GUI tasks. In response to these challenges, we introduce GUI-PRA (Process Reward Agent for GUI Tasks), a judge agent designed to better provide process reward than standard PRM by intelligently processing historical context and actively perceiving UI state changes. Specifically, to directly combat the ``lost in the middle'' phenomenon, we introduce a dynamic memory mechanism consisting of two core components: a Relevance-based Retrieval Module to actively fetch pertinent information from long histories and a Progressive Summarization Module to dynamically condense growing interaction data, ensuring the model focuses on relevant context. Moreover, to address the lack of UI changing awareness, we introduce an Aadaptive UI Perception mechanism. This mechanism enables the agent to reason about UI state changes and dynamically select the most appropriate tool to gather grounded visual evidence, ensuring its evaluation is always informed by the current UI context.