Agentic AI Reasoning for Mobile Edge General Intelligence: Fundamentals, Approaches, and Directions

作者: Mingyi Luo, Ruichen Zhang, Xiangwang Hou, Jun Du, Chunxiao Jiang, Yong Ren, Dusit Niyato, Shiwen Mao

分类: cs.AI, cs.NI

发布日期: 2025-09-27

💡 一句话要点

提出基于Agentic AI的移动边缘通用智能推理框架,优化资源受限环境下的LLM部署。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动边缘计算 通用智能 大型语言模型 Agentic AI 思维链 混合专家 分布式推理 资源优化

📋 核心要点

- 现有方法难以在资源受限的移动边缘环境中部署计算需求高的LLM推理。

- 提出自适应CoT提示和分布式MoE架构的联合优化框架,提升推理效率。

- 实验表明,该框架有效平衡了推理质量和资源效率,验证了可行性。

📝 摘要(中文)

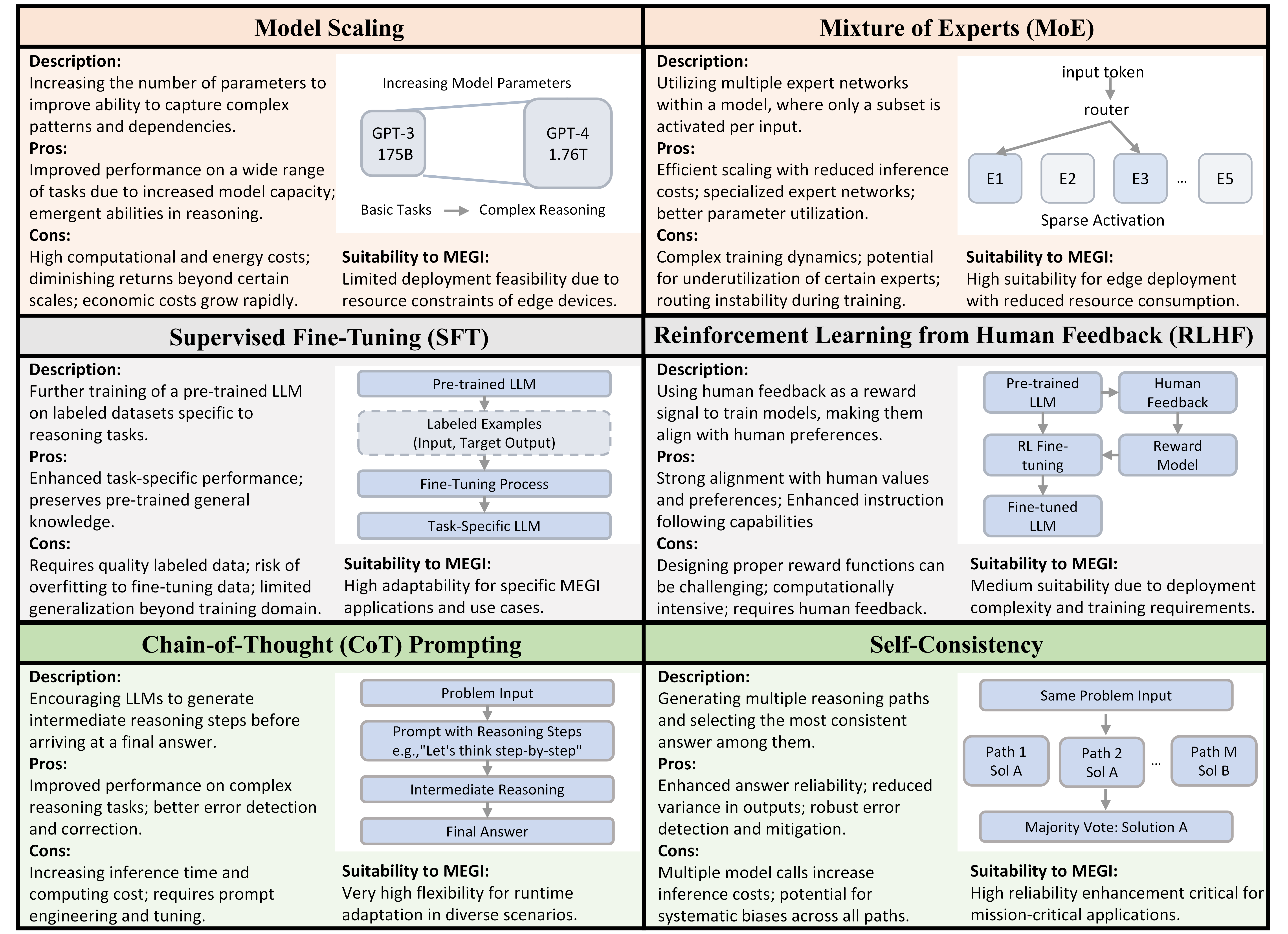

大型语言模型(LLM)的快速发展催生了具有强大推理和自主决策能力的Agentic人工智能(AI)。与边缘计算的结合促进了移动边缘通用智能(MEGI)的发展,从而将实时、保护隐私的推理带到网络边缘。然而,在MEGI环境中部署基于LLM的Agentic AI推理面临着巨大的挑战,这是由于推理的高计算需求和边缘设备有限的资源所致。为了应对这些挑战,我们提出了一个联合优化框架,用于在MEGI中高效部署LLM推理。首先,我们回顾了增强LLM推理能力的方法,例如思维链(CoT)提示、监督微调(SFT)和混合专家(MoE)。接下来,我们提出了一个分布式框架,该框架解决了两个相关方面:通过自适应CoT提示进行推理增强,以及通过分布式MoE架构进行可扩展部署。该框架根据任务复杂性和设备能力动态激活专家网络并调整推理深度。我们进一步在移动边缘环境中进行了实验评估。实验结果表明,该框架在平衡推理质量与资源效率方面是有效的,验证了在资源受限的MEGI环境中部署复杂的LLM推理能力的可行性。

🔬 方法详解

问题定义:论文旨在解决在移动边缘通用智能(MEGI)环境中,由于边缘设备资源有限,难以高效部署大型语言模型(LLM)进行Agentic AI推理的问题。现有方法在计算资源需求和推理质量之间难以取得平衡,导致LLM推理在边缘设备上的应用受限。

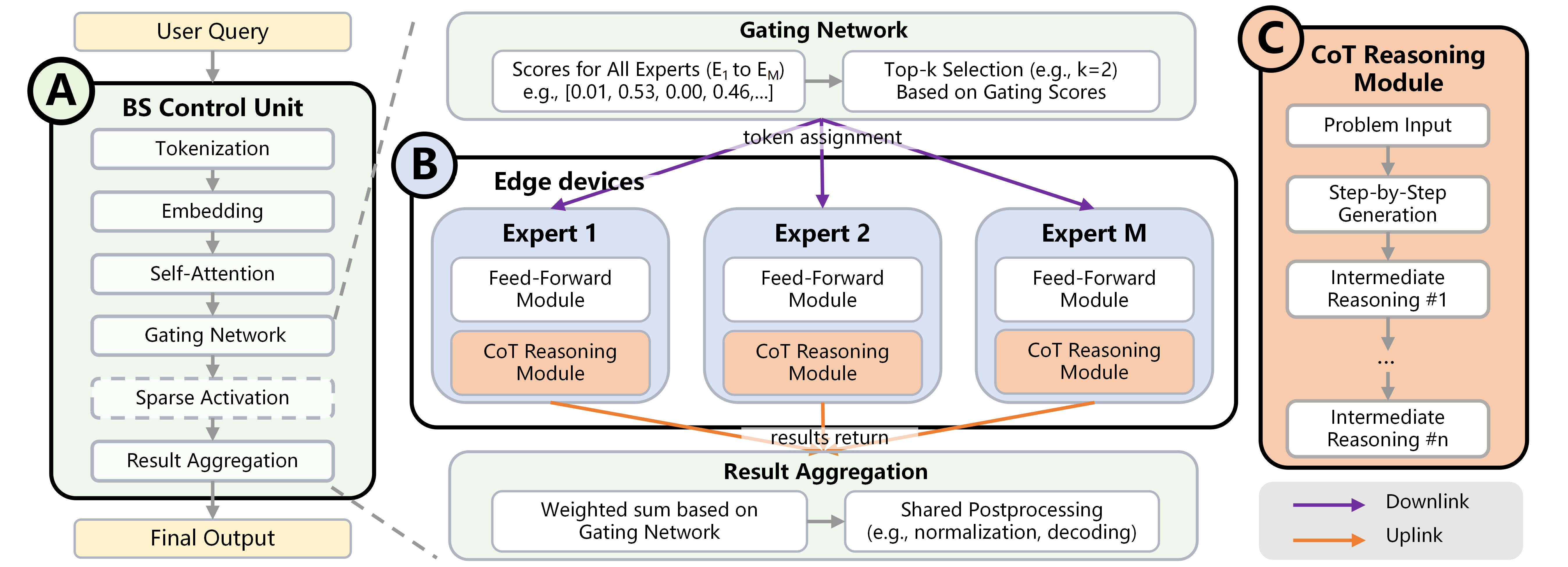

核心思路:论文的核心思路是利用自适应的思维链(Chain-of-Thought, CoT)提示来增强LLM的推理能力,并采用分布式混合专家(Mixture of Experts, MoE)架构来实现LLM推理在边缘设备上的可扩展部署。通过动态调整CoT提示的深度和激活合适的专家网络,可以在保证推理质量的同时,降低计算资源消耗。

技术框架:该框架包含两个主要组成部分:自适应CoT提示模块和分布式MoE架构。自适应CoT提示模块根据任务的复杂程度和设备的计算能力,动态调整CoT提示的深度,以优化推理过程。分布式MoE架构将LLM分解为多个专家网络,并根据任务的特点动态激活相应的专家网络,从而降低单个设备的计算负担。整体流程包括任务输入、CoT提示生成、专家网络选择、推理执行和结果输出。

关键创新:论文的关键创新在于提出了一个联合优化框架,将自适应CoT提示和分布式MoE架构相结合,实现了在资源受限的MEGI环境中高效部署LLM推理。与现有方法相比,该框架能够根据任务和设备特性动态调整推理策略,从而在推理质量和资源效率之间取得更好的平衡。

关键设计:自适应CoT提示模块使用强化学习来学习最佳的CoT提示深度,奖励函数综合考虑了推理准确率和计算资源消耗。分布式MoE架构采用门控网络来选择激活哪些专家网络,门控网络的训练目标是最大化推理准确率并最小化激活的专家网络数量。具体参数设置和网络结构细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

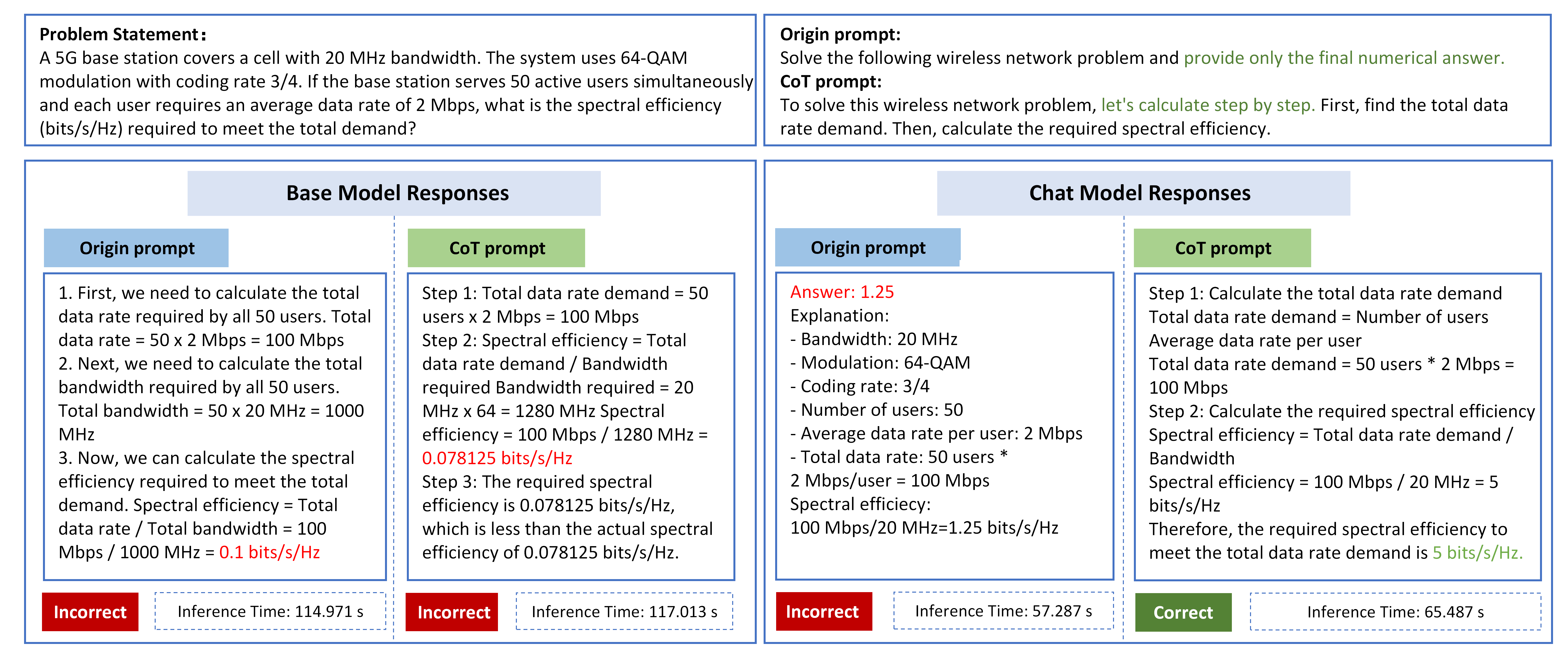

实验结果表明,所提出的框架能够在保证推理质量的前提下,显著降低计算资源消耗。具体性能数据和对比基线在摘要中未提及,属于未知信息。但实验验证了在资源受限的MEGI环境中部署复杂的LLM推理能力的可行性。

🎯 应用场景

该研究成果可应用于智能交通、智能安防、工业自动化等领域,在这些场景中,边缘设备需要实时进行复杂推理和决策。通过在边缘部署高效的LLM推理能力,可以减少对云端资源的依赖,提高响应速度,并保护用户隐私。未来,该技术有望推动边缘智能的广泛应用。

📄 摘要(原文)

The rapid advancement of large language models (LLMs) has enabled an emergence of agentic artificial intelligence (AI) with powerful reasoning and autonomous decision-making capabilities. This integration with edge computing has led to the development of Mobile Edge General Intelligence (MEGI), which brings real-time, privacy-preserving reasoning to the network edge. However, deploying LLM-based agentic AI reasoning in MEGI environments poses significant challenges due to the high computational demands of reasoning and the limited resources of edge devices. To address these challenges, we propose a joint optimization framework for efficient LLM reasoning deployment in MEGI. First, we review methods that enhance LLM reasoning capabilities, such as Chain-of-Thought (CoT) prompting, Supervised Fine-Tuning (SFT), and Mixture of Experts (MoE). Next, we present a distributed framework that addresses two correlated aspects: reasoning enhancement through adaptive CoT prompting and scalable deployment through distributed MoE architecture. The framework dynamically activates expert networks and adjusts reasoning depth based on task complexity and device capabilities. We further conduct experimental evaluations in mobile edge environments. Experimental results demonstrate the framework's effectiveness in balancing reasoning quality with resource efficiency, validating the practical viability of deploying sophisticated LLM reasoning capabilities in resource-constrained MEGI environments.