WaveMind: Towards a Conversational EEG Foundation Model Aligned to Textual and Visual Modalities

作者: Ziyi Zeng, Zhenyang Cai, Yixi Cai, Xidong Wang, Junying Chen, Rongsheng Wang, Yipeng Liu, Siqi Cai, Benyou Wang, Zhiguo Zhang, Haizhou Li

分类: eess.SP, cs.AI, cs.CL, cs.LG, q-bio.NC

发布日期: 2025-09-26

💡 一句话要点

WaveMind:面向文本和视觉模态对齐的会话式脑电图基础模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑电图分析 多模态学习 大型语言模型 指令调优 跨模态表征 脑机接口 语义空间

📋 核心要点

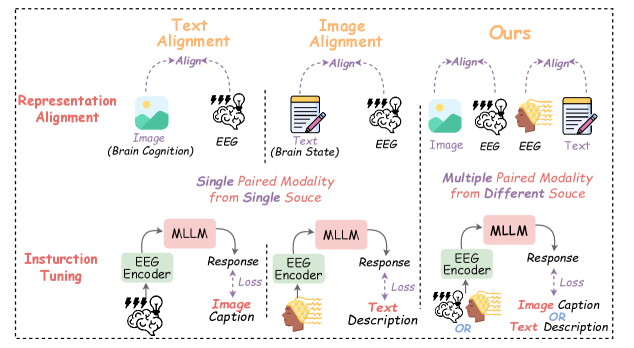

- 现有方法难以有效学习脑电信号的跨模态表征,因为脑电信号同时包含认知过程和神经状态,导致模态不匹配。

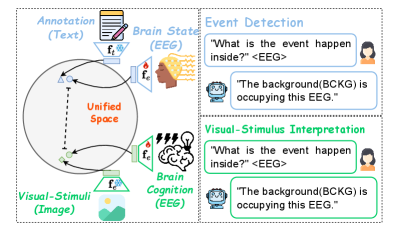

- 论文核心思想是将脑电信号及其对应模态映射到统一语义空间,利用模态间的互补关系,实现泛化的脑电图理解。

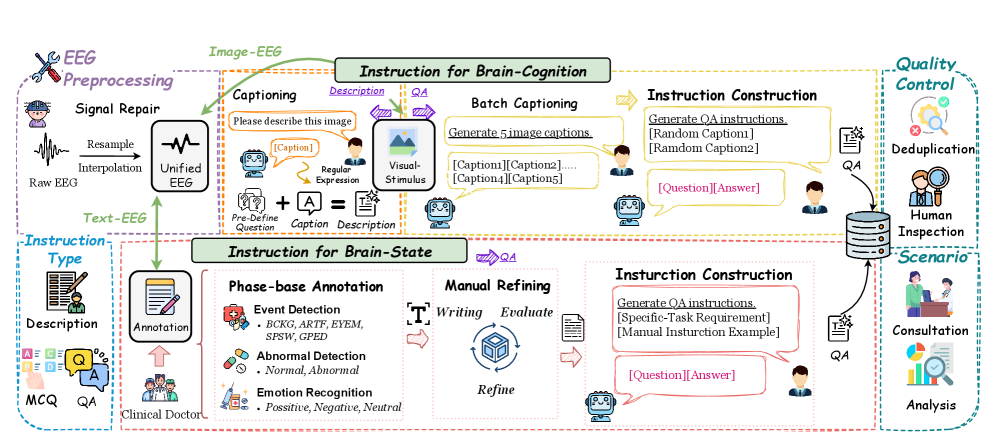

- 论文构建了WaveMind-Instruct-338k数据集,并通过指令调优,使模型具备了鲁棒的分类精度和开放式对话能力。

📝 摘要(中文)

本文提出了一种利用多模态大型语言模型(MLLM)进行脑电图(EEG)分析的新方法。脑电信号同时编码认知过程和内在神经状态,导致脑电配对数据模态不匹配,阻碍了有效的跨模态表征学习。通过研究,我们发现了这些模态之间的互补关系。基于此,我们提出将脑电信号及其对应的模态映射到一个统一的语义空间,以实现泛化的脑电图解释。为了充分实现会话能力,我们进一步引入了WaveMind-Instruct-338k,这是第一个用于指令调优的跨任务脑电数据集。实验结果表明,该模型在保持鲁棒分类精度的同时,支持跨四个下游任务的灵活、开放式对话,为神经科学研究和通用脑电模型的开发提供了有价值的见解。

🔬 方法详解

问题定义:现有方法在利用多模态大型语言模型分析脑电图时,面临脑电信号复杂性的挑战。脑电信号同时编码认知过程和内在神经状态,导致脑电配对数据模态之间存在不匹配,阻碍了有效的跨模态表征学习。因此,如何解决脑电信号的模态不匹配问题,实现更有效的跨模态学习,是本文要解决的核心问题。

核心思路:论文的核心思路是将脑电信号及其对应的模态(例如文本描述、视觉刺激)映射到一个统一的语义空间。通过学习不同模态之间的互补关系,模型可以更好地理解脑电信号的含义,从而实现更泛化的脑电图解释。这种方法旨在弥合脑电信号内在复杂性和其他模态之间的语义差距。

技术框架:整体框架包含以下几个主要步骤:1) 数据收集与预处理:收集包含脑电信号以及对应文本和视觉信息的跨模态数据集。2) 特征提取:使用合适的算法(例如,时频分析、小波变换)从脑电信号中提取特征。3) 模态映射:将脑电信号特征以及其他模态的信息映射到统一的语义空间。这可以通过训练一个多模态编码器来实现。4) 指令调优:使用WaveMind-Instruct-338k数据集对模型进行指令调优,使其具备会话能力。5) 任务评估:在多个下游任务上评估模型的性能,包括脑电信号分类、开放式对话等。

关键创新:论文的关键创新在于:1) 提出了将脑电信号映射到统一语义空间的方法,以解决模态不匹配问题。2) 构建了WaveMind-Instruct-338k数据集,这是第一个用于指令调优的跨任务脑电数据集。3) 实现了具有鲁棒分类精度和开放式对话能力的脑电图分析模型。与现有方法相比,该方法能够更好地利用跨模态信息,并支持更灵活的脑电图分析。

关键设计:关于关键设计,论文提到构建了WaveMind-Instruct-338k数据集,但未提供关于损失函数、网络结构等技术细节的具体信息。推测可能使用了标准的Transformer架构或其变体作为多模态编码器,并采用对比学习或类似的损失函数来学习跨模态表征。指令调优可能使用了标准的监督学习方法,例如交叉熵损失。

🖼️ 关键图片

📊 实验亮点

论文构建了WaveMind-Instruct-338k数据集,并通过指令调优,使模型在多个下游任务上表现出鲁棒的分类精度,并支持开放式对话。虽然论文没有提供具体的性能数据和对比基线,但强调了模型在跨任务泛化和会话能力方面的优势。具体的性能提升幅度未知。

🎯 应用场景

该研究成果可应用于多种领域,包括神经科学研究、脑机接口(BCI)系统、精神疾病诊断和治疗等。通过构建通用脑电模型,可以更深入地理解大脑活动,开发更智能的BCI设备,并为精神疾病的早期诊断和个性化治疗提供新的工具。该研究的潜在价值在于提高脑电图分析的效率和准确性,并促进相关技术的广泛应用。

📄 摘要(原文)

Electroencephalography (EEG) interpretation using multimodal large language models (MLLMs) offers a novel approach for analyzing brain signals. However, the complex nature of brain activity introduces critical challenges: EEG signals simultaneously encode both cognitive processes and intrinsic neural states, creating a mismatch in EEG paired-data modality that hinders effective cross-modal representation learning. Through a pivot investigation, we uncover complementary relationships between these modalities. Leveraging this insight, we propose mapping EEG signals and their corresponding modalities into a unified semantic space to achieve generalized interpretation. To fully enable conversational capabilities, we further introduce WaveMind-Instruct-338k, the first cross-task EEG dataset for instruction tuning. The resulting model demonstrates robust classification accuracy while supporting flexible, open-ended conversations across four downstream tasks, thereby offering valuable insights for both neuroscience research and the development of general-purpose EEG models.