Embodied AI: From LLMs to World Models

作者: Tongtong Feng, Xin Wang, Yu-Gang Jiang, Wenwu Zhu

分类: cs.AI, cs.CL, cs.RO

发布日期: 2025-09-24

备注: Accepted by IEEE CASM

💡 一句话要点

综述性论文:探索具身智能中LLM与世界模型的融合应用

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 大型语言模型 世界模型 多模态学习 机器人

📋 核心要点

- 现有具身智能方法在处理复杂任务时,缺乏对物理世界的深入理解和长期规划能力,难以实现通用智能。

- 论文提出结合大型语言模型(LLM)和世界模型(WM)的具身智能架构,利用LLM进行任务分解和语义推理,WM进行环境建模和未来预测。

- 该架构旨在提升具身智能体在复杂物理环境中完成任务的能力,并为未来的研究方向提供指导。

📝 摘要(中文)

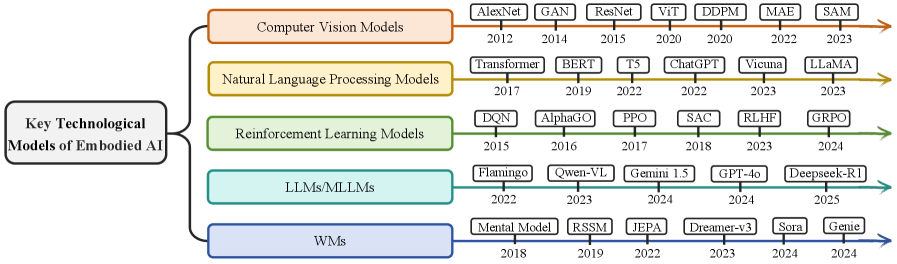

具身智能(Embodied AI)是一种实现通用人工智能(AGI)的智能系统范式,是各种应用的基础,并推动着从网络空间到物理系统的演进。大型语言模型(LLM)和世界模型(WM)的最新突破引起了人们对具身智能的广泛关注。一方面,LLM通过语义推理和任务分解来增强具身智能,将高级自然语言指令和低级自然语言动作引入具身认知。另一方面,WM通过构建外部世界的内部表示和未来预测来增强具身智能,从而促进符合物理定律的具身交互。因此,本文全面探讨了具身智能的文献,从基础到高级,涵盖了LLM驱动和WM驱动的工作。特别地,我们首先介绍了具身智能的历史、关键技术、关键组件和硬件系统,并从单模态到多模态的角度讨论了其发展。然后,我们仔细研究了具身智能的两个新兴领域,即具有LLM/多模态LLM(MLLM)的具身智能和具有WM的具身智能,细致地描述了它们在端到端具身认知和物理定律驱动的具身交互中不可或缺的作用。基于上述进展,我们进一步分享了我们对联合MLLM-WM驱动的具身智能架构必要性的见解,阐明了其在物理世界中实现复杂任务的深远意义。此外,我们还研究了具身智能的代表性应用,展示了其在现实场景中的广泛适用性。最后但并非最不重要的一点是,我们指出了具身智能未来值得进一步研究的研究方向。

🔬 方法详解

问题定义:现有具身智能方法在复杂物理环境中面临挑战,例如难以理解高级指令、缺乏对环境的长期预测能力,以及难以进行符合物理规律的交互。这些问题阻碍了具身智能向通用人工智能方向发展。

核心思路:论文的核心思路是将大型语言模型(LLM)和世界模型(WM)结合起来,构建一个更强大的具身智能系统。LLM负责理解高级指令、进行任务分解和生成行动策略,而WM负责构建环境的内部表示、预测未来状态和提供物理规律约束。

技术框架:论文探讨的整体架构是MLLM-WM驱动的具身智能系统。该系统包含以下主要模块:1) MLLM:负责接收自然语言指令,进行语义理解和任务分解,生成行动序列。2) WM:负责构建环境的内部表示,预测未来状态,并提供物理规律约束。3) 执行器:负责将行动序列转化为具体的物理动作,并与环境进行交互。4) 反馈模块:负责接收环境的反馈信息,并将其传递给MLLM和WM,用于更新模型和调整策略。

关键创新:论文的关键创新在于强调了MLLM和WM的联合使用,并阐述了其在具身智能中的重要性。MLLM负责高层次的认知和决策,而WM负责低层次的物理交互和环境建模。这种结合可以使具身智能体更好地理解环境、预测未来,并做出更合理的决策。

关键设计:论文没有提供具体的参数设置、损失函数或网络结构等技术细节,而是侧重于对现有研究的综述和对未来方向的展望。未来的研究可以探索如何设计更有效的MLLM和WM,以及如何将它们更好地结合起来,以实现更强大的具身智能系统。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述性文章,主要贡献在于对现有具身智能研究进行了全面的梳理和总结,并提出了MLLM-WM联合驱动的具身智能架构。论文没有提供具体的实验结果,而是侧重于对未来研究方向的展望,例如如何设计更有效的MLLM和WM,以及如何将它们更好地结合起来。

🎯 应用场景

具身智能在机器人、自动驾驶、智能家居、医疗健康等领域具有广泛的应用前景。例如,在机器人领域,具身智能可以使机器人更好地理解人类指令、适应复杂环境,并完成各种任务。在自动驾驶领域,具身智能可以使车辆更好地感知周围环境、预测其他车辆的行动,并做出更安全的驾驶决策。在智能家居领域,具身智能可以使家居设备更好地理解用户的需求、提供个性化的服务。

📄 摘要(原文)

Embodied Artificial Intelligence (AI) is an intelligent system paradigm for achieving Artificial General Intelligence (AGI), serving as the cornerstone for various applications and driving the evolution from cyberspace to physical systems. Recent breakthroughs in Large Language Models (LLMs) and World Models (WMs) have drawn significant attention for embodied AI. On the one hand, LLMs empower embodied AI via semantic reasoning and task decomposition, bringing high-level natural language instructions and low-level natural language actions into embodied cognition. On the other hand, WMs empower embodied AI by building internal representations and future predictions of the external world, facilitating physical law-compliant embodied interactions. As such, this paper comprehensively explores the literature in embodied AI from basics to advances, covering both LLM driven and WM driven works. In particular, we first present the history, key technologies, key components, and hardware systems of embodied AI, as well as discuss its development via looking from unimodal to multimodal angle. We then scrutinize the two burgeoning fields of embodied AI, i.e., embodied AI with LLMs/multimodal LLMs (MLLMs) and embodied AI with WMs, meticulously delineating their indispensable roles in end-to-end embodied cognition and physical laws-driven embodied interactions. Building upon the above advances, we further share our insights on the necessity of the joint MLLM-WM driven embodied AI architecture, shedding light on its profound significance in enabling complex tasks within physical worlds. In addition, we examine representative applications of embodied AI, demonstrating its wide applicability in real-world scenarios. Last but not least, we point out future research directions of embodied AI that deserve further investigation.