CogAtom: From Cognitive Atoms to Olympiad-level Mathematical Reasoning in Large Language Models

作者: Zhuofan Chen, Jiyuan He, Yichi Zhang, Xing Hu, Haoxing Wen, Jun Bai, Wenge Rong

分类: cs.AI, cs.CL, cs.LG

发布日期: 2025-09-22 (更新: 2025-09-24)

🔗 代码/项目: GITHUB

💡 一句话要点

CogAtom:提出基于认知原子的框架,用于生成奥林匹克级别数学题,提升大语言模型推理能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学推理 大语言模型 认知原子 问题生成 奥林匹克数学

📋 核心要点

- 大型语言模型在数学推理方面面临挑战,现有方法依赖高质量问题,但奥赛级别题目稀缺。

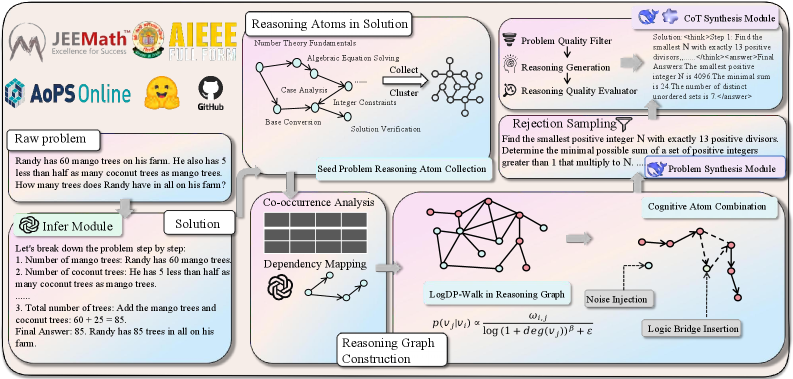

- CogAtom 框架通过选择和重组从人类解题方案中提取的认知原子来合成数学题。

- 实验表明,CogAtom 在准确性、推理深度和多样性方面优于现有方法,生成高质量数学题。

📝 摘要(中文)

由于需要多步推理和抽象概念整合,数学推理对大型语言模型(LLM)提出了重大挑战。虽然最近的测试时扩展技术严重依赖于高质量、具有挑战性的问题,但奥林匹克级别数学题的稀缺仍然是一个瓶颈。我们介绍 CogAtom,这是一个新颖的基于认知原子的框架,用于合成数学上严谨且认知上多样化的问题。与先前的方法不同,CogAtom 将问题构建建模为选择和重组从人工编写的解决方案中提取的基本推理单元(认知原子)的过程。一种促进多样性的随机游走算法能够探索认知原子空间,而一种基于约束的重组机制确保了逻辑上的合理性和结构上的有效性。图结构的组合性质提供了近乎无限的推理路径空间,并且游走算法系统地探索该空间以实现大规模高质量问题的合成;同时,通过控制认知原子的数量,我们可以精确地调整问题难度,确保生成问题的多样性、可扩展性和可控性。实验结果表明,CogAtom 在准确性、推理深度和多样性方面优于现有方法,生成的问题在结构变化方面超过 AIME 的难度。我们的工作为可扩展、高质量的数学问题生成提供了一条认知基础的途径。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在数学推理方面面临的挑战,特别是缺乏高质量、多样化的奥林匹克级别数学题的问题。现有方法难以生成足够复杂且具有认知挑战性的题目,限制了模型推理能力的提升。

核心思路:CogAtom 的核心思路是将数学问题构建过程分解为基本推理单元的组合,这些推理单元被称为“认知原子”。通过从人类解题方案中提取这些认知原子,并以一种结构化的方式重新组合,可以生成新的、具有挑战性的数学问题。这种方法借鉴了人类解决问题的认知过程,旨在创造更贴近人类思维模式的题目。

技术框架:CogAtom 的整体框架包括以下几个主要模块:1) 认知原子提取:从现有的数学题解数据集中提取认知原子。2) 认知原子空间探索:使用一种促进多样性的随机游走算法,在认知原子空间中探索不同的组合方式。3) 基于约束的重组:利用约束条件来确保生成的数学问题在逻辑上是合理的,并且在结构上是有效的。4) 问题难度控制:通过控制认知原子的数量来调整生成问题的难度。

关键创新:CogAtom 的关键创新在于其基于认知原子的数学问题生成方法。与以往的生成模型不同,CogAtom 更加关注问题的认知结构,通过模拟人类的解题过程来生成题目。此外,CogAtom 还引入了一种促进多样性的随机游走算法,以及一种基于约束的重组机制,从而保证了生成问题的质量和多样性。

关键设计:CogAtom 的关键设计包括:1) 认知原子的定义和提取方法:如何有效地从人类解题方案中提取出具有代表性的认知原子。2) 随机游走算法的设计:如何设计一种能够有效探索认知原子空间,并且能够促进多样性的随机游走算法。3) 约束条件的定义和应用:如何定义合适的约束条件,以保证生成问题的逻辑合理性和结构有效性。4) 难度控制机制:如何通过控制认知原子的数量来精确地调整生成问题的难度。具体参数设置和损失函数等细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CogAtom 在准确性、推理深度和多样性方面优于现有方法。CogAtom 生成的问题在结构变化方面超过 AIME 的难度,表明其能够生成更具挑战性的数学问题。具体性能数据未知,但论文强调了 CogAtom 在生成高质量数学问题方面的优势。

🎯 应用场景

CogAtom 的潜在应用领域包括:1) 用于训练和评估大型语言模型的数学推理能力。2) 用于生成个性化的数学练习题,以满足不同学生的学习需求。3) 用于自动化数学题库的构建和维护。该研究的实际价值在于能够为大型语言模型提供更多高质量的训练数据,从而提升其在数学推理方面的能力。未来,CogAtom 可以进一步扩展到其他类型的推理问题,例如物理、化学等。

📄 摘要(原文)

Mathematical reasoning poses significant challenges for Large Language Models (LLMs) due to its demand for multi-step reasoning and abstract conceptual integration. While recent test-time scaling techniques rely heavily on high-quality, challenging problems, the scarcity of Olympiad-level math problems remains a bottleneck. We introduce CogAtom, a novel cognitive atom-based framework for synthesizing mathematically rigorous and cognitively diverse problems. Unlike prior approaches, CogAtom models problem construction as a process of selecting and recombining fundamental reasoning units, cognitive atoms, extracted from human-authored solutions. A diversity-promoting random walk algorithm enables exploration of the cognitive atom space, while a constraint-based recombination mechanism ensures logical soundness and structural validity. The combinatorial nature of the graph structure provides a near-infinite space of reasoning paths, and the walk algorithm systematically explores this space to achieve large-scale synthesis of high-quality problems; meanwhile, by controlling the number of cognitive atoms, we can precisely adjust problem difficulty, ensuring diversity, scalability, and controllability of the generated problems. Experimental results demonstrate that CogAtom outperforms existing methods in accuracy, reasoning depth, and diversity, generating problems that closely match the difficulty of AIME while exceeding it in structural variation. Our work offers a cognitively grounded pathway toward scalable, high-quality math problem generation.Our code is publicly available at https://github.com/Icarus-1111/CogAtom.