SalaMAnder: Shapley-based Mathematical Expression Attribution and Metric for Chain-of-Thought Reasoning

作者: Yue Xin, Chen Shen, Shaotian Yan, Xiaosong Yuan, Yaoming Wang, Xiaofeng Zhang, Chenxi Huang, Jieping Ye

分类: cs.AI, cs.CL

发布日期: 2025-09-20

备注: accpeted by EMNLP 2025

💡 一句话要点

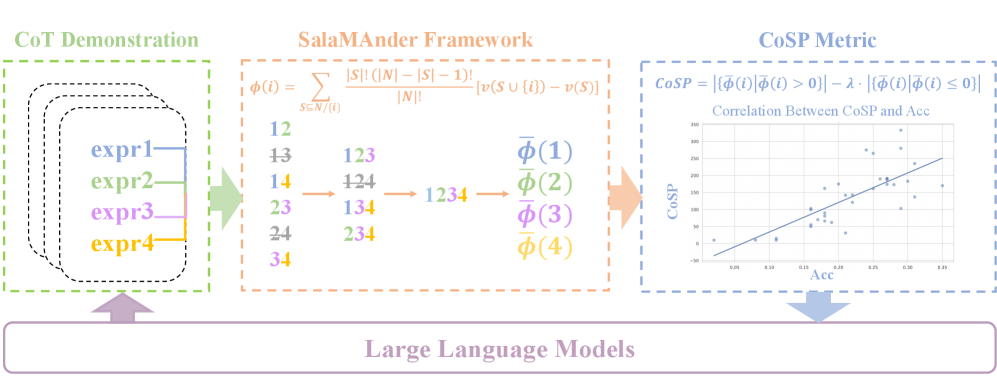

提出SalaMAnder,基于Shapley值评估CoT推理中数学表达式的贡献度,并优化提示构建。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 链式思考 Shapley值 数学推理 大语言模型 可解释性 提示工程 表达式归因

📋 核心要点

- 现有研究对CoT提升LLM数学推理能力的机制缺乏深入理解,组件贡献度难以量化。

- 利用Shapley值进行数学表达式归因,并通过分层抽样降低计算复杂度,提出CoSP指标。

- 实验表明CoSP指标与模型性能具有单调相关性,为CoT的成功提供理论解释,并优化提示构建。

📝 摘要(中文)

本文提出SalaMAnder,一个理论驱动的方法和一个数学上严谨的评估指标,用于量化少样本CoT推理中组件级别的贡献。具体而言,我们利用Shapley值进行数学表达式归因,并开发了一种高效的分层抽样算法,显著降低了计算复杂度。此外,我们通过协方差分析开发了CoSP(Shapley正值的基数)指标。在流行的LLM模型和不同的数学基准上的综合验证表明,SalaMAnder框架内的CoSP指标与模型性能表现出稳健的单调相关性,不仅为现有少样本CoT的经验成功提供了理论解释,而且为提示构建优化建立了数学上严谨的原则。此外,我们验证了解释的可靠性,并在此基础上统一了先前工作的见解。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)中,链式思考(CoT)提示如何提升数学推理能力这一问题。现有方法缺乏对CoT内部机制的深入理解,无法有效量化CoT中各个组成部分(例如,数学表达式)对最终推理结果的贡献程度。这使得优化CoT提示变得困难,缺乏理论指导。

核心思路:论文的核心思路是利用Shapley值来量化CoT推理过程中每个数学表达式的贡献度。Shapley值是一种合作博弈论中的概念,可以公平地分配合作产生的收益。在这里,每个数学表达式被视为一个参与者,CoT推理的正确性被视为合作产生的收益。通过计算每个表达式的Shapley值,可以评估其对最终结果的重要性。此外,论文还提出了CoSP指标,用于衡量Shapley正值的基数,从而进一步分析CoT的有效性。

技术框架:SalaMAnder框架主要包含以下几个阶段: 1. CoT推理:使用LLM和CoT提示生成推理过程。 2. 数学表达式提取:从CoT推理过程中提取所有数学表达式。 3. Shapley值计算:使用分层抽样算法计算每个数学表达式的Shapley值。分层抽样旨在减少计算复杂度,提高效率。 4. CoSP指标计算:基于Shapley值计算CoSP指标,用于评估CoT的整体有效性。 5. 性能评估:将CoSP指标与模型性能进行比较,验证其相关性。

关键创新:论文的关键创新在于: 1. 将Shapley值应用于CoT推理的数学表达式归因:这是首次尝试使用博弈论的方法来理解CoT的内部机制。 2. 高效的分层抽样算法:该算法显著降低了Shapley值计算的复杂度,使其在实际应用中可行。 3. CoSP指标:该指标提供了一种新的方式来评估CoT的有效性,并与模型性能具有很强的相关性。

关键设计:论文的关键设计包括: 1. 分层抽样策略:为了降低计算复杂度,论文采用了一种分层抽样策略。具体来说,将所有数学表达式分成不同的层,然后从每一层中随机抽取一部分表达式进行Shapley值计算。这种策略可以有效地减少计算量,同时保证结果的准确性。 2. CoSP指标的定义:CoSP指标定义为Shapley正值的基数,即对最终结果有积极贡献的数学表达式的数量。该指标可以反映CoT推理过程中关键步骤的数量,从而评估其有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SalaMAnder框架内的CoSP指标与模型性能表现出稳健的单调相关性。这意味着CoSP指标可以有效地预测CoT提示的有效性。此外,实验还验证了解释的可靠性,并在此基础上统一了先前工作的见解。具体性能数据和对比基线在原文中提供。

🎯 应用场景

该研究成果可应用于提升大型语言模型在数学、科学等领域的推理能力。通过SalaMAnder框架,可以优化CoT提示的构建,提高模型性能。此外,该方法还可以用于分析其他类型的推理过程,例如代码生成、逻辑推理等,具有广泛的应用前景。

📄 摘要(原文)

Chain-of-Thought (CoT) prompting enhances the math reasoning capability of large language models (LLMs) to a large margin. However, the mechanism underlying such improvements remains unexplored. In this paper, we present \textbf{SalaMAnder} (\textbf{S}h\textbf{a}p\textbf{l}ey-b\textbf{a}sed \textbf{M}athematical Expression \textbf{A}ttribution a\textbf{nd} M\textbf{e}t\textbf{r}ic), a theoretically grounded methodology as well as a mathematically rigorous evaluation metric for quantifying component-level contributions in few-shot CoT reasoning. Concretely, we leverage the Shapley value for mathematical expression attribution and develop an efficient stratified sampling algorithm that significantly reduces the computational complexity. Besides, we develop the \textbf{CoSP} (\textbf{C}ardinality \textbf{o}f \textbf{S}hapley \textbf{P}ositives) metric through covariance analysis. Comprehensive validation across popular LLM models and diverse mathematical benchmarks demonstrates that the CoSP metric within our SalaMAnder framework exhibits a robust monotonic correlation with model performance, not only providing theoretical explanations for the empirical success of existing few-shot CoT but also establishing mathematically rigorous principles for prompt construction optimization. Furthermore, we verify the reliability of the explanation, based on which we unify the insights of previous work.