Modelling the Interplay of Eye-Tracking Temporal Dynamics and Personality for Emotion Detection in Face-to-Face Settings

作者: Meisam J. Seikavandi, Jostein Fimland, Fabricio Batista Narcizo, Maria Barrett, Ted Vucurevich, Jesper Bünsow Boldt, Andrew Burke Dittberner, Paolo Burelli

分类: cs.HC, cs.AI, cs.CV

发布日期: 2025-09-19

💡 一句话要点

提出融合眼动时序、人格特质和情境线索的多模态情感识别框架,提升人机交互体验。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感识别 眼动追踪 多模态融合 人格特质 人机交互

📋 核心要点

- 现有情感识别方法在动态对话场景中表现不足,难以捕捉情绪的细微变化和个体差异。

- 论文提出融合眼动时序动态、人格特质和情境刺激线索的多模态框架,区分感知和感受情绪。

- 实验结果表明,该方法在感知情绪和感受情绪识别上均优于基线模型,提升了情感识别的准确性。

📝 摘要(中文)

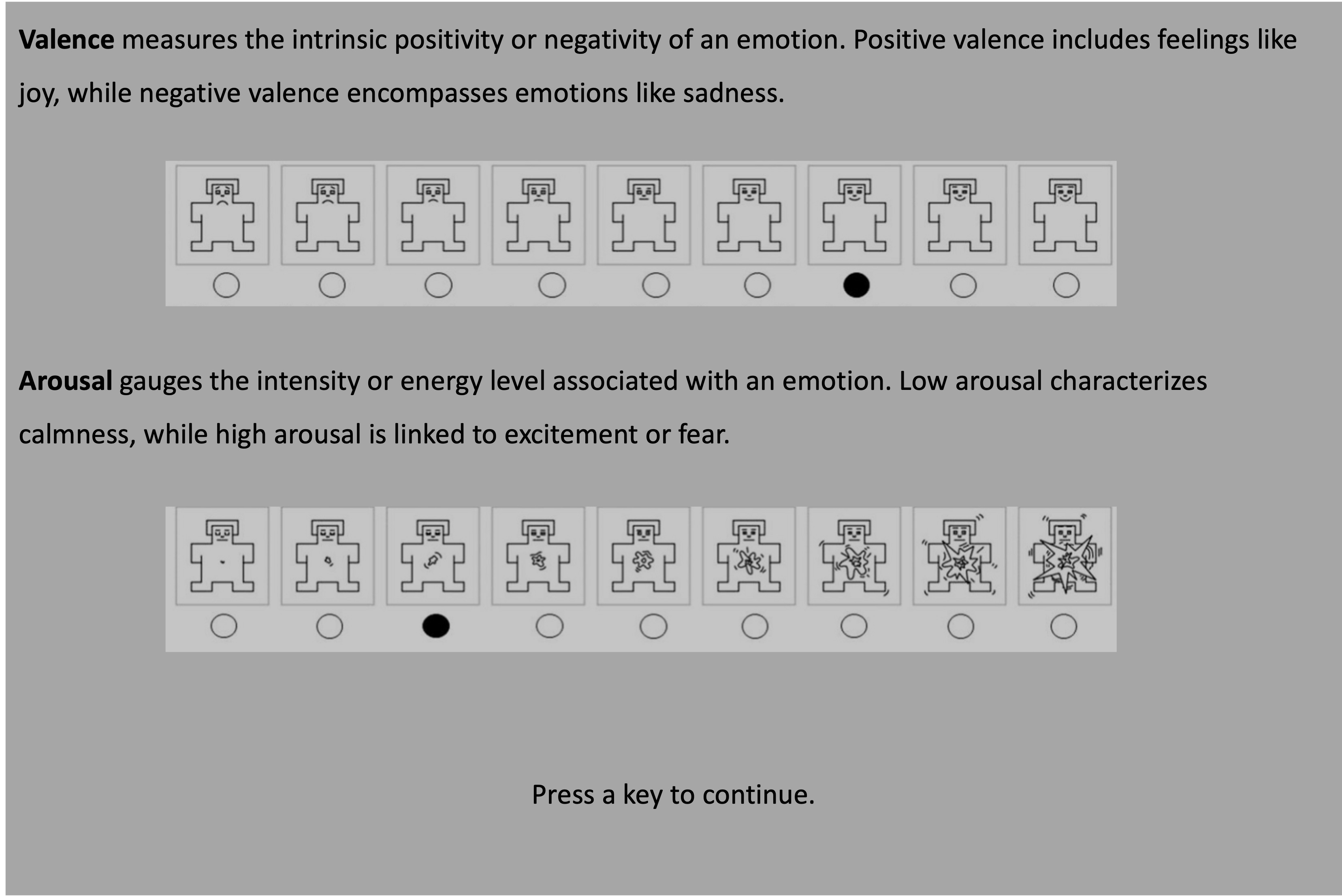

为了实现自适应人机交互,准确识别人类情感至关重要,但在动态的、类似对话的环境中仍然具有挑战性。本文提出了一个人格感知的多模态框架,该框架集成了眼动追踪序列、大五人格特质和情境刺激线索,以预测感知和感受到的情绪。研究中,73名参与者观看了CREMA-D数据集中的包含语音的片段,同时提供了眼动信号、人格评估和情绪评分。我们的神经模型捕获了时间注视动态,并将它们与特质和刺激信息融合,从而始终优于SVM和文献基线。结果表明,(i)刺激线索强烈地增强了感知情绪预测(宏F1值高达0.77),而(ii)人格特质为感受情绪识别提供了最大的改进(宏F1值高达0.58)。这些发现突出了结合生理、特质和情境信息来解决情绪的内在主观性的好处。通过区分感知和感受到的反应,我们的方法推进了多模态情感计算,并指向了更加个性化和生态有效的、情感感知的系统。

🔬 方法详解

问题定义:论文旨在解决在动态人际交互场景中,准确识别个体的情绪状态这一问题。现有方法通常忽略了个体的人格差异以及情境因素对情绪表达的影响,导致情感识别的准确率不高,尤其是在区分“感知情绪”和“感受情绪”时表现不足。

核心思路:论文的核心思路是结合个体的生理信号(眼动追踪)、心理特征(人格特质)以及外部环境刺激(语音片段)等多模态信息,构建一个更加全面和个性化的情感识别模型。通过融合这些信息,模型能够更好地理解个体的情绪状态,并区分其感知到的情绪和实际感受到的情绪。

技术框架:该框架包含以下几个主要模块:1) 数据采集模块:收集参与者的眼动追踪数据、人格评估数据(大五人格)以及观看语音片段时的情绪评分数据。2) 特征提取模块:从眼动追踪数据中提取时序特征,例如注视持续时间、扫视频率等;从语音片段中提取声学特征。3) 多模态融合模块:将提取的眼动特征、人格特质和语音特征进行融合,形成一个综合的特征向量。4) 情感预测模块:使用神经网络模型(具体结构未知)对融合后的特征向量进行分类,预测个体的情绪状态(感知情绪和感受情绪)。

关键创新:该论文的关键创新在于:1) 区分了“感知情绪”和“感受情绪”,并分别进行建模,更符合实际情况。2) 将人格特质纳入情感识别模型中,考虑了个体差异对情绪表达的影响。3) 融合了眼动追踪、人格特质和情境刺激等多模态信息,提高了情感识别的准确率。

关键设计:论文中关于神经网络的具体结构、损失函数以及参数设置等技术细节没有详细描述,属于未知信息。但可以推测,模型可能采用了循环神经网络(RNN)或Transformer等擅长处理时序数据的结构来建模眼动追踪数据,并使用交叉熵损失函数进行训练。人格特质可能被作为模型的输入特征,或者通过注意力机制等方式与眼动特征和语音特征进行融合。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在感知情绪预测方面,宏F1值高达0.77,显著优于基线模型。人格特质的引入为感受情绪识别带来了最大的改进,宏F1值高达0.58。这些结果验证了融合眼动时序、人格特质和情境线索的多模态框架在情感识别方面的有效性。

🎯 应用场景

该研究成果可应用于多个领域,如人机交互、心理咨询、教育和医疗保健。例如,在人机交互中,系统可以根据用户的情绪状态调整交互方式,提供更个性化的服务。在心理咨询中,可以辅助咨询师了解患者的真实情绪,提高咨询效果。在教育领域,教师可以根据学生的情绪状态调整教学策略,提高教学质量。

📄 摘要(原文)

Accurate recognition of human emotions is critical for adaptive human-computer interaction, yet remains challenging in dynamic, conversation-like settings. This work presents a personality-aware multimodal framework that integrates eye-tracking sequences, Big Five personality traits, and contextual stimulus cues to predict both perceived and felt emotions. Seventy-three participants viewed speech-containing clips from the CREMA-D dataset while providing eye-tracking signals, personality assessments, and emotion ratings. Our neural models captured temporal gaze dynamics and fused them with trait and stimulus information, yielding consistent gains over SVM and literature baselines. Results show that (i) stimulus cues strongly enhance perceived-emotion predictions (macro F1 up to 0.77), while (ii) personality traits provide the largest improvements for felt emotion recognition (macro F1 up to 0.58). These findings highlight the benefit of combining physiological, trait-level, and contextual information to address the inherent subjectivity of emotion. By distinguishing between perceived and felt responses, our approach advances multimodal affective computing and points toward more personalized and ecologically valid emotion-aware systems.