SENSE-7: Taxonomy and Dataset for Measuring User Perceptions of Empathy in Sustained Human-AI Conversations

作者: Jina Suh, Lindy Le, Erfan Shayegani, Gonzalo Ramos, Judith Amores, Desmond C. Ong, Mary Czerwinski, Javier Hernandez

分类: cs.HC, cs.AI

发布日期: 2025-09-19

💡 一句话要点

提出SENSE-7数据集和移情分类器,用于衡量用户在人机对话中对AI移情的感知

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 移情 大型语言模型 用户感知 数据集 情感计算 对话系统

📋 核心要点

- 现有数字移情方法侧重于模拟人类情感,忽略了用户感知的移情的主观性和情境性。

- 提出以人为中心的移情分类法,强调可观察的行为,并构建包含用户标注的SENSE-7数据集。

- 实验表明移情判断高度个体化和情境敏感,并验证了LLM分类器识别移情水平的潜力。

📝 摘要(中文)

移情在人机交流中日益重要,但传统的“数字移情”方法侧重于模拟内部的、类人的情感状态,忽略了用户感知的移情的主观性、情境性和关系性。本文提出了一个以人为中心的分类法,强调可观察的移情行为,并引入了一个新的数据集Sense-7,包含信息工作者与大型语言模型(LLM)之间的真实对话,其中包括来自用户的每轮移情标注、用户特征和上下文细节,从而提供了更以用户为基础的移情表示。对来自109名参与者的695次对话的分析表明,移情判断具有高度的个体化、情境敏感性,并且容易在对话连续性失败或用户期望未得到满足时受到干扰。为了促进进一步的研究,我们提供了一个包含672个匿名对话的子集,并进行了探索性分类分析,表明基于LLM的分类器可以识别5个移情级别,平均Spearman相关系数ρ=0.369,准确率=0.487。总的来说,我们的发现强调了AI设计需要动态地根据用户情境和目标调整移情行为,为未来研究和以人为本的社交人工智能体的实际开发提供了路线图。

🔬 方法详解

问题定义:现有数字移情研究主要集中在让AI模拟人类的情感状态,而忽略了用户在实际人机交互中对AI移情的感知。这种感知是主观的、情境化的,并且受到对话历史和用户期望的影响。因此,如何准确衡量用户对AI移情的感知,并将其用于改进AI的设计,是一个亟待解决的问题。

核心思路:本文的核心思路是以用户为中心,关注AI在对话中表现出的可观察的移情行为,而不是AI内部的情感状态。通过构建包含用户标注的数据集,并分析用户对不同移情行为的感知,可以更好地理解用户对AI移情的期望,并指导AI的设计。

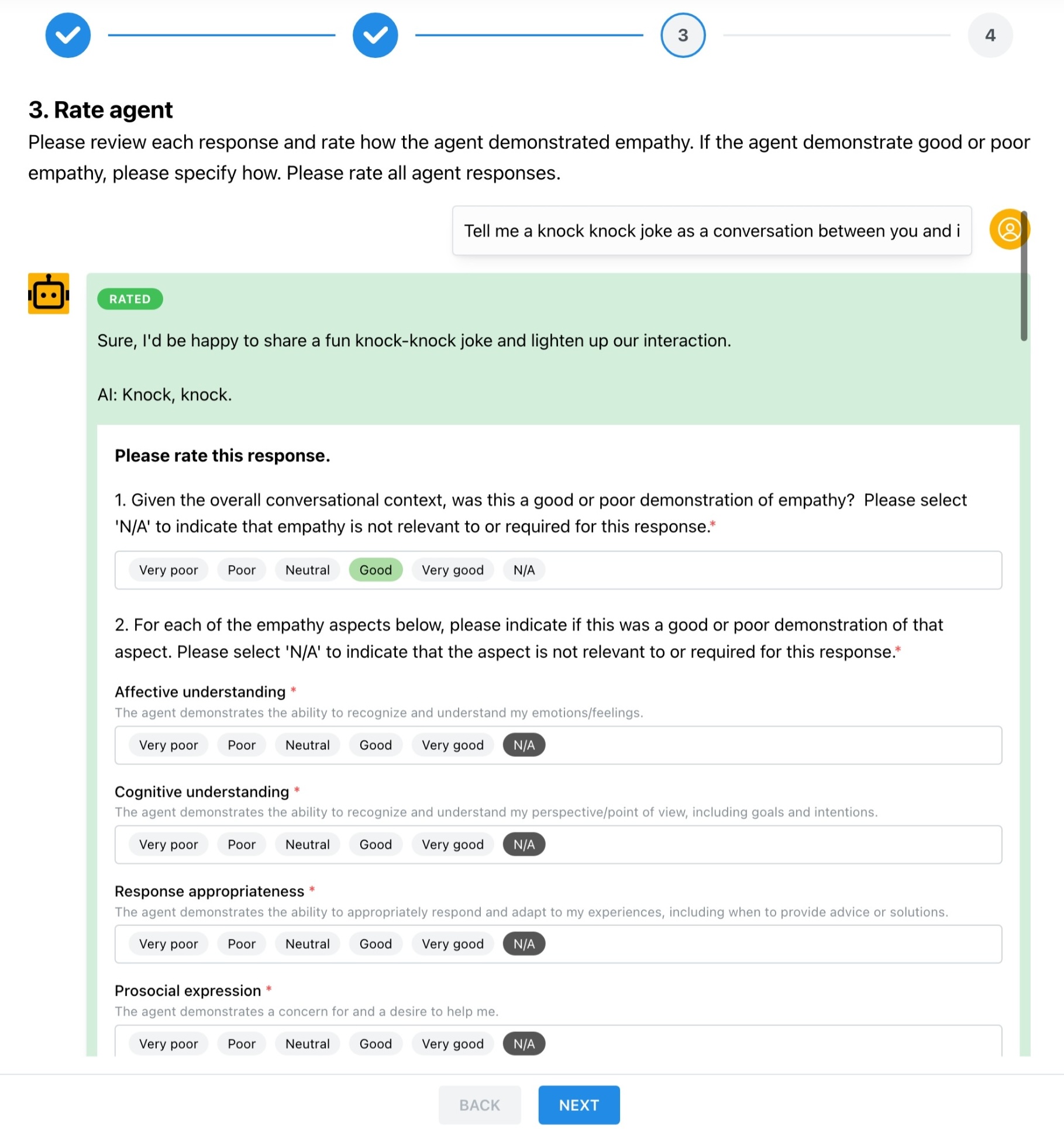

技术框架:本文主要包含两个部分:一是构建SENSE-7数据集,二是训练基于LLM的移情分类器。SENSE-7数据集包含信息工作者与LLM之间的真实对话,以及用户对每轮对话的移情标注、用户特征和上下文细节。基于SENSE-7数据集,本文训练了一个基于LLM的分类器,用于识别对话中不同级别的移情。

关键创新:本文的关键创新在于提出了一个以人为中心的移情分类法,强调可观察的移情行为,并构建了包含用户标注的SENSE-7数据集。与以往的研究相比,本文更加关注用户对AI移情的感知,而不是AI内部的情感状态。

关键设计:SENSE-7数据集包含695个对话,来自109名参与者。每个对话都包含用户与LLM之间的多轮交互,以及用户对每轮交互的移情标注。移情标注分为5个级别,从“完全没有移情”到“非常移情”。基于SENSE-7数据集,本文使用预训练的LLM(具体模型未知)进行微调,以训练移情分类器。损失函数和网络结构等技术细节未在论文中详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于LLM的分类器可以识别5个移情级别,平均Spearman相关系数ρ=0.369,准确率=0.487。虽然性能还有提升空间,但这些结果表明,LLM具有识别和理解用户对AI移情感知的潜力。此外,研究还发现,移情判断具有高度的个体化和情境敏感性,这强调了AI设计需要动态地根据用户情境和目标调整移情行为。

🎯 应用场景

该研究成果可应用于开发更具同理心的人工智能助手,例如在客户服务、医疗保健和教育等领域。通过理解用户对AI移情的感知,可以设计出能够更好地满足用户需求、建立信任关系并提高用户满意度的AI系统。未来的研究可以进一步探索不同用户群体对AI移情的不同期望,并开发更加个性化的AI移情策略。

📄 摘要(原文)

Empathy is increasingly recognized as a key factor in human-AI communication, yet conventional approaches to "digital empathy" often focus on simulating internal, human-like emotional states while overlooking the inherently subjective, contextual, and relational facets of empathy as perceived by users. In this work, we propose a human-centered taxonomy that emphasizes observable empathic behaviors and introduce a new dataset, Sense-7, of real-world conversations between information workers and Large Language Models (LLMs), which includes per-turn empathy annotations directly from the users, along with user characteristics, and contextual details, offering a more user-grounded representation of empathy. Analysis of 695 conversations from 109 participants reveals that empathy judgments are highly individualized, context-sensitive, and vulnerable to disruption when conversational continuity fails or user expectations go unmet. To promote further research, we provide a subset of 672 anonymized conversation and provide exploratory classification analysis, showing that an LLM-based classifier can recognize 5 levels of empathy with an encouraging average Spearman $ρ$=0.369 and Accuracy=0.487 over this set. Overall, our findings underscore the need for AI designs that dynamically tailor empathic behaviors to user contexts and goals, offering a roadmap for future research and practical development of socially attuned, human-centered artificial agents.