Structured Information for Improving Spatial Relationships in Text-to-Image Generation

作者: Sander Schildermans, Chang Tian, Ying Jiao, Marie-Francine Moens

分类: cs.AI

发布日期: 2025-09-19

备注: text-to-image generation, structured information, spatial relationship

💡 一句话要点

提出一种轻量级结构化信息增强方法,提升文本到图像生成中空间关系准确性。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 文本到图像生成 空间关系 结构化信息 提示词增强 语言模型微调

📋 核心要点

- 文本到图像生成在空间关系理解方面存在挑战,难以准确捕捉自然语言提示词中描述的空间关系。

- 论文提出利用元组结构的结构化信息增强提示词,通过微调语言模型自动生成,提升空间关系表达。

- 实验表明,该方法显著提高了空间准确性,且不影响整体图像质量,自动生成元组质量可与人工设计媲美。

📝 摘要(中文)

本文提出了一种轻量级方法,通过元组结构的结构化信息增强提示词,以改善文本到图像(T2I)生成中空间关系的准确性。该方法使用微调的语言模型自动转换自然语言提示词为结构化元组,并无缝集成到T2I流程中。实验结果表明,该方法在不影响Inception Score衡量的整体图像质量的前提下,显著提高了空间准确性。此外,自动生成的元组质量与人工设计的元组相当。这种结构化信息为增强T2I生成中的空间关系提供了一种实用且可移植的解决方案,解决了当前大型生成系统的一个关键限制。

🔬 方法详解

问题定义:文本到图像生成模型难以准确理解和生成符合自然语言描述的空间关系,例如“左边的猫”和“右边的狗”。现有方法在处理复杂空间关系时表现不佳,导致生成的图像在物体布局上与文本描述不符。

核心思路:核心思路是将自然语言提示词转换为结构化的元组信息,例如(object1, relation, object2),从而显式地表达物体之间的空间关系。通过这种方式,模型可以更准确地理解提示词中的空间信息,并生成符合描述的图像。

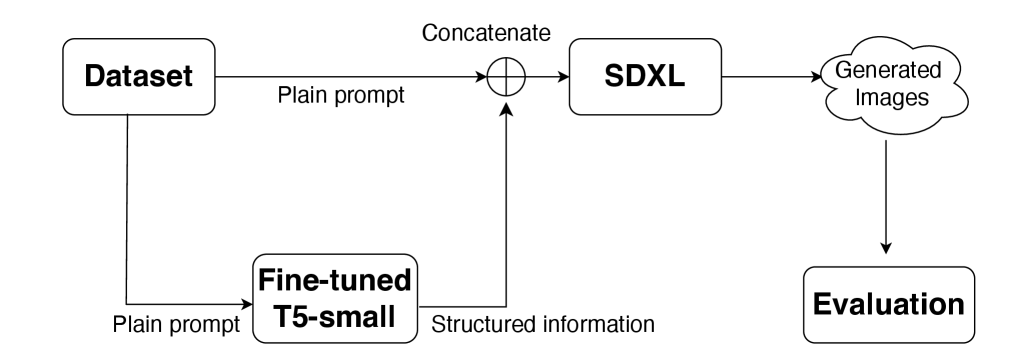

技术框架:该方法包含以下几个主要步骤:1) 使用微调的语言模型将自然语言提示词转换为元组形式的结构化信息。2) 将生成的元组信息与原始文本提示词结合,作为T2I模型的输入。3) 使用T2I模型生成图像。整个框架的关键在于语言模型的微调,使其能够准确地提取和表示空间关系。

关键创新:该方法的主要创新在于使用轻量级的结构化信息(元组)来增强提示词,从而提高空间关系的准确性。与需要大量计算资源或复杂网络结构的现有方法相比,该方法更加简单、高效且易于集成到现有的T2I流程中。

关键设计:论文使用微调的语言模型(具体模型未知)来生成元组。微调的目标是使语言模型能够准确地识别和提取提示词中的物体和它们之间的空间关系。具体的损失函数和训练细节未知。此外,如何将生成的元组信息有效地融入到T2I模型的输入中也是一个关键设计,具体实现方式未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在空间准确性方面取得了显著提升,同时保持了良好的图像质量(通过Inception Score衡量)。自动生成的元组质量与人工设计的元组相当,证明了该方法的有效性和实用性。具体的性能提升数据未知,但摘要中明确指出是“substantial improvements”。

🎯 应用场景

该研究成果可应用于各种需要精确空间关系控制的图像生成场景,例如:电商产品展示图生成(确保商品摆放位置符合描述)、室内设计图生成(根据用户描述生成房间布局)、游戏场景生成(根据文本描述生成游戏地图)。该方法有望提升生成图像的真实感和用户满意度,并为更高级的文本到场景生成任务奠定基础。

📄 摘要(原文)

Text-to-image (T2I) generation has advanced rapidly, yet faithfully capturing spatial relationships described in natural language prompts remains a major challenge. Prior efforts have addressed this issue through prompt optimization, spatially grounded generation, and semantic refinement. This work introduces a lightweight approach that augments prompts with tuple-based structured information, using a fine-tuned language model for automatic conversion and seamless integration into T2I pipelines. Experimental results demonstrate substantial improvements in spatial accuracy, without compromising overall image quality as measured by Inception Score. Furthermore, the automatically generated tuples exhibit quality comparable to human-crafted tuples. This structured information provides a practical and portable solution to enhance spatial relationships in T2I generation, addressing a key limitation of current large-scale generative systems.