THOR: Tool-Integrated Hierarchical Optimization via RL for Mathematical Reasoning

作者: Qikai Chang, Zhenrong Zhang, Pengfei Hu, Jun Du, Jiefeng Ma, Yicheng Pan, Jianshu Zhang, Quan Liu, Jianqing Gao

分类: cs.AI, cs.CL

发布日期: 2025-09-17 (更新: 2025-10-03)

备注: 22 pages, 13 figures

🔗 代码/项目: GITHUB

💡 一句话要点

THOR:基于强化学习的工具集成层次优化,提升数学推理能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学推理 工具集成 强化学习 层次优化 自我纠正 大型语言模型 多智能体 Actor-Critic

📋 核心要点

- 现有方法在构建高质量的工具集成推理数据、进行细粒度优化以及增强推理能力方面存在不足。

- THOR通过强化学习进行工具集成层次优化,联合优化episode级别的问题解决和step级别的代码生成。

- 实验表明,THOR在数学和代码基准测试中均取得了显著的性能提升,并在不同模型中表现出良好的泛化能力。

📝 摘要(中文)

大型语言模型(LLMs)在数学推理方面取得了显著进展,但在数值计算和形式符号操作等高精度任务中仍然面临挑战。集成外部工具已成为弥合这一差距的有希望的方法。然而,现有方法在构建工具集成推理数据、执行细粒度优化和增强推理方面存在局限性。为了克服这些限制,我们提出了THOR(Tool-Integrated Hierarchical Optimization via RL)。首先,我们引入了TIRGen,这是一个基于多智能体Actor-Critic的pipeline,用于构建高质量的工具集成推理路径数据集,与策略对齐并在不同模型中泛化。其次,为了执行细粒度的层次优化,我们引入了一种RL策略,该策略联合优化episode级别的问题解决和step级别的代码生成。这是基于我们的关键洞察力,即中间工具调用的成功是最终答案正确性的有力预测指标。最后,THOR结合了一种自我纠正机制,该机制利用即时工具反馈来动态修改推理过程中的错误推理路径。我们的方法在不同的模型中表现出强大的泛化能力,在推理和非推理模型中均有效。它还在多个数学基准测试中为类似规模的模型实现了最先进的性能,同时在代码基准测试中也提供了持续的改进。

🔬 方法详解

问题定义:现有的大型语言模型在数学推理任务中,尤其是在需要高精度计算和符号操作的任务中表现不佳。虽然集成外部工具是一种有效的解决方案,但现有方法在数据构建、优化粒度和推理能力上存在瓶颈,难以充分利用工具的潜力。

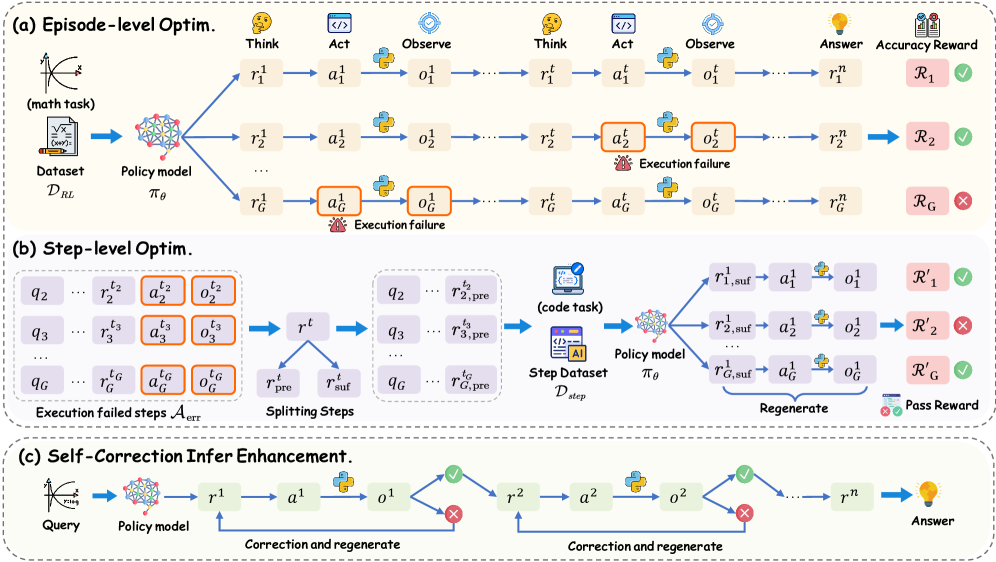

核心思路:THOR的核心思路是利用强化学习,对工具集成推理过程进行层次化的优化。通过将问题解决过程分解为episode级别和step级别,并分别进行优化,可以更有效地利用工具,提高推理的准确性和效率。同时,利用工具的即时反馈进行自我纠正,进一步提升推理的鲁棒性。

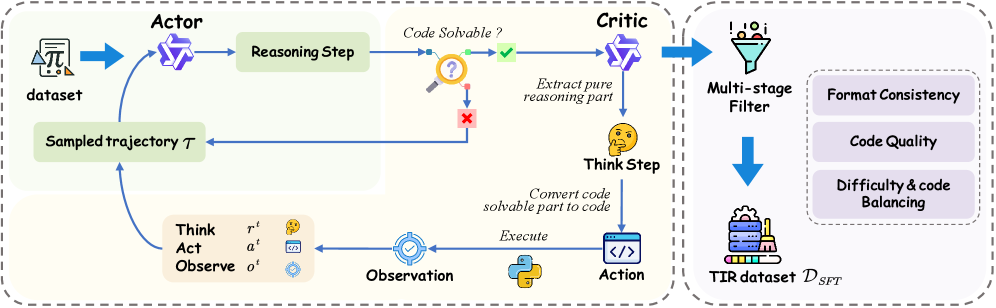

技术框架:THOR包含三个主要组成部分:TIRGen(用于生成高质量的工具集成推理数据)、层次化强化学习优化策略和自我纠正机制。TIRGen使用多智能体Actor-Critic框架生成数据。层次化强化学习策略同时优化episode级别的问题解决和step级别的代码生成。自我纠正机制利用工具的反馈动态修改推理路径。

关键创新:THOR的关键创新在于其层次化的强化学习优化策略和自我纠正机制。层次化优化允许模型更细粒度地学习如何有效地使用工具,而自我纠正机制则提高了模型的鲁棒性。此外,TIRGen的引入解决了工具集成推理数据不足的问题。

关键设计:TIRGen使用多智能体Actor-Critic框架,其中每个智能体负责生成推理路径中的一个步骤。层次化强化学习策略使用奖励函数来鼓励模型生成正确的答案,并惩罚模型生成错误的答案。自我纠正机制使用工具的反馈来判断推理路径是否正确,并根据需要进行修改。具体的损失函数和网络结构细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

THOR在多个数学基准测试中取得了state-of-the-art的性能,超越了同等规模的模型。此外,THOR在代码基准测试中也取得了持续的改进,证明了其在不同领域的泛化能力。实验结果表明,THOR能够有效地利用外部工具,提高推理的准确性和效率。

🎯 应用场景

THOR的研究成果可以应用于各种需要复杂推理和计算的场景,例如科学研究、金融分析、软件开发等。通过集成外部工具,THOR可以帮助人们更有效地解决复杂问题,提高工作效率。未来,该技术有望进一步发展,实现更智能、更高效的自动化推理。

📄 摘要(原文)

Large Language Models (LLMs) have made remarkable progress in mathematical reasoning, but still continue to struggle with high-precision tasks like numerical computation and formal symbolic manipulation. Integrating external tools has emerged as a promising approach to bridge this gap. Despite recent advances, existing methods struggle with three key challenges: constructing tool-integrated reasoning data, performing fine-grained optimization, and enhancing inference. To overcome these limitations, we propose THOR (Tool-Integrated Hierarchical Optimization via RL). First, we introduce TIRGen, a multi-agent actor-critic-based pipeline for constructing high-quality datasets of tool-integrated reasoning paths, aligning with the policy and generalizing well across diverse models. Second, to perform fine-grained hierarchical optimization, we introduce an RL strategy that jointly optimizes for both episode-level problem solving and step-level code generation. This is motivated by our key insight that the success of an intermediate tool call is a strong predictor of the final answer's correctness. Finally, THOR incorporates a self-correction mechanism that leverages immediate tool feedback to dynamically revise erroneous reasoning paths during inference. Our approach demonstrates strong generalization across diverse models, performing effectively in both reasoning and non-reasoning models. It further achieves state-of-the-art performance for models of a similar scale on multiple mathematical benchmarks, while also delivering consistent improvements on code benchmarks. Our code will be publicly available at https://github.com/JingMog/THOR.