Beyond IVR Touch-Tones: Customer Intent Routing using LLMs

作者: Sergio Rojas-Galeano

分类: cs.HC, cs.AI, cs.CL, eess.AS

发布日期: 2025-09-14

备注: Accepted for publication in the Proceedings of the Workshop on Engineering Applications 2025 (WEA 2025)

💡 一句话要点

提出基于LLM的IVR意图路由方法,解决传统语音交互系统用户体验差的问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 交互式语音应答 大型语言模型 意图路由 自然语言处理 客户服务

📋 核心要点

- 传统IVR系统依赖触摸按键,用户体验差,而语音交互的关键在于将用户意图准确路由到IVR菜单路径。

- 利用LLM强大的语言理解能力,合成IVR结构和用户意图数据,并设计提示工程方法,实现意图路由。

- 实验表明,扁平化路径表示的准确率更高,在基础数据集上达到89.13%,证明了LLM在IVR意图路由中的潜力。

📝 摘要(中文)

针对传统交互式语音应答(IVR)系统用户体验差的问题,本文提出了一种基于大型语言模型(LLM)的意图路由方法。由于真实IVR结构和交互数据稀缺,我们首先利用三个不同的LLM合成了包含23个节点的IVR结构,并生成了920个用户意图(230个基础意图和690个增强意图)。然后,我们评估了两种提示设计:描述性分层菜单和扁平化路径表示,并分别在基础数据集和增强数据集上进行了测试。结果表明,扁平化路径表示始终能获得更高的准确率,在基础数据集上达到89.13%,而描述性格式为81.30%。数据增强引入了语言噪声,略微降低了性能。混淆矩阵分析表明,低性能的路由可能反映了菜单设计的冗余。总之,我们的研究证明了LLM可以通过更流畅的用户体验实现IVR路由,从而使客户服务比触摸音调菜单更进一步。

🔬 方法详解

问题定义:传统IVR系统依赖于用户通过按键选择菜单选项,这种方式效率低、用户体验差。语音交互是未来的发展方向,但如何将用户自然语言表达的意图准确地映射到IVR系统的菜单路径上是一个关键挑战。现有方法缺乏足够的真实IVR数据进行训练和评估,限制了LLM在该领域的应用。

核心思路:本文的核心思路是利用LLM的生成能力,首先合成一个逼真的IVR系统结构和相应的用户意图数据,然后利用LLM的理解能力,将用户意图路由到正确的IVR菜单路径。通过这种方式,可以克服数据稀缺的问题,并探索LLM在IVR意图路由中的潜力。

技术框架:整体框架包含三个主要阶段:1) IVR结构合成:使用LLM生成包含多个节点和分支的IVR菜单结构。2) 用户意图生成:基于合成的IVR结构,使用LLM生成用户可能表达的各种意图,包括基础意图和增强意图。3) 意图路由:设计不同的提示策略(描述性分层菜单和扁平化路径表示),利用LLM将用户意图路由到IVR菜单路径。

关键创新:最重要的创新点在于利用LLM进行IVR结构和用户意图的合成,从而解决了数据稀缺的问题。此外,对比了两种不同的提示策略,发现扁平化路径表示更有效。与传统方法相比,该方法无需人工标注大量数据,降低了成本,并提高了灵活性。

关键设计:在提示设计方面,论文比较了两种方法:描述性分层菜单,即以层级结构描述IVR菜单;扁平化路径表示,即将IVR路径表示为单个字符串。实验中使用了三个不同的LLM模型来完成IVR结构合成、用户意图生成和意图路由任务。具体模型名称和参数设置未知。

🖼️ 关键图片

📊 实验亮点

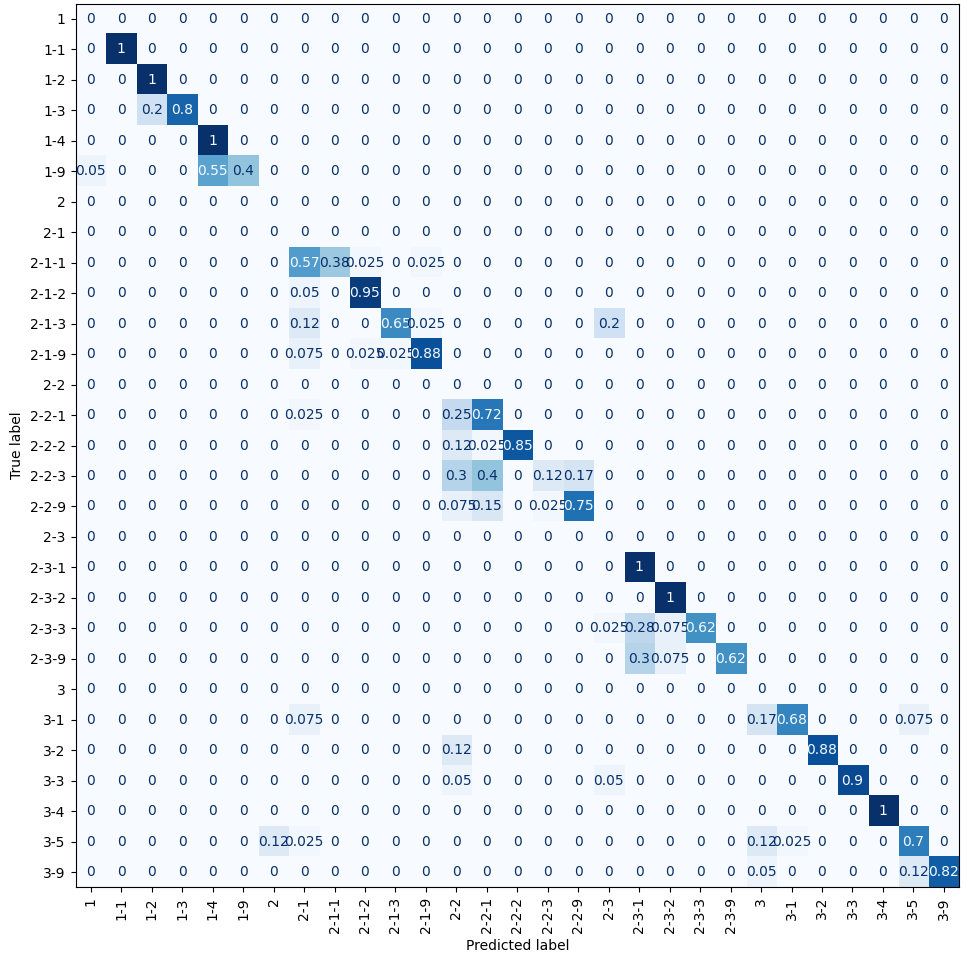

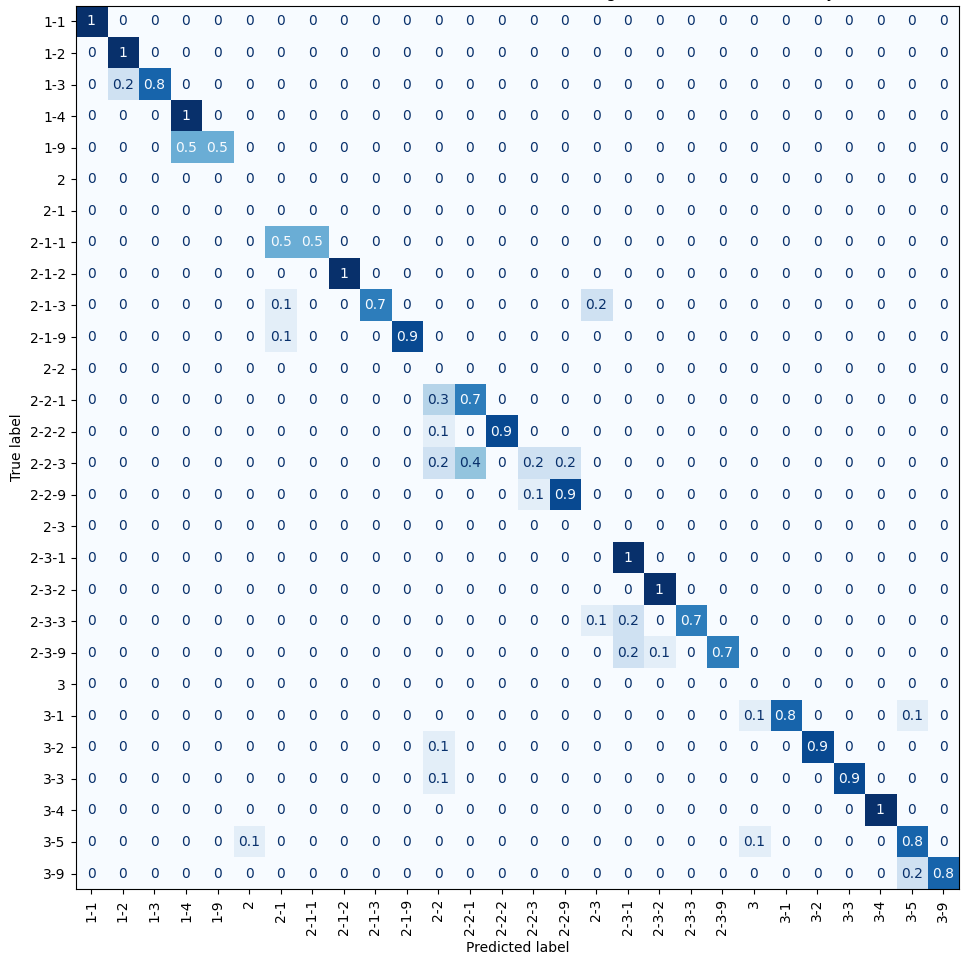

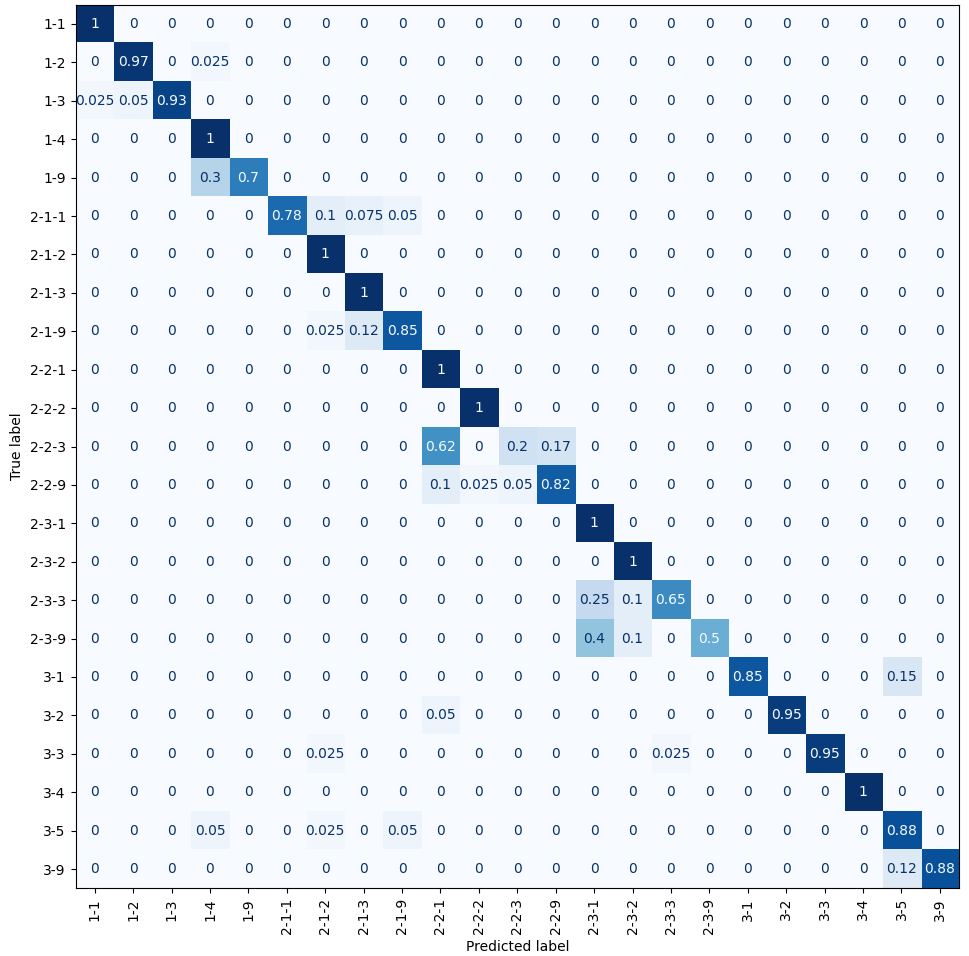

实验结果表明,使用扁平化路径表示方法,LLM在基础数据集上的意图路由准确率达到89.13%,显著高于描述性分层菜单方法(81.30%)。数据增强虽然引入了语言噪声,但整体性能仍然可观。混淆矩阵分析揭示了菜单设计冗余对路由性能的影响,为IVR系统优化提供了依据。

🎯 应用场景

该研究成果可应用于智能客服、语音助手等领域,提升用户与机器的交互体验。通过LLM驱动的IVR系统,用户可以用自然语言表达需求,系统自动将其路由到正确的服务路径,无需繁琐的按键操作。未来,该技术有望实现更智能、更个性化的客户服务。

📄 摘要(原文)

Widespread frustration with rigid touch-tone Interactive Voice Response (IVR) systems for customer service underscores the need for more direct and intuitive language interaction. While speech technologies are necessary, the key challenge lies in routing intents from user phrasings to IVR menu paths, a task where Large Language Models (LLMs) show strong potential. Progress, however, is limited by data scarcity, as real IVR structures and interactions are often proprietary. We present a novel LLM-based methodology to address this gap. Using three distinct models, we synthesized a realistic 23-node IVR structure, generated 920 user intents (230 base and 690 augmented), and performed the routing task. We evaluate two prompt designs: descriptive hierarchical menus and flattened path representations, across both base and augmented datasets. Results show that flattened paths consistently yield higher accuracy, reaching 89.13% on the base dataset compared to 81.30% with the descriptive format, while augmentation introduces linguistic noise that slightly reduces performance. Confusion matrix analysis further suggests that low-performing routes may reflect not only model limitations but also redundancies in menu design. Overall, our findings demonstrate proof-of-concept that LLMs can enable IVR routing through a smoother, more seamless user experience -- moving customer service one step ahead of touch-tone menus.