AgentArch: A Comprehensive Benchmark to Evaluate Agent Architectures in Enterprise

作者: Tara Bogavelli, Roshnee Sharma, Hari Subramani

分类: cs.AI, cs.CL, cs.MA

发布日期: 2025-09-13 (更新: 2026-01-06)

💡 一句话要点

提出AgentArch基准以评估企业中的智能体架构

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 智能体架构 多智能体系统 企业应用 性能评估 基准测试 设计维度 模型选择

📋 核心要点

- 现有研究多集中于智能体架构的单个组成部分,缺乏对不同设计维度相互作用的实证理解。

- 本研究提出了一个全面的基准,评估多种智能体配置在企业特定场景下的表现,涵盖多个关键维度。

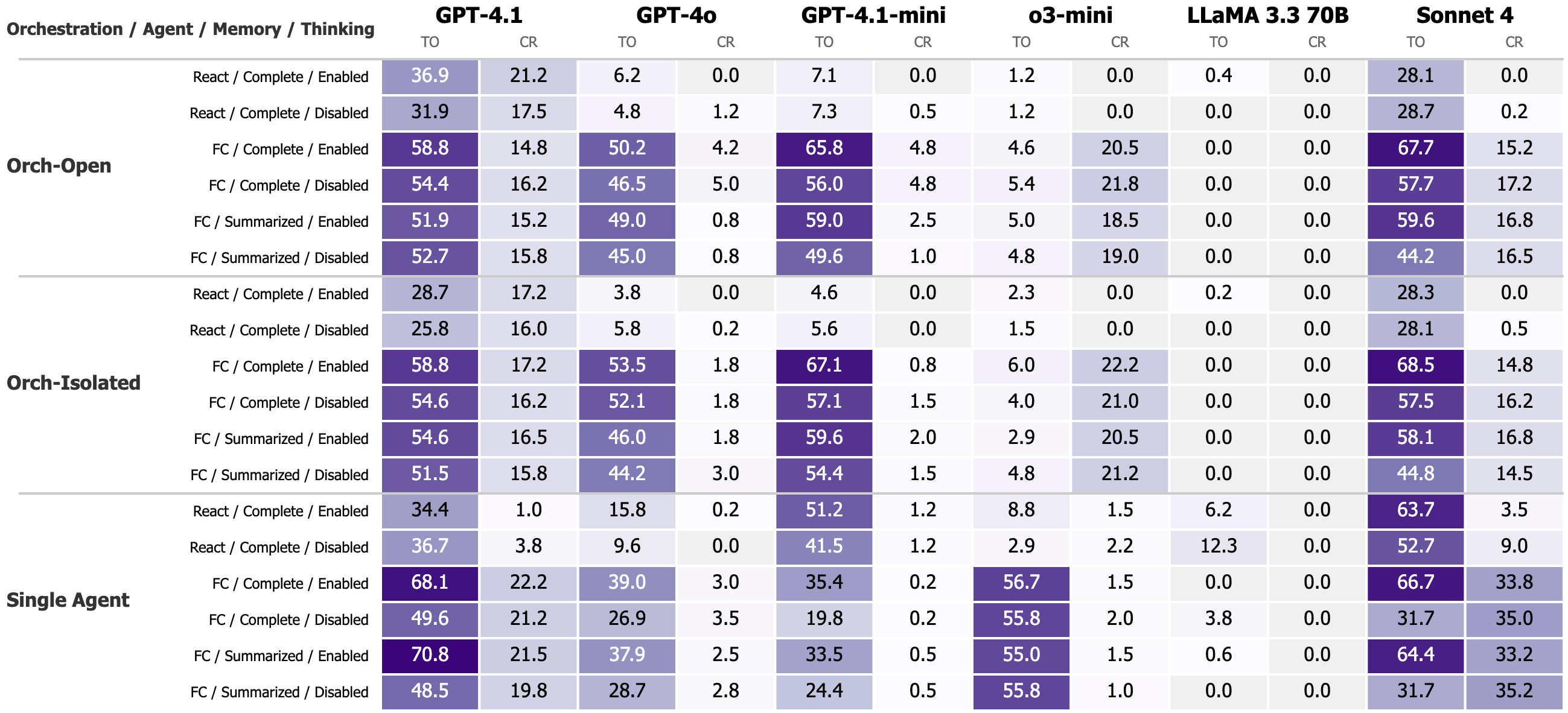

- 实验结果显示,当前智能体在复杂任务中的表现仍然有限,最高模型的成功率仅为35.3%,为未来设计提供了改进方向。

📝 摘要(中文)

尽管智能体架构的各个组成部分已被单独研究,但对不同设计维度在复杂多智能体系统中如何相互作用的实证理解仍然有限。本研究旨在通过提供一个全面的企业特定基准,评估18种不同的智能体配置,填补这些空白。我们考察了四个关键的智能体系统维度:编排策略、智能体提示实现(ReAct与函数调用)、记忆架构和思维工具集成。我们的基准揭示了显著的模型特定架构偏好,挑战了智能体AI系统中普遍存在的“一刀切”范式。研究还显示,在企业任务中整体智能体性能存在显著弱点,最高得分模型在更复杂任务上的成功率仅为35.3%,而在较简单任务上的成功率为70.8%。我们希望这些发现能够为未来智能体系统的设计提供更具实证依据的决策支持。

🔬 方法详解

问题定义:本研究旨在解决智能体架构在复杂多智能体系统中的设计维度相互作用理解不足的问题。现有方法往往忽视了不同架构配置对性能的影响,导致“一刀切”的设计策略。

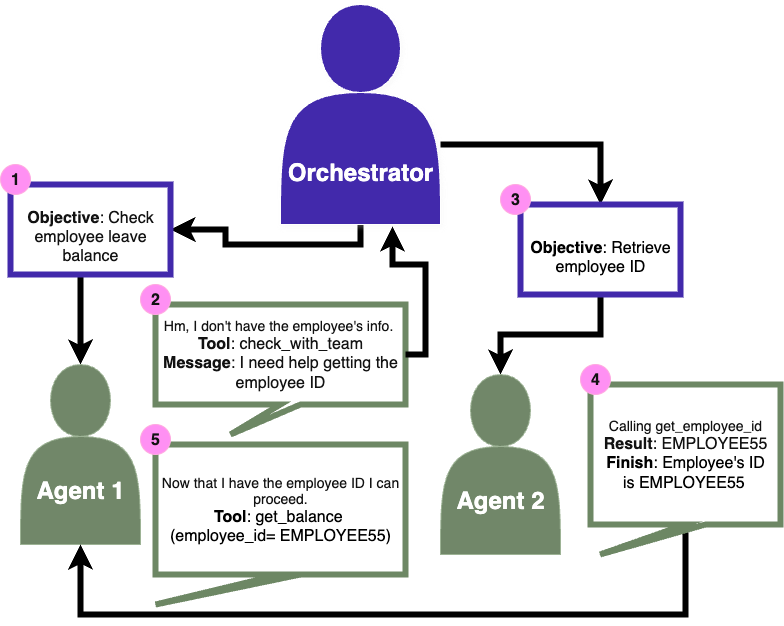

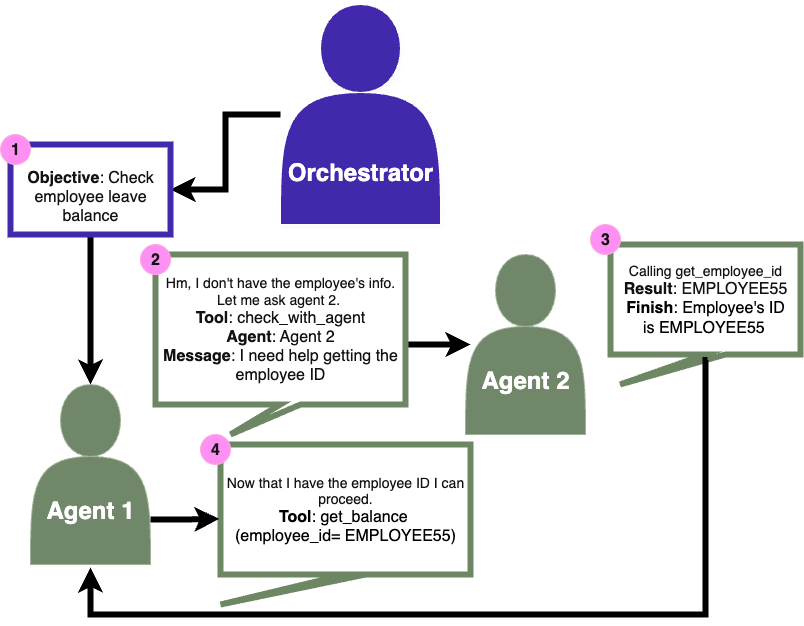

核心思路:论文通过构建一个企业特定的基准,评估18种不同的智能体配置,探索编排策略、提示实现、记忆架构和思维工具集成等维度的相互作用,从而为智能体系统的设计提供实证依据。

技术框架:研究采用了系统化的评估框架,首先定义了四个关键维度,然后通过对比实验评估不同配置的性能,最后分析模型特定的架构偏好。

关键创新:最重要的创新在于提出了一个全面的基准,能够系统性地评估智能体架构的多维度交互,挑战了传统的“一刀切”设计理念。

关键设计:在实验中,研究设置了多种参数,包括不同的编排策略和记忆架构,采用了ReAct与函数调用的提示实现方式,确保了评估的全面性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,最高得分模型在复杂任务上的成功率仅为35.3%,而在简单任务上的成功率为70.8%。这些数据表明当前智能体架构在企业任务中的表现存在显著不足,为未来的改进提供了方向。

🎯 应用场景

该研究的潜在应用领域包括企业智能体系统的设计与优化,尤其是在多智能体协作和任务执行方面。通过提供实证依据,研究能够帮助开发更高效的智能体架构,提升企业在复杂任务中的执行能力,具有重要的实际价值和未来影响。

📄 摘要(原文)

While individual components of agentic architectures have been studied in isolation, there remains limited empirical understanding of how different design dimensions interact within complex multi-agent systems. This study aims to address these gaps by providing a comprehensive enterprise-specific benchmark evaluating 18 distinct agentic configurations across state-of-the-art large language models. We examine four critical agentic system dimensions: orchestration strategy, agent prompt implementation (ReAct versus function calling), memory architecture, and thinking tool integration. Our benchmark reveals significant model-specific architectural preferences that challenge the prevalent one-size-fits-all paradigm in agentic AI systems. It also reveals significant weaknesses in overall agentic performance on enterprise tasks with the highest scoring models achieving a maximum of only 35.3\% success on the more complex task and 70.8\% on the simpler task. We hope these findings inform the design of future agentic systems by enabling more empirically backed decisions regarding architectural components and model selection.