Smart Trial: Evaluating the Use of Large Language Models for Recruiting Clinical Trial Participants via Social Media

作者: Xiaofan Zhou, Zisu Wang, Janice Krieger, Mohan Zalake, Lu Cheng

分类: cs.CY, cs.AI, cs.CL

发布日期: 2025-09-12

💡 一句话要点

提出TRIALQA数据集,评估大型语言模型在社交媒体上招募临床试验参与者的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 临床试验招募 大型语言模型 社交媒体分析 自然语言处理 医疗健康 TRIALQA数据集 资格标准判断

📋 核心要点

- 临床试验招募面临挑战,传统方法效率低且受限,难以触达潜在参与者。

- 利用大型语言模型理解社交媒体文本,识别潜在的临床试验参与者,提高招募效率。

- 构建TRIALQA数据集,包含社交媒体文本和人工标注,用于评估LLM在资格判断任务上的表现。

📝 摘要(中文)

临床试验(CT)对于推进医学研究和治疗至关重要,但高效招募符合条件的参与者仍然是一个重大挑战,因为每个参与者都必须满足复杂的资格标准。传统招募方法,如广告或医院内的电子健康记录筛选,通常耗时且受地域限制。本文通过利用个人在社交媒体平台上分享的大量健康相关信息来解决招募挑战。随着能够进行复杂文本理解的强大大型语言模型(LLM)的出现,我们提出了核心研究问题:LLM驱动的工具能否通过识别社交媒体上的潜在参与者来促进CT招募?为了研究这个问题,我们引入了TRIALQA,这是一个包含来自结肠癌和前列腺癌subreddit的两个社交媒体集合的新数据集。使用来自公共真实CT的资格标准,聘请经验丰富的注释员来注释TRIALQA,以表明(1)社交媒体用户是否符合给定的资格标准,以及(2)用户参与CT的理由。我们使用六种不同的训练和推理策略,对这两种预测任务中的七个广泛使用的LLM进行了基准测试。我们广泛的实验表明,虽然LLM显示出相当大的希望,但它们在执行准确评估资格标准所需的复杂的多跳推理方面仍然面临挑战。

🔬 方法详解

问题定义:论文旨在解决临床试验招募效率低下的问题。现有方法,如广告和电子病历筛选,耗时且地域受限,难以有效触达潜在参与者。社交媒体平台包含大量用户分享的健康相关信息,但如何利用这些信息来识别合适的临床试验参与者是一个挑战。现有方法缺乏有效利用社交媒体数据的能力,无法进行复杂的多跳推理来判断用户是否符合临床试验的资格标准。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大文本理解能力,分析社交媒体用户的帖子和评论,判断他们是否符合特定的临床试验资格标准。通过将临床试验的资格标准转化为自然语言描述,并利用LLM进行推理,可以自动识别潜在的临床试验参与者,从而提高招募效率。

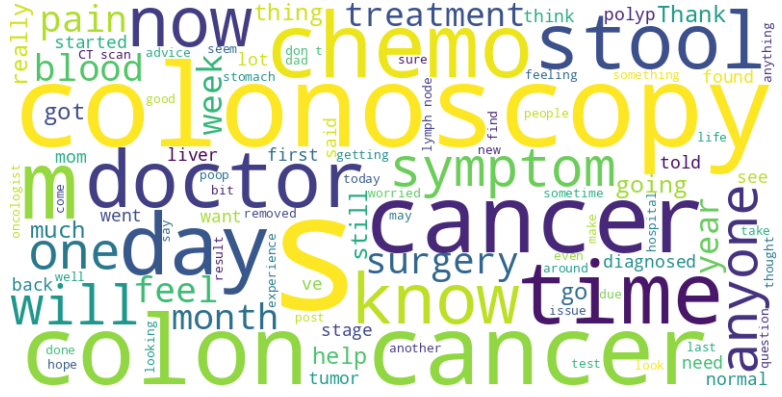

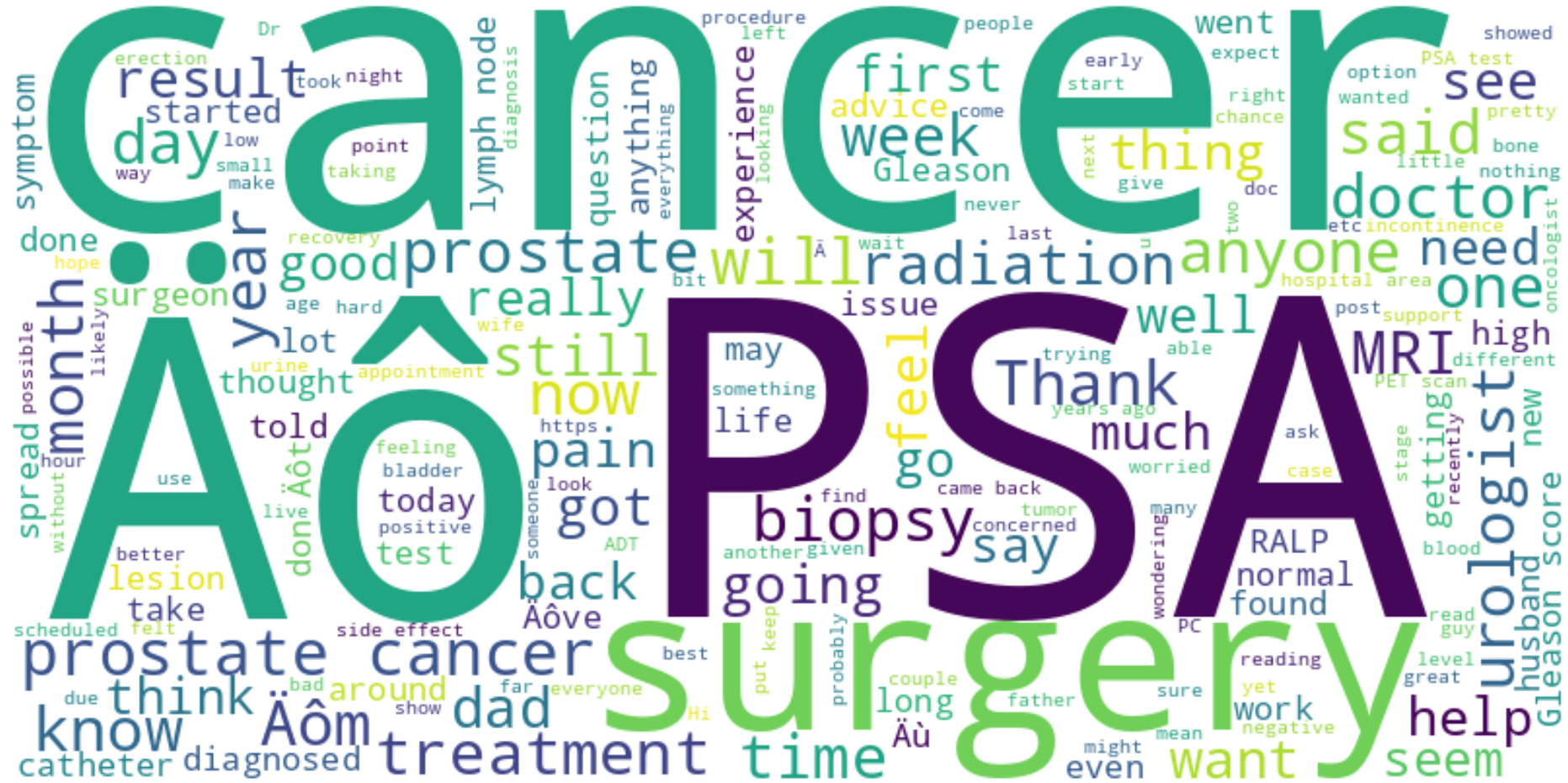

技术框架:论文构建了一个名为TRIALQA的数据集,用于评估LLM在临床试验招募任务中的表现。该数据集包含来自Reddit上结肠癌和前列腺癌subreddit的社交媒体帖子,以及人工标注的资格判断结果和参与理由。研究人员使用TRIALQA数据集对七个广泛使用的LLM进行了基准测试,采用了六种不同的训练和推理策略。整体流程包括数据收集、数据标注、模型训练和评估。

关键创新:论文的关键创新在于构建了TRIALQA数据集,这是一个专门用于评估LLM在临床试验招募任务中表现的数据集。该数据集包含真实世界的社交媒体数据和人工标注的资格判断结果,为研究人员提供了一个评估LLM性能的平台。此外,论文还探索了不同的训练和推理策略,以提高LLM在资格判断任务中的准确性。

关键设计:论文的关键设计包括:1) TRIALQA数据集的构建,包括数据来源的选择、数据清洗和人工标注流程的设计;2) 资格标准的自然语言描述,将复杂的医学术语转化为易于理解的自然语言;3) 不同的训练和推理策略,例如微调、提示学习等,以提高LLM的性能;4) 评估指标的选择,例如准确率、召回率等,以全面评估LLM在资格判断任务中的表现。

🖼️ 关键图片

📊 实验亮点

实验结果表明,虽然LLM在临床试验招募任务中显示出潜力,但在执行复杂的多跳推理以准确评估资格标准方面仍然面临挑战。不同LLM和训练策略的表现存在差异,表明需要进一步研究如何优化LLM在医疗健康领域的应用。TRIALQA数据集的发布为后续研究提供了基准和资源。

🎯 应用场景

该研究成果可应用于临床试验招募领域,通过分析社交媒体数据,自动识别潜在的临床试验参与者,提高招募效率,降低招募成本。此外,该技术还可以扩展到其他医疗健康领域,例如疾病风险预测、个性化健康建议等,具有广阔的应用前景。

📄 摘要(原文)

Clinical trials (CT) are essential for advancing medical research and treatment, yet efficiently recruiting eligible participants -- each of whom must meet complex eligibility criteria -- remains a significant challenge. Traditional recruitment approaches, such as advertisements or electronic health record screening within hospitals, are often time-consuming and geographically constrained. This work addresses the recruitment challenge by leveraging the vast amount of health-related information individuals share on social media platforms. With the emergence of powerful large language models (LLMs) capable of sophisticated text understanding, we pose the central research question: Can LLM-driven tools facilitate CT recruitment by identifying potential participants through their engagement on social media? To investigate this question, we introduce TRIALQA, a novel dataset comprising two social media collections from the subreddits on colon cancer and prostate cancer. Using eligibility criteria from public real-world CTs, experienced annotators are hired to annotate TRIALQA to indicate (1) whether a social media user meets a given eligibility criterion and (2) the user's stated reasons for interest in participating in CT. We benchmark seven widely used LLMs on these two prediction tasks, employing six distinct training and inference strategies. Our extensive experiments reveal that, while LLMs show considerable promise, they still face challenges in performing the complex, multi-hop reasoning needed to accurately assess eligibility criteria.