Abduct, Act, Predict: Scaffolding Causal Inference for Automated Failure Attribution in Multi-Agent Systems

作者: Alva West, Yixuan Weng, Minjun Zhu, Zhen Lin, Zhiyuan Ning, Yue Zhang

分类: cs.AI, cs.CL

发布日期: 2025-09-12 (更新: 2025-09-23)

🔗 代码/项目: GITHUB

💡 一句话要点

提出A2P框架,通过因果推理提升多智能体系统故障归因准确率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 故障归因 因果推理 反事实推理 大型语言模型 溯因 行动 预测

📋 核心要点

- 现有方法在多智能体系统中进行故障归因时,依赖模式识别,缺乏反事实推理能力,导致步骤级别准确率低。

- A2P框架通过溯因、行动和预测三个步骤,将故障归因转化为结构化的因果推理任务,提升了推理的准确性和可解释性。

- 实验表明,A2P在算法生成和手工数据集上,步骤级别准确率分别提升至47.46%和29.31%,显著优于现有基线方法。

📝 摘要(中文)

多智能体系统中的故障归因,即精确定位发生决定性错误的步骤,是一个关键但尚未解决的挑战。现有方法将其视为长对话日志上的模式识别任务,导致步骤级别的准确率极低(低于17%),使其无法用于调试复杂系统。它们的核心弱点是无法进行稳健的反事实推理:确定纠正单个动作是否能实际避免任务失败。为了弥合这种“反事实推理差距”,我们引入了Abduct-Act-Predict (A2P) Scaffolding,这是一种新颖的智能体框架,它将故障归因从模式识别转变为结构化的因果推理任务。A2P显式地引导大型语言模型在单个推理过程中完成一个正式的三步推理过程:(1)溯因,推断智能体行为背后的隐藏根本原因;(2)行动,定义最小的纠正干预;(3)预测,模拟后续轨迹并验证干预是否解决了故障。这种结构化方法利用了整个对话的整体上下文,同时对模型的分析施加了严格的因果逻辑。我们在Who&When基准测试上的大量实验证明了其有效性。在算法生成的数据集上,A2P实现了47.46%的步骤级别准确率,比基线的16.67%提高了2.85倍。在更复杂的手工制作数据集上,它实现了29.31%的步骤准确率,比基线的12.07%提高了2.43倍。通过用因果视角重新构建问题,A2P Scaffolding为自动故障归因提供了一个稳健、可验证且准确得多的解决方案。

🔬 方法详解

问题定义:论文旨在解决多智能体系统中自动故障归因的问题。现有方法主要依赖于模式识别,直接在对话日志中寻找错误模式,缺乏对智能体行为背后因果关系的理解,无法进行有效的反事实推理,导致在复杂场景下准确率极低。

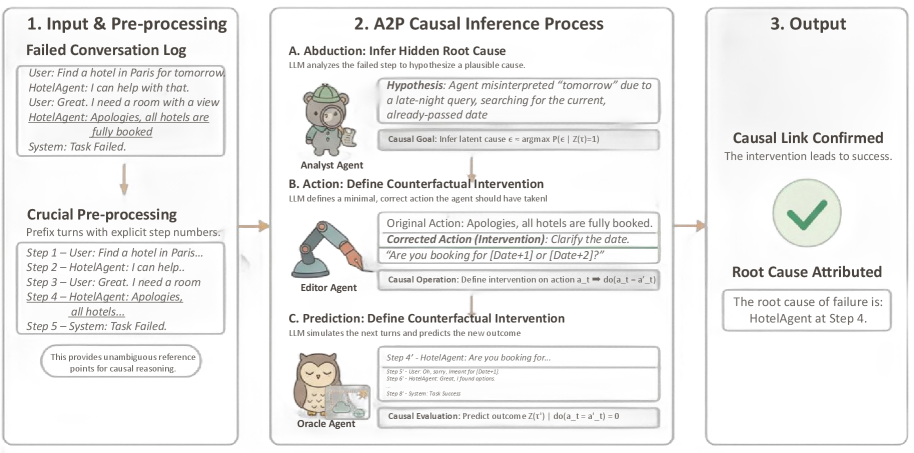

核心思路:论文的核心思路是将故障归因问题转化为一个结构化的因果推理任务。通过显式地引导大型语言模型进行溯因(Abduct)、行动(Act)和预测(Predict)三个步骤,模拟人类专家进行故障诊断的过程,从而提高故障归因的准确性和可解释性。

技术框架:A2P框架包含以下三个主要阶段: 1. 溯因(Abduct):分析智能体的行为,推断其行为背后的隐藏根本原因。这通常涉及对智能体的目标、约束和知识的理解。 2. 行动(Act):基于溯因的结果,定义一个最小的纠正干预。这个干预旨在纠正智能体的错误行为,使其能够朝着正确的方向前进。 3. 预测(Predict):模拟在进行纠正干预后,系统的后续轨迹。通过预测,可以验证干预是否能够有效地解决故障。

关键创新:A2P框架最重要的技术创新点在于将故障归因问题从模式识别转化为因果推理。与现有方法相比,A2P框架能够更好地理解智能体行为背后的因果关系,进行有效的反事实推理,从而提高故障归因的准确性和可解释性。

关键设计:A2P框架的关键设计包括: 1. 三步推理流程:明确的溯因、行动和预测步骤,引导模型进行结构化的因果推理。 2. 大型语言模型的使用:利用大型语言模型的强大语言理解和推理能力,进行溯因和预测。 3. 最小干预原则:在行动阶段,选择最小的纠正干预,避免对系统造成不必要的干扰。 4. 整体上下文利用:在推理过程中,充分利用整个对话的上下文信息,提高推理的准确性。

🖼️ 关键图片

📊 实验亮点

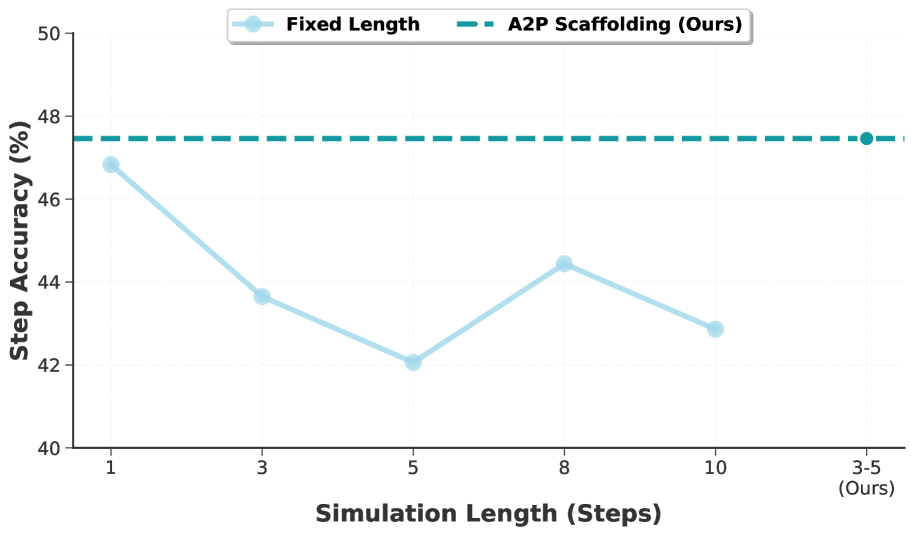

A2P框架在Who&When基准测试中表现出色。在算法生成的数据集上,A2P实现了47.46%的步骤级别准确率,比基线的16.67%提高了2.85倍。在更复杂的手工制作数据集上,A2P实现了29.31%的步骤准确率,比基线的12.07%提高了2.43倍。这些结果表明,A2P框架能够显著提高多智能体系统中故障归因的准确性。

🎯 应用场景

该研究成果可应用于各种多智能体系统,例如协作机器人、自动驾驶车辆和分布式计算系统。通过自动故障归因,可以快速定位系统中的错误,减少调试时间和成本,提高系统的可靠性和安全性。未来,该技术有望应用于更复杂的场景,例如智能制造和智慧城市。

📄 摘要(原文)

Failure attribution in multi-agent systems -- pinpointing the exact step where a decisive error occurs -- is a critical yet unsolved challenge. Current methods treat this as a pattern recognition task over long conversation logs, leading to critically low step-level accuracy (below 17\%), which renders them impractical for debugging complex systems. Their core weakness is a fundamental inability to perform robust counterfactual reasoning: to determine if correcting a single action would have actually averted the task failure. To bridge this \emph{counterfactual inference gap}, we introduce Abduct-Act-Predict (A2P) Scaffolding, a novel agent framework that transforms failure attribution from pattern recognition into a structured causal inference task. A2P explicitly guides a large language model through a formal three-step reasoning process within a single inference pass: (1) Abduction, to infer the hidden root causes behind an agent's actions; (2) Action, to define a minimal corrective intervention; and (3) Prediction, to simulate the subsequent trajectory and verify if the intervention resolves the failure. This structured approach leverages the holistic context of the entire conversation while imposing a rigorous causal logic on the model's analysis. Our extensive experiments on the Who\&When benchmark demonstrate its efficacy. On the Algorithm-Generated dataset, A2P achieves 47.46\% step-level accuracy, a 2.85$\times$ improvement over the 16.67\% of the baseline. On the more complex Hand-Crafted dataset, it achieves 29.31\% step accuracy, a 2.43$\times$ improvement over the baseline's 12.07\%. By reframing the problem through a causal lens, A2P Scaffolding provides a robust, verifiable, and significantly more accurate solution for automated failure attribution. Ours code are released at https://github.com/ResearAI/A2P.