An Ethically Grounded LLM-Based Approach to Insider Threat Synthesis and Detection

作者: Haywood Gelman, John D. Hastings, David Kenley

分类: cs.CR, cs.AI, cs.CL, cs.CY

发布日期: 2025-09-08 (更新: 2025-10-01)

备注: 6 pages, 5 figures, 5 tables

期刊: 2025 IEEE Cyber Awareness and Research Symposium (CARS'25)

DOI: 10.1109/CARS67163.2025.11337953

💡 一句话要点

提出一种基于伦理的大语言模型方法,用于内部威胁合成与检测

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 内部威胁检测 大型语言模型 合成数据生成 系统日志分析 安全评估

📋 核心要点

- 现有内部威胁检测研究依赖静态、受限数据集,阻碍了自适应模型的开发。

- 利用LLM(Claude Sonnet 3.7)动态合成包含内部威胁指标的系统日志,模拟真实数据分布。

- 实验表明,Sonnet 3.7在内部威胁检测方面优于GPT-4o,尤其在降低误报率和提高准确率上。

📝 摘要(中文)

内部威胁因其技术和行为元素的复杂性,日益成为组织面临的难题。大量研究致力于从技术、心理和教育角度研究内部威胁。然而,该领域的研究通常依赖于静态且访问受限的数据集,这限制了自适应检测模型的开发。本研究提出了一种新颖的、基于伦理的方法,使用大型语言模型Claude Sonnet 3.7动态合成系统日志消息,其中一些消息包含内部威胁场景的指标。这些消息通过高度不平衡(1%的内部威胁)来反映真实世界的数据分布。系统日志由Sonnet 3.7和GPT-4o分析以检测内部威胁,并通过包括准确率、精确率、召回率、F1、特异性、误报率、MCC和ROC AUC在内的统计指标评估其性能。Sonnet 3.7在几乎所有指标上都始终优于GPT-4o,尤其是在减少误报和提高检测准确率方面。结果表明,LLM在合成数据集生成和内部威胁检测方面具有广阔的应用前景。

🔬 方法详解

问题定义:论文旨在解决内部威胁检测中数据集匮乏且难以获取的问题。现有方法依赖于静态数据集,无法有效训练自适应的内部威胁检测模型,并且真实场景下的数据分布高度不平衡,导致模型泛化能力不足。

核心思路:论文的核心思路是利用大型语言模型(LLM)生成合成数据,以克服真实数据集的限制。通过精心设计的提示工程,使LLM能够模拟真实系统日志,并注入包含内部威胁行为的日志条目,从而创建大规模、多样化的数据集,用于训练和评估内部威胁检测模型。

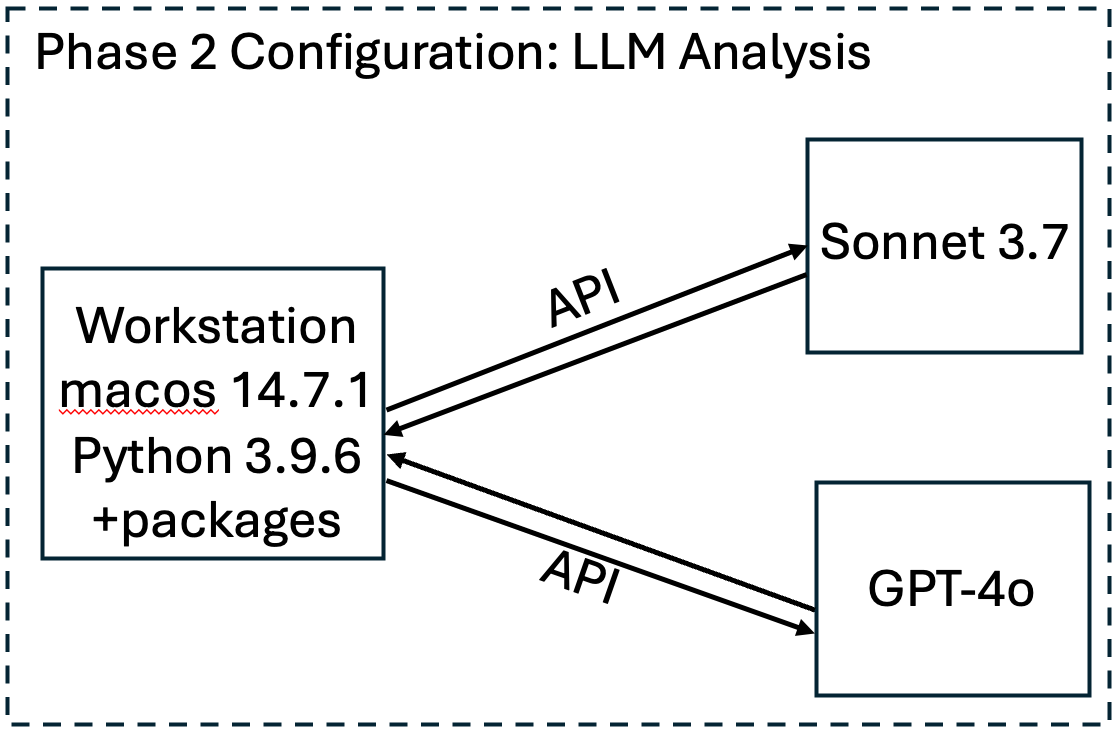

技术框架:该方法主要包含两个阶段:1) 基于LLM的合成数据生成阶段:使用Claude Sonnet 3.7作为生成器,通过特定的提示词引导其生成系统日志,并控制内部威胁事件的比例。2) 内部威胁检测阶段:使用Sonnet 3.7和GPT-4o作为检测器,分析生成的系统日志,并评估其检测内部威胁的能力。评估指标包括准确率、精确率、召回率、F1值、特异性、误报率、MCC和ROC AUC。

关键创新:该研究的关键创新在于将LLM应用于合成内部威胁检测数据集,并结合伦理考量,确保生成的数据不会泄露敏感信息或造成其他伦理问题。此外,该研究还比较了不同LLM在内部威胁检测任务上的性能,为选择合适的LLM提供了参考。

关键设计:在数据生成阶段,通过调整提示词来控制内部威胁事件的类型和频率,以模拟真实世界的数据分布。内部威胁事件的比例被设置为1%,以反映真实场景中内部威胁事件的稀疏性。在模型评估阶段,使用了多种统计指标来全面评估模型的性能,包括准确率、精确率、召回率、F1值、特异性、误报率、MCC和ROC AUC。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Claude Sonnet 3.7在内部威胁检测任务上优于GPT-4o,尤其是在降低误报率和提高检测准确率方面。Sonnet 3.7在各项指标上均取得了更好的表现,证明了LLM在合成数据集生成和内部威胁检测方面的潜力。具体性能数据未在摘要中详细给出,需要查阅原文。

🎯 应用场景

该研究成果可应用于企业安全领域,帮助组织构建更有效的内部威胁检测系统。通过使用合成数据训练模型,可以降低对真实敏感数据的依赖,并提高模型的泛化能力。此外,该方法还可以用于评估和比较不同安全产品的性能,为组织选择合适的安全解决方案提供依据。未来,该方法可以扩展到其他安全领域,例如恶意软件检测和网络入侵检测。

📄 摘要(原文)

Insider threats are a growing organizational problem due to the complexity of identifying their technical and behavioral elements. A large research body is dedicated to the study of insider threats from technological, psychological, and educational perspectives. However, research in this domain has been generally dependent on datasets that are static and limited access which restricts the development of adaptive detection models. This study introduces a novel, ethically grounded approach that uses the large language model (LLM) Claude Sonnet 3.7 to dynamically synthesize syslog messages, some of which contain indicators of insider threat scenarios. The messages reflect real-world data distributions by being highly imbalanced (1% insider threats). The syslogs were analyzed for insider threats by both Sonnet 3.7 and GPT-4o, with their performance evaluated through statistical metrics including accuracy, precision, recall, F1, specificity, FAR, MCC, and ROC AUC. Sonnet 3.7 consistently outperformed GPT-4o across nearly all metrics, particularly in reducing false alarms and improving detection accuracy. The results show strong promise for the use of LLMs in synthetic dataset generation and insider threat detection.