Hyperbolic Large Language Models

作者: Sarang Patil, Zeyong Zhang, Yiran Huang, Tengfei Ma, Mengjia Xu

分类: cs.AI

发布日期: 2025-09-06 (更新: 2025-12-07)

备注: 27 pages, 7 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于双曲几何的大语言模型(HypLLMs),增强语义表示学习和多尺度推理。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双曲几何 大型语言模型 分层结构 语义表示学习 多尺度推理

📋 核心要点

- 现有LLM难以有效学习具有非欧几里得分层结构的真实世界数据中的语义蕴含和分层关系。

- 利用双曲几何作为LLM的表示空间,建模树状分层结构,增强语义表示学习和多尺度推理。

- 论文对双曲LLM进行了分类,并探讨了其潜在应用和未来研究方向,提供了一个资源库。

📝 摘要(中文)

大型语言模型(LLMs)在自然语言处理(NLP)、天气预报、生物蛋白质折叠、文本生成和解决数学问题等各种任务中取得了显著成功并表现出卓越的性能。然而,许多现实世界的数据都表现出高度非欧几里得潜在分层结构,例如蛋白质网络、交通运输网络、金融网络、大脑网络以及自然语言中的语言结构或句法树。利用LLM从这些原始的、非结构化的输入数据中有效地学习内在的语义蕴含和分层关系仍然是一个未被充分探索的领域。由于双曲几何在建模树状分层结构方面的有效性——一种非欧几里得空间——它已迅速普及,成为跨图、图像、语言和多模态数据等领域的复杂数据建模的富有表现力的潜在表示空间。本文全面而有条理地阐述了最近在LLM方面的进展,这些进展利用双曲几何作为表示空间来增强语义表示学习和多尺度推理。具体来说,本文根据四个主要类别提出了双曲LLM(HypLLM)的主要技术分类:(1)通过exp/log映射的双曲LLM;(2)双曲微调模型;(3)完全双曲LLM;(4)双曲状态空间模型。我们还探讨了关键的潜在应用,并概述了未来的研究方向。关键论文、模型、数据集和代码实现的存储库可在https://github.com/sarangp2402/Hyperbolic-LLM-Models上找到。

🔬 方法详解

问题定义:现有的大型语言模型在处理具有复杂分层结构的数据(如蛋白质网络、交通网络、语言结构等)时,由于其固有的欧几里得空间限制,难以有效地捕捉和表示这些数据中蕴含的语义关系和层级结构。这导致模型在理解和推理这些数据时性能受限。

核心思路:论文的核心思路是利用双曲几何作为LLM的潜在表示空间。双曲几何能够自然地表示树状结构和层级关系,因此更适合于建模具有复杂分层结构的数据。通过将数据映射到双曲空间,LLM可以更好地学习和理解数据中的语义信息。

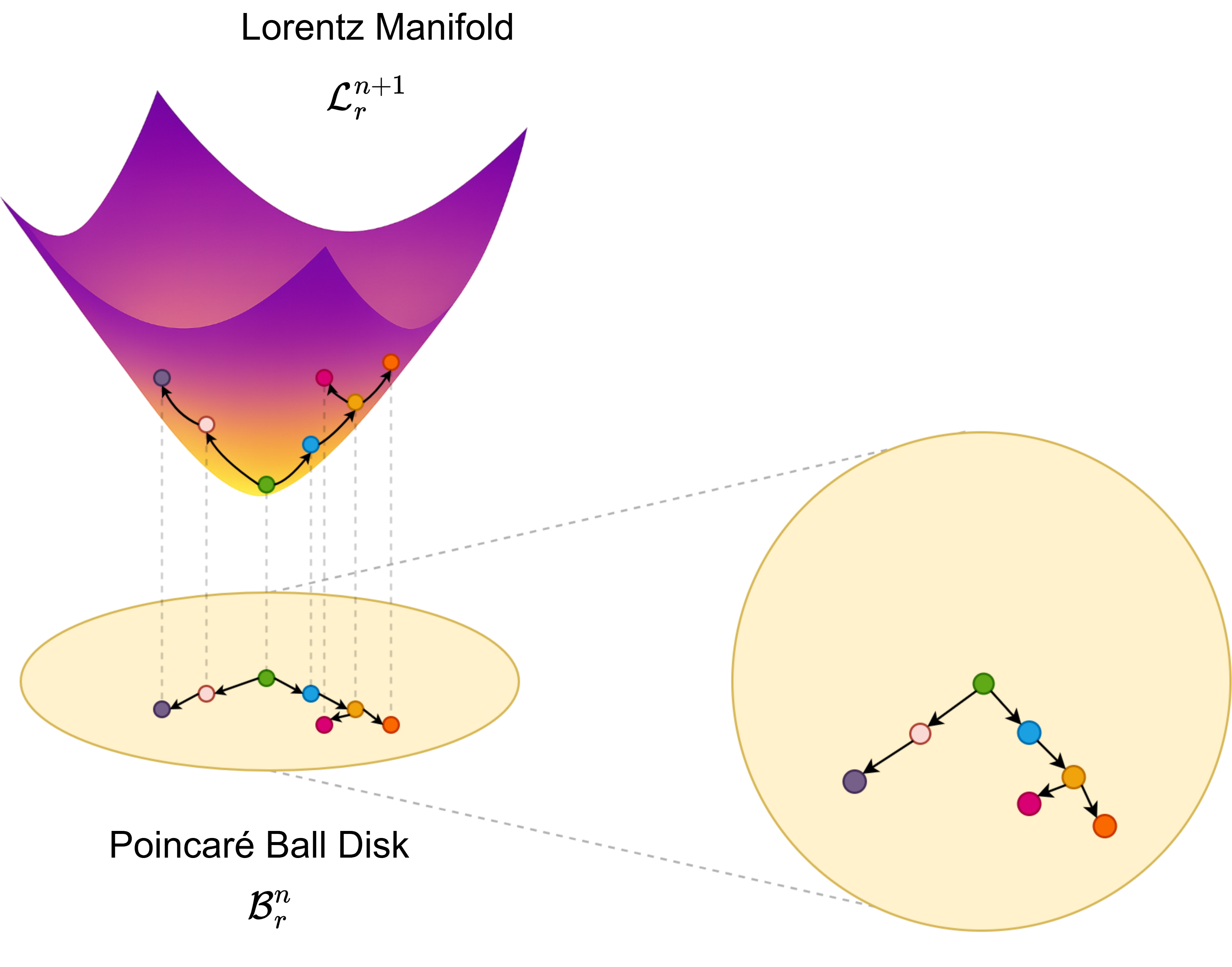

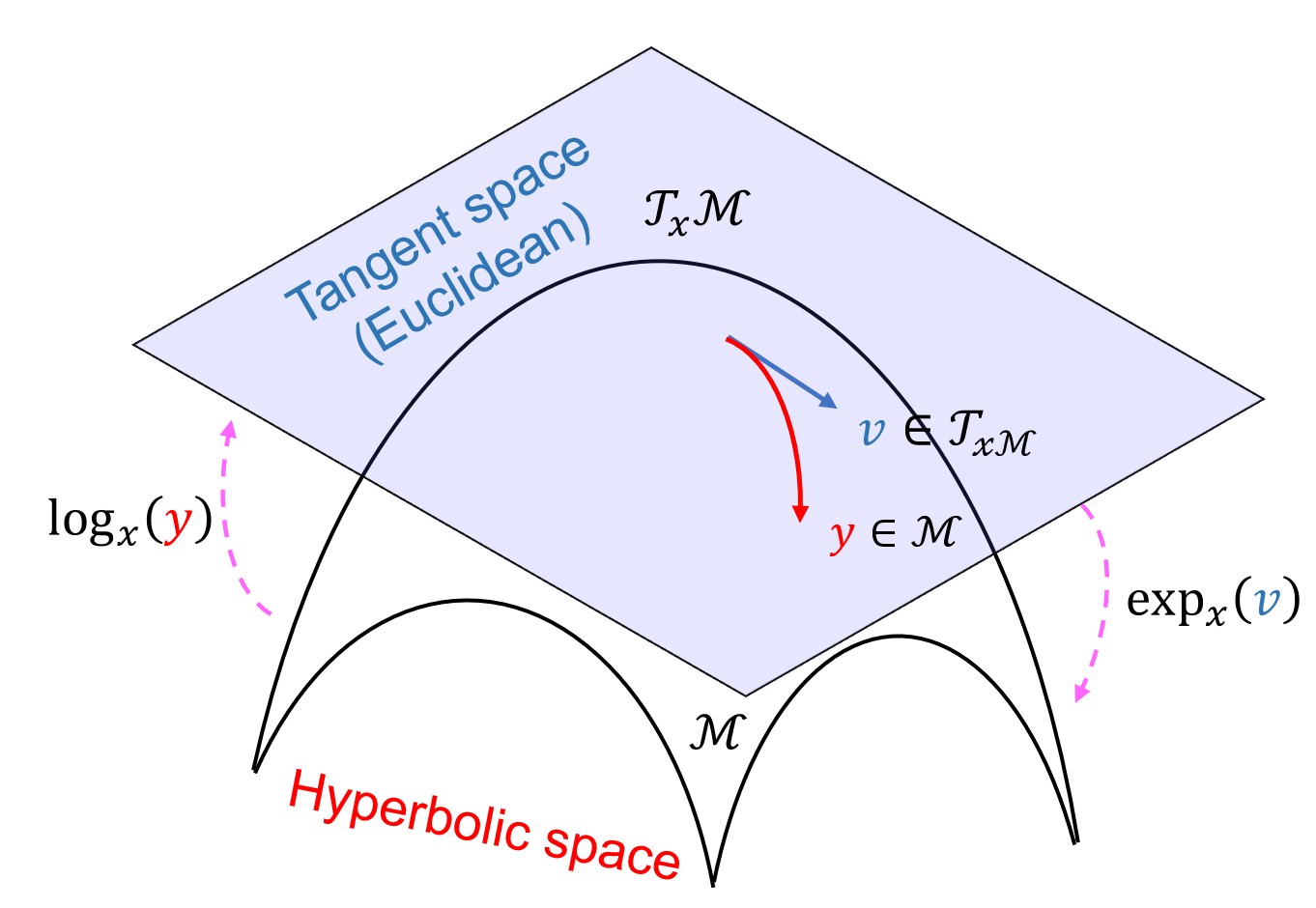

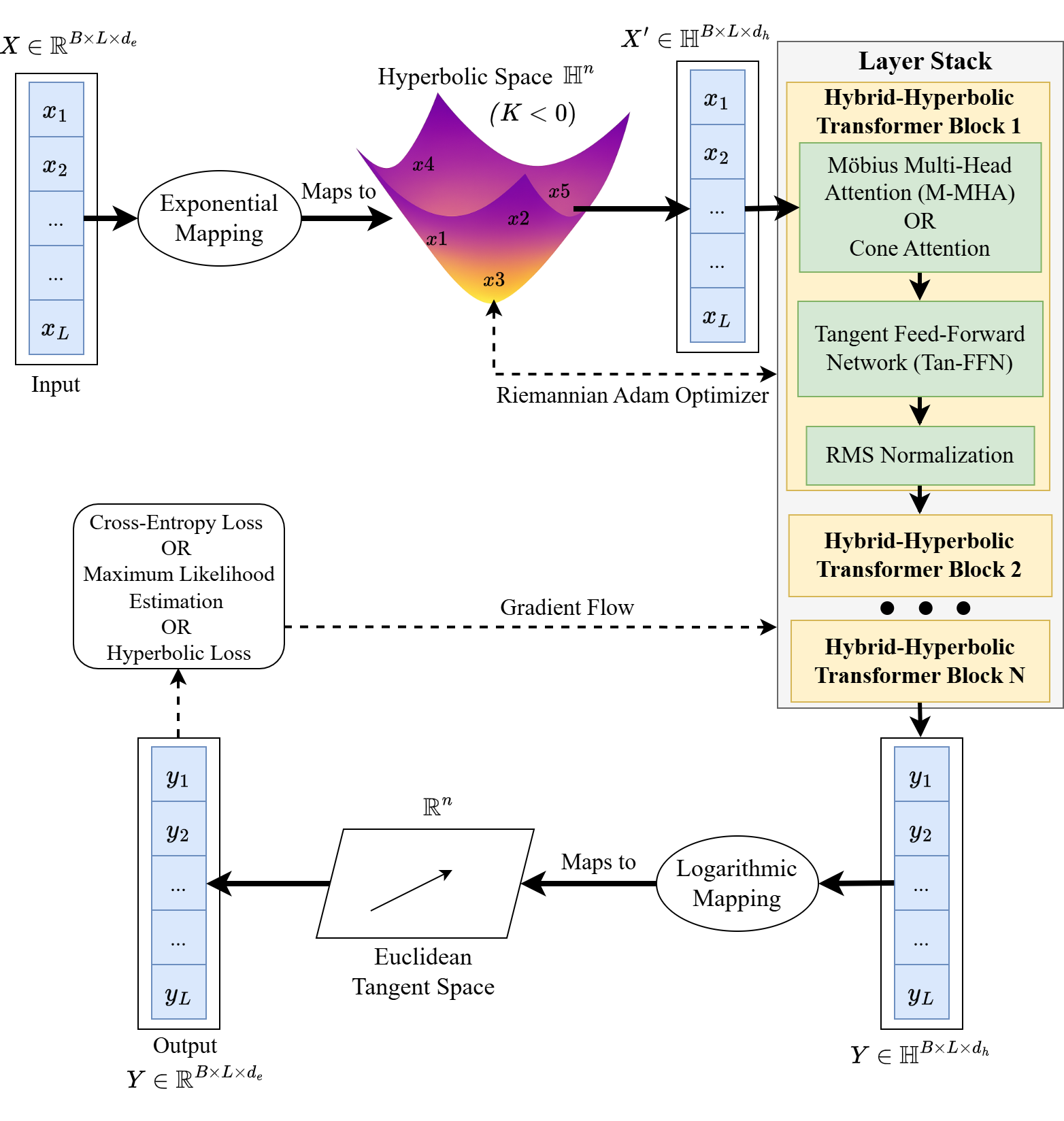

技术框架:论文将双曲LLM(HypLLM)分为四个主要类别:(1) 通过指数/对数映射的双曲LLM,即将欧几里得空间的数据映射到双曲空间;(2) 双曲微调模型,即在预训练的LLM基础上,利用双曲几何进行微调;(3) 完全双曲LLM,即整个模型都在双曲空间中进行计算;(4) 双曲状态空间模型,将双曲几何应用于状态空间模型。

关键创新:最重要的技术创新点在于将双曲几何引入到LLM中,从而使模型能够更好地处理具有复杂分层结构的数据。与传统的欧几里得空间相比,双曲空间能够更有效地表示树状结构和层级关系,从而提升了模型在相关任务上的性能。

关键设计:论文中涉及的关键设计包括:不同的双曲映射方法(如Poincaré ball模型、Hyperboloid模型等),用于将数据映射到双曲空间;针对双曲空间的优化算法,以确保模型能够有效地学习;以及针对不同类型的双曲LLM(如微调模型、完全双曲模型等)的网络结构设计。

🖼️ 关键图片

📊 实验亮点

论文提供了一个双曲LLM的分类框架,并整理了相关的论文、模型、数据集和代码实现,为后续研究提供了便利。虽然摘要中没有明确提及具体的实验结果和性能数据,但论文强调了双曲几何在增强语义表示学习和多尺度推理方面的潜力,暗示了在特定任务上可能取得的性能提升。

🎯 应用场景

该研究成果可应用于多种领域,包括自然语言处理(例如,更好地理解句法结构和语义关系)、生物信息学(例如,建模蛋白质网络)、金融网络分析、交通网络优化等。通过更有效地表示和理解这些领域中的复杂分层结构,可以提升相关任务的性能,例如知识图谱推理、关系预测和推荐系统。

📄 摘要(原文)

Large language models (LLMs) have achieved remarkable success and demonstrated superior performance across various tasks, including natural language processing (NLP), weather forecasting, biological protein folding, text generation, and solving mathematical problems. However, many real-world data exhibit highly non-Euclidean latent hierarchical anatomy, such as protein networks, transportation networks, financial networks, brain networks, and linguistic structures or syntactic trees in natural languages. Effectively learning intrinsic semantic entailment and hierarchical relationships from these raw, unstructured input data using LLMs remains an underexplored area. Due to its effectiveness in modeling tree-like hierarchical structures, hyperbolic geometry -- a non-Euclidean space -- has rapidly gained popularity as an expressive latent representation space for complex data modeling across domains such as graphs, images, languages, and multi-modal data. Here, we provide a comprehensive and contextual exposition of recent advancements in LLMs that leverage hyperbolic geometry as a representation space to enhance semantic representation learning and multi-scale reasoning. Specifically, the paper presents a taxonomy of the principal techniques of Hyperbolic LLMs (HypLLMs) in terms of four main categories: (1) hyperbolic LLMs through exp/log maps; (2) hyperbolic fine-tuned models; (3) fully hyperbolic LLMs, and (4) hyperbolic state-space models. We also explore crucial potential applications and outline future research directions. A repository of key papers, models, datasets, and code implementations is available at https://github.com/sarangp2402/Hyperbolic-LLM-Models.