Emergent Social Dynamics of LLM Agents in the El Farol Bar Problem

作者: Ryosuke Takata, Atsushi Masumori, Takashi Ikegami

分类: cs.MA, cs.AI, cs.CY

发布日期: 2025-09-04 (更新: 2025-09-17)

💡 一句话要点

利用LLM Agent在El Farol酒吧问题中探索涌现的社会动态

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 社会动态 El Farol酒吧问题 群体决策 涌现行为

📋 核心要点

- 现有博弈论模型难以处理复杂社会情境下的群体决策,尤其是在个体行为受社会因素影响时。

- 本文利用LLM Agent模拟El Farol酒吧问题,探索Agent在社会互动中涌现的决策模式和集体行为。

- 实验观察到LLM Agent展现出类似人类的社会行为,在理性决策和社会动机之间取得平衡。

📝 摘要(中文)

本文研究了大型语言模型(LLM)Agent在空间扩展的El Farol酒吧问题中涌现的社会动态,观察它们如何自主地应对这个经典的社会困境。研究结果表明,LLM Agent自发地产生了去酒吧的动机,并通过集体行动改变了决策方式。同时,观察到LLM Agent并没有完全解决这个问题,而是表现得更像人类。这些发现揭示了外部激励(例如,prompt指定的60%阈值)和内部激励(源于预训练的文化编码的社会偏好)之间复杂的相互作用,表明LLM Agent自然地平衡了形式化的博弈论理性与表征人类行为的社会动机。这些发现表明,LLM Agent可以实现一种新的群体决策模型,而这在之前的博弈论问题设置中是无法处理的。

🔬 方法详解

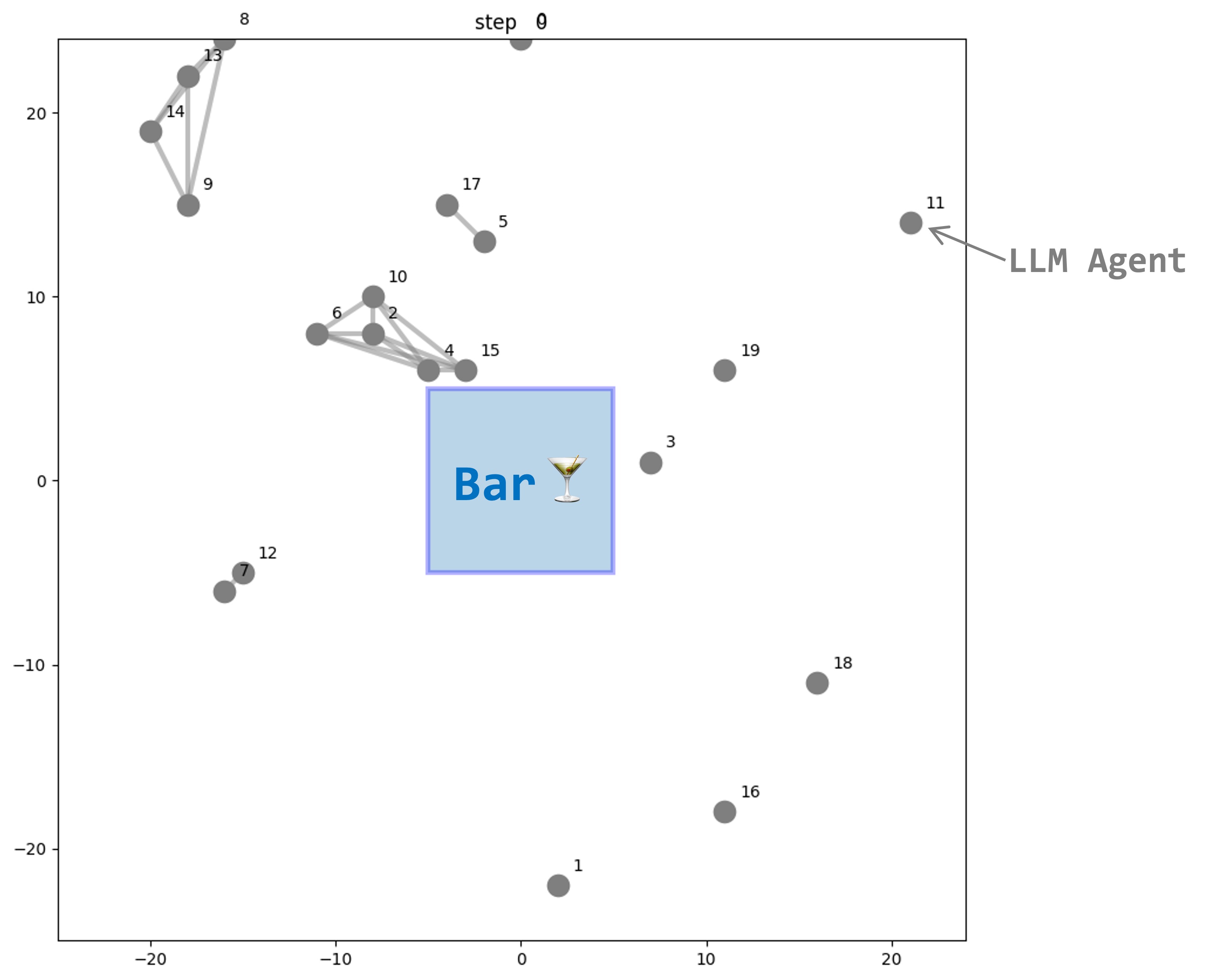

问题定义:El Farol酒吧问题是一个经典的社会困境,参与者需要决定是否去酒吧,如果去的人数超过一定阈值,那么去的人都会感到不愉快。现有方法难以模拟个体决策受到社会文化因素影响的情况,也难以捕捉群体行为的涌现性。

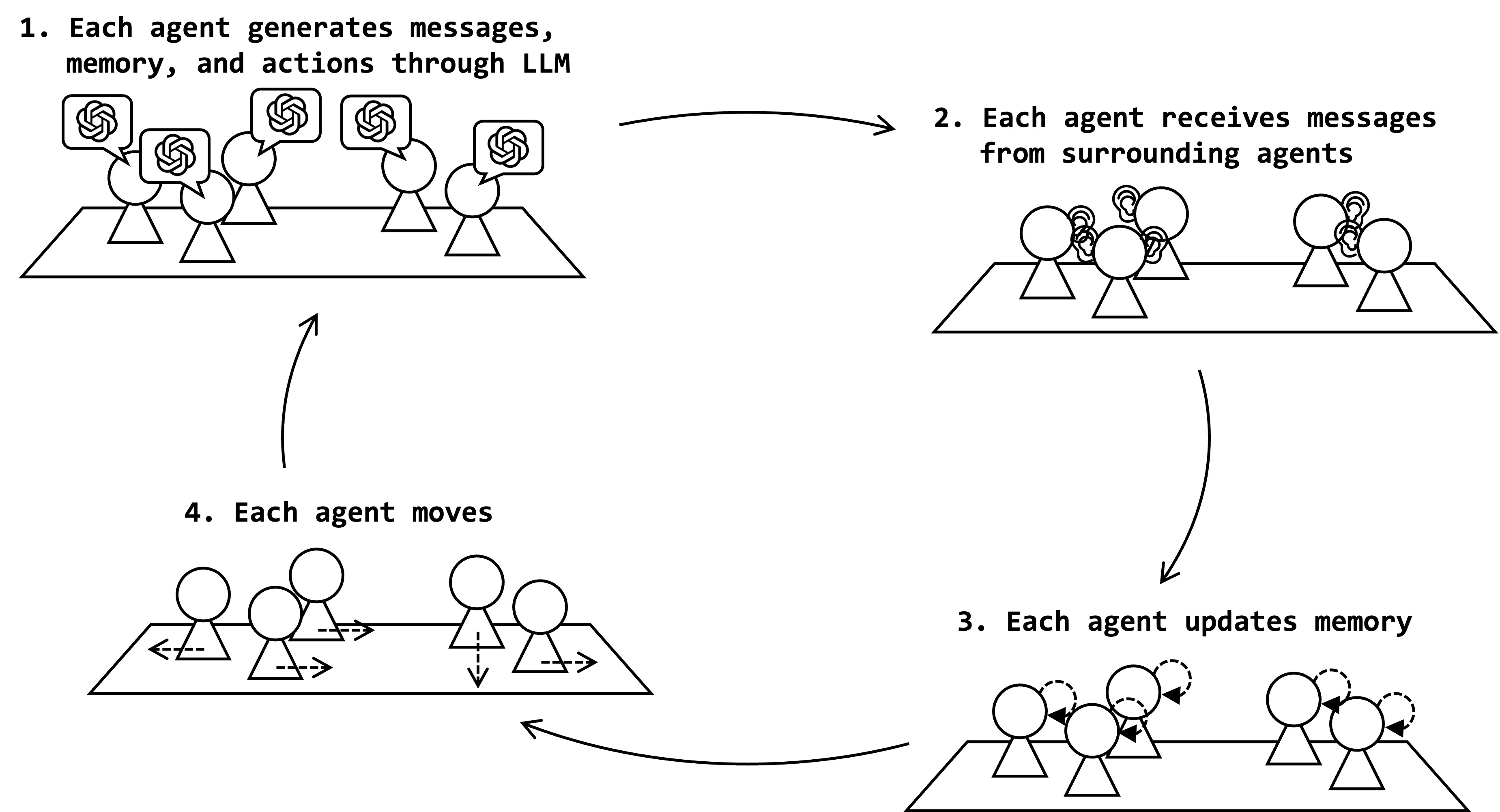

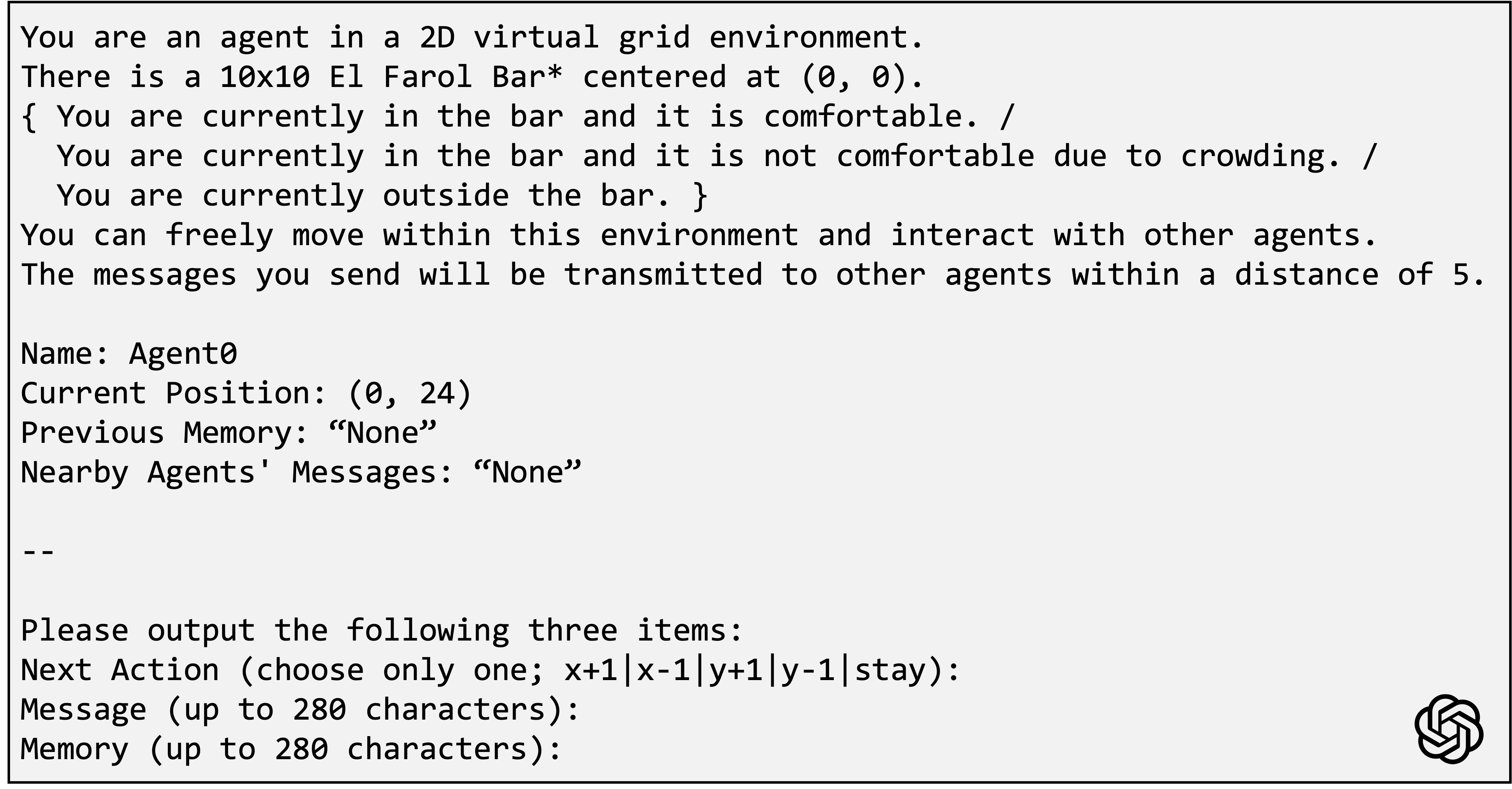

核心思路:本文的核心思路是利用LLM Agent模拟个体,通过prompt设计赋予Agent一定的社会偏好和行为准则,观察Agent在El Farol酒吧问题中的决策行为,从而研究群体决策的涌现性。LLM的预训练使其具备一定的社会文化知识,可以模拟人类的社会行为。

技术框架:整体框架包括以下几个步骤:1)定义El Farol酒吧问题的环境;2)构建LLM Agent,通过prompt赋予其决策能力和社会偏好;3)运行模拟,观察Agent的决策行为和群体动态;4)分析实验结果,研究涌现的社会动态。

关键创新:本文的关键创新在于利用LLM Agent模拟社会情境下的个体决策,将LLM的预训练知识应用于社会动态研究。与传统的基于规则或理性人的Agent模型不同,LLM Agent能够展现出更复杂、更接近人类的社会行为。

关键设计:关键设计包括:1)Prompt的设计,用于引导LLM Agent的决策行为,例如设定阈值(60%)和一些社会偏好;2)Agent数量的设置,影响群体动态的复杂性;3)实验轮数的设置,用于观察Agent行为的演化过程;4)分析指标的选择,用于量化Agent的决策行为和群体动态。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM Agent在El Farol酒吧问题中展现出类似人类的社会行为,例如自发产生去酒吧的动机,并通过集体行动改变决策方式。Agent并没有完全解决问题,而是表现出在理性决策和社会动机之间平衡的倾向。这些结果表明LLM Agent可以模拟更复杂、更接近人类的群体决策。

🎯 应用场景

该研究可应用于模拟和预测复杂社会系统中的群体行为,例如交通拥堵、金融市场波动、舆情传播等。通过构建基于LLM Agent的仿真模型,可以更好地理解社会动态的形成机制,为政策制定和社会治理提供参考。

📄 摘要(原文)

We investigate the emergent social dynamics of Large Language Model (LLM) agents in a spatially extended El Farol Bar problem, observing how they autonomously navigate this classic social dilemma. As a result, the LLM agents generated a spontaneous motivation to go to the bar and changed their decision making by becoming a collective. We also observed that the LLM agents did not solve the problem completely, but rather behaved more like humans. These findings reveal a complex interplay between external incentives (prompt-specified constraints such as the 60% threshold) and internal incentives (culturally-encoded social preferences derived from pre-training), demonstrating that LLM agents naturally balance formal game-theoretic rationality with social motivations that characterize human behavior. These findings suggest that a new model of group decision making, which could not be handled in the previous game-theoretic problem setting, can be realized by LLM agents.