Meta-learning ecological priors from large language models explains human learning and decision making

作者: Akshay K. Jagadish, Mirko Thalmann, Julian Coda-Forno, Marcel Binz, Eric Schulz

分类: q-bio.NC, cs.AI

发布日期: 2025-08-28 (更新: 2025-09-03)

💡 一句话要点

提出ERMI模型,利用大语言模型和元学习模拟人类在真实环境中的学习与决策。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 元学习 大语言模型 认知建模 生态理性 人类行为预测

📋 核心要点

- 现有认知模型难以解释人类在复杂、真实世界环境中的学习和决策行为,缺乏对生态环境统计规律的有效建模。

- 提出生态理性元学习推理(ERMI)框架,利用大语言模型生成生态有效任务,并通过元学习优化模型以适应这些环境。

- 实验表明,ERMI在多个认知任务中能更好地预测人类行为,优于传统认知模型,揭示了人类认知与环境结构的适应性。

📝 摘要(中文)

人类认知深受环境影响。本文探讨了学习和决策是否可以被解释为对真实世界任务统计结构的适应。我们引入了生态理性分析,这是一个将理性分析的规范基础与生态基础相结合的计算框架。利用大型语言模型大规模生成生态有效的认知任务,并使用元学习来推导针对这些环境优化的理性模型,我们开发了一种新的学习算法:生态理性元学习推理(ERMI)。ERMI内化了自然问题空间的统计规律,并灵活地适应新的情况,而不需要手工制作的启发式方法或显式的参数更新。我们表明,ERMI在涵盖函数学习、类别学习和决策的15个实验中捕捉到了人类行为,在逐次试验预测中优于几种已建立的认知模型。我们的结果表明,人类认知的很大一部分可能反映了对日常生活中遇到的问题生态结构的适应性调整。

🔬 方法详解

问题定义:现有认知模型在解释人类在真实世界复杂环境中的学习和决策行为时存在局限性。这些模型通常依赖于手工设计的启发式方法或需要显式参数更新,难以捕捉真实世界任务的统计规律和复杂性。因此,如何构建一个能够有效适应真实世界环境并准确预测人类行为的认知模型是一个关键问题。

核心思路:本文的核心思路是利用大型语言模型(LLM)生成具有生态有效性的认知任务,并使用元学习来训练一个能够适应这些任务的模型。通过让模型在大量由LLM生成的真实世界任务上进行学习,使其能够内化这些任务的统计规律,从而在面对新的任务时能够快速适应并做出合理的决策。这种方法的核心在于将认知模型与真实世界的生态环境联系起来,使其能够更好地反映人类在实际情境中的学习和决策过程。

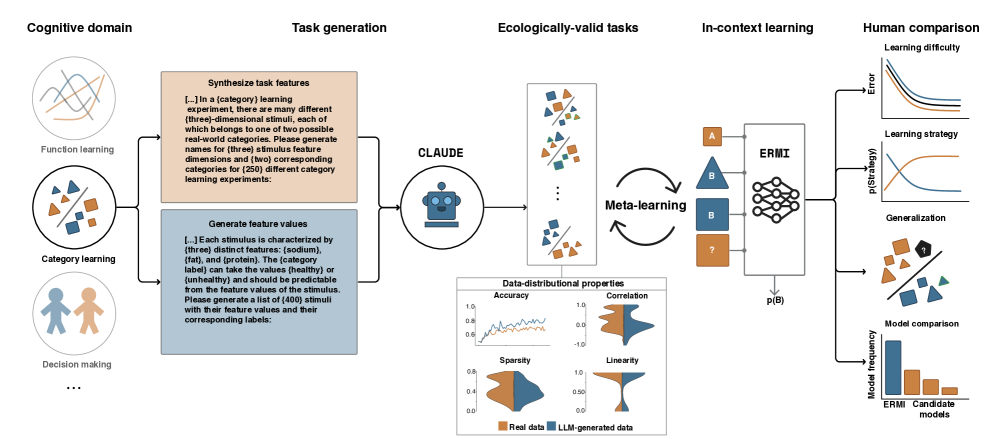

技术框架:ERMI框架主要包含以下几个阶段:1) 使用大型语言模型生成生态有效的认知任务;2) 使用元学习算法在这些任务上训练模型,使其能够快速适应新的任务;3) 使用训练好的模型预测人类在各种认知任务中的行为;4) 将模型的预测结果与人类的实际行为进行比较,评估模型的性能。整体流程是从生态环境数据生成到模型训练,再到行为预测和评估的闭环。

关键创新:ERMI的关键创新在于将大型语言模型和元学习相结合,构建了一个能够有效适应真实世界环境的认知模型。与传统的认知模型相比,ERMI不需要手工设计的启发式方法或显式参数更新,而是通过在大量真实世界任务上进行学习,自动内化这些任务的统计规律。这种方法使得ERMI能够更好地捕捉人类在实际情境中的学习和决策过程,并能够更准确地预测人类行为。

关键设计:ERMI的关键设计包括:1) 使用特定prompt设计,引导LLM生成符合认知任务要求的文本数据;2) 选择合适的元学习算法,例如Model-Agnostic Meta-Learning (MAML),以实现快速适应新任务的能力;3) 设计合适的模型结构,例如循环神经网络(RNN)或Transformer,以处理序列化的认知任务数据;4) 使用合适的损失函数,例如交叉熵损失或均方误差损失,以衡量模型预测结果与人类行为之间的差异。

🖼️ 关键图片

📊 实验亮点

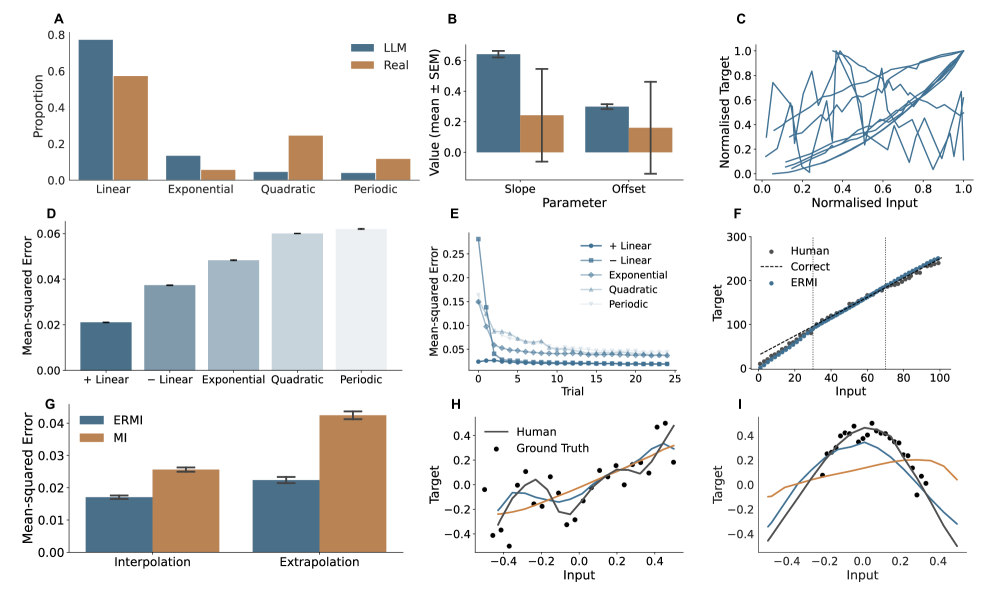

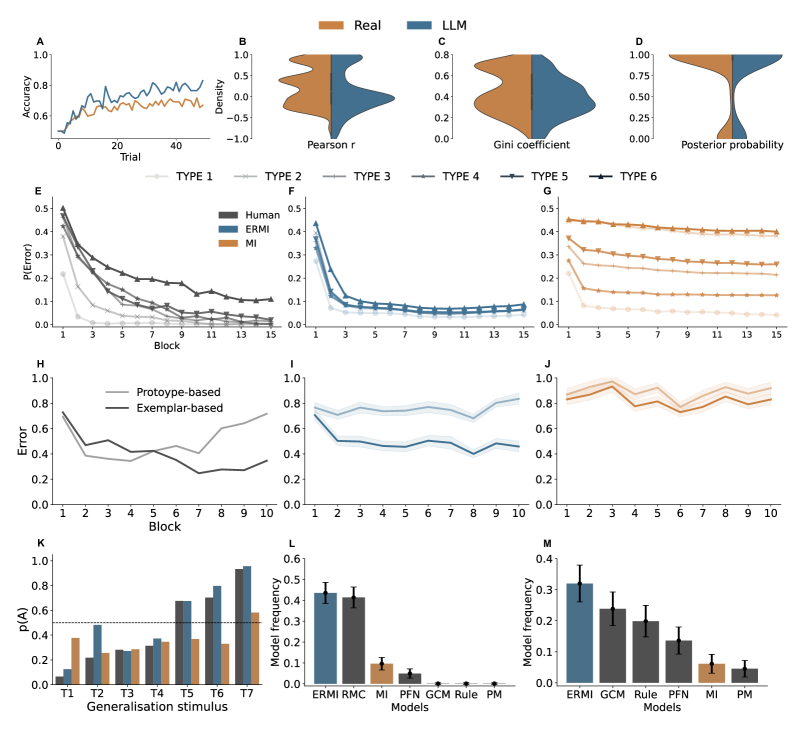

ERMI模型在15个涵盖函数学习、类别学习和决策的实验中表现出色,能够更准确地预测人类行为。在逐次试验预测中,ERMI优于几种已建立的认知模型,表明其能够更好地捕捉人类在真实世界环境中的学习和决策过程。具体性能提升幅度未知,但整体表现优于现有模型。

🎯 应用场景

该研究成果可应用于开发更智能的人机交互系统,例如个性化教育平台、智能助手和决策支持系统。通过模拟人类在真实环境中的学习和决策过程,这些系统可以更好地理解用户的需求,并提供更有效的帮助和建议。此外,该研究还可以用于研究人类认知和行为的神经机制,为认知科学和人工智能的发展提供新的思路。

📄 摘要(原文)

Human cognition is profoundly shaped by the environments in which it unfolds. Yet, it remains an open question whether learning and decision making can be explained as a principled adaptation to the statistical structure of real-world tasks. We introduce ecologically rational analysis, a computational framework that unifies the normative foundations of rational analysis with ecological grounding. Leveraging large language models to generate ecologically valid cognitive tasks at scale, and using meta-learning to derive rational models optimized for these environments, we develop a new class of learning algorithms: Ecologically Rational Meta-learned Inference (ERMI). ERMI internalizes the statistical regularities of naturalistic problem spaces and adapts flexibly to novel situations, without requiring hand-crafted heuristics or explicit parameter updates. We show that ERMI captures human behavior across 15 experiments spanning function learning, category learning, and decision making, outperforming several established cognitive models in trial-by-trial prediction. Our results suggest that much of human cognition may reflect adaptive alignment to the ecological structure of the problems we encounter in everyday life.