Adaptive Monitoring and Real-World Evaluation of Agentic AI Systems

作者: Manish Shukla

分类: cs.AI, cs.CL, cs.MA

发布日期: 2025-08-28 (更新: 2025-09-13)

🔗 代码/项目: GITHUB

💡 一句话要点

提出自适应多维监控算法AMDM,用于Agentic AI系统的实时异常检测与评估。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic AI 多智能体系统 异常检测 自适应监控 目标漂移

📋 核心要点

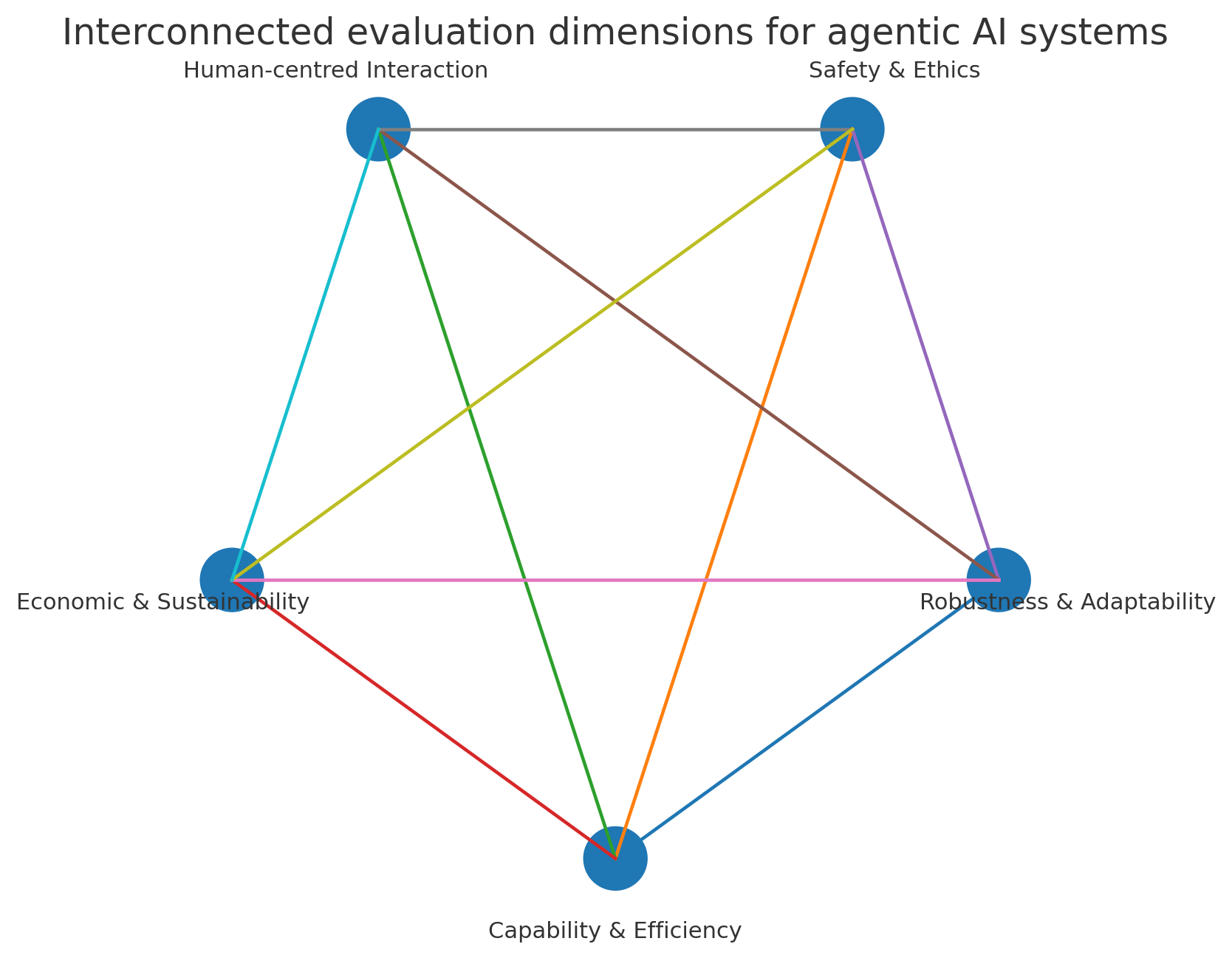

- 现有Agentic AI系统评估主要依赖技术指标,忽略了以人为本和经济等重要维度,导致系统风险难以有效监控。

- 提出自适应多维监控(AMDM)算法,通过归一化异构指标、动态阈值和联合异常检测,实现对Agentic AI系统的全面监控。

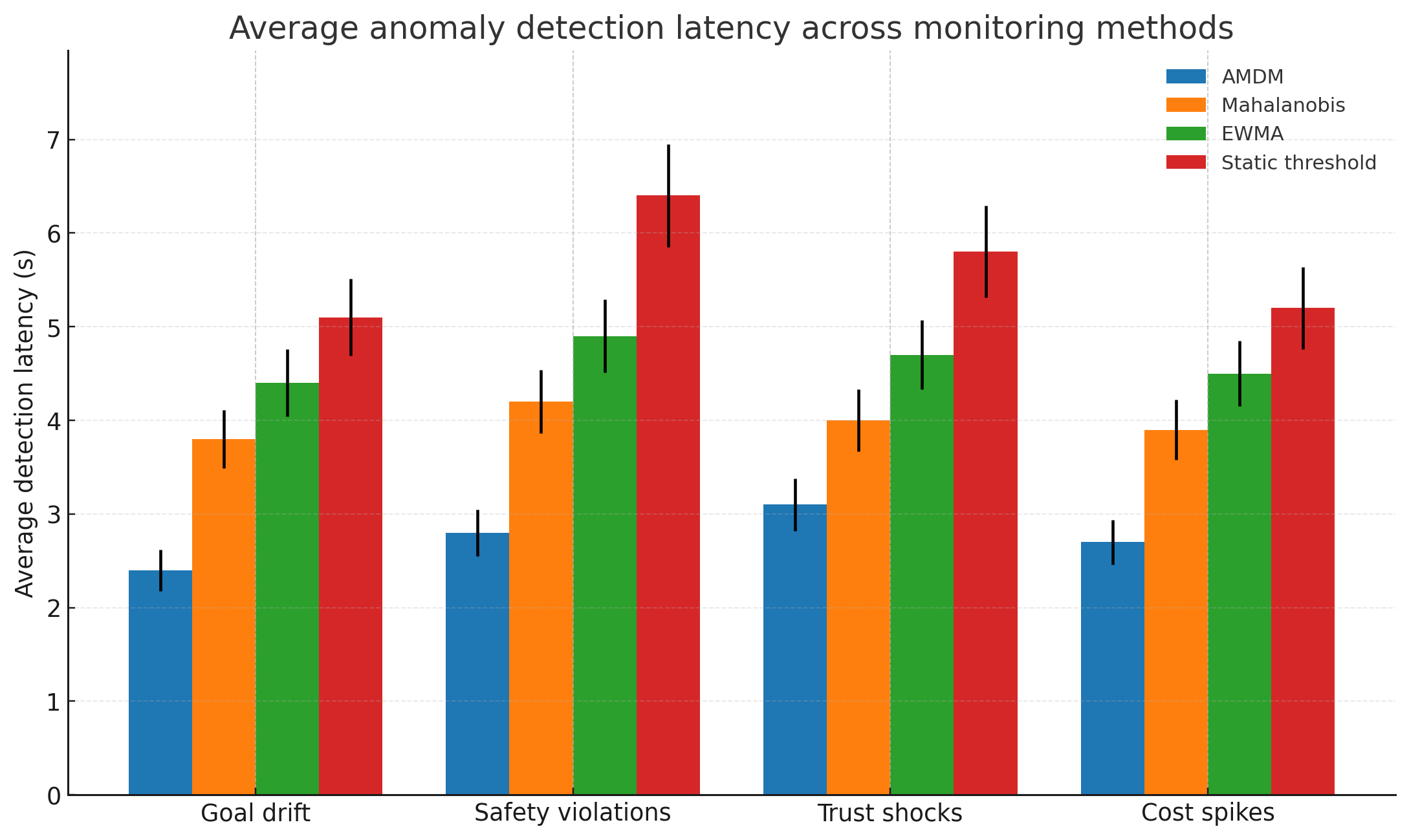

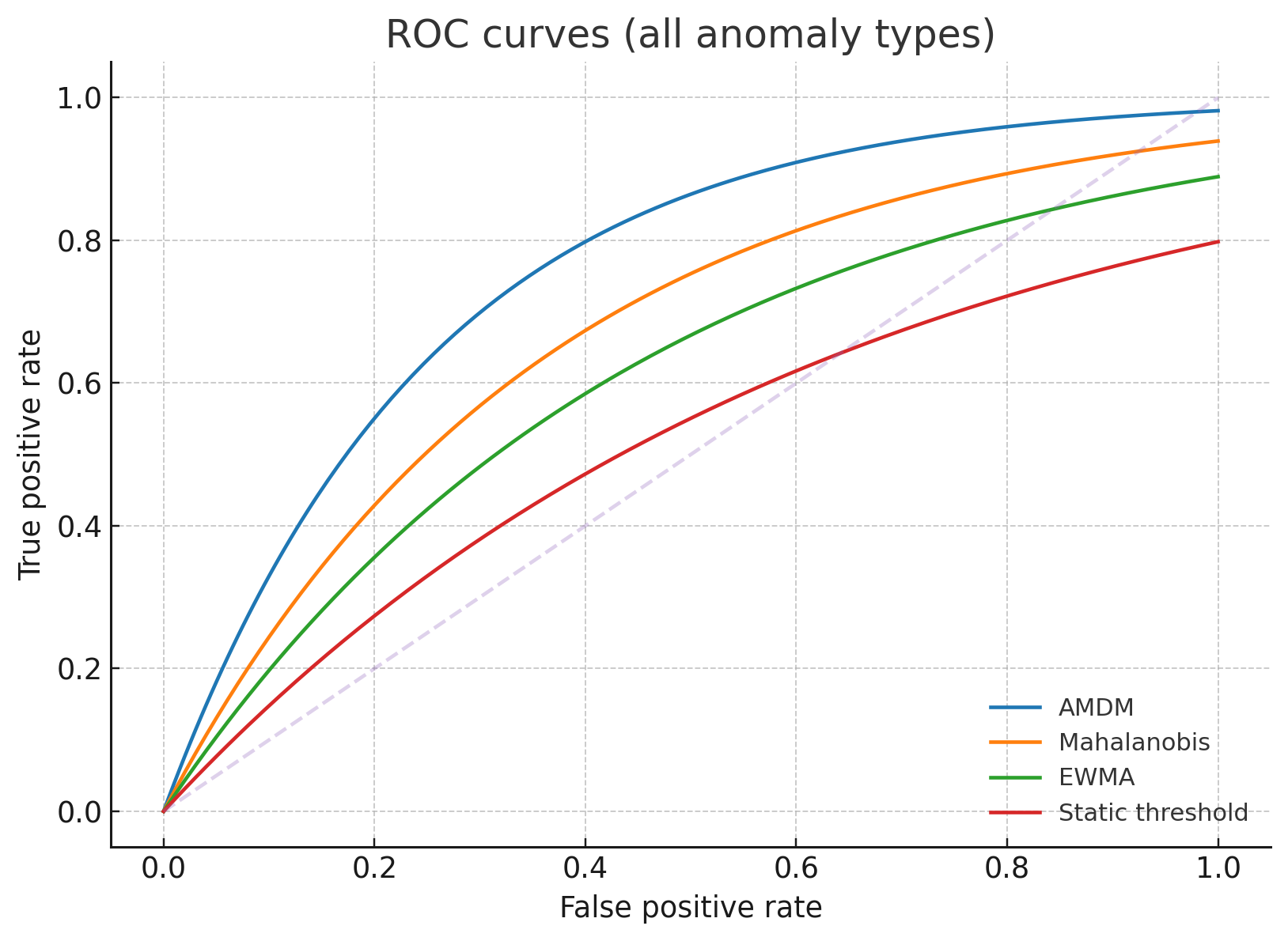

- 实验表明,AMDM能显著降低异常检测延迟和误报率,并能有效发现现有评估方法中缺失的关键指标。

📝 摘要(中文)

Agentic人工智能(AI),即结合大型语言模型、外部工具和自主规划的多智能体系统,正迅速从研究实验室走向高风险领域。我们之前的“基础”论文提出了一个五轴框架,并提出了诸如目标漂移和减少危害等初步指标,但没有提供算法实例化或经验证据。这篇“高级”续集填补了这一空白。首先,我们回顾了最近的基准和工业部署,表明技术指标仍然主导评估:对2023-2025年84篇论文的系统回顾发现,83%的论文报告了能力指标,而只有30%的论文考虑了以人为本或经济轴[2]。其次,我们形式化了一种自适应多维监控(AMDM)算法,该算法对异构指标进行归一化,应用每个轴的指数加权移动平均阈值,并通过马氏距离[7]执行联合异常检测。第三,我们进行了模拟和真实世界的实验。与静态阈值相比,AMDM在模拟目标漂移中将异常检测延迟从12.3秒缩短到5.6秒,并将误报率从4.5%降低到0.9%。我们提供了一个比较表和ROC/PR曲线,并重新分析了案例研究以发现缺失的指标。代码、数据和可重复性清单随本文一起提供,以方便复制。支持这项工作的代码可在https://github.com/Manishms18/Adaptive-Multi-Dimensional-Monitoring获得。

🔬 方法详解

问题定义:Agentic AI系统正被部署到高风险领域,但现有评估方法过度依赖技术指标,缺乏对目标漂移、经济影响和潜在危害的有效监控。静态阈值方法无法适应Agentic AI系统行为的动态变化,导致较高的异常检测延迟和误报率。

核心思路:论文的核心思路是提出一种自适应的多维监控算法,该算法能够整合异构指标,并根据系统的实时行为动态调整监控阈值。通过联合分析多个维度的指标,可以更准确地检测到Agentic AI系统中的异常行为,从而降低风险。

技术框架:AMDM算法包含以下主要模块:1) 指标归一化:将不同量纲的指标转化为统一的尺度。2) 指数加权移动平均(EWMA)阈值:为每个维度动态设置阈值,以适应系统行为的变化。3) 马氏距离计算:计算当前状态与历史状态的马氏距离,用于联合异常检测。4) 异常检测:当马氏距离超过预设阈值时,触发异常警报。

关键创新:AMDM的关键创新在于其自适应性。与静态阈值方法相比,AMDM能够根据Agentic AI系统的实时行为动态调整监控阈值,从而更准确地检测到异常行为。此外,AMDM通过马氏距离进行联合异常检测,考虑了不同维度指标之间的相关性,提高了异常检测的准确性。

关键设计:AMDM算法的关键设计包括:1) 指标归一化方法:选择合适的归一化方法,例如Min-Max归一化或Z-score归一化,以确保不同指标具有可比性。2) EWMA参数设置:调整EWMA的平滑因子,以控制阈值对系统行为变化的响应速度。3) 马氏距离阈值设置:根据历史数据和风险偏好,设置合适的马氏距离阈值,以平衡异常检测的灵敏度和特异性。

🖼️ 关键图片

📊 实验亮点

AMDM算法在模拟目标漂移实验中,将异常检测延迟从12.3秒降低到5.6秒,显著提升了实时性。与静态阈值方法相比,AMDM将误报率从4.5%降低到0.9%,大幅提高了检测精度。实验结果通过ROC/PR曲线进行了可视化展示,并提供了详细的比较表格。

🎯 应用场景

该研究成果可应用于各种Agentic AI系统的监控与评估,例如自动驾驶、金融交易、医疗诊断等。通过实时检测系统异常行为,可以有效降低系统风险,提高系统可靠性和安全性。该方法还有助于发现系统设计中的潜在缺陷,为系统优化提供依据。

📄 摘要(原文)

Agentic artificial intelligence (AI) -- multi-agent systems that combine large language models with external tools and autonomous planning -- are rapidly transitioning from research laboratories into high-stakes domains. Our earlier "Basic" paper introduced a five-axis framework and proposed preliminary metrics such as goal drift and harm reduction but did not provide an algorithmic instantiation or empirical evidence. This "Advanced" sequel fills that gap. First, we revisit recent benchmarks and industrial deployments to show that technical metrics still dominate evaluations: a systematic review of 84 papers from 2023--2025 found that 83% report capability metrics while only 30% consider human-centred or economic axes [2]. Second, we formalise an Adaptive Multi-Dimensional Monitoring (AMDM) algorithm that normalises heterogeneous metrics, applies per-axis exponentially weighted moving-average thresholds and performs joint anomaly detection via the Mahalanobis distance [7]. Third, we conduct simulations and real-world experiments. AMDM cuts anomaly-detection latency from 12.3 s to 5.6 s on simulated goal drift and reduces false-positive rates from 4.5% to 0.9% compared with static thresholds. We present a comparison table and ROC/PR curves, and we reanalyse case studies to surface missing metrics. Code, data and a reproducibility checklist accompany this paper to facilitate replication. The code supporting this work is available at https://github.com/Manishms18/Adaptive-Multi-Dimensional-Monitoring.