Fuzzy, Symbolic, and Contextual: Enhancing LLM Instruction via Cognitive Scaffolding

作者: Vanessa Figueiredo

分类: cs.AI, cs.CL

发布日期: 2025-08-28 (更新: 2025-10-29)

💡 一句话要点

通过认知支架增强LLM指令:模糊、符号化和情境化方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知支架 教学对话 符号推理 短期记忆 提示工程 苏格拉底式辅导

📋 核心要点

- 现有LLM在教学对话中缺乏自适应和结构化的推理能力,难以进行有效的苏格拉底式辅导。

- 论文提出一种符号支架方法,结合短期记忆模式,通过提示工程引导LLM进行结构化推理和自适应学习。

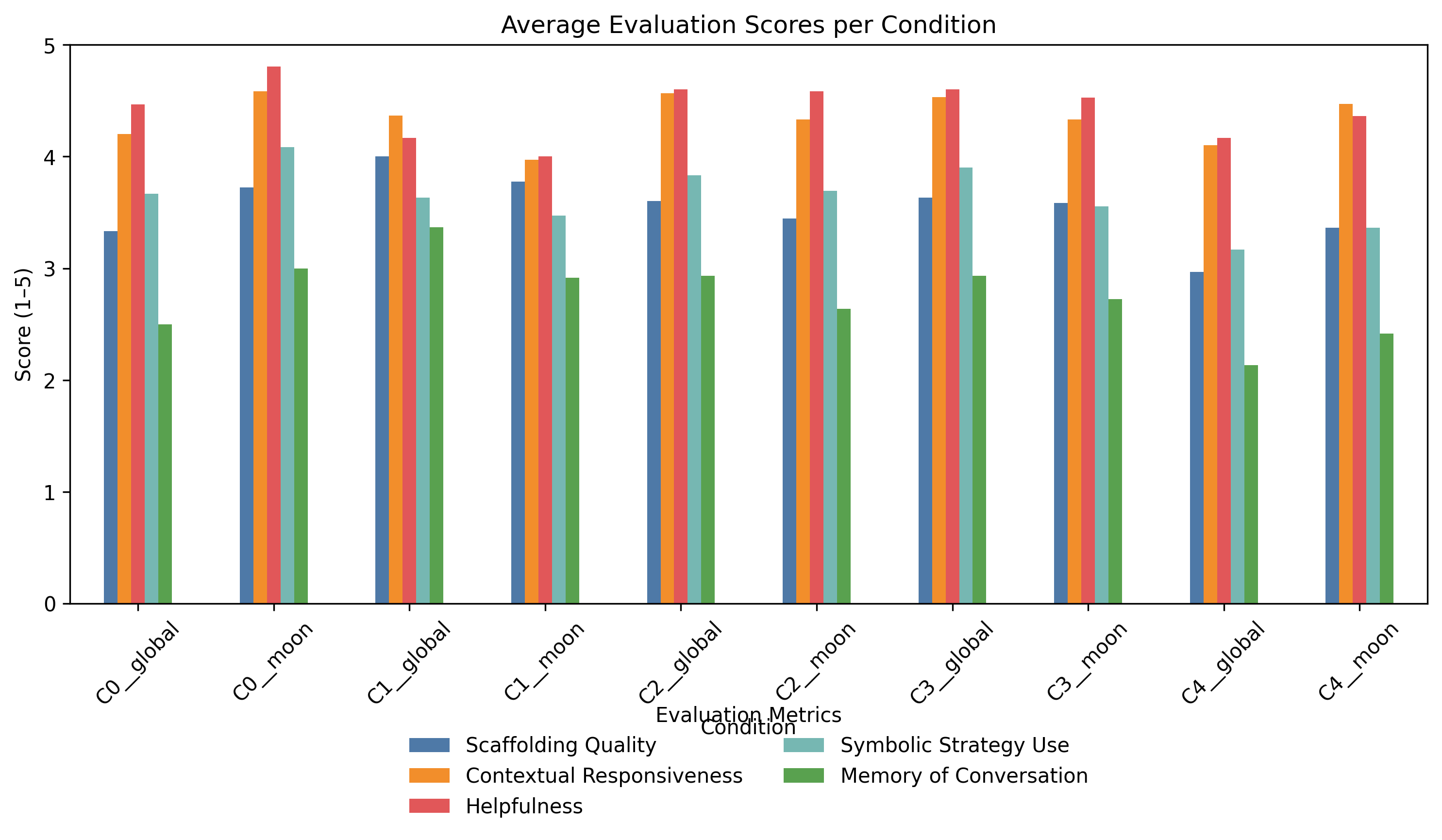

- 实验结果表明,该方法显著提升了LLM在支架搭建、响应性、符号推理和对话记忆等方面的性能。

📝 摘要(中文)

本文研究了提示级别的归纳偏置如何影响大型语言模型(LLM)在教学对话中的认知行为。我们引入了一种符号支架方法,并结合一个短期记忆模式,旨在促进苏格拉底式辅导中的自适应、结构化推理。通过对五个系统变体进行受控消融实验,我们使用专家设计的评分标准评估模型输出,涵盖支架搭建、响应性、符号推理和对话记忆。我们展示了使用基于LLM的评估框架的初步结果,该框架与认知基础的评分标准对齐。这使得早期实验中能够对架构变体进行可扩展的系统比较。初步结果表明,我们的完整系统始终优于基线变体。分析表明,移除记忆或符号结构会降低关键的认知行为,包括抽象、自适应探测和概念连续性。这些发现支持了一种处理层面的解释,即提示级别的认知支架可以可靠地塑造LLM中涌现的教学策略。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在教学对话中,特别是苏格拉底式辅导场景下,缺乏自适应性和结构化推理能力的问题。现有方法往往难以引导LLM进行有效的提问、概念解释和知识迁移,导致教学效果不佳。现有方法的痛点在于缺乏有效的认知引导机制,使得LLM难以模拟人类导师的认知过程。

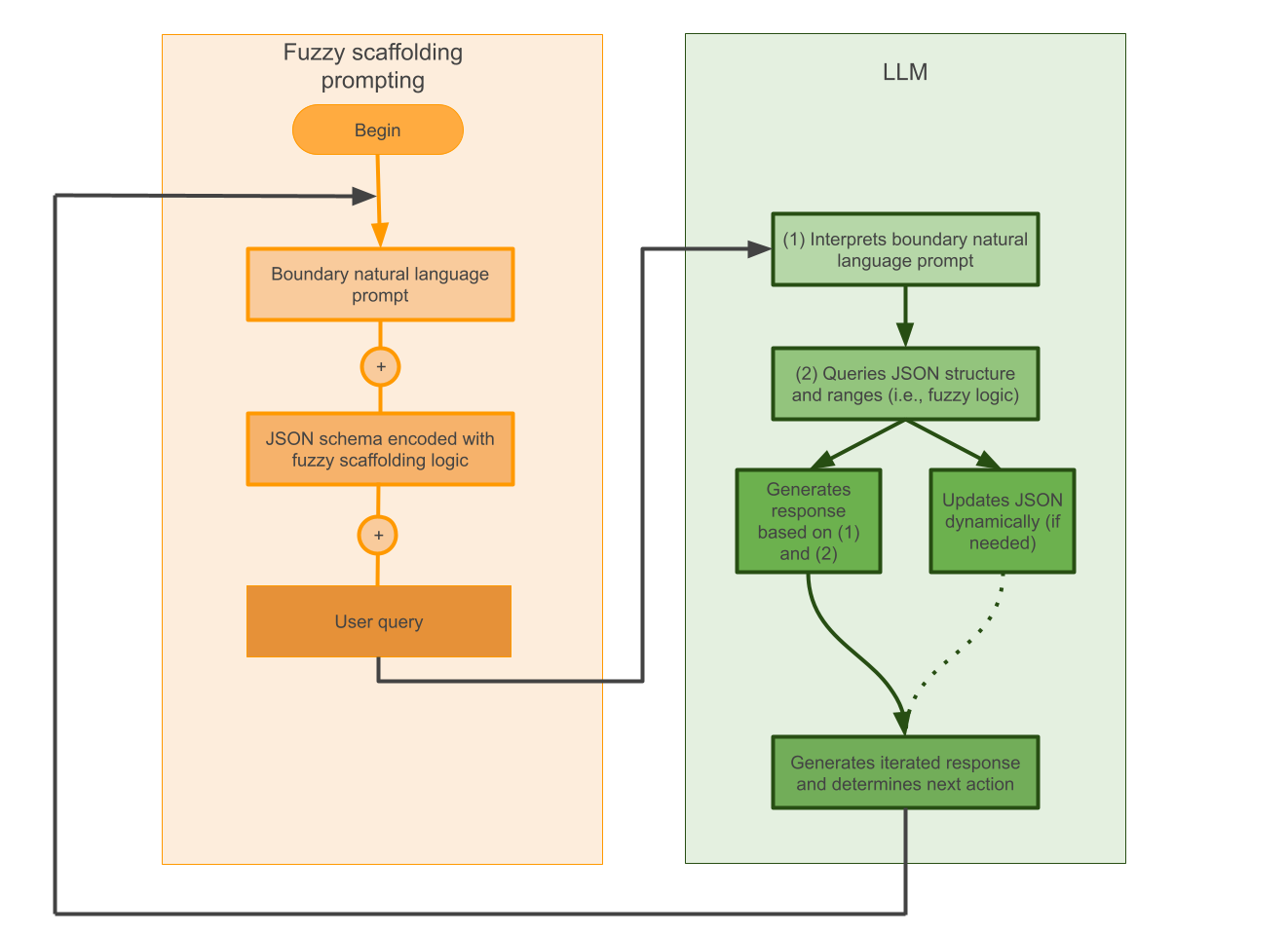

核心思路:论文的核心思路是通过在提示层面构建认知支架,引导LLM进行结构化推理和自适应学习。具体来说,论文引入了符号支架方法和短期记忆模式,模拟人类认知过程中的知识组织和推理过程。通过精心设计的提示,促使LLM在对话中进行抽象、探测和概念连接,从而实现更有效的教学。

技术框架:论文提出的技术框架主要包含以下几个部分:1) 符号支架:通过在提示中引入符号化的知识表示和推理规则,引导LLM进行结构化推理。2) 短期记忆模式:设计一个短期记忆模块,用于存储和检索对话历史信息,从而支持LLM进行上下文相关的推理和学习。3) LLM:使用大型语言模型作为核心的对话引擎,负责生成对话内容和进行知识推理。4) 评估框架:构建一个基于LLM的评估框架,用于评估模型在支架搭建、响应性、符号推理和对话记忆等方面的性能。

关键创新:论文最重要的技术创新点在于提出了prompt-level的认知支架概念,并通过符号化和短期记忆模式的具体实现,有效地提升了LLM在教学对话中的认知能力。与现有方法相比,该方法更加注重对LLM认知过程的引导,而非仅仅依赖于大量的数据训练。这种方法能够更好地利用LLM的推理能力,实现更有效的教学。

关键设计:论文的关键设计包括:1) 符号支架的具体形式:例如,使用特定的符号表示概念、关系和推理规则。2) 短期记忆模式的实现方式:例如,使用滑动窗口或注意力机制来存储和检索对话历史信息。3) 提示工程的设计:例如,如何设计提示来引导LLM进行抽象、探测和概念连接。4) 评估指标的设计:例如,如何量化评估模型在支架搭建、响应性、符号推理和对话记忆等方面的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,论文提出的完整系统在支架搭建、响应性、符号推理和对话记忆等方面始终优于基线变体。分析表明,移除记忆或符号结构会显著降低关键认知行为,包括抽象、自适应探测和概念连续性。这些结果验证了prompt-level认知支架对LLM教学策略的有效性。

🎯 应用场景

该研究成果可应用于智能教育系统、在线辅导平台和个性化学习工具等领域。通过提升LLM在教学对话中的认知能力,可以实现更有效的知识传递和技能培养,从而提高学习效率和学习体验。未来,该方法有望应用于更广泛的人机交互场景,例如智能客服、虚拟助手和游戏AI等。

📄 摘要(原文)

We study how prompt-level inductive biases influence the cognitive behavior of large language models (LLMs) in instructional dialogue. We introduce a symbolic scaffolding method paired with a short-term memory schema designed to promote adaptive, structured reasoning in Socratic tutoring. Using controlled ablation across five system variants, we evaluate model outputs via expert-designed rubrics covering scaffolding, responsiveness, symbolic reasoning, and conversational memory. We present preliminary results using an LLM-based evaluation framework aligned to a cognitively grounded rubric. This enables scalable, systematic comparisons across architectural variants in early-stage experimentation. The preliminary results show that our full system consistently outperforms baseline variants. Analysis reveals that removing memory or symbolic structure degrades key cognitive behaviors, including abstraction, adaptive probing, and conceptual continuity. These findings support a processing-level account in which prompt-level cognitive scaffolds can reliably shape emergent instructional strategies in LLMs.