Language-Guided Tuning: Enhancing Numeric Optimization with Textual Feedback

作者: Yuxing Lu, Yucheng Hu, Nan Sun, Xukai Zhao

分类: cs.AI, cs.CL, cs.LG, cs.MA

发布日期: 2025-08-21

备注: 9 pages, 4 figures, 4 tables

💡 一句话要点

提出语言引导调优(LGT),利用大语言模型和文本反馈提升数值优化效果。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言引导调优 大型语言模型 配置优化 文本反馈 多智能体系统

📋 核心要点

- 现有配置优化方法缺乏可解释性,难以适应动态变化,且无法有效进行语义推理。

- LGT利用多智能体大语言模型,通过自然语言推理和文本反馈来智能优化配置。

- 在六个数据集上的实验表明,LGT显著优于传统方法,同时保持了良好的可解释性。

📝 摘要(中文)

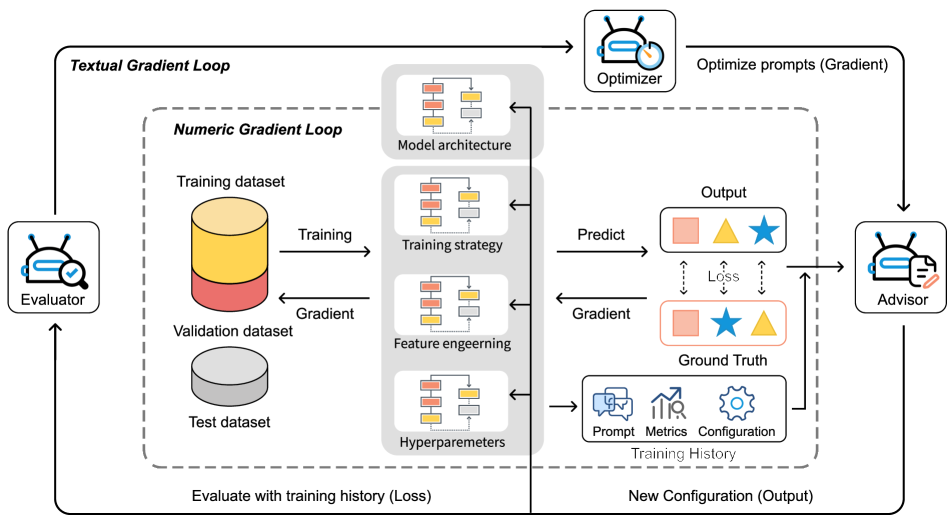

配置优化是机器学习中的一个关键瓶颈,需要在模型架构、训练策略、特征工程和超参数等方面进行协调调整。传统方法独立处理这些维度,缺乏可解释性,而最近的自动化方法在动态适应性和优化决策的语义推理方面存在困难。我们引入了语言引导调优(LGT),这是一个新颖的框架,它采用多智能体大型语言模型,通过自然语言推理智能地优化配置。我们应用文本梯度——定性反馈信号,通过提供对训练动态和配置相互依赖性的语义理解来补充数值优化。LGT协调三个专门的智能体:一个提出配置更改的顾问、一个评估进度的评估者和一个改进决策过程的优化器,从而创建一个自我改进的反馈循环。通过对六个不同数据集的全面评估,LGT证明了相对于传统优化方法的显著改进,在保持高可解释性的同时实现了性能提升。

🔬 方法详解

问题定义:论文旨在解决机器学习中配置优化的问题,包括模型架构、训练策略、特征工程和超参数的协同调整。现有方法要么独立处理这些维度,缺乏可解释性;要么自动化方法难以适应动态变化,并且缺乏对优化决策的语义理解,导致优化效率低下。

核心思路:论文的核心思路是利用大型语言模型(LLM)的自然语言处理能力,通过文本反馈来指导数值优化过程。通过将优化过程转化为LLM可以理解和推理的语言,从而实现更智能、更可解释的配置优化。这种方法借鉴了人类专家通过语言交流和经验总结来优化配置的思路。

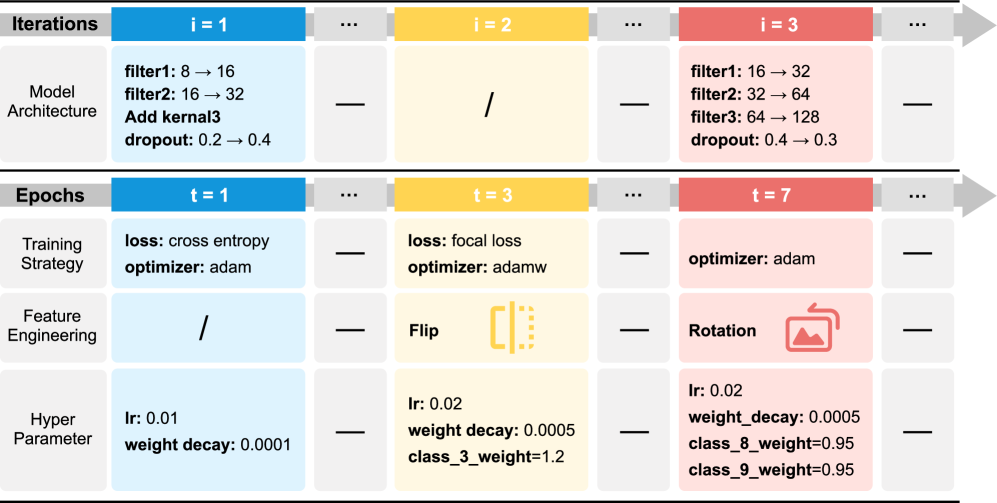

技术框架:LGT框架包含三个主要智能体:顾问(Advisor)、评估者(Evaluator)和优化器(Optimizer)。顾问负责提出配置更改建议;评估者负责评估当前配置的性能和训练动态,并生成文本反馈;优化器负责根据评估者的反馈,调整顾问的决策过程,从而形成一个自我改进的反馈循环。整个流程通过自然语言进行信息传递和协调。

关键创新:LGT的关键创新在于引入了“文本梯度”的概念,即利用自然语言描述训练动态和配置依赖关系,作为数值优化的补充信息。这种文本梯度能够提供更丰富的语义信息,帮助LLM更好地理解优化过程,从而做出更明智的决策。此外,LGT的多智能体架构也能够有效地协调不同角色的任务,实现更高效的优化。

关键设计:LGT的关键设计包括:(1) 如何设计合适的提示(Prompt)来引导LLM生成有用的配置建议和评估反馈;(2) 如何将文本反馈有效地融入到优化器的决策过程中,例如,可以通过强化学习或策略梯度等方法来训练优化器;(3) 如何选择合适的LLM,并对其进行微调,以适应特定的优化任务。

🖼️ 关键图片

📊 实验亮点

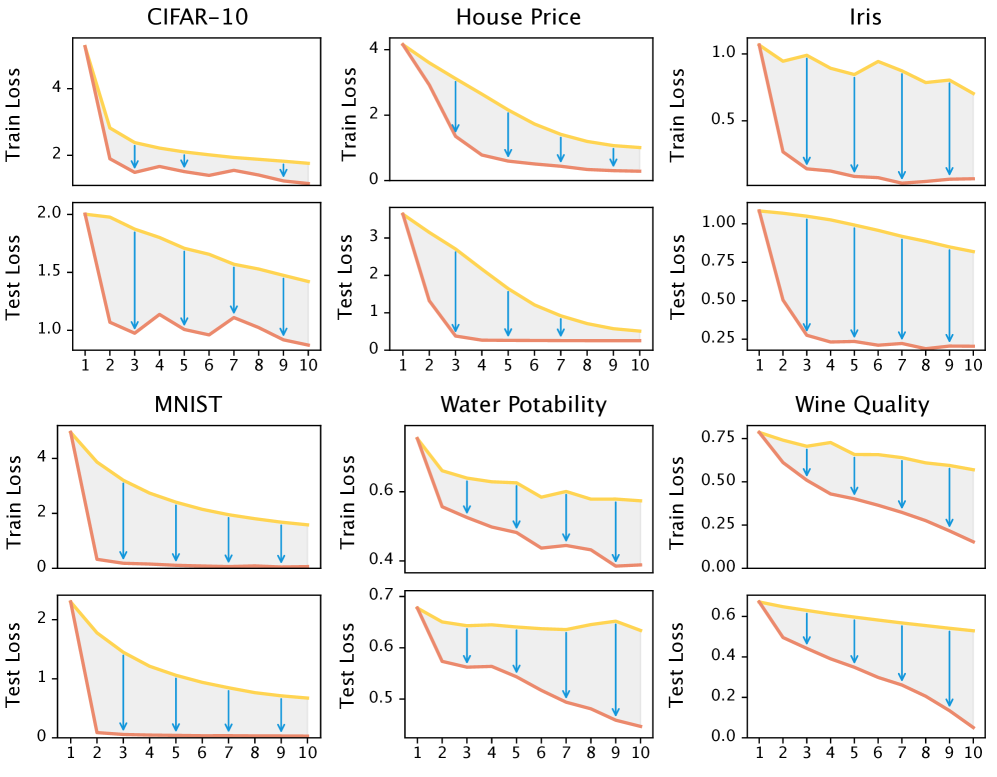

LGT在六个不同的数据集上进行了评估,结果表明LGT显著优于传统的优化方法。具体而言,LGT在多个数据集上取得了最高的性能,并且在保持高性能的同时,提供了更强的可解释性。实验结果验证了LGT框架的有效性和优越性。

🎯 应用场景

LGT可应用于各种机器学习模型的自动配置优化,例如深度学习模型的超参数调优、强化学习算法的策略搜索等。该方法能够提高模型性能,降低人工调参成本,并提供可解释的优化过程,有助于研究人员更好地理解模型行为。未来,LGT有望扩展到更广泛的优化问题,例如自动特征工程、模型架构搜索等。

📄 摘要(原文)

Configuration optimization remains a critical bottleneck in machine learning, requiring coordinated tuning across model architecture, training strategy, feature engineering, and hyperparameters. Traditional approaches treat these dimensions independently and lack interpretability, while recent automated methods struggle with dynamic adaptability and semantic reasoning about optimization decisions. We introduce Language-Guided Tuning (LGT), a novel framework that employs multi-agent Large Language Models to intelligently optimize configurations through natural language reasoning. We apply textual gradients - qualitative feedback signals that complement numerical optimization by providing semantic understanding of training dynamics and configuration interdependencies. LGT coordinates three specialized agents: an Advisor that proposes configuration changes, an Evaluator that assesses progress, and an Optimizer that refines the decision-making process, creating a self-improving feedback loop. Through comprehensive evaluation on six diverse datasets, LGT demonstrates substantial improvements over traditional optimization methods, achieving performance gains while maintaining high interpretability.