Understanding Action Effects through Instrumental Empowerment in Multi-Agent Reinforcement Learning

作者: Ardian Selmonaj, Miroslav Strupl, Oleg Szehr, Alessandro Antonucci

分类: cs.AI, cs.IT, cs.LG, cs.MA

发布日期: 2025-08-21 (更新: 2025-08-23)

备注: European Conference on Artificial Intelligence (ECAI) 2025

💡 一句话要点

提出基于工具性赋权的ICV方法,用于理解多智能体强化学习中的行为效应

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 行为理解 工具性赋权 Shapley值 信息论 合作博弈 策略分析

📋 核心要点

- 现有MARL方法依赖显式奖励信号评估团队表现,难以在无价值反馈时推断个体智能体的贡献。

- 提出Intended Cooperation Values (ICV)方法,基于信息论Shapley值量化智能体对队友工具性赋权的因果影响。

- 通过分析合作和竞争任务,ICV能识别有益的智能体行为,揭示智能体策略的相似性和多样性。

📝 摘要(中文)

为了可靠地部署多智能体强化学习(MARL)系统,理解个体智能体的行为至关重要。现有工作通常基于显式奖励信号评估整体团队表现,但如何在没有任何价值反馈的情况下推断智能体的贡献尚不清楚。本文研究了是否可以通过仅分析策略分布来提取对智能体行为的有意义的见解。受到智能体倾向于追求收敛的工具性价值这一现象的启发,我们引入了预期合作价值(ICV),这是一种基于信息论Shapley值的量化方法,用于衡量每个智能体对其合作者的工具性赋权所产生的因果影响。具体而言,ICV通过评估其决策的(不)确定性和偏好对齐来衡量智能体的行为对其队友策略的影响。通过分析合作和竞争MARL任务中策略和价值函数的行为影响,我们的方法可以识别哪些智能体行为有利于团队成功,无论是通过促进确定性决策还是通过保持未来行动选择的灵活性,同时揭示智能体采用相似或多样化策略的程度。我们提出的方法为合作动态提供了新的见解,并增强了MARL系统的可解释性。

🔬 方法详解

问题定义:在多智能体强化学习(MARL)中,理解个体智能体的行为对于系统部署至关重要。然而,现有方法主要依赖于显式的奖励信号来评估团队的整体表现,缺乏在没有价值反馈的情况下推断个体智能体贡献的有效手段。这使得我们难以理解智能体之间的合作机制,以及每个智能体对团队成功所起的作用。现有方法的痛点在于缺乏对智能体策略的细粒度分析,以及对智能体间相互影响的有效建模。

核心思路:本文的核心思路是借鉴智能体倾向于追求收敛的工具性价值这一现象,通过分析智能体的策略分布来推断其行为对其他智能体的影响。具体来说,论文提出了Intended Cooperation Values (ICV) 方法,该方法基于信息论的Shapley值,用于量化每个智能体对其合作者的工具性赋权所产生的因果影响。这种方法的核心在于,通过分析智能体行为对其他智能体策略的影响,可以揭示智能体之间的合作关系和个体贡献。

技术框架:ICV方法的技术框架主要包括以下几个步骤:1) 收集多智能体系统的策略数据,包括每个智能体的行动和观察;2) 使用信息论的工具,例如熵和互信息,来衡量每个智能体策略的确定性和与其他智能体策略的对齐程度;3) 使用Shapley值来量化每个智能体对其合作者的工具性赋权所产生的因果影响。Shapley值是一种合作博弈论中的概念,可以用来衡量每个参与者对整体合作价值的贡献。在这个框架中,每个智能体被视为一个参与者,而整体合作价值被定义为所有智能体策略的联合效用。

关键创新:本文最重要的技术创新点在于提出了Intended Cooperation Values (ICV) 方法,该方法将信息论和Shapley值相结合,用于量化每个智能体对其合作者的工具性赋权所产生的因果影响。与现有方法相比,ICV方法不需要显式的奖励信号,而是通过分析智能体的策略分布来推断其行为的影响。这使得ICV方法可以在没有价值反馈的情况下,有效地理解智能体之间的合作机制和个体贡献。

关键设计:ICV方法的关键设计包括以下几个方面:1) 使用熵来衡量每个智能体策略的确定性,熵越低表示策略越确定;2) 使用互信息来衡量每个智能体策略与其他智能体策略的对齐程度,互信息越高表示策略越对齐;3) 使用Shapley值来量化每个智能体对其合作者的工具性赋权所产生的因果影响,Shapley值越高表示智能体的贡献越大。此外,论文还设计了一系列的实验,用于验证ICV方法在合作和竞争MARL任务中的有效性。

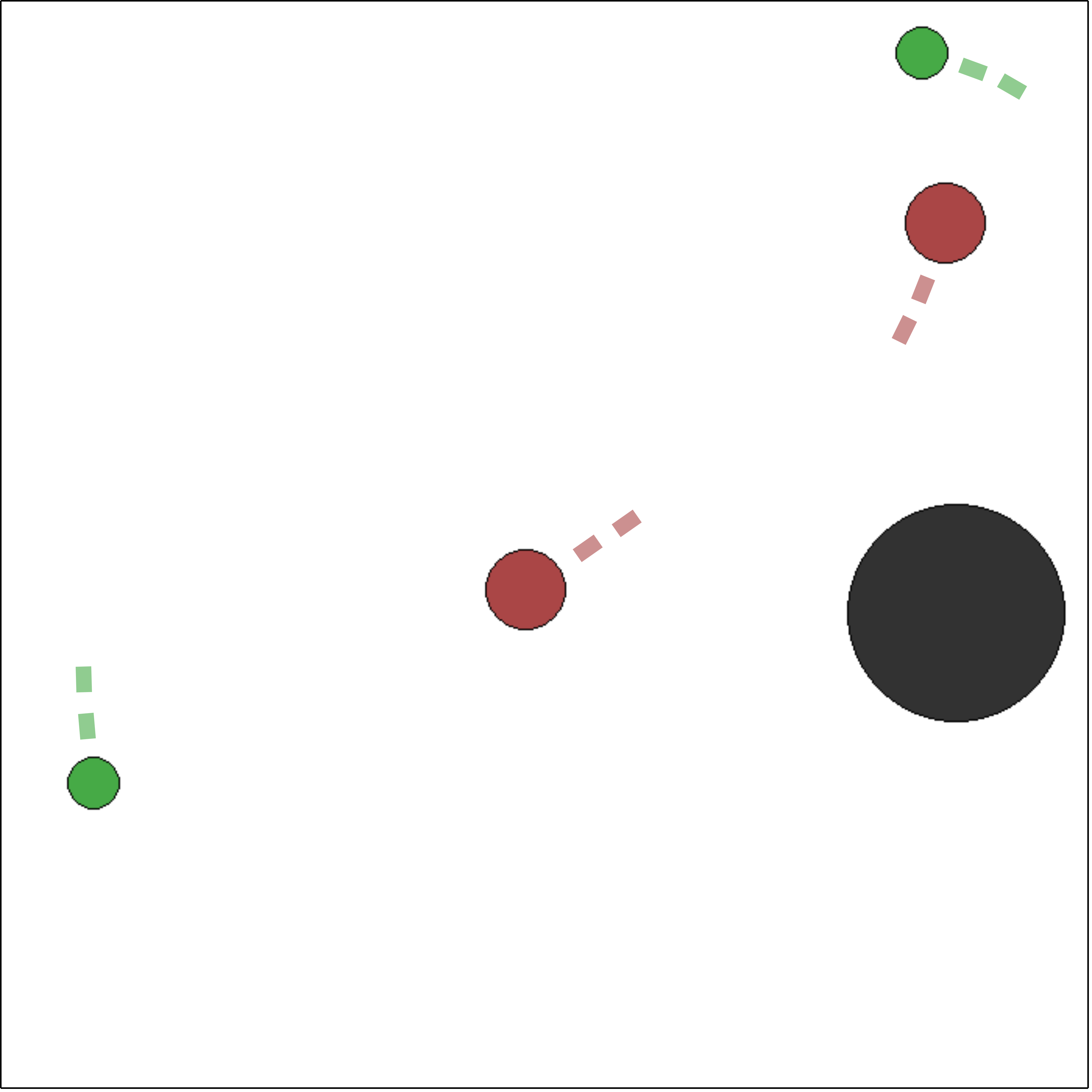

🖼️ 关键图片

📊 实验亮点

论文在合作和竞争MARL任务中验证了ICV方法的有效性。实验结果表明,ICV能够准确识别对团队成功有益的智能体行为,并揭示智能体策略的相似性和多样性。例如,在合作任务中,ICV能够识别出促进确定性决策的智能体,而在竞争任务中,ICV能够识别出保持未来行动选择灵活性的智能体。这些结果表明,ICV方法可以为理解MARL系统的合作动态提供新的见解。

🎯 应用场景

该研究成果可应用于各种多智能体系统,例如机器人协同、交通调度、资源分配等。通过理解个体智能体的行为和贡献,可以优化系统设计,提高整体性能和鲁棒性。此外,该方法还可用于评估智能体策略的安全性,避免出现不良行为,从而促进MARL系统的可靠部署和应用。

📄 摘要(原文)

To reliably deploy Multi-Agent Reinforcement Learning (MARL) systems, it is crucial to understand individual agent behaviors. While prior work typically evaluates overall team performance based on explicit reward signals, it is unclear how to infer agent contributions in the absence of any value feedback. In this work, we investigate whether meaningful insights into agent behaviors can be extracted solely by analyzing the policy distribution. Inspired by the phenomenon that intelligent agents tend to pursue convergent instrumental values, we introduce Intended Cooperation Values (ICVs), a method based on information-theoretic Shapley values for quantifying each agent's causal influence on their co-players' instrumental empowerment. Specifically, ICVs measure an agent's action effect on its teammates' policies by assessing their decision (un)certainty and preference alignment. By analyzing action effects on policies and value functions across cooperative and competitive MARL tasks, our method identifies which agent behaviors are beneficial to team success, either by fostering deterministic decisions or by preserving flexibility for future action choices, while also revealing the extent to which agents adopt similar or diverse strategies. Our proposed method offers novel insights into cooperation dynamics and enhances explainability in MARL systems.