Coarse-to-Fine Grounded Memory for LLM Agent Planning

作者: Wei Yang, Jinwei Xiao, Hongming Zhang, Qingyang Zhang, Yanna Wang, Bo Xu

分类: cs.AI

发布日期: 2025-08-21

备注: Accepted to EMNLP 2025 Main Conference;27 pages,15 figures

💡 一句话要点

提出粗细粒度对齐记忆框架,提升LLM Agent在复杂规划任务中的适应性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 复杂规划 记忆机制 粗细粒度对齐 环境适应性

📋 核心要点

- 现有LLM Agent依赖单一粒度记忆,经验质量限制了知识多样性和规划灵活性。

- 提出粗细粒度对齐记忆框架,通过多粒度信息对齐提升LLM Agent的适应性。

- 框架通过粗粒度引导经验收集,细粒度支持异常处理,实现灵活规划。

📝 摘要(中文)

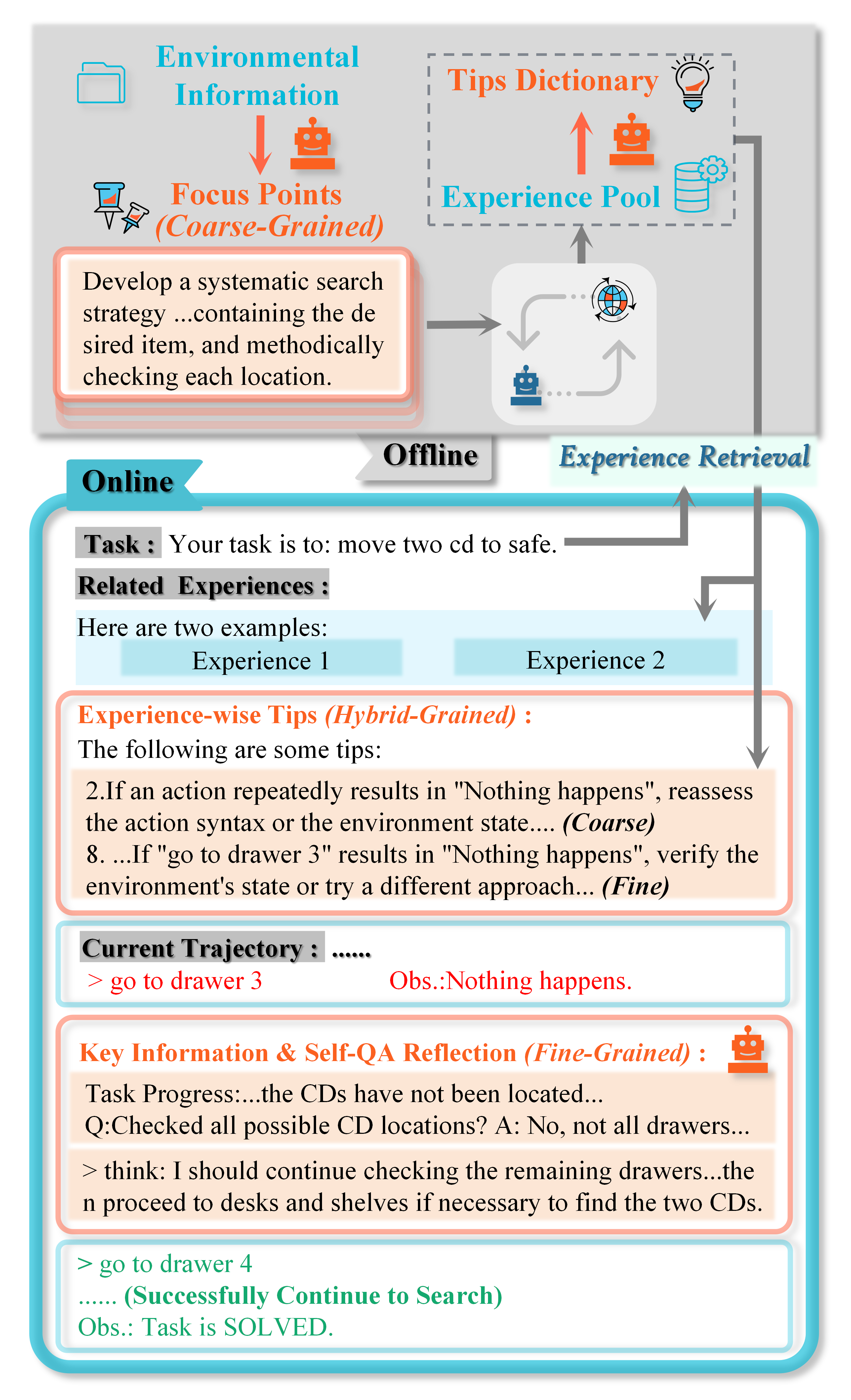

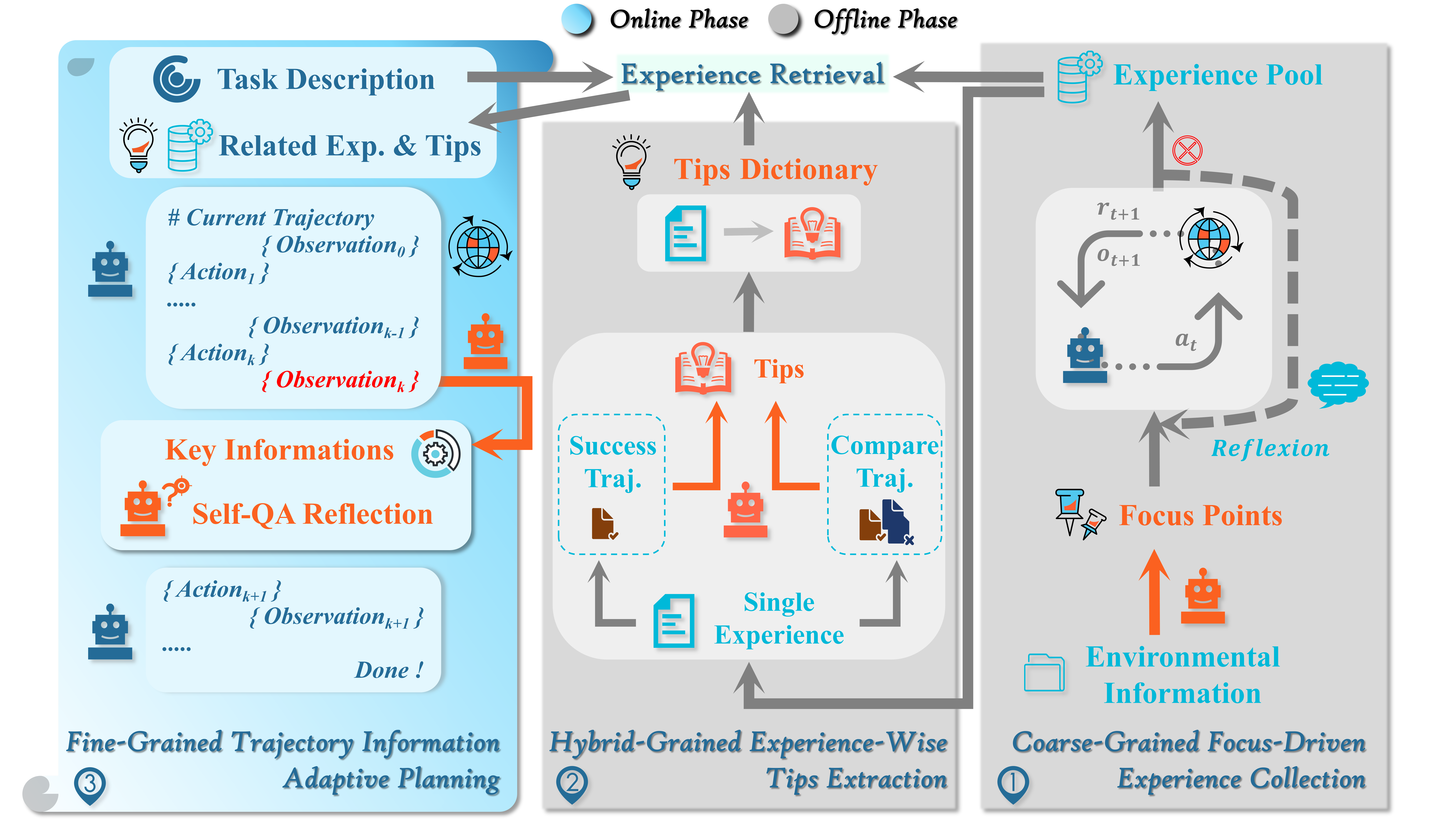

本文提出了一种名为粗细粒度对齐记忆(Coarse-to-Fine Grounded Memory)的新框架,旨在提升基于大型语言模型(LLM)的Agent在复杂规划任务中的性能。现有方法依赖于单一粒度的记忆,受限于收集到的经验质量,从而限制了知识的多样性和规划的灵活性。该框架将环境信息对齐到粗粒度的焦点,以指导训练任务中的经验收集,然后从每个经验中对齐可操作的混合粒度提示。在推理阶段,检索与任务相关的经验和提示来支持规划。当面对环境异常时,LLM将当前情况对齐到细粒度的关键信息,从而实现灵活的自我问答反思和计划修正。

🔬 方法详解

问题定义:现有基于LLM的Agent在复杂规划任务中,依赖于从动态环境交互中获得的单一粒度记忆。这种方法的痛点在于,记忆的质量严重依赖于收集到的经验,如果经验不足或者质量不高,就会限制Agent的知识多样性和规划的灵活性,尤其是在面对环境异常时,Agent难以进行有效的自我反思和计划修正。

核心思路:论文的核心思路是引入粗细粒度对齐的记忆机制,通过多粒度信息来增强LLM Agent的适应性。具体来说,首先利用粗粒度的环境信息引导经验收集,然后在经验中提取混合粒度的提示信息。在推理阶段,根据任务相关性检索记忆,并在面对环境异常时,利用细粒度信息进行自我反思和计划修正。这样设计的目的是为了充分利用不同粒度的信息,提高Agent在各种场景下的规划能力。

技术框架:Coarse-to-Fine Grounded Memory框架包含三个主要阶段:1) 粗粒度引导的经验收集:将环境信息对齐到粗粒度的焦点,用于指导训练任务中的经验收集。2) 混合粒度提示提取:从每个经验中对齐可操作的混合粒度提示信息。3) 推理与异常处理:在推理阶段,检索与任务相关的经验和提示来支持规划;当面对环境异常时,LLM将当前情况对齐到细粒度的关键信息,从而实现灵活的自我问答反思和计划修正。

关键创新:该方法最重要的创新点在于提出了粗细粒度对齐的记忆机制。与现有方法只关注单一粒度记忆不同,该方法能够充分利用不同粒度的信息,从而提高Agent在各种场景下的适应性和规划能力。通过粗粒度信息引导经验收集,混合粒度信息支持规划,细粒度信息支持异常处理,实现了更灵活和鲁棒的Agent。

关键设计:论文中没有明确给出关键的参数设置、损失函数、网络结构等技术细节。这些细节可能与具体的实验环境和任务相关,需要在实际应用中进行调整和优化。论文重点在于框架的设计和思想的提出,具体的实现细节可能需要参考相关的LLM和Agent技术。

🖼️ 关键图片

📊 实验亮点

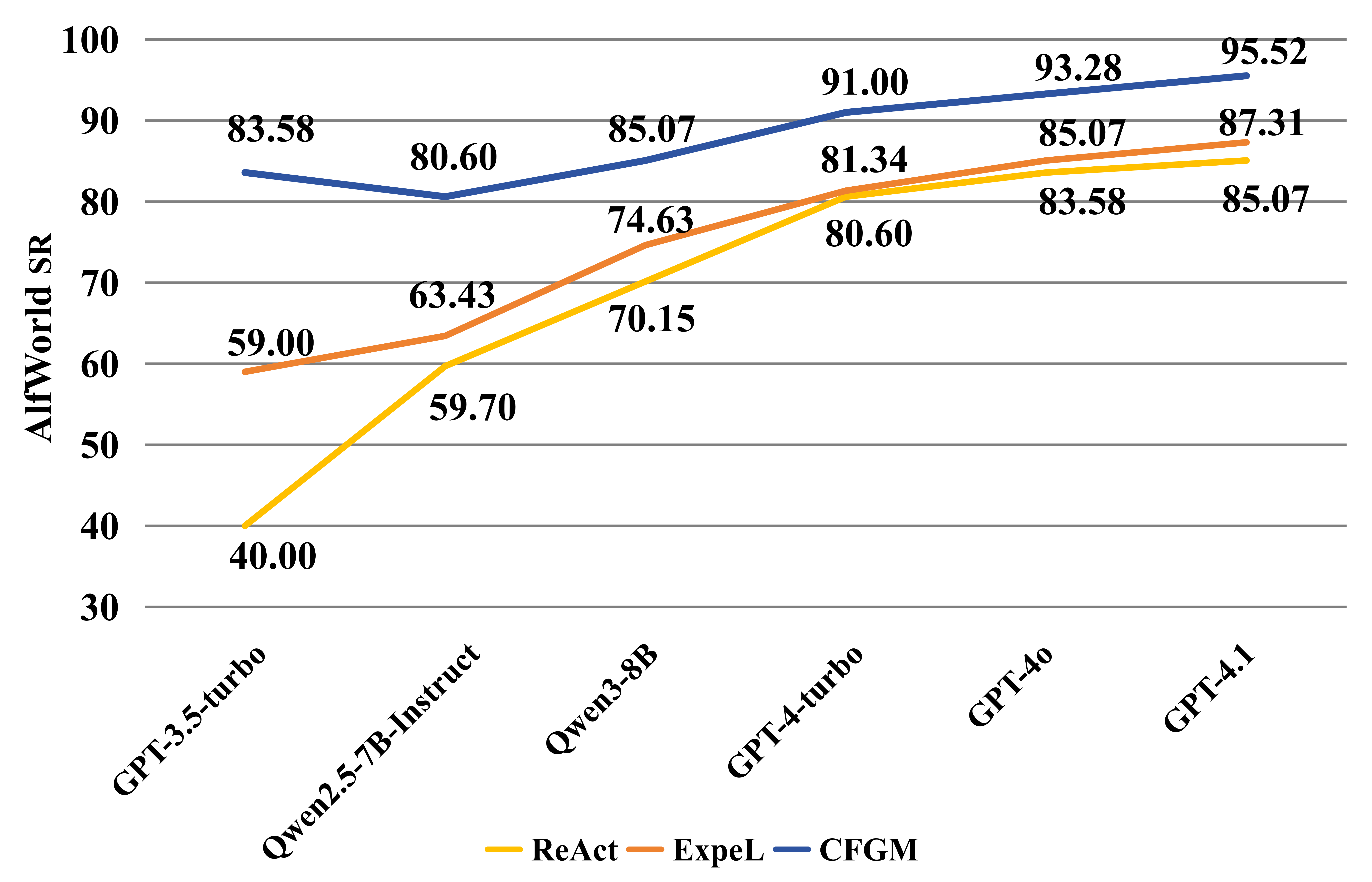

论文摘要中没有明确给出具体的实验数据和对比结果。因此,无法总结实验亮点。需要阅读论文全文才能了解具体的实验设置、对比基线和性能提升。

🎯 应用场景

该研究成果可应用于各种需要智能规划的领域,例如机器人导航、游戏AI、智能助手等。通过提升LLM Agent在复杂环境下的适应性和规划能力,可以实现更智能、更可靠的自动化系统,具有广泛的应用前景和实际价值。未来,该方法有望进一步扩展到更多领域,并与其他技术相结合,推动人工智能的发展。

📄 摘要(原文)

Recent advancements in Large Language Models (LLMs) have driven growing interest in LLM-based agents for complex planning tasks. To avoid costly agent training, many studies adopted memory mechanism that enhances LLM with offline experiences or online trajectory analysis. However, existing works focus on single-granularity memory derived from dynamic environmental interactions, which are inherently constrained by the quality of the collected experiences. This limitation, in turn, constrain the diversity of knowledge and the flexibility of planning. We propose Coarse-to-Fine Grounded Memory (\Ours{}), a novel framework that grounds coarse-to-fine memories with LLM, thereby fully leverage them for flexible adaptation to diverse scenarios. \Ours{} grounds environmental information into coarse-grained focus points to guide experience collection in training tasks, followed by grounding of actionable hybrid-grained tips from each experience. At inference, \Ours{} retrieves task-relevant experiences and tips to support planning. When facing environmental anomalies, the LLM grounds the current situation into fine-grained key information, enabling flexible self-QA reflection and plan correction.